日期:2016年4月

单位:University of Applied Sciences Western Switzerland

期刊/会议:ESANN

目录

Abstract

能够拍摄农田高分辨率图像的低成本无人机的出现,为航空场景理解带来了新的挑战和机遇。本文解决了从航空图像中识别作物类型的问题,并提出了一种新的混合神经网络结构,它结合了直方图和卷积单元。我们评估了混合模型在23类分类任务中的性能,并将其与基于卷积和直方图的模型进行了比较。其结果是提高了分类性能。

1 Introduction

在过去几年中,UAV工业已经从一个小众市场发展到主流可用性,降低了航空图像采集成本,并为许多有趣的应用开辟了道路。在农业方面,这些新的数据源可用于帮助农民和决策者更好地了解和管理作物。

利用无人机图像的自动作物分类系统将有助于许多研究。例如,在侵蚀风险评估中,有必要对几个种植者的整个景观进行概述,因为水流取决于土壤覆盖率和年度变化(作物轮作)。其他领域,如流域管理和作物产量估算也可以从这种分类中受益。

之前有许多作品在农业背景下使用无人机图像。在[1]中,作者使用神经网络,利用遥感图像对不同作物进行分类,以帮助管理部门评估和确定目标他们的农业补贴计划。在[2]中,作者设计了一个程序来量化无人机图像中杂草的地面覆盖范围,以更好地瞄准除草剂。在[3]中,作者评估了不同的植被指数,以量化无人机图像中的植被覆盖率。此外,[4]和[5]探索了从航空图像中分割区域的问题。

在纹理分类领域,许多方法使用手工挑选的过滤器来提取特征,然后由分类器使用。在[6]中,作者提出了一种改进的局部二进制模式描述符,在[7]中,探索了一种新的基于直方图的旋转不变方法。在[8]中,作者探索了使用随机投影提取纹理描述符。

在本文中,我们探索了混合深度神经网络的使用,该网络将卷积层[9]与每窗口直方图相结合,以提高作物分类性能。我们表明,混合系统的性能优于任何一个单独的模型,并且得到的分类图是高质量的。

2 Dataset

我们在本文中使用的数据集是根据瑞士联邦农业研究中心进行的一系列实验中发布的实验农田的航空图像构建的。我们使用的特定图像如图1所示,覆盖了一个小区域(∼ 100×60m),其中播种不同植物物种进行农艺研究。

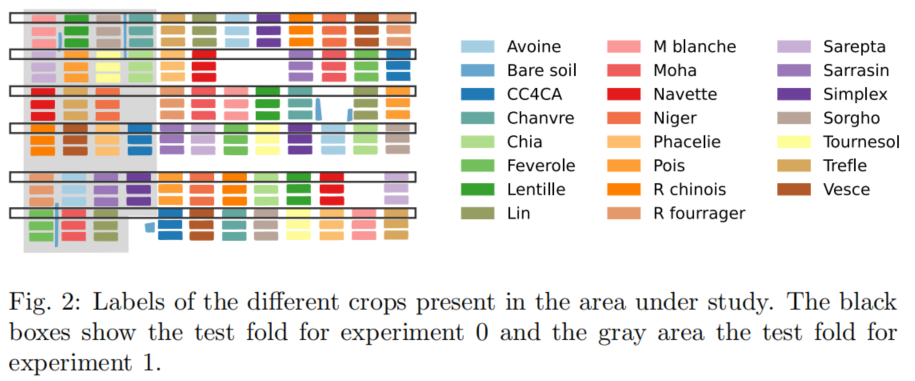

图2显示了在研究区域内发现的22种不同作物的空间分布情况(如果将裸土计算在内,则为23种)。RGB图像大小为2425×2175像素,地面分辨率为5 cm。作物被分成约6×8m的小块,每种作物重复3次。

根据两种不同的策略,将数据集分为训练部分和测试部分。图2显示了两个区域中产生褶皱的分布案例。黑色矩形中的包裹被用于构建实验0(实验0)的测试折叠,而实验1(实验1)则由浅灰色区域的包裹构建。对于某些作物,图像右下角的地块与左上角的地块不同,这使得实验1更加困难。

3 Models

为了推断像素的类别,我们向模型提供像素邻域窗口大小为21×21的信息3。

图1所示的图像表明,颜色和纹理似乎是区分不同作物类别的重要特征。因此,我们使用了一个深度神经网络,它由使用原始像素值的卷积边(CNN)和使用RGB his tograms的稠密边(HistNN)组成。两个网络的输出被预测每个像素类别的最后一层合并。

输入图像居中,以便所有通道都位于[−0.5,0.5]间隔。HistNN由两个32个单元的致密层组成,并由三个20个单元的直方图(每个通道一个)馈送。CNN由两个卷积层组成:第一层有48个11×11滤波器,第二层有48个子3×3滤波器。每层之后是一个最大2×2的池层。

CNN和HistNN的输出被合并到一个大小为128的稠密层中,然后使用softmax层预测23个目标类中的类概率。网络中的所有内层都具有校正的线性激活函数。

为了训练我们的网络,我们使用了Keras[11]深度学习库中包含的Adam[10]随机优化实现。我们保留了学习率α(α=0.001)、β1(β1=0.9)和β2(β2=0.999)的推荐参数,并使用了多类对数损失目标函数。

我们保证对60个epoch进行训练,批量大小为256个样本,并添加额外的缺失层以减少过度拟合。我们观察到,这些设置导致了良好的融合。对于培训阶段,每个窗口旋转0◦ , 90◦, 180◦ 和270◦ 强制学习的滤波器保持旋转不变,总共产生16万个示例。

我们首先分别培训了CNN和HistNN的模特。然后,我们添加合并层以获得合并模型,然后对其进行微调。虽然我们没有明确禁止在微调期间更新CNN和HistNN层,但我们观察到微调主要影响合并层。

4 Results

图3显示了我们测试的三个模型的分类性能。我们看到,由于折叠结构,实验1更难。在这两种情况下,我们的混合CNN HistNN网络的性能都优于单独的两种模式。在图4所示的最终分类图中,可以看到HistNN做出了更粗糙的预测,而CNN看起来更嘈杂。将两者合并可在地块内提供同质分类地图。尽管它表现出更好的性能,但合并网络的一个缺点是训练时间。对于一个时代,CNN需要53秒,合并网络需要57秒,而HistNN只需要6秒。

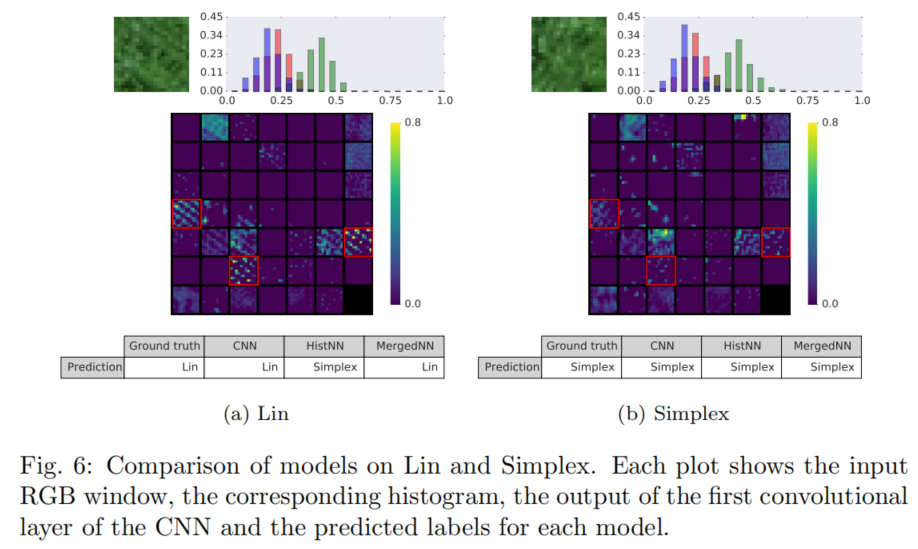

图5显示了每类和每种车型的F1测试分数,平均分为10次。对于大多数课程来说,HistNN的表现与CNN一样好或更好。对于像林和尼日尔这样的班级,CNN的表现比HistNN好。在图6中,我们比较了Lin类的示例窗口和Simplex类的窗口。我们可以看到,Lin窗口被HistNN错误地归类为Simplex。事实上,直方图非常相似,因此不可能仅根据颜色区分这两类。对于每个类,我们绘制了美国有线电视新闻网(CNN)对该窗口进行了申请。我们可以看到,对于Lin来说,CNN能够提取图像的对角线结构(图6中用红色方块突出显示)。在Lin类的其他示例上也可以进行类似的观察,这增强了我们的直觉,即纹理和颜色对我们数据集中的作物分类都很重要。

5 Conclusion

本文研究了基于无人机航空影像的农作物分类。我们提出了一种混合CNN-HistNN深度神经网络,它能够同时利用颜色分布和纹理模式成功地对多种作物进行分类。我们的模型在两种不同的折叠策略下表现出良好的性能,这表明了该方法的鲁棒性。进一步的工作应该探索模型的许多参数,例如CNN中的过滤器数量和层数。看看我们是否可以通过微调最后一层,将模型转移到具有不同场的新区域,这将很有趣。另一个有趣的问题是评估我们的模型对生长阶段进行分类的能力,这对于产量预测可能很有意义。