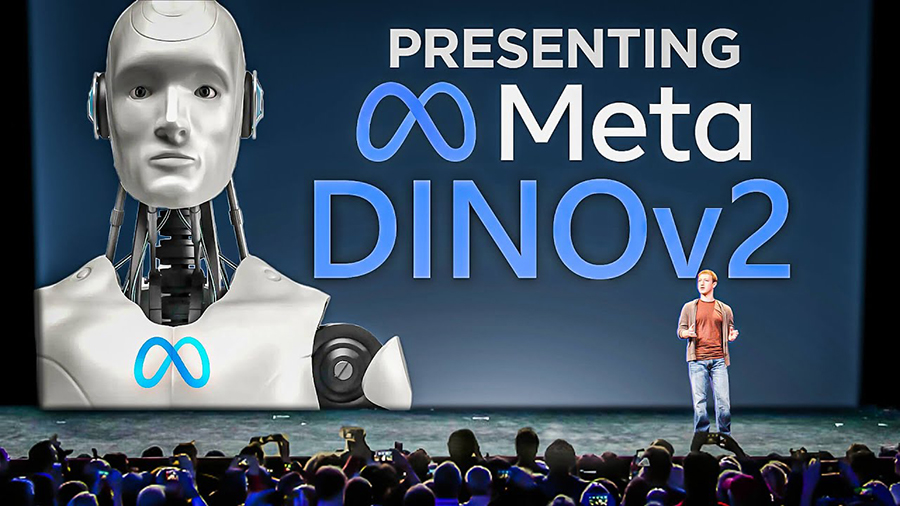

多模态技术已成为推动游戏内容与元宇宙建设的关键力量。扎克伯格表示,DINOv2 将被用于制作更具沉浸感的元宇宙。在 AI 大模型竞赛中,Meta 选择重押视觉模型,并在推出零样本分割一切的 SAM 后,扎克伯格亲自官宣了重量级开源项目 DINOv2。

据了解,DINOv2 是计算机视觉领域的预训练大模型,拥有 10 亿级参数量,采用 Transformer 架构,可在语义分割、图像检索和深度估计等方面实现自监督训练。无需微调,即可应用于多种下游任务,从而改善医学成像、粮食作物生长、地图绘制等领域。

所谓视觉模型,就是一种能够像人类一样看懂图像的程序。我们想象一下,你拿一张照片给它看,它能够告诉你这是一只猫、一辆车、一个人或者其他东西,而且能够非常准确地判断。

这些神奇的程序得益于深度学习技术,也就是让计算机通过大量的数据学习和理解图像。