【文章阅读】【超解像】–Image Restoration Using Convolutional Auto-encoders with Symmetric Skip Connections

RED-Net:Residual Encoder-Decoder Networks

论文链接:https://arxiv.org/abs/1606.08921

参考code: https://github.com/SSinyu/RED_CNN

1. 主要贡献

- 提出了卷积反卷积对称网络结构;

- 卷积和反卷积利用跳层结构相连;

- 提出的卷积反卷积架构可用于多任务,如image denoising,image super-resolution,JPEG deblocking, non-blind image deblurring image inpainting.

2. 论文分析

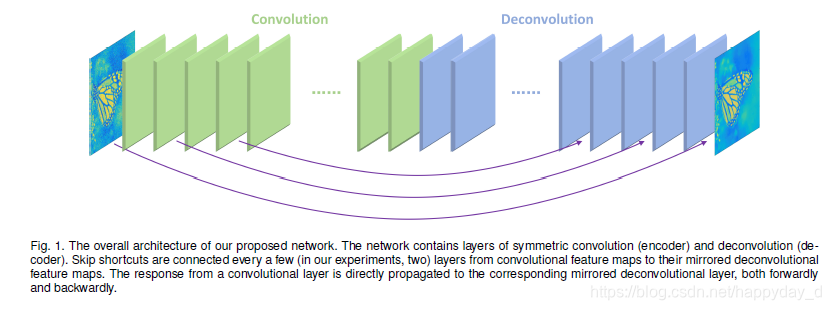

网络整体结构:

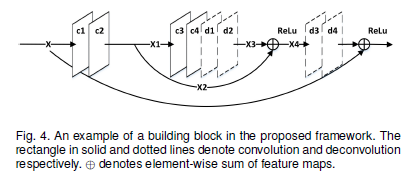

局部模块结构:

-

卷积反卷积网络结构

卷积:特征提取,随卷积进行,图像特征被提取,同时噪声的效果被降低,经过多层卷积后,图像的特征被提取出来,也降低了噪声的影响。

反卷积:针对特征的上采样,完成由图像特征到图像的转换,由于利用的是过滤后的噪声后的图像特征,因此达到了降噪、图像修复的目的。

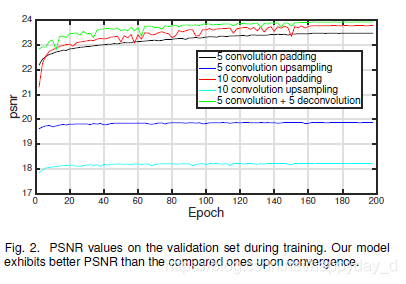

文中通过实验说明利用反卷积结构而不用padding 和upsampling的原因,如下图,反卷积对图像细节有补偿作用。

-

跳层结构(skip connections)

作用:

1)保留更多的图像细节,协助反卷积层完成图像的恢复工作;

2)反向传播过程中的梯度反向,减少梯度消失,加快模型训练,文章有一些公式推导说明跳层连接对梯度变化的好处,详见论文;

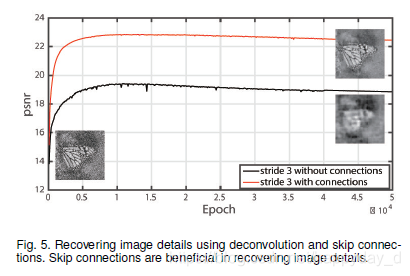

利用图像修复实验说明跳层作用:

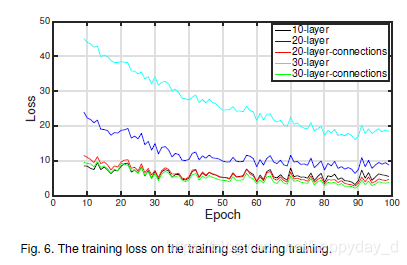

多层结构中跳层能减少梯度消失,如下图:

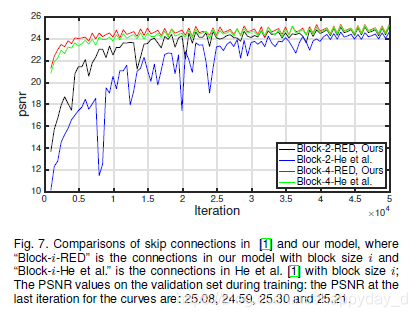

该跳层结构受何大神提出的Resnet激发,比较了该文提出的跳层结构和Resnet的跳层比较,本文提出效果较优:

-

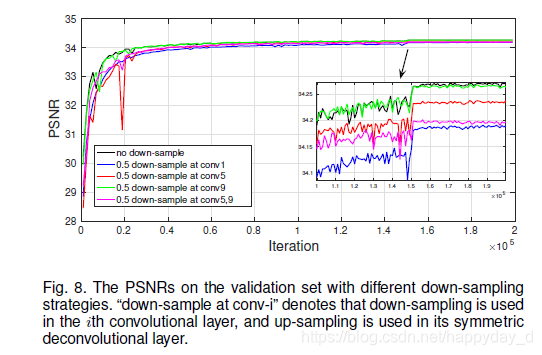

提升测试效率

为提升模型的运行速度,本文中提出在卷积层使用降采样,在反卷积层利用升采样恢复图像大小。利用实验比较了在不同卷积层降采样对最终性能的影响。

实验条件:图像大小160*240 , i7-2600CPU

降采样位置 运行时间(s) no down-sample 3.17 down-sample at conv1 0.84 down-sample at conv5 1.43 down-sample at conv5 2.0 down-sample at conv5,9 1.17 结果比较:

结论:在conv1处降采样,处理速度提升4倍,性能降低了0.1,根据具体应用进行trade-off -

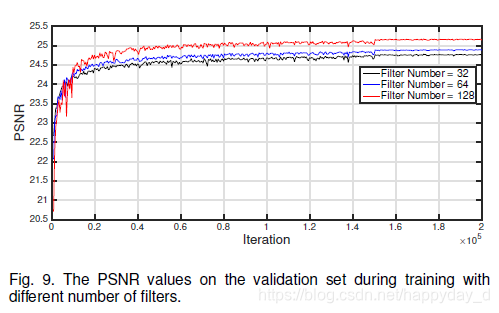

实验参数

损失函数:MSE

(a) filter number:滤波器大小为3x3,patch大小为50x50,跳层层数为2,不同的滤波个数,32,64,128,结果如下:

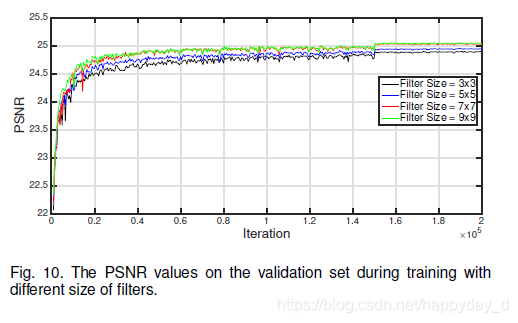

(b) filter size滤波器个数为64,patch大小为50x50,跳层层数为2,不同的滤波器大小为,3x3,5x5,7x7,9x9,结果如下:

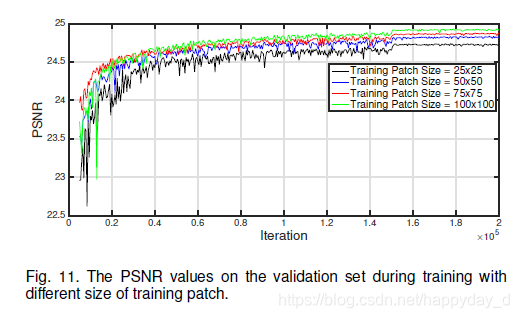

© training patch size滤波器个数为64,滤波器大小为3x3 ,跳层层数为2,不同的patch size,25x25, 50x50,75x75,100x100结果如下:

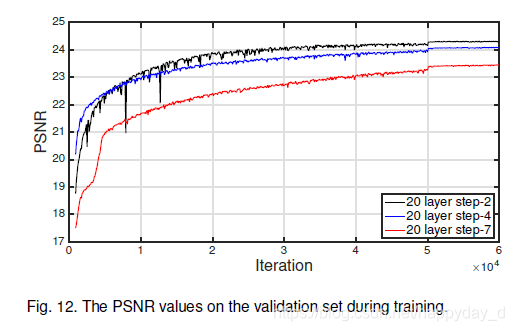

(d) step size pf skip connections滤波器个数为64,滤波器大小为3x3 ,跳层层数为2,4,7,不同的patch size为50x50结果如下:

结论:滤波器个数越多,大小越大,训练图像越大,跳层越少性能越好;

3. 结果分析

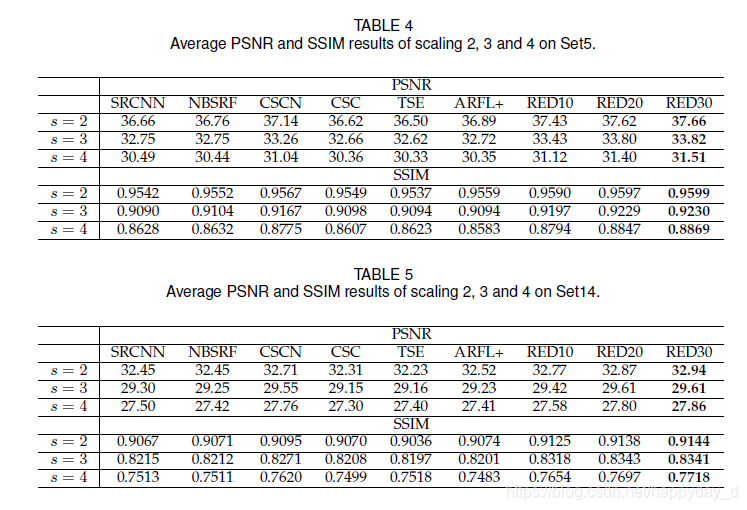

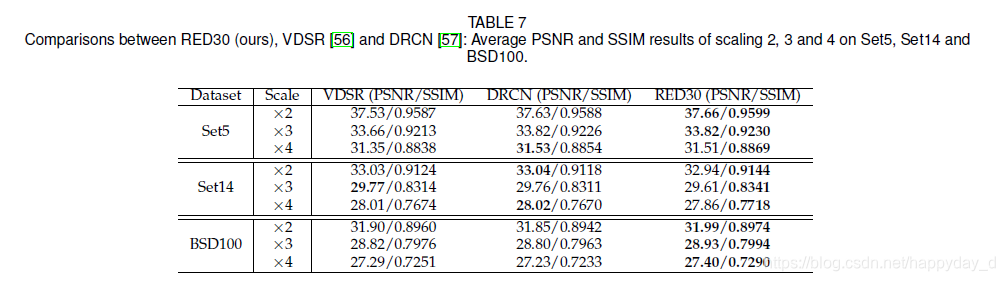

文章中进行了图像去噪、超解像、JPEG deblocking、Non-blind deblurring、图像修复实验,列举一下超解像相关结果:

与VDSR和DRCN进行了比较:

说明:

RED10:5层卷积,5层反卷积,无跳层

RED20:10卷积层,10反卷积层,跳层层距为2

RED30:15卷积层,15反卷积层,跳层层距为2

4.参考

https://blog.csdn.net/happyday_d/article/details/83715440

https://blog.csdn.net/wangkun1340378/article/details/78394673

https://blog.csdn.net/mzpmzk/article/details/54314864

论文个人理解,如有问题,烦请指正,谢谢!