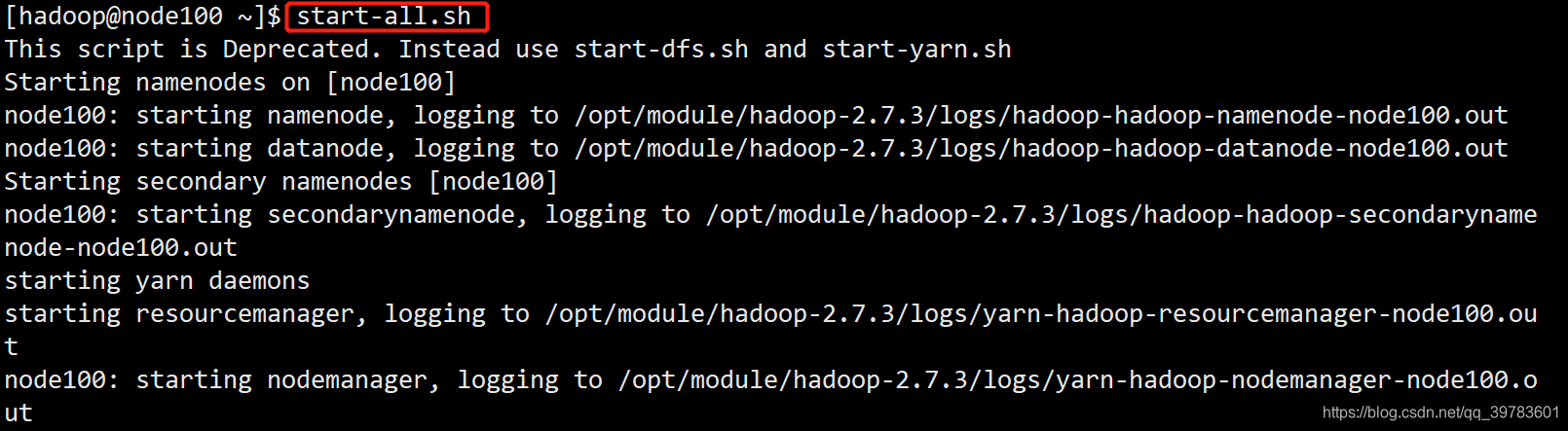

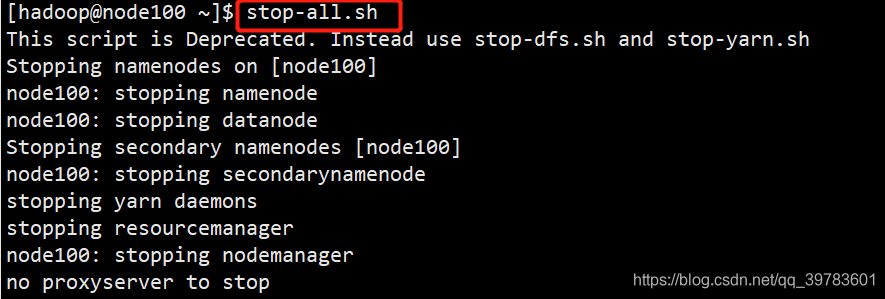

1.启动/关闭Hadoop集群

start-all.sh/stop-all.sh

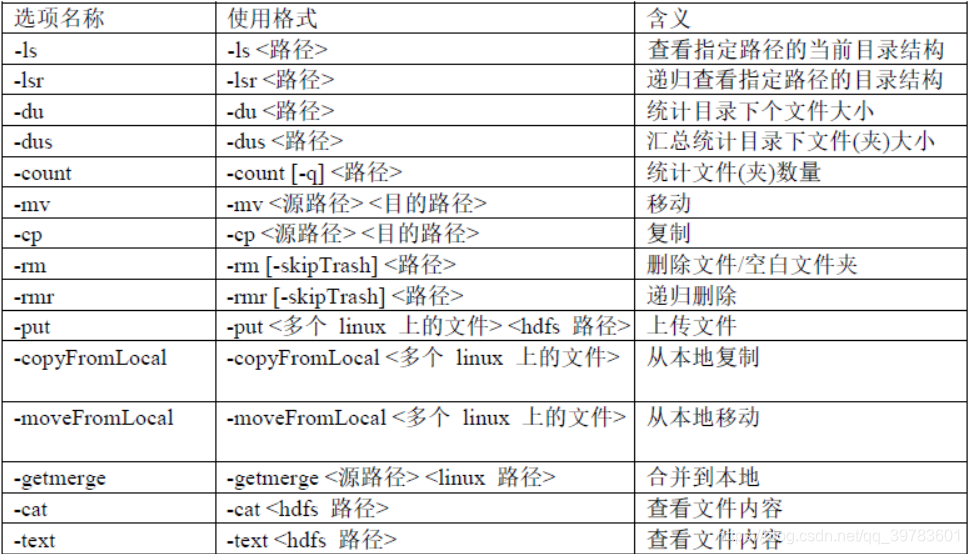

2.查看HDFS上的文件和目录

hadoop fs -ls -R /

3.在HDFS上创建文件夹

hadoop fs -mkdir -p /test/name

4.上传文件

hadoop fs -put source(本地文件路径) dest(HDFS路径)

5.下载文件

hadoop fs -get source(HDFS路径) dest(本地文件路径)

6.删除文件

hadoop fs -rm HDFS文件路径

hadoop fs -rm -r HDFS目录路径

7.查看文件内容

hadoop fs -cat HDFS文件路径

8.查看集群的工作状态

hdfs dfsadmin -report

9.单进程启动。

sbin/start-dfs.sh

sbin/start-yarn.sh

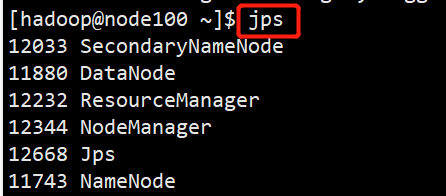

10.启动进程

jps

11.进Hive服务

cd /opt/module/apache-hive-3.1.1-bin/

12.从 hdfs 的一个路径拷贝 hdfs 的另一个路径cp

hadoop fs -cp /aaa/jdk.tar.gz /bbb/jdk.tar.gz.2

13.在 hdfs 目录中移动文件mv

hadoop fs -mv /aaa/jdk.tar.gz /

tab键可以自动补全命令

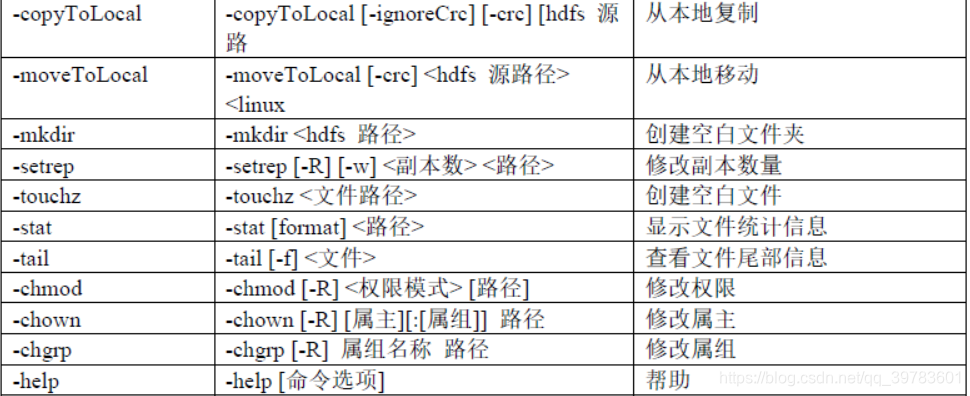

常用命令:

注意:以上表格中对于路径,包括hdfs中的路径和linux中的路径。对于容易产生歧义的地方,会特别指出“linux路径”或者“hdfs路径”。如果没有明确指出,意味着是hdfs路径。对hdfs操作的命令格式是hadoop fs +命令。