参考课程:YUN-NUNG (VIVIAN) CHEN的深度学习课程

参考书籍:http://lamda.nju.edu.cn/weixs/book/CNN_book.pdf

1.网络训练(神经网络前馈运算+反馈运算)

前馈运算:后一层的输入(z)=前一层的输出(a)与对应权值(w-两层间的连接线上)加权求和。

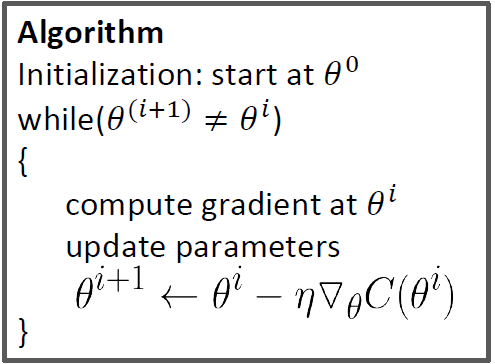

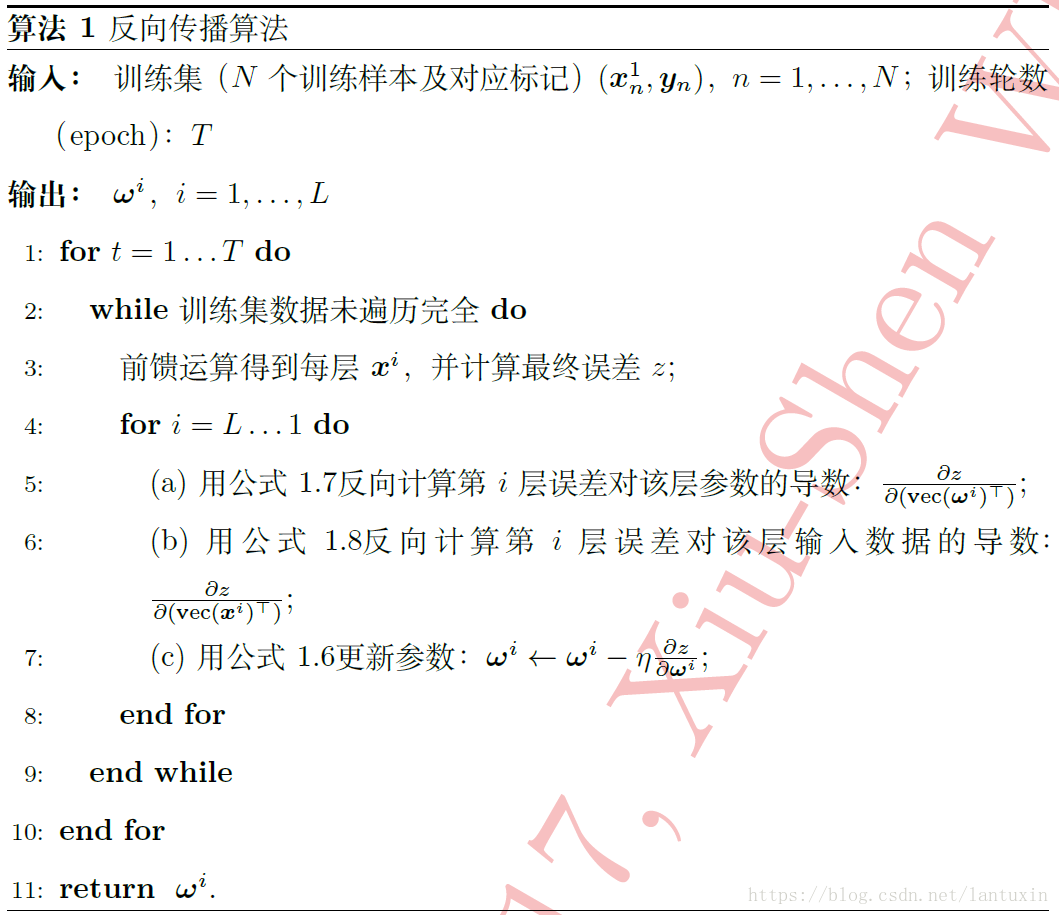

反馈运算(backpropagation):后一次迭代的权值w/偏置b=前一次迭代的权值w/偏置b-学习率×误差对前一次迭代权值w/偏置b的偏导数

①YUN-NUNG (VIVIAN) CHEN版

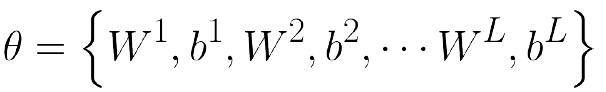

参数:

算法:

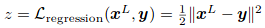

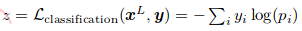

损失函数(目标函数):

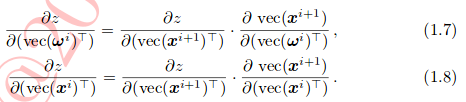

链式参数更新法则:

2.卷积操作

计算方式:图片对应位置与卷积核对应位置加权求和。(滑动的卷积核)

卷积核理解:其实在网络训练过程中,训练的就是卷积核对应位置的值,也就是1中前馈运算中的权重w

3.实质问题

网络训练其实就是不断更新权值w以及偏置b,权值就是卷积核中不同位置的参数值

附一篇知乎:https://zhuanlan.zhihu.com/p/27897220(通俗的讲解了图片在深度学习网络中各个实现步骤)

4.正则化

即“规则化”,防止过拟合,如:dropout层,用于丢弃一些拟合过于理想的情况。

深度学习中常用正则化操作:

①参数添加约束,如Weight Decay

②训练集合扩充,如图片旋转,缩放

③dropout,去掉部分w连接,形成子网络。如

5.AlexNet结构详述

参考网站:https://blog.csdn.net/xiequnyi/article/details/52232855

6.反卷积

就是用转置的卷积核卷积图片。