虽然是用pycharm进行调试,但是最开始一定不要在pycharm中生成项目,因为要用scrapy自己生成一个项目,否则会缺少如同scrapy.cfg的配置文件,导致Unknown command: crawl错误。

所以先在自己想要的地方开始:

scrapy startproject myproject

注意这个myproject是自定义的文件夹。然后在pycharm里找到这个项目。发现已经自动生成了这样的结构,也帮忙配置好了环境变量。

创建项目之后,我们还需要创建一个爬虫,官方的语法如下:

scrapy genspider [-t template] <name> <domain>

注意:name参数是爬虫名,不能与项目名相同,domain参数是想要爬取的网站。然后就能在spiders里面看到刚刚的生成的爬虫。

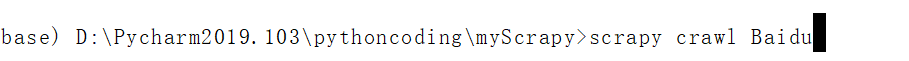

runspider命令可以直接通过运行 .py 文件来启动爬虫。此时要退到根目录下输入,注意不需要输入.py:

scrapy crawl <spider_file>

如果不想在命令行执行就可以在根目录下设置启动的脚本,我设置的名字叫做start.py,其中myspider可以替换成任意爬虫名字。

接下来是命令行的调试:

scrapy shell [url]

注意官方文档:https://scrapy-chs.readthedocs.io/zh_CN/0.24/topics/commands.html