写在前面

原文链接。原文应该是github上的一个项目,本文主要用来记录一些知识点和自己遇到的问题。

摄像机

前面的教程中我们讨论了观察矩阵以及如何使用观察矩阵移动场景(我们向后移动了一点)。OpenGL本身没有摄像机(Camera)的概念,但我们可以通过把场景中的所有物体往相反方向移动的方式来模拟出摄像机,产生一种我们在移动的感觉,而不是场景在移动。

本节我们将会讨论如何在OpenGL中配置一个摄像机,并且将会讨论FPS风格的摄像机,让你能够在3D场景中自由移动。我们也会讨论键盘和鼠标输入,最终完成一个自定义的摄像机类。

摄像机/观察空间

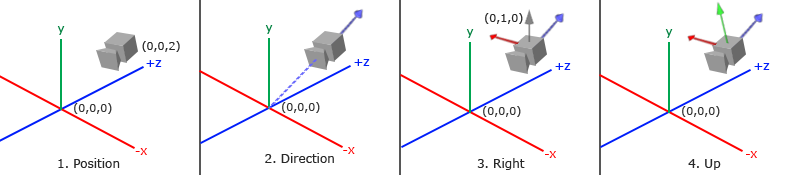

当我们讨论摄像机/观察空间(Camera/View Space)的时候,是在讨论以摄像机的视角作为场景原点时场景中所有的顶点坐标:观察矩阵把所有的世界坐标变换为相对于摄像机位置与方向的观察坐标。要定义一个摄像机,我们需要它在世界空间中的位置、观察的方向、一个指向它右测的向量以及一个指向它上方的向量。细心的读者可能已经注意到我们实际上创建了一个三个单位轴相互垂直的、以摄像机的位置为原点的坐标系。

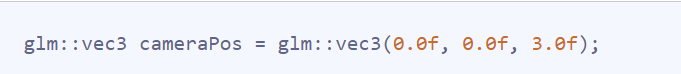

摄像机位置

获取摄像机位置很简单。摄像机位置简单来说就是世界空间中一个指向摄像机位置的向量。我们把摄像机位置设置为上一节中的那个相同的位置:

不要忘记正z轴是从屏幕指向你的,如果我们希望摄像机向后移动,我们就沿着z轴的正方向移动。

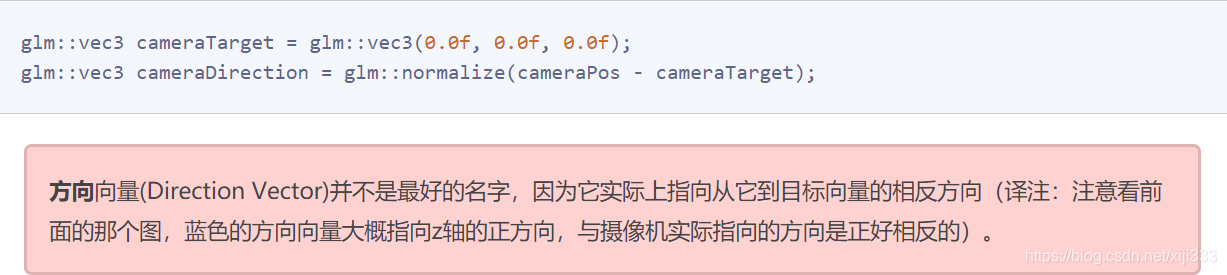

摄像机方向

下一个需要的向量是摄像机的方向,这里指的是摄像机指向哪个方向。现在我们让摄像机指向场景原点:(0, 0, 0)。还记得如果将两个矢量相减,我们就能得到这两个矢量的差吗?用场景原点向量减去摄像机位置向量的结果就是摄像机的指向向量。由于我们知道摄像机指向z轴负方向,但我们希望方向向量(Direction Vector)指向摄像机的z轴正方向。如果我们交换相减的顺序,我们就会获得一个指向摄像机正z轴方向的向量:

右轴

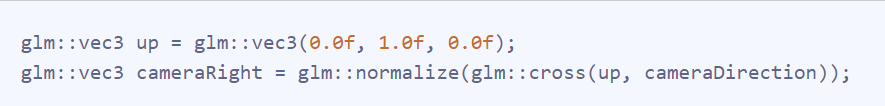

我们需要的另一个向量是一个右向量(Right Vector),它代表摄像机空间的x轴的正方向。为获取右向量我们需要先使用一个小技巧:先定义一个上向量(Up Vector)。接下来把上向量和第二步得到的方向向量进行叉乘。两个向量叉乘的结果会同时垂直于两向量,因此我们会得到指向x轴正方向的那个向量(如果我们交换两个向量叉乘的顺序就会得到相反的指向x轴负方向的向量):

上轴

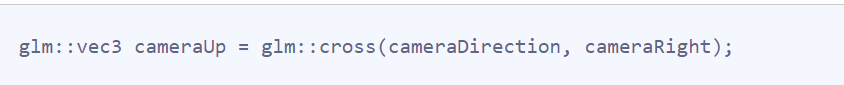

现在我们已经有了x轴向量和z轴向量,获取一个指向摄像机的正y轴向量就相对简单了:我们把右向量和方向向量进行叉乘:

在叉乘和一些小技巧的帮助下,我们创建了所有构成观察/摄像机空间的向量。对于想学到更多数学原理的读者,提示一下,在线性代数中这个处理叫做格拉姆—施密特正交化(Gram-Schmidt Process)。使用这些摄像机向量我们就可以创建一个LookAt矩阵了,它在创建摄像机的时候非常有用。

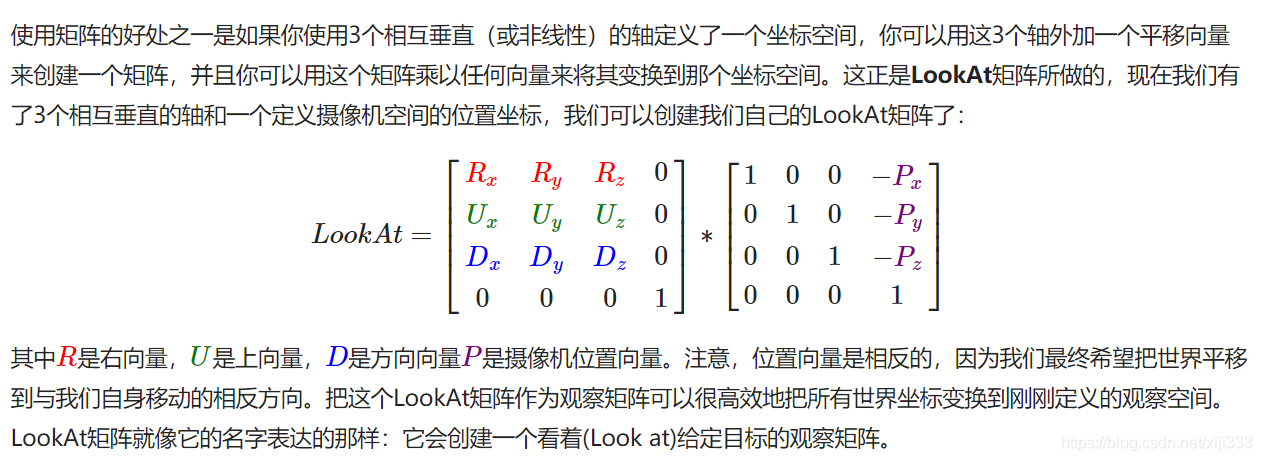

Look At

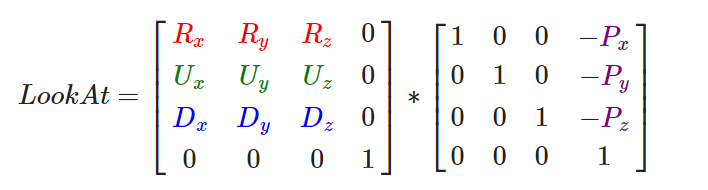

使用矩阵的好处之一是如果你使用3个相互垂直(或非线性)的轴定义了一个坐标空间,你可以用这3个轴外加一个平移向量来创建一个矩阵,并且你可以用这个矩阵乘以任何向量来将其变换到那个坐标空间。这正是LookAt矩阵所做的,现在我们有了3个相互垂直的轴和一个定义摄像机空间的位置坐标,我们可以创建我们自己的LookAt矩阵了:

其中R是右向量,U是上向量,D是方向向量,P是摄像机位置向量。注意,位置向量是相反的,因为我们最终希望把世界平移到与我们自身移动的相反方向。把这个LookAt矩阵作为观察矩阵可以很高效地把所有世界坐标变换到刚刚定义的观察空间。LookAt矩阵就像它的名字表达的那样:它会创建一个看着(Look at)给定目标的观察矩阵。

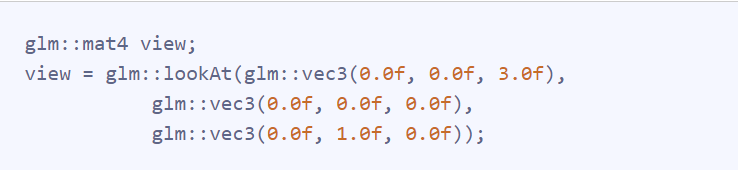

幸运的是,GLM已经提供了这些支持。我们要做的只是定义一个摄像机位置,一个目标位置和一个表示世界空间中的上向量的向量(我们计算右向量使用的那个上向量)。接着GLM就会创建一个LookAt矩阵,我们可以把它当作我们的观察矩阵:

glm::LookAt函数需要一个位置、目标和上向量。它会创建一个和在上一节使用的一样的观察矩阵。

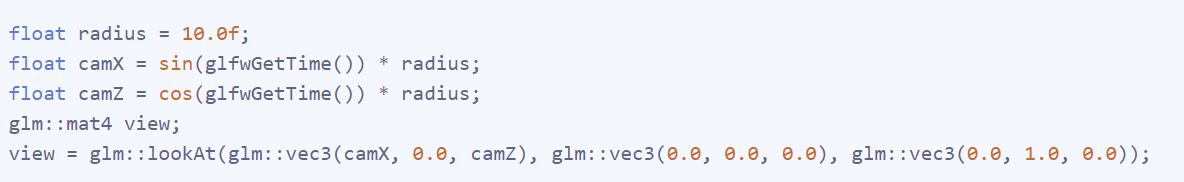

在讨论用户输入之前,我们先来做些有意思的事,把我们的摄像机在场景中旋转。我们会将摄像机的注视点保持在(0, 0, 0)。

我们需要用到一点三角学的知识来在每一帧创建一个x和z坐标,它会代表圆上的一点,我们将会使用它作为摄像机的位置。通过重新计算x和y坐标,我们会遍历圆上的所有点,这样摄像机就会绕着场景旋转了。我们预先定义这个圆的半径radius,在每次渲染迭代中使用GLFW的glfwGetTime函数重新创建观察矩阵,来扩大这个圆。

#include <glad/glad.h>

#include <GLFW/glfw3.h>

#include <glm/glm.hpp>

#include <glm/gtc/matrix_transform.hpp>

#include <glm/gtc/type_ptr.hpp>

#include <iostream>

#include "Shader.h"

#include "stb_image.h"

using std::cout;

//窗口回调函数

void framebuffer_size_callback(GLFWwindow* window, int width, int height)

{

//绘图视口 3D坐标到2D坐标的转换(映射)和这些参数(宽高)有关

glViewport(0, 0, width, height);

}

//键盘回调

void key_callback(GLFWwindow* window, int key, int scancode, int action, int mode);

//窗口初始大小

const unsigned int SCR_WIDTH = 800;

const unsigned int SCR_HEIGHT = 600;

const char* vShaderPath = "ShaderFiles/shader.vs";

const char* fShaderPath = "ShaderFiles/shader.fs";

float mixValue = 0.2f;

int main()

{

//glfw初始化

glfwInit();

//告诉glfw我们所使用的opengl版本 此处为3.3

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR, 3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR, 3);

glfwWindowHint(GLFW_OPENGL_PROFILE, GLFW_OPENGL_CORE_PROFILE);

//创建窗口

GLFWwindow* window = glfwCreateWindow(SCR_WIDTH, SCR_HEIGHT, "LearnOpenGL", NULL, NULL);

if (window == NULL)

{

cout << "Failed to create GLFW window\n";

glfwTerminate();

return -1;

}

glfwMakeContextCurrent(window);

//设置窗口回调函数

glfwSetFramebufferSizeCallback(window, framebuffer_size_callback);

//键盘回调函数

glfwSetKeyCallback(window, key_callback);

if (!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress))

{

cout << "Failed to initialize GLAD\n";

return -1;

}

//着色器对象

Shader shaderProgram = Shader(vShaderPath, fShaderPath);

//纹理

unsigned int texture1, texture2;

glGenTextures(1, &texture1);

glGenTextures(1, &texture2);

glBindTexture(GL_TEXTURE_2D, texture1);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_NEAREST);

//加载并生成纹理

//读取图片

stbi_set_flip_vertically_on_load(true);

int width, height, nrChannels;

unsigned char* data = stbi_load("Images/container.jpg", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGB, width, height, 0, GL_RGB, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

cout << "Failed to load texture1\n";

}

stbi_image_free(data);

glBindTexture(GL_TEXTURE_2D, texture2);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_MIRRORED_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_MIRRORED_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_NEAREST);

data = stbi_load("Images/awesomeface.png", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGBA, width, height, 0, GL_RGBA, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

cout << "Failed to load texture1\n";

}

stbi_image_free(data);

glm::vec3 cubePositions[] = {

glm::vec3(0.0f, 0.0f, 0.0f),

glm::vec3(2.0f, 5.0f, -15.0f),

glm::vec3(-1.5f, -2.2f, -2.5f),

glm::vec3(-3.8f, -2.0f, -12.3f),

glm::vec3(2.4f, -0.4f, -3.5f),

glm::vec3(-1.7f, 3.0f, -7.5f),

glm::vec3(1.3f, -2.0f, -2.5f),

glm::vec3(1.5f, 2.0f, -2.5f),

glm::vec3(1.5f, 0.2f, -1.5f),

glm::vec3(-1.3f, 1.0f, -1.5f)

};

float vertices[] = {

// 后面

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

0.5f, -0.5f, -0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

// 前面

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

// 左侧面

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

// 右侧面

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

//底面

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

//顶面

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f

};

/*unsigned int indices[] = {

0, 1, 2,

2, 3, 0

};*/

//顶点缓冲对象 VBO

//顶点数组对象 VAO

//索引缓冲对象 EBO

unsigned int VBO, VAO, EBO;

glGenVertexArrays(1, &VAO);

glGenBuffers(1, &VBO);

//glGenBuffers(1, &EBO);

//先绑定VAO 再绑定设置VBO 最后设置顶点属性 vertex attributes

glBindVertexArray(VAO);

glBindBuffer(GL_ARRAY_BUFFER, VBO);

glBufferData(GL_ARRAY_BUFFER, sizeof(vertices), vertices, GL_STATIC_DRAW);

//glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, EBO);

//glBufferData(GL_ELEMENT_ARRAY_BUFFER, sizeof(indices), indices, GL_STATIC_DRAW);

//设置顶点属性

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

glVertexAttribPointer(1, 2, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)(3 * sizeof(float)));

glEnableVertexAttribArray(1);

glBindBuffer(GL_ARRAY_BUFFER, 0);

//remember: do NOT unbind the EBO while a VAO is active as the bound element buffer object IS stored in the VAO; keep the EBO bound.

//当VAO处于活动状态时,不要解除EBO的绑定 因为它存储在VAO中

//glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, 0);

//您可以在之后解除对VAO的绑定,这样其他VAO调用就不会意外地修改此VAO,但这种情况很少发生。修改其他

//VAOs需要调用glBindVertexArray,所以我们通常不会在不需要的时候解除VAOs(或VBOs)的绑定。

glBindVertexArray(0);

//线框模式

//glPolygonMode(GL_FRONT_AND_BACK, GL_LINE);

shaderProgram.use();

shaderProgram.setInt("texture1", 0);

shaderProgram.setInt("texture2", 1);

//开启深度测试

glEnable(GL_DEPTH_TEST);

while (!glfwWindowShouldClose(window))

{

glClearColor(0.2f, 0.3f, 0.3f, 1.0f);

glClear(GL_COLOR_BUFFER_BIT | GL_DEPTH_BUFFER_BIT);

//矩阵运算

float radius = 10.0f;

float camX = sin(glfwGetTime()) * radius;

float camZ = cos(glfwGetTime()) * radius;

glm::mat4 view = glm::lookAt(

glm::vec3(camX, 0.0f, camZ),

glm::vec3(0.0f, 0.0f, 0.0f),

glm::vec3(0.0f, 1.0f, 0.0f));

glm::mat4 projection(1.0f);

projection = glm::perspective(glm::radians(45.0f), SCR_WIDTH * 1.0f / SCR_HEIGHT, 0.1f, 100.0f);

//激活着色器

shaderProgram.use();

shaderProgram.setFloat("mixValue", mixValue);

shaderProgram.setMatrix4fv("view", glm::value_ptr(view));

shaderProgram.setMatrix4fv("projection", glm::value_ptr(projection));

//绑定纹理

glActiveTexture(GL_TEXTURE0);

glBindTexture(GL_TEXTURE_2D, texture1);

glActiveTexture(GL_TEXTURE1);

glBindTexture(GL_TEXTURE_2D, texture2);

//绘制三角形

glBindVertexArray(VAO);

//glDrawElements(GL_TRIANGLES, 6, GL_UNSIGNED_INT, 0);

for (unsigned int i = 0; i < 10; i++)

{

glm::mat4 model(1.0f);

model = glm::translate(model, cubePositions[i]);

float angle = 20.0f * i;

if (i % 3 == 0)

angle = 20.0f * glfwGetTime();

model = glm::rotate(model, glm::radians(angle), glm::vec3(1.0, 0.3, 0.5));

shaderProgram.setMatrix4fv("model", glm::value_ptr(model));

glDrawArrays(GL_TRIANGLES, 0, 36);

}

glBindVertexArray(0);

glfwSwapBuffers(window);

glfwPollEvents();

}

//这一步是可选的

glDeleteVertexArrays(1, &VAO);

glDeleteBuffers(1, &VBO);

//glDeleteBuffers(1, &EBO);

//释放资源

glfwTerminate();

return 0;

}

void key_callback(GLFWwindow* window, int key, int scancode, int action, int mode)

{

if (action == GLFW_REPEAT || action == GLFW_PRESS)

{

if (key == GLFW_KEY_ESCAPE)

{

glfwSetWindowShouldClose(window, GL_TRUE);

return;

}

switch (key)

{

case GLFW_KEY_UP:

mixValue += 0.1f;

if (mixValue >= 1.0f)

mixValue = 1.0f;

break;

case GLFW_KEY_DOWN:

mixValue -= 0.1f;

if (mixValue <= 0.0f)

mixValue = 0.0f;

break;

default:

break;

}

}

}

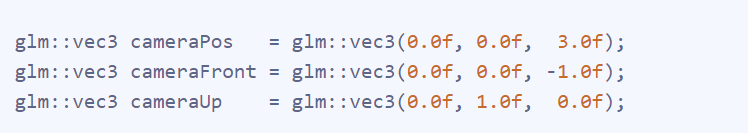

自由移动

让摄像机绕着场景转的确很有趣,但是让我们自己移动摄像机会更有趣!首先我们必须设置一个摄像机系统,所以在我们的程序前面定义一些摄像机变量很有用:

LookAt函数现在成了:

我们首先将摄像机位置设置为之前定义的cameraPos。方向是当前的位置加上我们刚刚定义的方向向量。这样能保证无论我们怎么移动,摄像机都会注视着目标方向。让我们摆弄一下这些向量,在按下某些按钮时更新cameraPos向量。

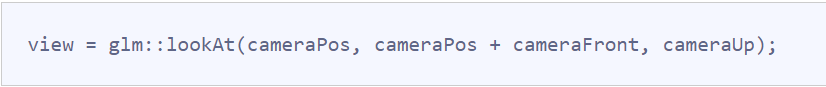

我们已经为GLFW的键盘输入定义过一个processInput函数了,我们来新添加几个需要检查的按键命令:

当我们按下WASD键的任意一个,摄像机的位置都会相应更新。如果我们希望向前或向后移动,我们就把位置向量加上或减去方向向量。如果我们希望向左右移动,我们使用叉乘来创建一个右向量(Right Vector),并沿着它相应移动就可以了。这样就创建了使用摄像机时熟悉的横移(Strafe)效果。

现在你就应该能够移动摄像机了,虽然移动速度和系统有关,你可能会需要调整一下cameraSpeed。

移动速度

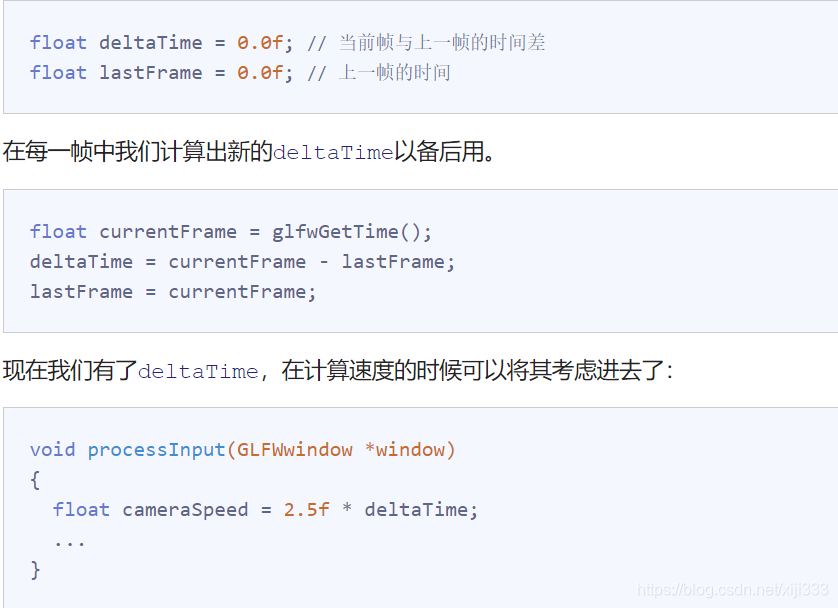

目前我们的移动速度是个常量。理论上没什么问题,但是实际情况下根据处理器的能力不同,有些人可能会比其他人每秒绘制更多帧,也就是以更高的频率调用processInput函数。结果就是,根据配置的不同,有些人可能移动很快,而有些人会移动很慢。当你发布你的程序的时候,你必须确保它在所有硬件上移动速度都一样。

图形程序和游戏通常会跟踪一个时间差(Deltatime)变量,它储存了渲染上一帧所用的时间。我们把所有速度都去乘以deltaTime值。结果就是,如果我们的deltaTime很大,就意味着上一帧的渲染花费了更多时间,所以这一帧的速度需要变得更高来平衡渲染所花去的时间。使用这种方法时,无论你的电脑快还是慢,摄像机的速度都会相应平衡,这样每个用户的体验就都一样了。

我们跟踪两个全局变量来计算出deltaTime值:

与前面的部分结合在一起,我们有了一个更流畅点的摄像机系统。同样,如果你卡住了,查看一下源码。我们可以看到任何移动都会影响返回的deltaTime值。

视角移动

只用键盘移动没什么意思。特别是我们还不能转向,移动很受限制。是时候加入鼠标了!

为了能够改变视角,我们需要根据鼠标的输入改变cameraFront向量。然而,根据鼠标移动改变方向向量有点复杂,需要一些三角学知识。如果你对三角学知之甚少,别担心,你可以跳过这一部分,直接复制粘贴我们的代码;当你想了解更多的时候再回来看。

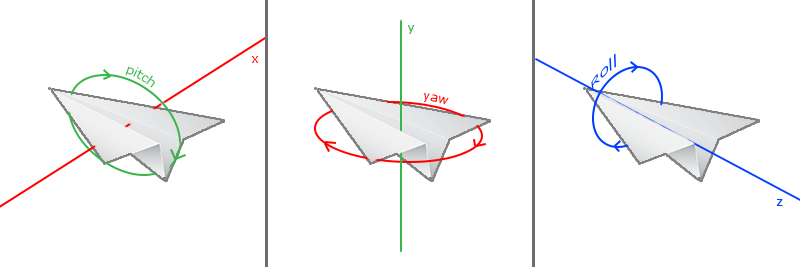

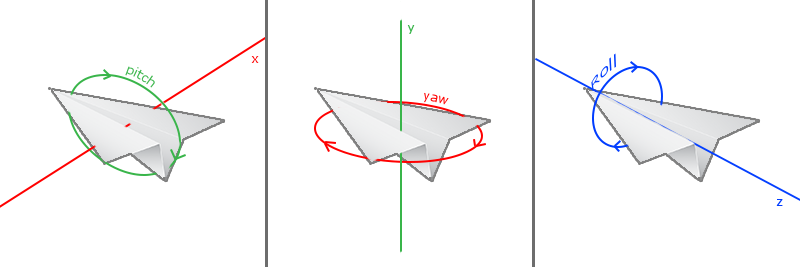

欧拉角

欧拉角(Euler Angle)是可以表示3D空间中任何旋转的3个值,由莱昂哈德·欧拉(Leonhard Euler)在18世纪提出。一共有3种欧拉角:俯仰角(Pitch)、偏航角(Yaw)和滚转角(Roll),下面的图片展示了它们的含义:

俯仰角是描述我们如何往上或往下看的角,可以在第一张图中看到。第二张图展示了偏航角,偏航角表示我们往左和往右看的程度。滚转角代表我们如何翻滚摄像机,通常在太空飞船的摄像机中使用。每个欧拉角都有一个值来表示,把三个角结合起来我们就能够计算3D空间中任何的旋转向量了。

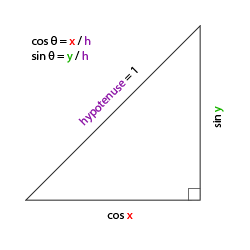

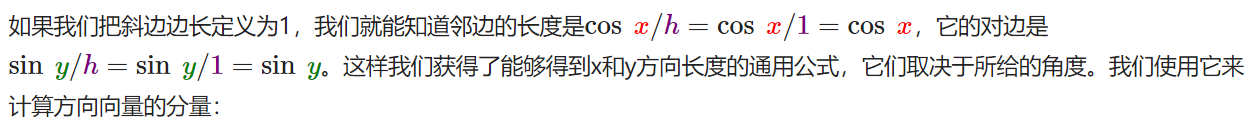

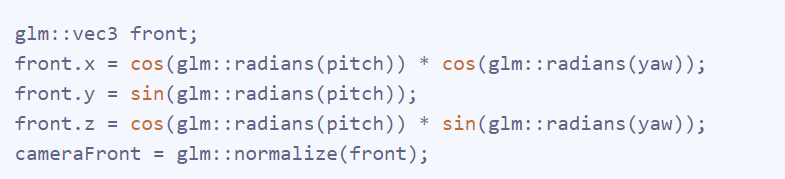

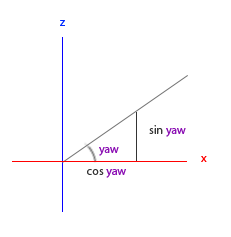

对于我们的摄像机系统来说,我们只关心俯仰角和偏航角,所以我们不会讨论滚转角。给定一个俯仰角和偏航角,我们可以把它们转换为一个代表新的方向向量的3D向量。俯仰角和偏航角转换为方向向量的处理需要一些三角学知识,我们先从最基本的情况开始:

这个三角形看起来和前面的三角形很像,所以如果我们想象自己在xz平面上,看向y轴,我们可以基于第一个三角形计算来计算它的长度在y方向的强度(Strength)(我们往上或往下看多少)。从图中我们可以看到对于一个给定俯仰角的y值等于sin θ:

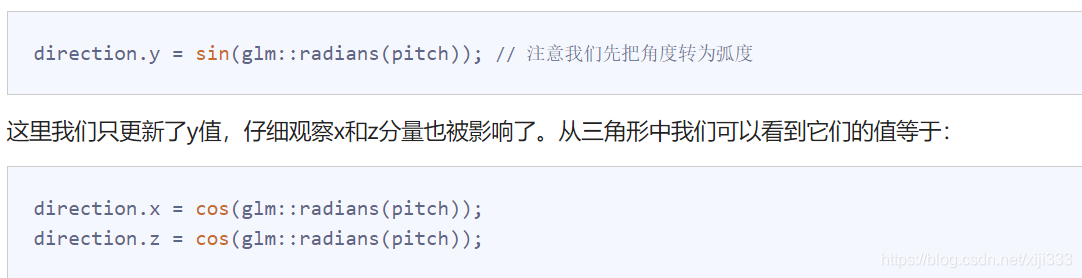

看看我们是否能够为偏航角找到需要的分量:

就像俯仰角的三角形一样,我们可以看到x分量取决于cos(yaw)的值,z值同样取决于偏航角的正弦值。把这个加到前面的值中,会得到基于俯仰角和偏航角的方向向量:

这样我们就有了一个可以把俯仰角和偏航角转化为用来自由旋转视角的摄像机的3维方向向量了。你可能会奇怪:我们怎么得到俯仰角和偏航角?

鼠标输入

偏航角和俯仰角是通过鼠标(或手柄)移动获得的,水平的移动影响偏航角,竖直的移动影响俯仰角。它的原理就是,储存上一帧鼠标的位置,在当前帧中我们当前计算鼠标位置与上一帧的位置相差多少。如果水平/竖直差别越大那么俯仰角或偏航角就改变越大,也就是摄像机需要移动更多的距离。

首先我们要告诉GLFW,它应该隐藏光标,并捕捉(Capture)它。捕捉光标表示的是,如果焦点在你的程序上(译注:即表示你正在操作这个程序,Windows中拥有焦点的程序标题栏通常是有颜色的那个,而失去焦点的程序标题栏则是灰色的),光标应该停留在窗口中(除非程序失去焦点或者退出)。我们可以用一个简单地配置调用来完成:

在调用这个函数之后,无论我们怎么去移动鼠标,光标都不会显示了,它也不会离开窗口。对于FPS摄像机系统来说非常完美。

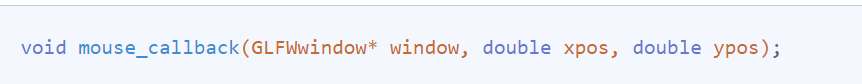

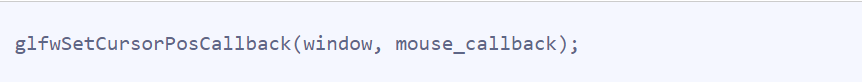

为了计算俯仰角和偏航角,我们需要让GLFW监听鼠标移动事件。(和键盘输入相似)我们会用一个回调函数来完成,函数的原型如下:

这里的xpos和ypos代表当前鼠标的位置。当我们用GLFW注册了回调函数之后,鼠标一移动mouse_callback函数就会被调用:

在处理FPS风格摄像机的鼠标输入的时候,我们必须在最终获取方向向量之前做下面这几步:

- 计算鼠标距上一帧的偏移量。

- 把偏移量添加到摄像机的俯仰角和偏航角中。

- 对偏航角和俯仰角进行最大和最小值的限制。

- 计算方向向量。

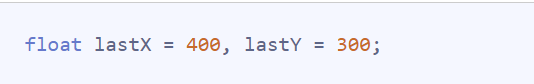

第一步是计算鼠标自上一帧的偏移量。我们必须先在程序中储存上一帧的鼠标位置,我们把它的初始值设置为屏幕的中心(屏幕的尺寸是800x600):

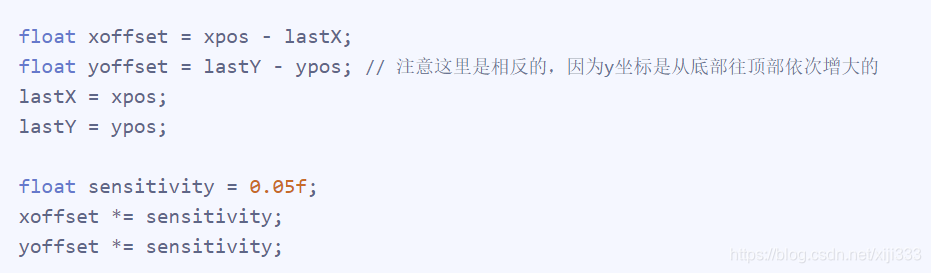

然后在鼠标的回调函数中我们计算当前帧和上一帧鼠标位置的偏移量(经过测试,鼠标右移,x增大,鼠标下移,y增大):

注意我们把偏移量乘以了sensitivity(灵敏度)值。如果我们忽略这个值,鼠标移动就会太大了;你可以自己实验一下,找到适合自己的灵敏度值。

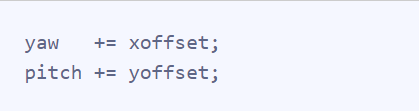

接下来我们把偏移量加到全局变量pitch和yaw上:

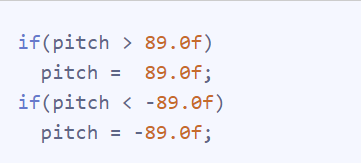

第三步,我们需要给摄像机添加一些限制,这样摄像机就不会发生奇怪的移动了(这样也会避免一些奇怪的问题)。对于俯仰角,要让用户不能看向高于89度的地方(在90度时视角会发生逆转,所以我们把89度作为极限),同样也不允许小于-89度。这样能够保证用户只能看到天空或脚下,但是不能超越这个限制。我们可以在值超过限制的时候将其改为极限值来实现:

注意我们没有给偏航角设置限制,这是因为我们不希望限制用户的水平旋转。当然,给偏航角设置限制也很容易,如果你愿意可以自己实现。

第四也是最后一步,就是通过俯仰角和偏航角来计算以得到真正的方向向量:

计算出来的方向向量就会包含根据鼠标移动计算出来的所有旋转了。由于cameraFront向量已经包含在GLM的lookAt函数中,我们这就没什么问题了。

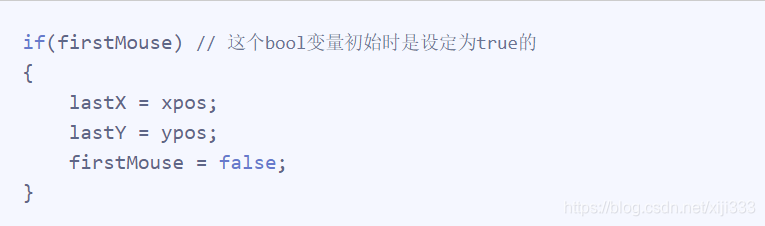

如果你现在运行代码,你会发现在窗口第一次获取焦点的时候摄像机会突然跳一下。这个问题产生的原因是,在你的鼠标移动进窗口的那一刻,鼠标回调函数就会被调用,这时候的xpos和ypos会等于鼠标刚刚进入屏幕的那个位置。这通常是一个距离屏幕中心很远的地方,因而产生一个很大的偏移量,所以就会跳了。我们可以简单的使用一个bool变量检验我们是否是第一次获取鼠标输入,如果是,那么我们先把鼠标的初始位置更新为xpos和ypos值,这样就能解决这个问题;接下来的鼠标移动就会使用刚进入的鼠标位置坐标来计算偏移量了:

最后的代码应该是这样的:

void mouse_callback(GLFWwindow* window, double xpos, double ypos)

{

if(firstMouse)

{

lastX = xpos;

lastY = ypos;

firstMouse = false;

}

float xoffset = xpos - lastX;

float yoffset = lastY - ypos;

lastX = xpos;

lastY = ypos;

float sensitivity = 0.05;

xoffset *= sensitivity;

yoffset *= sensitivity;

yaw += xoffset;

pitch += yoffset;

if(pitch > 89.0f)

pitch = 89.0f;

if(pitch < -89.0f)

pitch = -89.0f;

glm::vec3 front;

front.x = cos(glm::radians(yaw)) * cos(glm::radians(pitch));

front.y = sin(glm::radians(pitch));

front.z = sin(glm::radians(yaw)) * cos(glm::radians(pitch));

cameraFront = glm::normalize(front);

}

现在我们就可以自由地在3D场景中移动了!

缩放

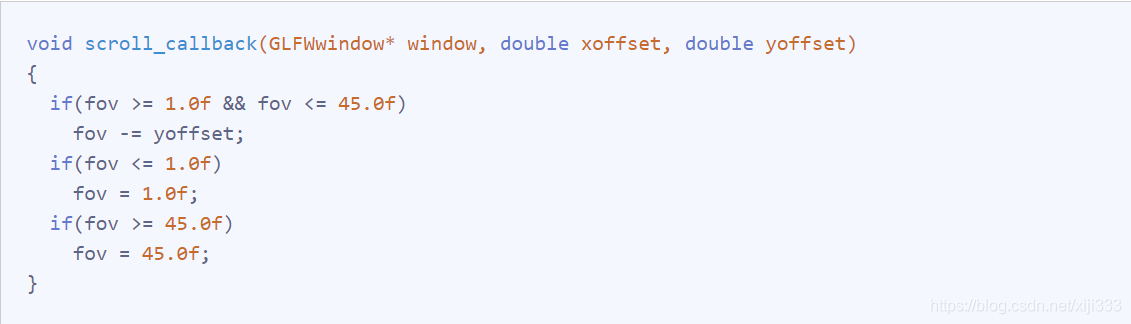

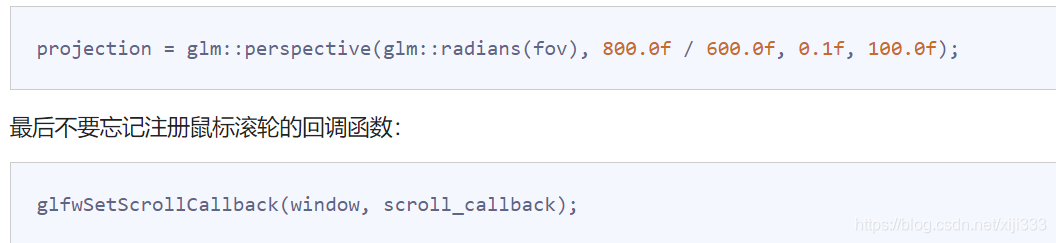

作为我们摄像机系统的一个附加内容,我们还会来实现一个缩放(Zoom)接口。在之前的教程中我们说视野(Field of View)或fov定义了我们可以看到场景中多大的范围。当视野变小时,场景投影出来的空间就会减小,产生放大(Zoom In)了的感觉。我们会使用鼠标的滚轮来放大。与鼠标移动、键盘输入一样,我们需要一个鼠标滚轮的回调函数(前滚时,yoffset>0):

当滚动鼠标滚轮的时候,yoffset值代表我们竖直滚动的大小。当scroll_callback函数被调用后,我们改变全局变量fov变量的内容。因为45.0f是默认的视野值,我们将会把缩放级别(Zoom Level)限制在1.0f到45.0f。

我们现在在每一帧都必须把透视投影矩阵上传到GPU,但现在使用fov变量作为它的视野:

现在,我们就实现了一个简单的摄像机系统了,它能够让我们在3D环境中自由移动。

#include <glad/glad.h>

#include <GLFW/glfw3.h>

#include <glm/glm.hpp>

#include <glm/gtc/matrix_transform.hpp>

#include <glm/gtc/type_ptr.hpp>

#include <iostream>

#include "Shader.h"

#include "stb_image.h"

using std::cout;

//窗口回调函数

void framebuffer_size_callback(GLFWwindow* window, int width, int height)

{

//绘图视口 3D坐标到2D坐标的转换(映射)和这些参数(宽高)有关

glViewport(0, 0, width, height);

}

//键盘回调

void key_callback(GLFWwindow* window, int key, int scancode, int action, int mode);

//鼠标回调

void mouse_callback(GLFWwindow* window, double xpos, double ypos);

//滚轮回调

void scroll_callback(GLFWwindow* window, double xoffset, double yoffset);

//窗口初始大小

const unsigned int SCR_WIDTH = 800;

const unsigned int SCR_HEIGHT = 600;

const char* vShaderPath = "ShaderFiles/shader.vs";

const char* fShaderPath = "ShaderFiles/shader.fs";

float fov = 45.0f;

float mixValue = 0.2f;

float pitch = 0.0f; //俯仰

float yaw = -90.0f; //偏航

float lastX, lastY;

bool firstMouse = true;

glm::vec3 cameraPos = glm::vec3(0.0f, 0.0f, 3.0f);

glm::vec3 cameraFront = glm::vec3(0.0f, 0.0f, -1.0f);

glm::vec3 cameraUp = glm::vec3(0.0f, 1.0f, 0.0f);

int main()

{

//glfw初始化

glfwInit();

//告诉glfw我们所使用的opengl版本 此处为3.3

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR, 3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR, 3);

glfwWindowHint(GLFW_OPENGL_PROFILE, GLFW_OPENGL_CORE_PROFILE);

//创建窗口

GLFWwindow* window = glfwCreateWindow(SCR_WIDTH, SCR_HEIGHT, "LearnOpenGL", NULL, NULL);

if (window == NULL)

{

cout << "Failed to create GLFW window\n";

glfwTerminate();

return -1;

}

glfwMakeContextCurrent(window);

glfwSetInputMode(window, GLFW_CURSOR, GLFW_CURSOR_DISABLED);

//设置窗口回调函数

glfwSetFramebufferSizeCallback(window, framebuffer_size_callback);

//键盘回调函数

glfwSetKeyCallback(window, key_callback);

//鼠标回调

glfwSetCursorPosCallback(window, mouse_callback);

//滚轮回调

glfwSetScrollCallback(window, scroll_callback);

if (!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress))

{

cout << "Failed to initialize GLAD\n";

return -1;

}

//着色器对象

Shader shaderProgram = Shader(vShaderPath, fShaderPath);

//纹理

unsigned int texture1, texture2;

glGenTextures(1, &texture1);

glGenTextures(1, &texture2);

glBindTexture(GL_TEXTURE_2D, texture1);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_NEAREST);

//加载并生成纹理

//读取图片

stbi_set_flip_vertically_on_load(true);

int width, height, nrChannels;

unsigned char* data = stbi_load("Images/container.jpg", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGB, width, height, 0, GL_RGB, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

cout << "Failed to load texture1\n";

}

stbi_image_free(data);

glBindTexture(GL_TEXTURE_2D, texture2);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_MIRRORED_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_MIRRORED_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_NEAREST);

data = stbi_load("Images/awesomeface.png", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGBA, width, height, 0, GL_RGBA, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

cout << "Failed to load texture1\n";

}

stbi_image_free(data);

glm::vec3 cubePositions[] = {

glm::vec3(0.0f, 0.0f, 0.0f),

glm::vec3(2.0f, 5.0f, -15.0f),

glm::vec3(-1.5f, -2.2f, -2.5f),

glm::vec3(-3.8f, -2.0f, -12.3f),

glm::vec3(2.4f, -0.4f, -3.5f),

glm::vec3(-1.7f, 3.0f, -7.5f),

glm::vec3(1.3f, -2.0f, -2.5f),

glm::vec3(1.5f, 2.0f, -2.5f),

glm::vec3(1.5f, 0.2f, -1.5f),

glm::vec3(-1.3f, 1.0f, -1.5f)

};

float vertices[] = {

// 后面

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

0.5f, -0.5f, -0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

// 前面

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

// 左侧面

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

// 右侧面

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

//底面

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

//顶面

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f

};

/*unsigned int indices[] = {

0, 1, 2,

2, 3, 0

};*/

//顶点缓冲对象 VBO

//顶点数组对象 VAO

//索引缓冲对象 EBO

unsigned int VBO, VAO, EBO;

glGenVertexArrays(1, &VAO);

glGenBuffers(1, &VBO);

//glGenBuffers(1, &EBO);

//先绑定VAO 再绑定设置VBO 最后设置顶点属性 vertex attributes

glBindVertexArray(VAO);

glBindBuffer(GL_ARRAY_BUFFER, VBO);

glBufferData(GL_ARRAY_BUFFER, sizeof(vertices), vertices, GL_STATIC_DRAW);

//glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, EBO);

//glBufferData(GL_ELEMENT_ARRAY_BUFFER, sizeof(indices), indices, GL_STATIC_DRAW);

//设置顶点属性

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

glVertexAttribPointer(1, 2, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)(3 * sizeof(float)));

glEnableVertexAttribArray(1);

glBindBuffer(GL_ARRAY_BUFFER, 0);

//remember: do NOT unbind the EBO while a VAO is active as the bound element buffer object IS stored in the VAO; keep the EBO bound.

//当VAO处于活动状态时,不要解除EBO的绑定 因为它存储在VAO中

//glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, 0);

//您可以在之后解除对VAO的绑定,这样其他VAO调用就不会意外地修改此VAO,但这种情况很少发生。修改其他

//VAOs需要调用glBindVertexArray,所以我们通常不会在不需要的时候解除VAOs(或VBOs)的绑定。

glBindVertexArray(0);

//线框模式

//glPolygonMode(GL_FRONT_AND_BACK, GL_LINE);

shaderProgram.use();

shaderProgram.setInt("texture1", 0);

shaderProgram.setInt("texture2", 1);

//开启深度测试

glEnable(GL_DEPTH_TEST);

while (!glfwWindowShouldClose(window))

{

glClearColor(0.2f, 0.3f, 0.3f, 1.0f);

glClear(GL_COLOR_BUFFER_BIT | GL_DEPTH_BUFFER_BIT);

//矩阵运算

glm::mat4 view = glm::lookAt(cameraPos,cameraPos+cameraFront,cameraUp);

glm::mat4 projection(1.0f);

projection = glm::perspective(glm::radians(fov), SCR_WIDTH * 1.0f / SCR_HEIGHT, 0.1f, 100.0f);

//激活着色器

shaderProgram.use();

shaderProgram.setFloat("mixValue", mixValue);

shaderProgram.setMatrix4fv("view", glm::value_ptr(view));

shaderProgram.setMatrix4fv("projection", glm::value_ptr(projection));

//绑定纹理

glActiveTexture(GL_TEXTURE0);

glBindTexture(GL_TEXTURE_2D, texture1);

glActiveTexture(GL_TEXTURE1);

glBindTexture(GL_TEXTURE_2D, texture2);

//绘制三角形

glBindVertexArray(VAO);

//glDrawElements(GL_TRIANGLES, 6, GL_UNSIGNED_INT, 0);

for (unsigned int i = 0; i < 10; i++)

{

glm::mat4 model(1.0f);

model = glm::translate(model, cubePositions[i]);

float angle = 20.0f * i;

if (i % 3 == 0)

angle = 20.0f * glfwGetTime();

model = glm::rotate(model, glm::radians(angle), glm::vec3(1.0, 0.3, 0.5));

shaderProgram.setMatrix4fv("model", glm::value_ptr(model));

glDrawArrays(GL_TRIANGLES, 0, 36);

}

glBindVertexArray(0);

glfwSwapBuffers(window);

glfwPollEvents();

}

//这一步是可选的

glDeleteVertexArrays(1, &VAO);

glDeleteBuffers(1, &VBO);

//glDeleteBuffers(1, &EBO);

//释放资源

glfwTerminate();

return 0;

}

void key_callback(GLFWwindow* window, int key, int scancode, int action, int mode)

{

float cameraSpeed = 0.2f;

if (action == GLFW_REPEAT || action == GLFW_PRESS)

{

if (key == GLFW_KEY_ESCAPE)

{

glfwSetWindowShouldClose(window, GL_TRUE);

return;

}

switch (key)

{

case GLFW_KEY_UP:

mixValue += 0.1f;

if (mixValue >= 1.0f)

mixValue = 1.0f;

break;

case GLFW_KEY_DOWN:

mixValue -= 0.1f;

if (mixValue <= 0.0f)

mixValue = 0.0f;

break;

case GLFW_KEY_W:

cameraPos += cameraFront * cameraSpeed;

break;

case GLFW_KEY_S:

cameraPos -= cameraFront * cameraSpeed;

break;

case GLFW_KEY_A:

cameraPos -= glm::normalize(glm::cross(cameraFront, cameraUp)) * cameraSpeed;

break;

case GLFW_KEY_D:

cameraPos += glm::normalize(glm::cross(cameraFront, cameraUp)) * cameraSpeed;

break;

default:

break;

}

}

}

void mouse_callback(GLFWwindow* window, double xpos, double ypos)

{

if (firstMouse)

{

firstMouse = false;

lastX = xpos, lastY = ypos;

}

float xoffset = xpos - lastX;

float yoffset = lastY - ypos;

lastX = xpos, lastY = ypos;

float sensitivity = 0.05f;

xoffset *= sensitivity, yoffset *= sensitivity;

pitch += yoffset;

yaw += xoffset;

if (pitch > 89.0f)

pitch = 89.0f;

else if (pitch < -89.0f)

pitch = -89.0f;

glm::vec3 front;

front.x = cos(glm::radians(pitch)) * cos(glm::radians(yaw));

front.y = sin(glm::radians(pitch));

front.z = cos(glm::radians(pitch)) * sin(glm::radians(yaw));

cameraFront = glm::normalize(front);

}

void scroll_callback(GLFWwindow* window, double xoffset, double yoffset)

{

if (fov >= 1.0f && fov <= 45.0f)

fov -= yoffset;

if (fov <= 1.0f)

fov = 1.0f;

else if (fov >= 45.0f)

fov = 45.0f;

}

注意,使用欧拉角的摄像机系统并不完美。根据你的视角限制或者是配置,你仍然可能引入万向节死锁问题。最好的摄像机系统是使用四元数(Quaternions)的,但我们将会把这个留到后面讨论。(译注:这里可以查看四元数摄像机的实现)

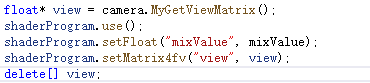

摄像机类

接下来的教程中,我们将会一直使用一个摄像机来浏览场景,从各个角度观察结果。然而,由于一个摄像机会占用每篇教程很大的篇幅,我们将会从细节抽象出来,创建我们自己的摄像机对象,它会完成大多数的工作,而且还会提供一些附加的功能。与着色器教程不同,我们不会带你一步一步创建摄像机类,我们只会提供你一份(有完整注释的)代码,如果你想知道它的内部构造的话可以自己去阅读。

和着色器对象一样,我们把摄像机类写在一个单独的头文件中。你可以在这里找到它,你现在应该能够理解所有的代码了。我们建议您至少看一看这个类,看看如何创建一个自己的摄像机类。

使用新摄像机对象,更新后版本的源码可以在这里找到。

这里也贴一下我的代码:

#ifndef CAMERA_H

#define CAMERA_H

#include <glad/glad.h>

#include <glm/glm.hpp>

#include <glm/gtc/matrix_transform.hpp>

#include <vector>

const float YAW = -90.0f;

const float PITCH = 0.0f;

const float SPEED = 0.2f;

const float SENSITIVITY = 0.1f;

const float FOV = 45.0f;

enum Camera_Movement {

FORWARD,

BACKWARD,

LEFT,

RIGHT

};

template <typename T>

void climb(T& target, T min, T max)

{

if (target < min)

target = min;

else if (target > max)

target = max;

}

class Camera

{

public:

glm::vec3 Position;

glm::vec3 Front;

glm::vec3 Up;

glm::vec3 Right;

glm::vec3 WorldUp;

float Yaw;

float Pitch;

float MovementSpeed;

float MouseSensitivity;

float Fov;

Camera(glm::vec3 position = glm::vec3(0.0f, 0.0f, 0.0f), glm::vec3 up = glm::vec3(0.0f, 1.0f, 0.0f), float yaw = YAW, float pitch = PITCH);

Camera(float posX, float posY, float posZ, float upX, float upY, float upZ, float yaw, float pitch);

glm::mat4 GetViewMatrix();

void ProcessKeyboard(Camera_Movement direction);

void ProcessMouseMovement(float xoffset, float yoffset, GLboolean constrainPitch = true);

void ProcessMouseScroll(float yoffset);

private:

void updateCameraVectors();

};

#endif // !CAMERA_H

#include "camera.h"

Camera::Camera(glm::vec3 position, glm::vec3 up, float yaw, float pitch) :

Front(glm::vec3(0.0f, 0.0f, -1.0f)), MovementSpeed(SPEED), MouseSensitivity(SENSITIVITY), Fov(FOV)

{

Position = position;

WorldUp = up;

Yaw = yaw;

Pitch = pitch;

updateCameraVectors();

}

Camera::Camera(float posX, float posY, float posZ, float upX, float upY, float upZ, float yaw, float pitch) :

Front(glm::vec3(0.0f, 0.0f, -1.0f)), MovementSpeed(SPEED), MouseSensitivity(SENSITIVITY), Fov(FOV)

{

Position = glm::vec3(posX, posY, posZ);

WorldUp = glm::vec3(upX, upY, upZ);

Yaw = yaw;

Pitch = pitch;

updateCameraVectors();

}

glm::mat4 Camera::GetViewMatrix()

{

return glm::lookAt(Position, Position + Front, Up);

}

void Camera::ProcessKeyboard(Camera_Movement direction)

{

switch (direction)

{

case FORWARD:

Position += Front * SPEED;

break;

case BACKWARD:

Position -= Front * SPEED;

break;

case LEFT:

Position -= Right * SPEED;

break;

case RIGHT:

Position += Right * SPEED;

break;

default:

break;

}

}

void Camera::ProcessMouseMovement(float xoffset, float yoffset, GLboolean constrainPitch)

{

xoffset *= MouseSensitivity, yoffset *= MouseSensitivity;

Yaw += xoffset;

Pitch += yoffset;

if (constrainPitch)

{

climb(Pitch, -89.0f, 89.0f);

}

updateCameraVectors();

}

void Camera::ProcessMouseScroll(float yoffset)

{

Fov -= yoffset;

climb(Fov, 1.0f, 45.0f);

}

void Camera::updateCameraVectors()

{

glm::vec3 front;

front.x = cos(glm::radians(Pitch)) * cos(glm::radians(Yaw));

front.y = sin(glm::radians(Pitch));

front.z = cos(glm::radians(Pitch)) * sin(glm::radians(Yaw));

Front = glm::normalize(front);

Right = glm::normalize(glm::cross(Front, WorldUp));

Up = glm::normalize(glm::cross(Right, Front));

}

#include <glad/glad.h>

#include <GLFW/glfw3.h>

#include <glm/glm.hpp>

#include <glm/gtc/matrix_transform.hpp>

#include <glm/gtc/type_ptr.hpp>

#include <iostream>

#include "Shader.h"

#include "stb_image.h"

#include "camera.h"

using std::cout;

//窗口回调函数

void framebuffer_size_callback(GLFWwindow* window, int width, int height)

{

//绘图视口 3D坐标到2D坐标的转换(映射)和这些参数(宽高)有关

glViewport(0, 0, width, height);

}

//键盘回调

void key_callback(GLFWwindow* window, int key, int scancode, int action, int mode);

//鼠标回调

void mouse_callback(GLFWwindow* window, double xpos, double ypos);

//滚轮回调

void scroll_callback(GLFWwindow* window, double xoffset, double yoffset);

//窗口初始大小

const unsigned int SCR_WIDTH = 800;

const unsigned int SCR_HEIGHT = 600;

const char* vShaderPath = "ShaderFiles/shader.vs";

const char* fShaderPath = "ShaderFiles/shader.fs";

float mixValue = 0.2f;

float lastX, lastY;

bool firstMouse = true;

Camera camera(glm::vec3(0.0f, 0.0f, 3.0f));

int main()

{

//glfw初始化

glfwInit();

//告诉glfw我们所使用的opengl版本 此处为3.3

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR, 3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR, 3);

glfwWindowHint(GLFW_OPENGL_PROFILE, GLFW_OPENGL_CORE_PROFILE);

//创建窗口

GLFWwindow* window = glfwCreateWindow(SCR_WIDTH, SCR_HEIGHT, "LearnOpenGL", NULL, NULL);

if (window == NULL)

{

cout << "Failed to create GLFW window\n";

glfwTerminate();

return -1;

}

glfwMakeContextCurrent(window);

glfwSetInputMode(window, GLFW_CURSOR, GLFW_CURSOR_DISABLED);

//设置窗口回调函数

glfwSetFramebufferSizeCallback(window, framebuffer_size_callback);

//键盘回调函数

glfwSetKeyCallback(window, key_callback);

//鼠标回调

glfwSetCursorPosCallback(window, mouse_callback);

//滚轮回调

glfwSetScrollCallback(window, scroll_callback);

if (!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress))

{

cout << "Failed to initialize GLAD\n";

return -1;

}

//着色器对象

Shader shaderProgram = Shader(vShaderPath, fShaderPath);

//纹理

unsigned int texture1, texture2;

glGenTextures(1, &texture1);

glGenTextures(1, &texture2);

glBindTexture(GL_TEXTURE_2D, texture1);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_NEAREST);

//加载并生成纹理

//读取图片

stbi_set_flip_vertically_on_load(true);

int width, height, nrChannels;

unsigned char* data = stbi_load("Images/container.jpg", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGB, width, height, 0, GL_RGB, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

cout << "Failed to load texture1\n";

}

stbi_image_free(data);

glBindTexture(GL_TEXTURE_2D, texture2);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_MIRRORED_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_MIRRORED_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_NEAREST);

data = stbi_load("Images/awesomeface.png", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGBA, width, height, 0, GL_RGBA, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

cout << "Failed to load texture1\n";

}

stbi_image_free(data);

glm::vec3 cubePositions[] = {

glm::vec3(0.0f, 0.0f, 0.0f),

glm::vec3(2.0f, 5.0f, -15.0f),

glm::vec3(-1.5f, -2.2f, -2.5f),

glm::vec3(-3.8f, -2.0f, -12.3f),

glm::vec3(2.4f, -0.4f, -3.5f),

glm::vec3(-1.7f, 3.0f, -7.5f),

glm::vec3(1.3f, -2.0f, -2.5f),

glm::vec3(1.5f, 2.0f, -2.5f),

glm::vec3(1.5f, 0.2f, -1.5f),

glm::vec3(-1.3f, 1.0f, -1.5f)

};

float vertices[] = {

// 后面

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

0.5f, -0.5f, -0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

// 前面

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

// 左侧面

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

// 右侧面

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

//底面

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

//顶面

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f

};

/*unsigned int indices[] = {

0, 1, 2,

2, 3, 0

};*/

//顶点缓冲对象 VBO

//顶点数组对象 VAO

//索引缓冲对象 EBO

unsigned int VBO, VAO, EBO;

glGenVertexArrays(1, &VAO);

glGenBuffers(1, &VBO);

//glGenBuffers(1, &EBO);

//先绑定VAO 再绑定设置VBO 最后设置顶点属性 vertex attributes

glBindVertexArray(VAO);

glBindBuffer(GL_ARRAY_BUFFER, VBO);

glBufferData(GL_ARRAY_BUFFER, sizeof(vertices), vertices, GL_STATIC_DRAW);

//glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, EBO);

//glBufferData(GL_ELEMENT_ARRAY_BUFFER, sizeof(indices), indices, GL_STATIC_DRAW);

//设置顶点属性

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

glVertexAttribPointer(1, 2, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)(3 * sizeof(float)));

glEnableVertexAttribArray(1);

glBindBuffer(GL_ARRAY_BUFFER, 0);

//remember: do NOT unbind the EBO while a VAO is active as the bound element buffer object IS stored in the VAO; keep the EBO bound.

//当VAO处于活动状态时,不要解除EBO的绑定 因为它存储在VAO中

//glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, 0);

//您可以在之后解除对VAO的绑定,这样其他VAO调用就不会意外地修改此VAO,但这种情况很少发生。修改其他

//VAOs需要调用glBindVertexArray,所以我们通常不会在不需要的时候解除VAOs(或VBOs)的绑定。

glBindVertexArray(0);

//线框模式

//glPolygonMode(GL_FRONT_AND_BACK, GL_LINE);

shaderProgram.use();

shaderProgram.setInt("texture1", 0);

shaderProgram.setInt("texture2", 1);

//开启深度测试

glEnable(GL_DEPTH_TEST);

while (!glfwWindowShouldClose(window))

{

glClearColor(0.2f, 0.3f, 0.3f, 1.0f);

glClear(GL_COLOR_BUFFER_BIT | GL_DEPTH_BUFFER_BIT);

//矩阵运算

glm::mat4 view = camera.GetViewMatrix();

glm::mat4 projection(1.0f);

projection = glm::perspective(glm::radians(camera.Fov), SCR_WIDTH * 1.0f / SCR_HEIGHT, 0.1f, 100.0f);

//激活着色器

shaderProgram.use();

shaderProgram.setFloat("mixValue", mixValue);

shaderProgram.setMatrix4fv("view", glm::value_ptr(view));

shaderProgram.setMatrix4fv("projection", glm::value_ptr(projection));

//绑定纹理

glActiveTexture(GL_TEXTURE0);

glBindTexture(GL_TEXTURE_2D, texture1);

glActiveTexture(GL_TEXTURE1);

glBindTexture(GL_TEXTURE_2D, texture2);

//绘制三角形

glBindVertexArray(VAO);

//glDrawElements(GL_TRIANGLES, 6, GL_UNSIGNED_INT, 0);

for (unsigned int i = 0; i < 10; i++)

{

glm::mat4 model(1.0f);

model = glm::translate(model, cubePositions[i]);

float angle = 20.0f * i;

if (i % 3 == 0)

angle = 20.0f * glfwGetTime();

model = glm::rotate(model, glm::radians(angle), glm::vec3(1.0, 0.3, 0.5));

shaderProgram.setMatrix4fv("model", glm::value_ptr(model));

glDrawArrays(GL_TRIANGLES, 0, 36);

}

glBindVertexArray(0);

glfwSwapBuffers(window);

glfwPollEvents();

}

//这一步是可选的

glDeleteVertexArrays(1, &VAO);

glDeleteBuffers(1, &VBO);

//glDeleteBuffers(1, &EBO);

//释放资源

glfwTerminate();

return 0;

}

void key_callback(GLFWwindow* window, int key, int scancode, int action, int mode)

{

if (action == GLFW_REPEAT || action == GLFW_PRESS)

{

if (key == GLFW_KEY_ESCAPE)

{

glfwSetWindowShouldClose(window, GL_TRUE);

return;

}

switch (key)

{

case GLFW_KEY_UP:

mixValue += 0.1f;

if (mixValue >= 1.0f)

mixValue = 1.0f;

break;

case GLFW_KEY_DOWN:

mixValue -= 0.1f;

if (mixValue <= 0.0f)

mixValue = 0.0f;

break;

case GLFW_KEY_W:

camera.ProcessKeyboard(FORWARD);

break;

case GLFW_KEY_S:

camera.ProcessKeyboard(BACKWARD);

break;

case GLFW_KEY_A:

camera.ProcessKeyboard(LEFT);

break;

case GLFW_KEY_D:

camera.ProcessKeyboard(RIGHT);

break;

default:

break;

}

}

}

void mouse_callback(GLFWwindow* window, double xpos, double ypos)

{

if (firstMouse)

{

firstMouse = false;

lastX = xpos, lastY = ypos;

}

camera.ProcessMouseMovement(xpos - lastX, lastY - ypos);

lastX = xpos;

lastY = ypos;

}

void scroll_callback(GLFWwindow* window, double xoffset, double yoffset)

{

camera.ProcessMouseScroll(yoffset);

}

总结

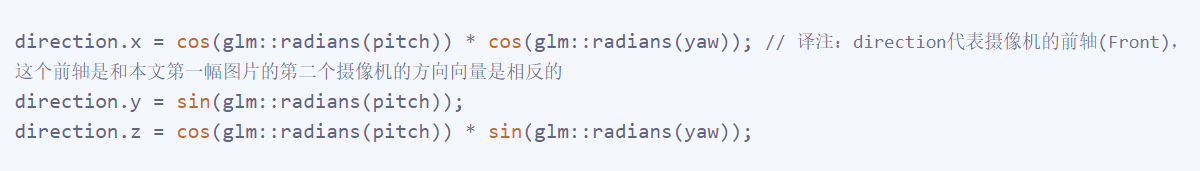

个人认为这一节的核心内容就是Look At矩阵:

还有如何通过俯仰角(Pitch)和偏航角(Yaw)计算FPS相机的朝向:

初始时可认为Pitch为0,Yaw为-90,这样可以使得相机朝向-z轴,在OpenGL中就是垂直屏幕向里。

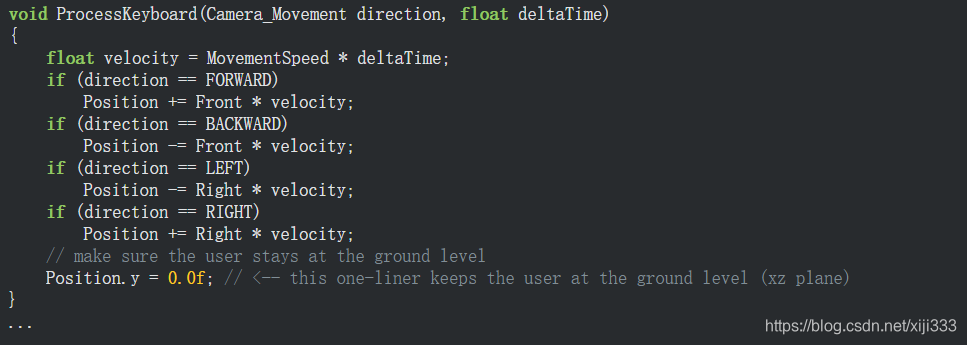

练习

看看你是否能够修改摄像机类,使得其能够变成一个真正的FPS摄像机(也就是说不能够随意飞行);你只能够呆在xz平面上:

试着创建你自己的LookAt函数,其中你需要手动创建一个我们在一开始讨论的观察矩阵。用你的函数实现来替换GLM的LookAt函数,看看它是否还能一样地工作: