全部笔记的汇总贴:《机器学习》西瓜书-读书笔记汇总贴

一、k近邻学习

比较简单,下面的这篇文章有写,就不赘述了。

统计学习方法读书笔记(十四)-聚类方法

二、低维嵌入

在高维情形下出现的数据样本稀疏、距离计算困难等问题?是所有机器学习方法共同面临的严重障碍,被称为 “ 维数灾难” 。缓解维数灾难的一个重要途径是降维 ,亦称“维数约简"。

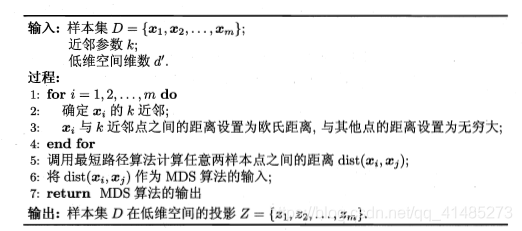

- MDS算法

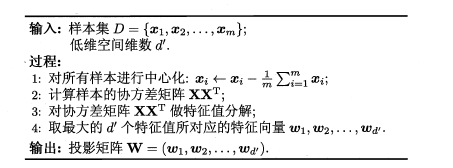

三、主成分分析

- 最近重构性

- 最大可分性

四、核化线性降维

基于核技巧对线性降维方法进行核化。

- 核主成分分析KPCA

五、流形学习

流形学习(manifold learning)是一类借鉴了拓扑流形概念的降维方法。 “流形 ” 是在局部与欧氏空间同胚的空间,换言之7 它在局部具有欧氏空间的性质,能用欧氏距离来进行距离计算。

- Isomap算法

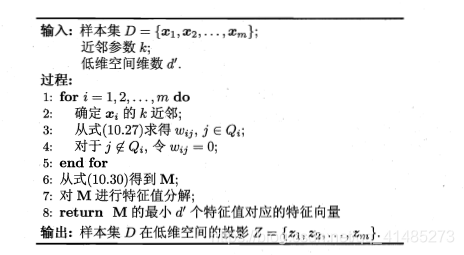

- LLE算法

六、度量学习

在机器学习中,对高维数据进行降维的主要目的是希望找到→个合适的低维空间,在此空间中进行学习能比原始空间性能更好。事实上,每个空间对应了在样本属性上定义的一个距离度量,而寻找合适的空间,实质上就是在寻找一 个合适的距离度量。

度量学习的线性模型

线性的度量学习问题也称为马氏度量学习问题,可以分为监督的和非监督的学习算法。

监督的全局度量学习

- Information-theoretic metric learning(ITML)

- Mahalanobis Metric Learning for Clustering(MMC)

- Maximally Collapsing Metric Learning (MCML)

监督的局部度量学习

- Neighbourhood Components Analysis (NCA)

- Large-Margin Nearest Neighbors (LMNN)

- Relevant Component Analysis(RCA)

- Local Linear Discriminative Analysis(Local LDA)

非监督的度量学习

- 主成分分析(Pricipal Components Analysis, PCA)

- 多维尺度变换(Multi-dimensional Scaling, MDS)

- 非负矩阵分解(Non-negative Matrix Factorization,NMF)

- 独立成分分析(Independent components analysis, ICA)

- 邻域保持嵌入(Neighborhood Preserving Embedding,NPE)

- 局部保留投影(Locality Preserving Projections. LPP)

度量学习的非线性模型

非线性降维算法(非线性度量学习):

- 等距映射(Isometric Mapping,ISOMAP)

- 局部线性嵌入(Locally Linear Embedding, LLE)

- 拉普拉斯特征映射(Laplacian Eigenmap,LE )

通过核方法来对线性映射进行扩展:

- Non-Mahalanobis Local Distance Functions

- Mahalanobis Local Distance Functions

- Metric Learning with Neural Networks

相关论文

- Distance metric learning with application to clustering with side-information

- Information-theoretic metric learning(关于ITML)

- Distance metric learning for large margin nearest neighbor classification(关于LMNN)

- Learning the parts of objects by non-negative matrix factorization(Nature关于RCA的文章)

- Neighbourhood components analysis(关于NCA)

- Metric Learning by Collapsing Classes(关于MCML)

- Distance metric learning a comprehensive survey(一篇经典的综述)

下一章传送门:西瓜书读书笔记(十一)-特征选择与稀疏学习