简介

在序列编解码中

- RNN无法很好地学习到全局的结构信息,因为它本质是一个马尔科夫决策过程。

- CNN的方案也是很自然的,窗口式遍历,比如尺寸为3的卷积

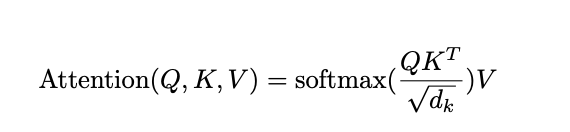

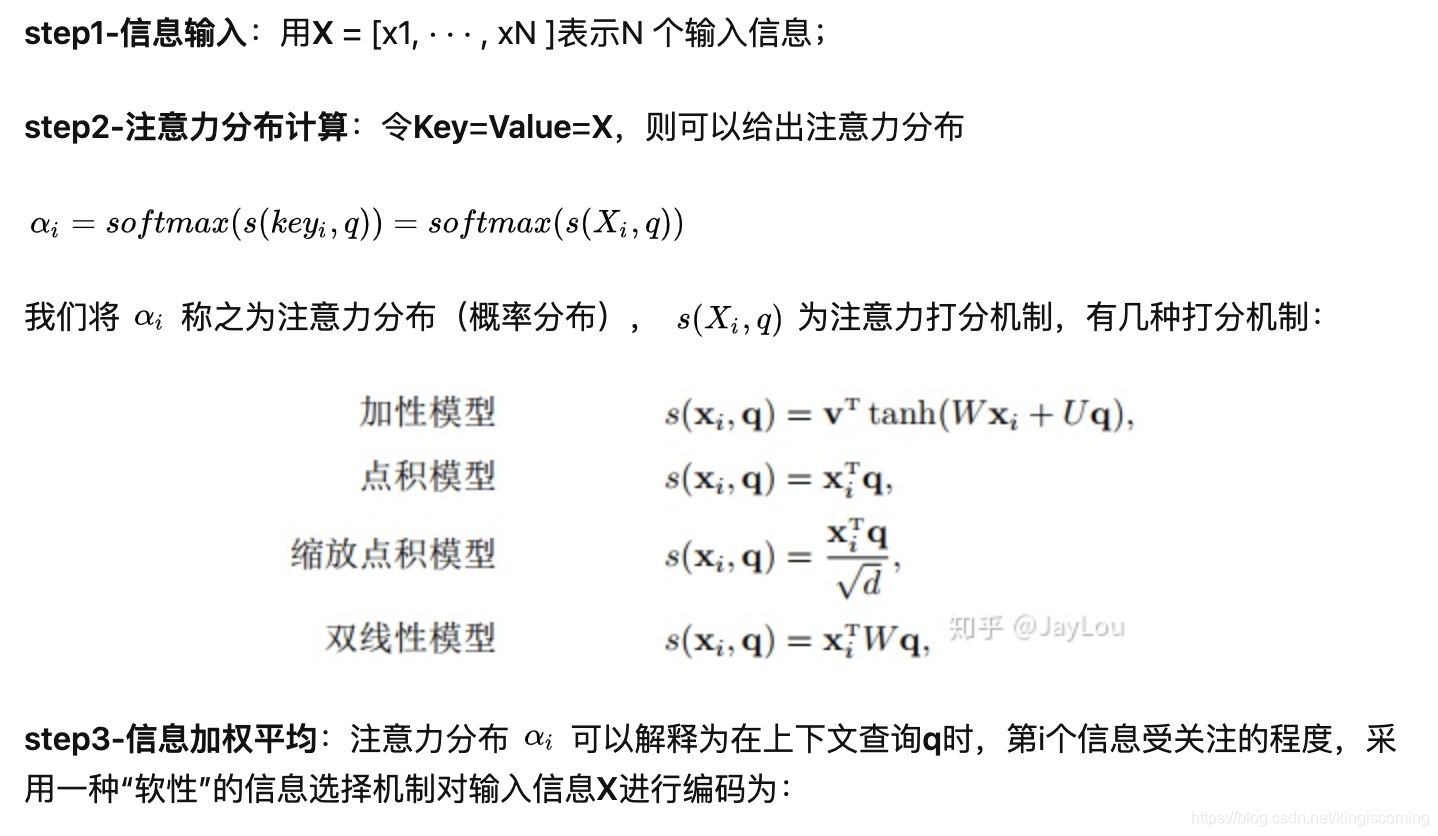

- google 提出 attention

attention 过程:

Reference:

1.nlp中的Attention注意力机制+Transformer详解

2.《Attention is All You Need》浅读

3.(线性Attention的探索:Attention必须有个Softmax吗?)[https://kexue.fm/archives/7546]