内容来源:pylessons

文章编译:源代码杀手

YOLOv4较旧版本YOLOv4的改进,并且我们已经知道现在它比以前更好。也许使用YOLOv3的每个人都将迁移到YOLOv4,因为它是我们可以用于实时应用程序的最快的对象检测模型之一。但是在本教程中,我想向您展示,如何使用TensorRT将对象检测的速度提高三倍!在本文中,不介绍如何安装TensorRT。

TensorFlow是当今最受欢迎的深度学习框架之一,在全球拥有成千上万的用户。TensorRT是一个深度学习平台,可通过简单的方式优化神经网络模型并加快GPU推理的性能。TensorFlow团队与NVIDIA合作,并在TensorFlow v1.7中添加了对TensorRT的初始支持,现在它已在TensorFlow 2.0及更高版本中投入使用。

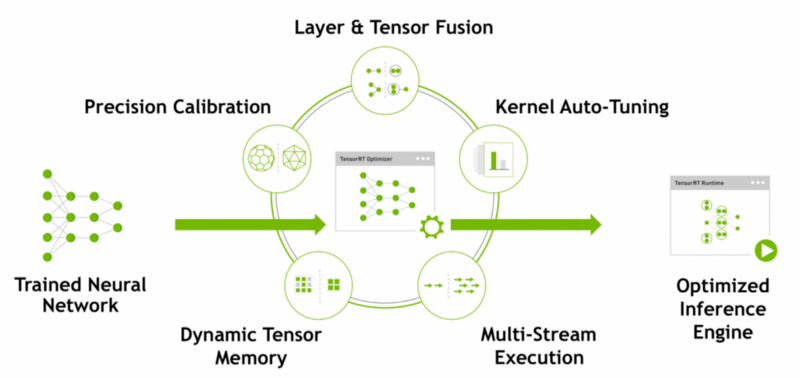

那么TensorRT是什么?NVIDIA TensorRT是高性能的推理优化器和运行时,可用于在GPU上以较低精度(FP32,FP16和INT8)执行推理。它与TensorFlow的集成使您可以通过几行代码将TensorRT优化应用于您的TensorFlow模型。与仅使用TensorFlow相比,我们可以将性能提高8倍。集成对支持的图进行了优化&