三大学派

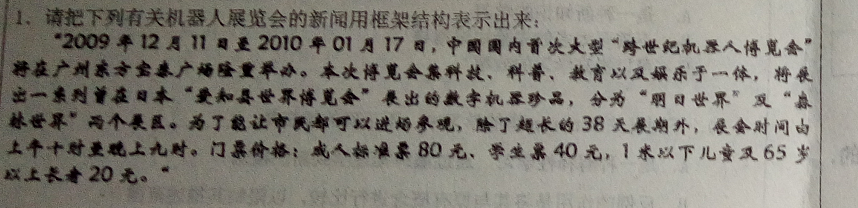

目前人工智能的主要学派有三个:

(1)符号主义,又称为逻辑主义或计算机学派。认为人类智能的基本单元是符号,认知过程就是符号表示下的符号计算,从而思维就是符号计算。其原理主要为物理符号系统假设和有限合理性原理。

(2)联结主义,又称仿生学派。认为人类智能的基本单元是神经元,认知过程是由神经元构成的网络的信息传递,这种传递是并行分布进行的。其原理主要为神经网络及神经网络间的连接机制与学习算法。

(3)行为主义,又称进化主义或控制论学派。这种观点认为智能取决于感知和行为(所以被称为行为主义),它不需要知识、不需要表示、不需要推理。其原理是控制论和感知-动作型控制系统。

- 符号主义:功能 逻辑主义

- 联结主义:结构 仿生学

- 行为主义:行为 控制论

归纳学习SBL

应用归纳推理进行学习的一种方法

温斯顿的拱学习、决策树学习

- 取消部分条件

- 放松条件

- 沿概念树上溯

- 形成闭合区域

- 将常量转化为变量

解释学习EBL

避免实例样本归纳学习所产生的不可靠性

- 解释

- 概括

- 选取

(1) 利用基于解释的方法对训练实例进行分析与解释,以说明它是目标概念的一个实例

(2) 对实例的结构进行概括性解释,建立该训练实例的一个解释结构以满足所学概念的定义;解释结构的各个叶节点应符合可操作性准则,且使这种解释比最初的例子适用于更大的一类例子

(3) 从解释结构中识别出训练实例的特性,并从中得到更大一类例子的概括性描述,获取一般控制知识

BP深度学习

bp网络是多层无反馈网络

两个阶段

- 第一个阶段是输入已知学习样本,通过设置的网络结构和前一次迭代的权值和阈值,从网络的第一层向后计算各神经元的输出。

- 第二个阶段是对权值和阈值进行修改,从最后一层向前计算各权值和阈值对总误差的影响(梯度),按照能够使误差减小的方向对各权值和阈值进行修改。

以上两个过程反复交替,直到达到收敛为止。

由于误差逐层往回传递,以修正层与层间的权值和阈值,所以称该算法为误差反向传播(error backpropagation)算法,这种误差反传学习算法可以推广到有若干个中间层的多层网络,因此该多层网络常称之为BP网络。

- CNN 卷积神经网络:由一个或多个卷积层和顶端的全连通层(对应经典的神经网络)组成,同时也包括关联权重和缓冲层(pooling layer)。

- RNN 循环神经网络:对输入序列数据形成有向图,显示时间动态行为 输入层输入 隐藏层输出

- RBM 受限波尔兹曼机:一类可通过输入数据集学习概率分布的随机生成神经网络,是隐层节点间彼此无连接的玻耳兹曼机。

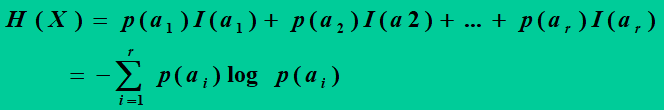

计算题

决策树ID3

模糊计算

并取最大值

交取最小值

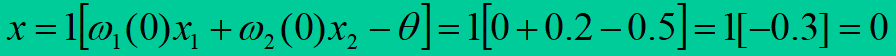

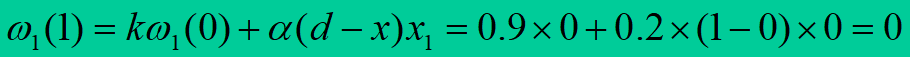

神经计算

应用题

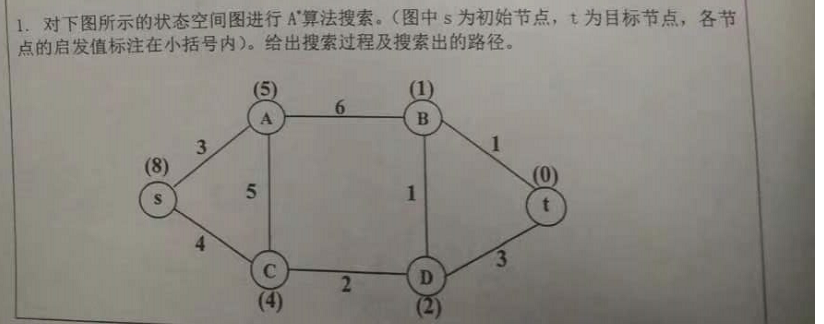

A*算法

- 均一代价搜索

- 深度优先搜索

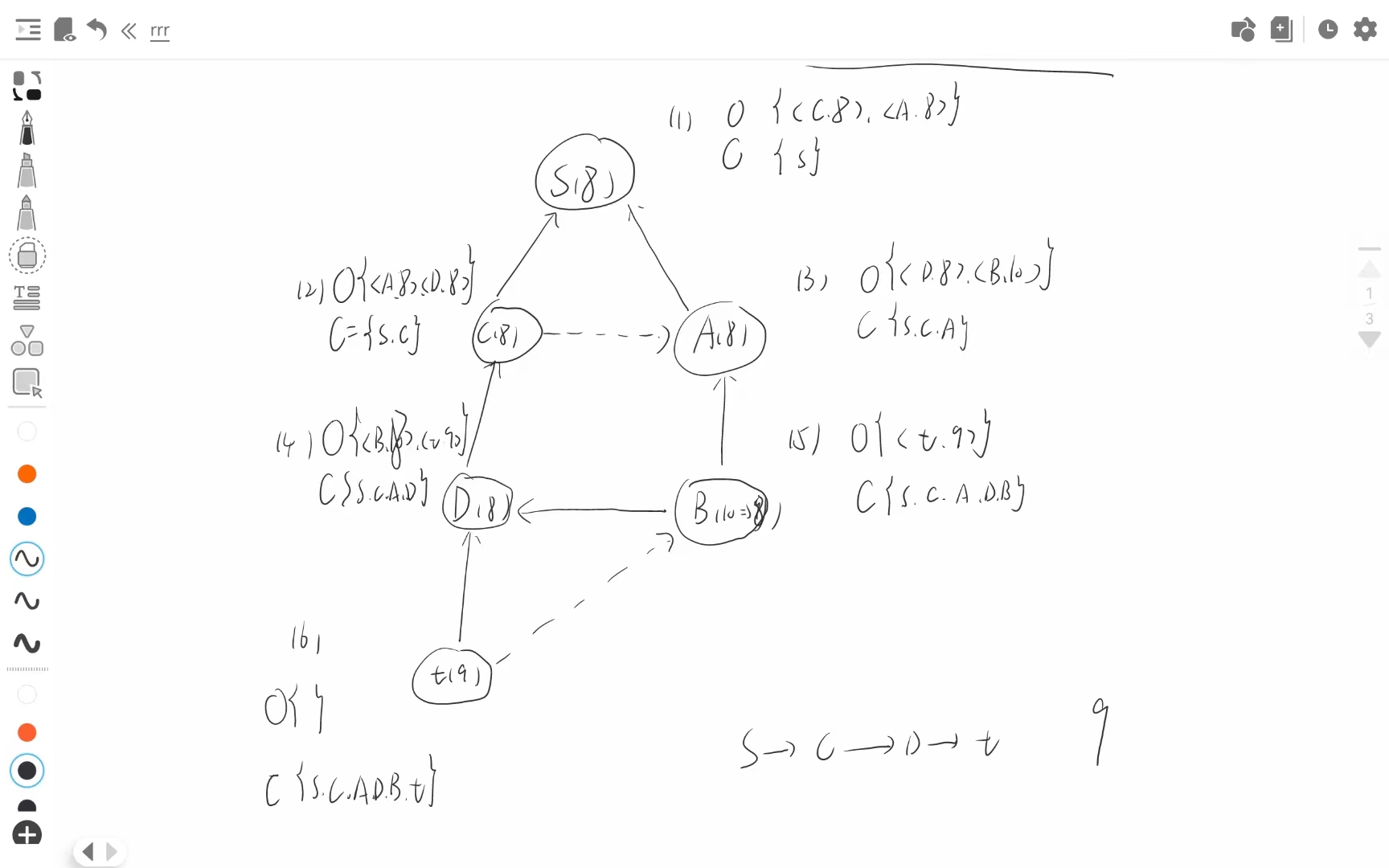

消解原理 归结原理

- 定义谓词

- 将前提及要求证的问题表示成谓词公式

- 将上述规则与事实以及求证目标的否定化成子句集

- 利用归结原理对上面的子句集S中的子句进行归结。

ps: 存在量词E取反变全称量词

STRIPS规划系统

PPT

- 先决条件

- 删除表

- 添加表

简答

- 常见的知识表示法有状态空间、问题归约、谓词表示、语义网络、框架表示

- 【状态表示法】在状态表示法中,解的问题是以状态和算符集合的形式表示的 从某个初始状态开始,每次加一个操作符,递增地建立起操作符的试验序列,直到达到目标状态为止

- 【问题归约法】从目标(要解决的问题)出发,逆向推理,通过一系列变换把初始问题变换为子问题集合和子子问题集合,直至最后归约为一个平凡的本原问题集合.这些本原问题的解可以直接得到,从而解决了初始问题,用与或图来有效地说明问题归约法的求解途径.

- 语义网络是有向图表示的(节点1,有向弧,节点2)三元联结而成的,其推理过程主要有继承和匹配两种

- 在图搜索中,是否应用了已有的知识,决定了搜索是盲目搜索还是启发式搜索。常见的启发式搜索有有序搜索、A*算法

- 基于解释的学习(EBL)中,给出训练事例的意义在于,提取出在解决实际问题时可以应用的部分,从而节省存储容量和搜索时间

- 机器学习主要的推理方式是机械式、类推、归纳、演绎以及发现

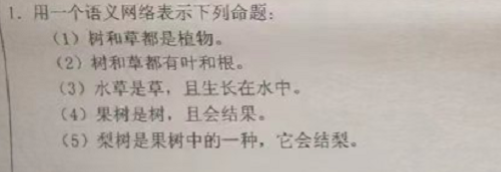

语义网络

- ISA 是

- AKO 一种

- AMemer-of 一员(个体)

- Have Can Age 属性

- Part-of 局部

- Before After 时间

- Located-on/at/under/inside/outside 位置

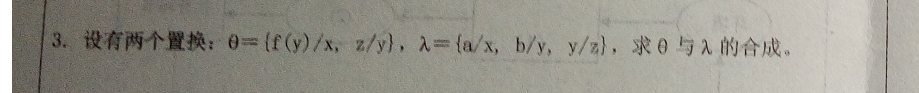

置换合成

https://wenku.baidu.com/view/dfeffe39b90d6c85ed3ac602.html

{f(b)/x ,y/z}

框架结构