卷积,一直是一个很耳熟但是却又不知道是什么的东西

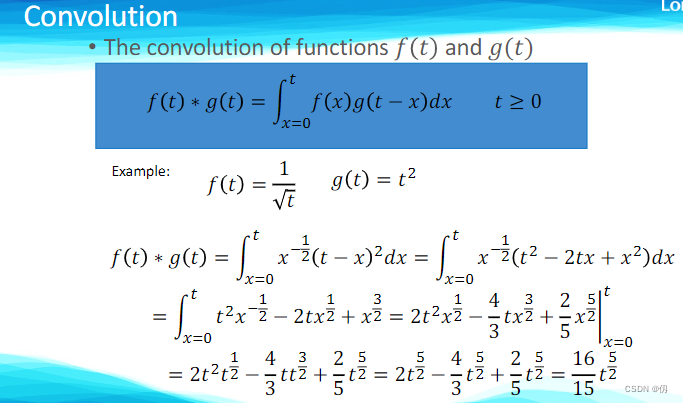

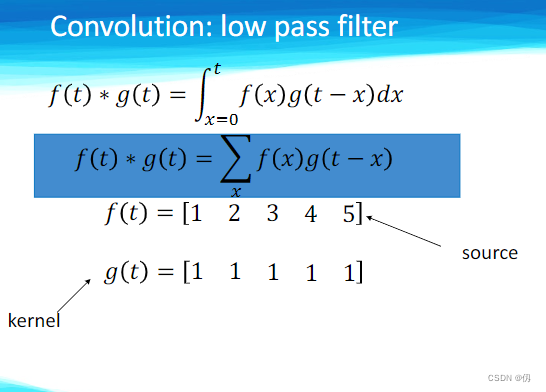

如上图所示,卷积被定义为:

设F(x)和g(x)是定义在无穷区间上的两个连续时间信号,则将积分

定义为f(x)和g(x)的卷积,记为f(x)*g(x)。

其中,函数g一般称为过滤器(filters),函数f指的是信号/图像。

在数学上,卷积核的标准定义是两个函数在反转和移位后的乘积的积分:在卷积神经网络里,卷积核其实就是一个过滤器,但在深度学习里,它不做反转,而是直接执行逐元素的乘法和加法,我们把这个又称为互相关,在深度学习里称为卷积。

引用自—— https://pic1.zhimg.com/v2-edda9924652a3d3d0268bd4d2752a6f4_b.webp

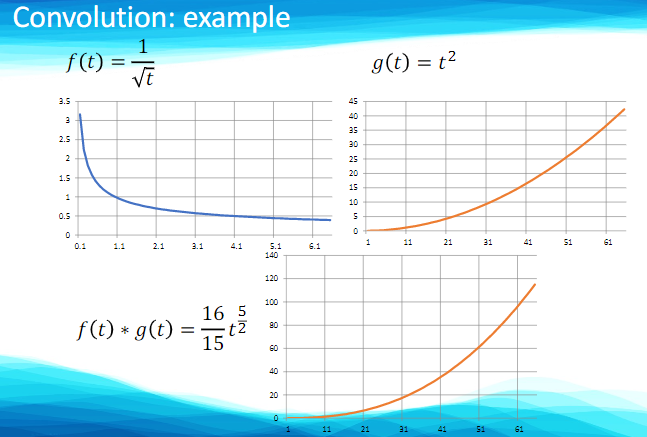

图中重叠部分的面积就相当于t处的卷积直观上,我明白了卷积的物理含义:函数 f 和 g 在 t 时刻的卷积表征为函数 f 与经过翻转和平移的 g 的重叠部分的面积。卷积即为面积、面积就是积分、积分便为叠加。

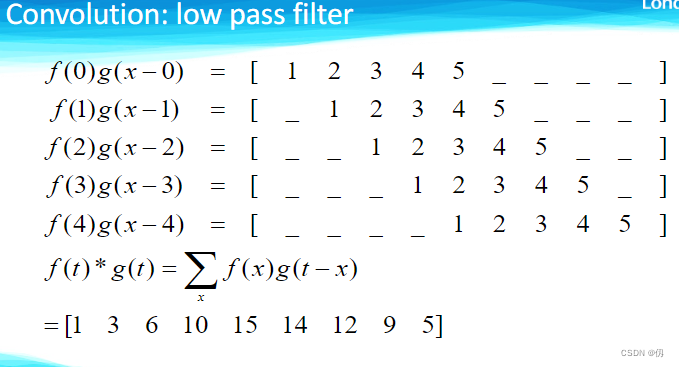

好了回归slide,有一个显而易见的例子,图示如下

卷积中有一个重要的理念为低通滤波器(low pass filter)

上边我们提到了,g函数就是一个过滤器。一般来讲,每个卷积核具有长、宽、深三个维度。

卷积核的长、宽都是人为指定的,长乘宽也被称为卷积核的尺寸,常用的尺寸为3X3,5X5等。在这个例子中我们的卷积核是【1 1 1 1 1】