择时系列第十五篇,分享一篇使用Transformer构建的择时策略。作者发现,基于注意力机制的深度学习策略,显著优于传统的时序动量策略和均值回归策略。此外作者提供了源码,可以直接测试,量化前沿速递公众号后台回复“择时15”获取报告及代码。

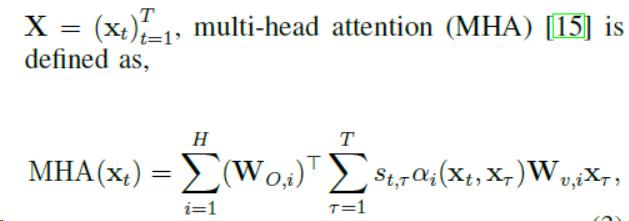

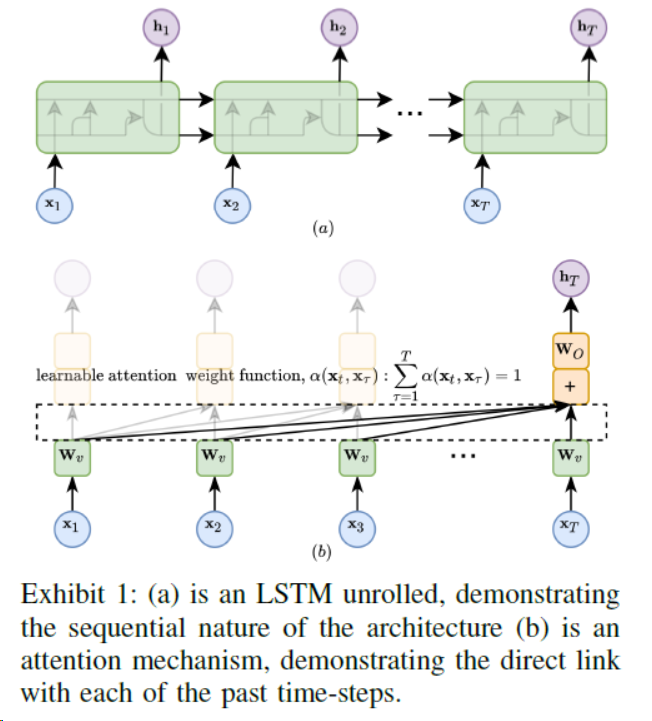

作者首先对Transfor的深度网络做了一些说明,并与LSTM做对比。Transformer与LSTM不同的地方在于,Transformer是基于注意力机制的深度学习架构,LSTM是顺序式的架构。这种注意力机制使得Transformer可以直接连接到所有先前的时间步骤,从而能够学习更长期的模式。此外,Transformer还引入了多个muliti-head atterntion(MHA),可以捕捉同时发生在不同时间尺度上的并发模式或时间动态。

下图是LSTM和Transformer的一个对比图。

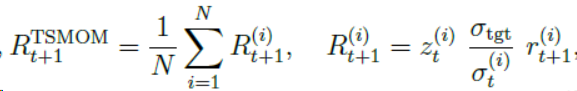

数据处理上,首先对收益率做波动率调整,以保证数据在时序上的一致性

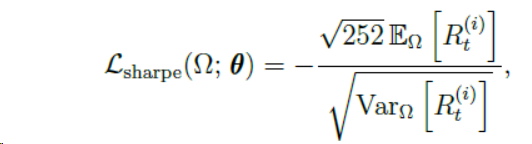

损失函数定义为策略的夏普比率

使用的特征包括收益率、波动率、MACD等价量指标。

样本为50个流动性非常好的期货(商品、股指、固定收益等等)。模型使用1990-1995年的数据做训练,1995-2000年作为测试集。

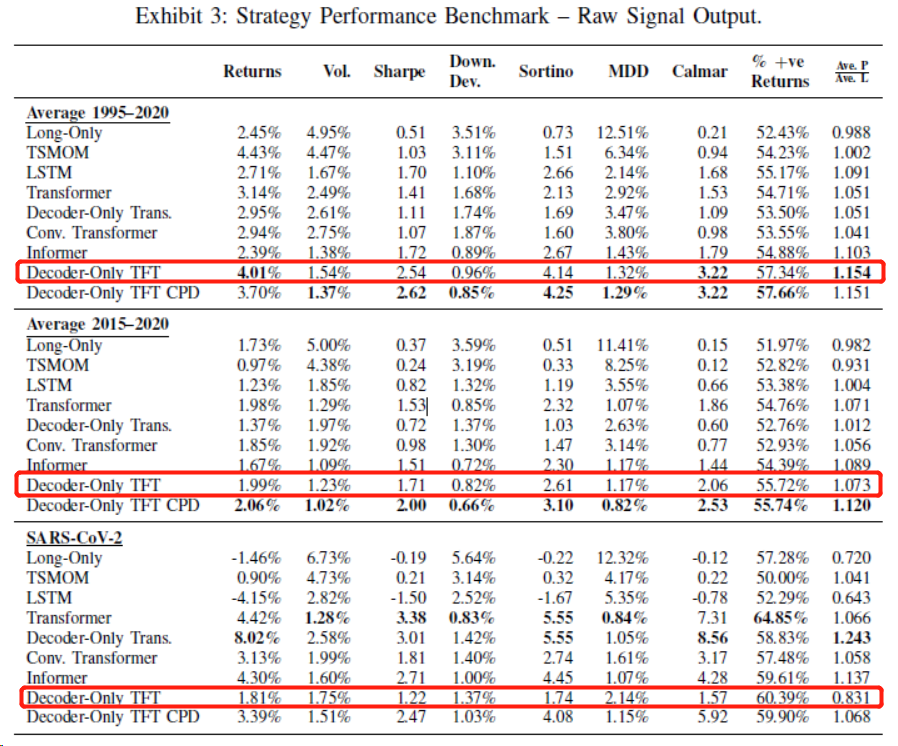

作者共测试了策略在三个区间下的表现:1995-2020、2015-2020、新冠期间期间。结果来看,都是Transformer策略下的策略最优

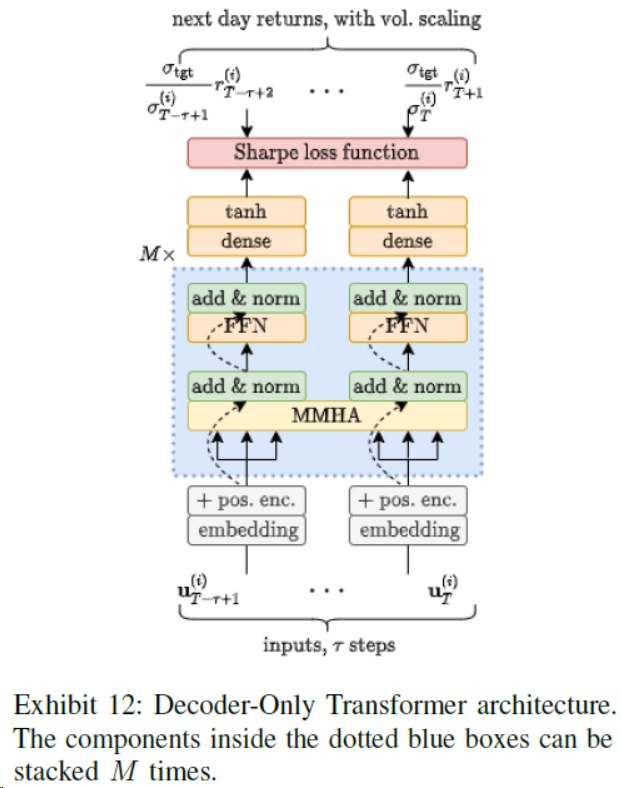

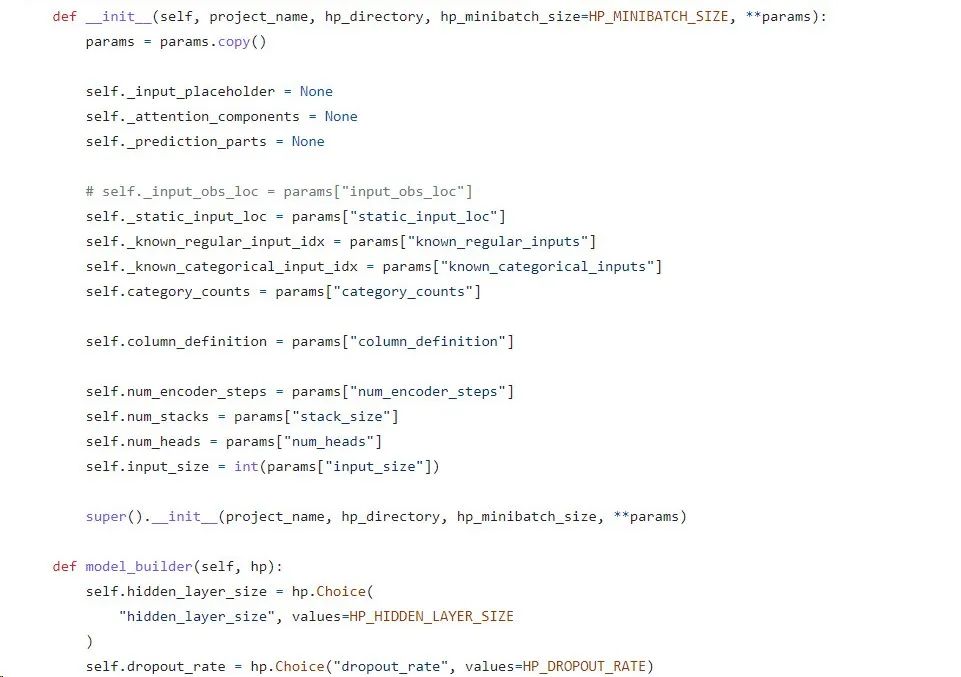

这里的Decoder-only TFT设定如下

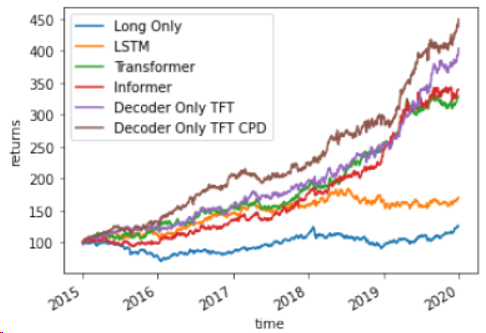

净值曲线如下

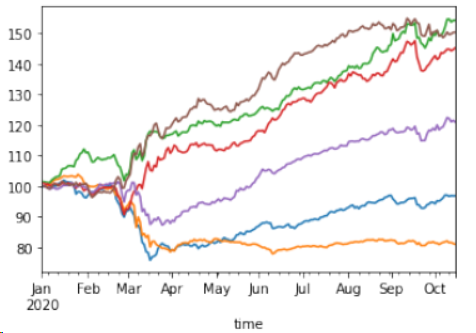

新冠期间

论文的主要内容如上,对于代码,作者在文中给出了github链接,可以直接访问。

此外, 还有一些对于参数设定、交易成本方面的说明,可自行查阅论文。

以上为论文的主要内容,觉得不错可以点赞/在看支持。