ORB-SLAM2源码分析(单目)——初始化流程

一、 ORB-SLAM2简介

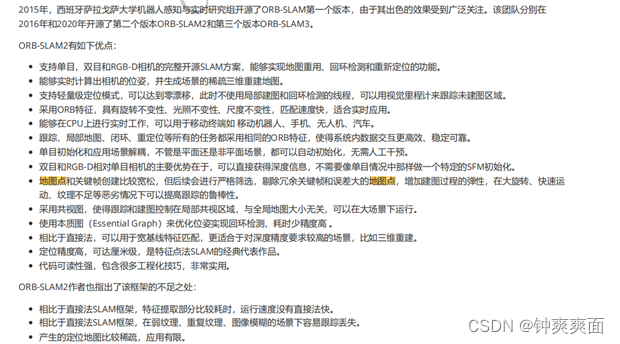

ORB-SLAM2特点:

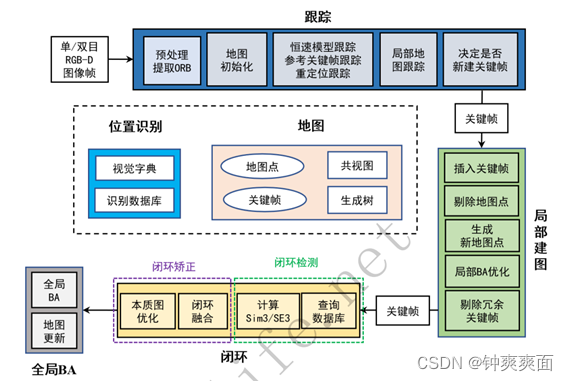

ORB-SLAM2整体框架:

(1) 输入:

有三种模式可以选择:单目模式、双目模式和RGB-D模式。

(2) 跟踪:

初始化成功后首先会选择参考关键帧跟踪,然后大部分时间都是恒速模型跟踪,当跟踪丢失的时候启动重定位跟踪,在经过以上跟踪后可以估计初步的位姿,然后经过局部地图跟踪对位姿进行进一步优化。同时会根据条件判断是否需要将当前帧新建为关键帧。

(3) 局部建图:

输入的关键帧来自跟踪里新建的关键帧。为了增加局部地图点数目,局部地图里关键帧之间会重新进行特征匹配,生成新的

(4) 地图点:

局部BA会同时优化共视图里的关键帧位姿和地图点,优化后也会删除不准确的地图点和冗余的关键帧。

(5) 闭环

通过词袋来查询数据集检测是否闭环,计算当前关键帧和闭环候选关键帧之间的Sim3位姿,仅在单目时考虑尺度,双目或RGBD模式下尺度固定为1。然后执行闭环融合和本质图优化,使得所有关键帧位姿更准确。

(6) 全局BA

优化所有的关键帧及其地图点。

(7) 位置识别

需要导入离线训练好的字典,这个字典是由视觉词袋模型构建的。新输入的图像帧需要先在线转化为词袋向量,主要应用于特征匹配、重定位、闭环。

(8) 地图

地图主要由地图点和关键帧组成。关键帧之间根据共视地图点数目组成了共视图,根据父子关系组成了生成树。

二、 SLAM系统初始化

从网上下载了ORB-SLAM2的源码,打开单目相机Demo。

(1) 进入main函数:

加载视频文件,用于接下来我们跑整个ORB-SLAM2的流程

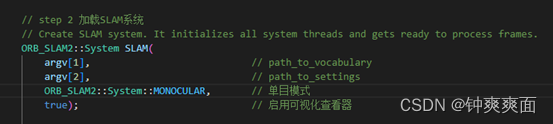

(2) Slam系统构造函数:

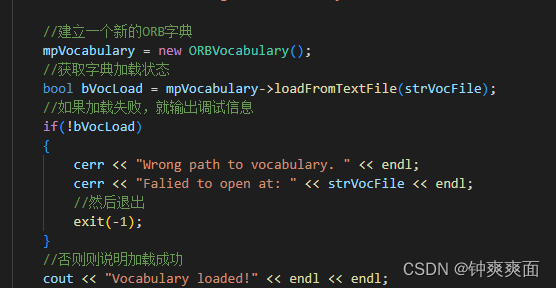

(3) 加载ORB字典

加载ORB字典,用于我们后续使用词袋匹配

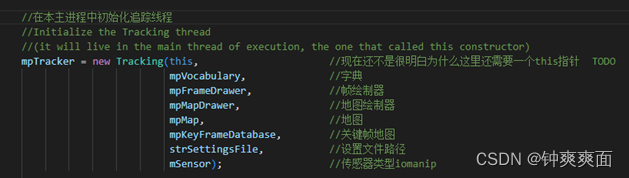

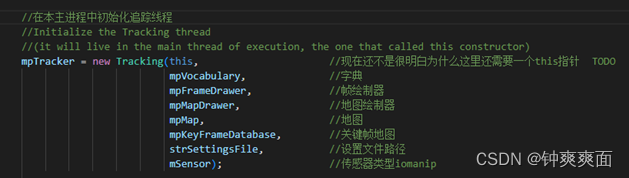

(4) 初始化追踪线程

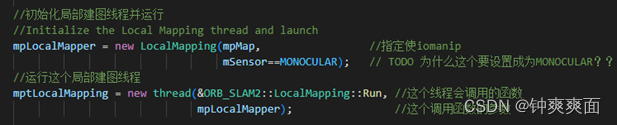

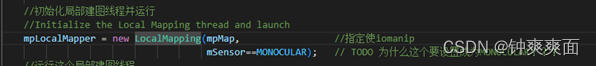

(5) 初始化局部建图,并且运行局部建图线程

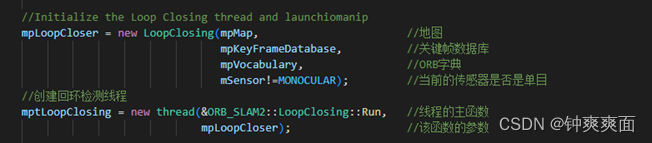

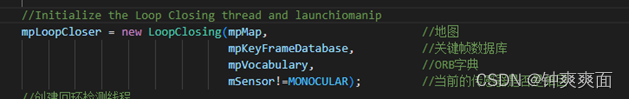

(6) 初始化回环检测,并且运行回环检测线程

(7) 初始化绘制器**

三、 跟踪线程初始化

我们进去看一下跟踪线程初始化具体做了哪些操作

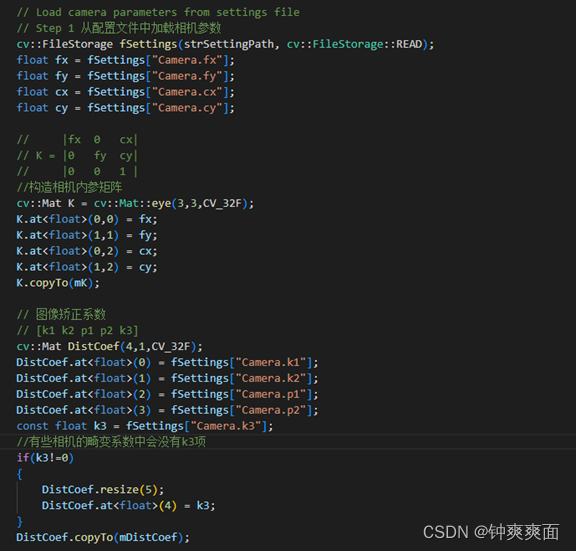

(1) 从配置文件中读取相机的内参

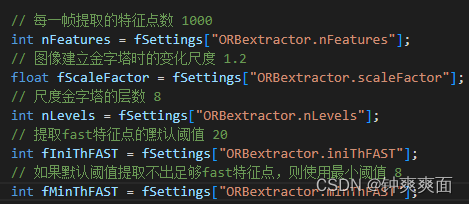

(2) 获取图像金字塔、特征点的参数

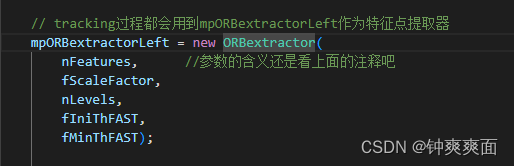

(3) 初始化ORB特征点提取器

看看ORB特征提取器是如何初始化的

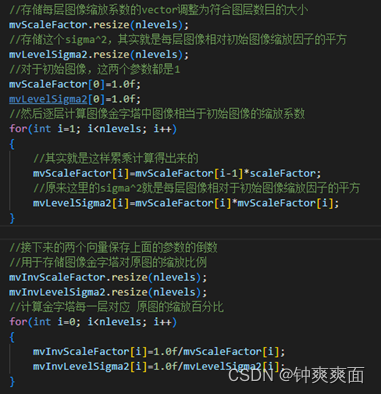

1) 初始化每一层的图像尺寸

通过我们输入的金字塔层数与缩放系数,计算出金字塔每一层图像跟原始图像的缩放比

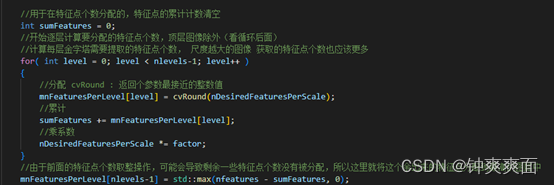

2) 初始化提取每一层金字塔图像的特征点数量

通过要提取的总特征点数量,计算提取每一层金字塔图像的特征点数量。图像尺寸越大,所提取的特征点占比越多,反之越少

3) 初始化ORB特征点的灰度质心的相关参数

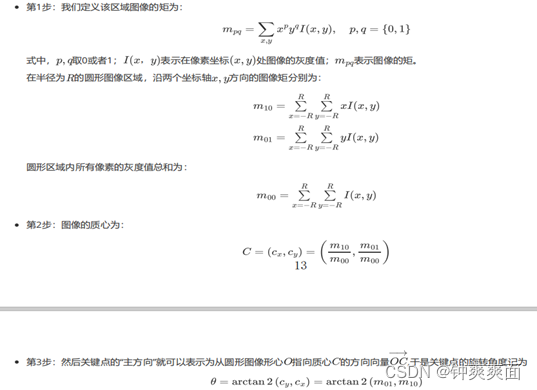

原始的FAST关键点没有方向信息,这样当图像发生旋转后,brief描述子也会发生变化,使得特征点对旋转不鲁棒,所以我们使用灰度质心法来获取特征点的方向,从而获得旋转不变性。

如何计算灰度质心?

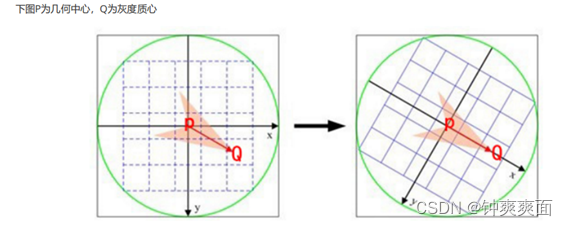

在一个圆内计算灰度质心

为什么使用圆形来计算灰度质心而不用正方形等其他形状呢?

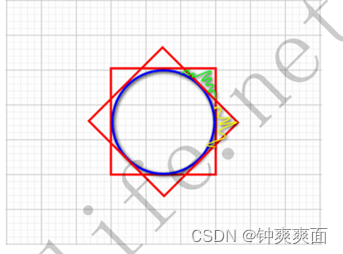

ORBSLAM里面是先旋转坐标再从图像中采点提取,并不是先取那块图像再旋转, 会导致下方采集点的时候绿色和黄色部分就是不同的像素

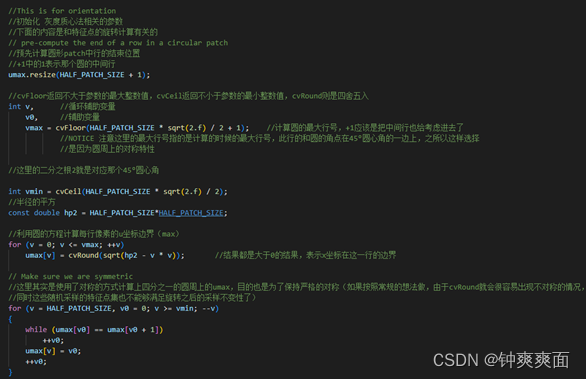

ORB-SLAM2初始化质心相关参数如下代码所示

我们需要计算特征点的灰度质心,根据公式,我们要获得圆内所有像素点的灰度值,在来计算出灰度质心。所以我们要先确定圆的边界,判断哪些像素点是在圆内参与计算的,哪些是不参与计算的。这里我们先计算四分之一圆的边界,再通过对称,最后组成一个圆。最终我们获得圆的边界参数信息umax。

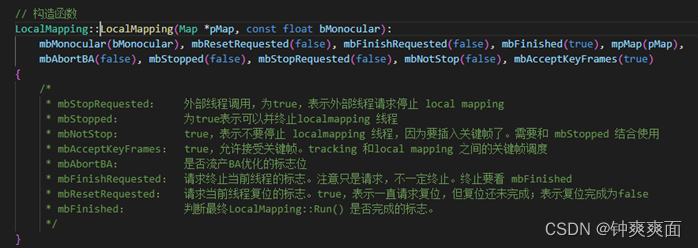

四、 局部建图初始化

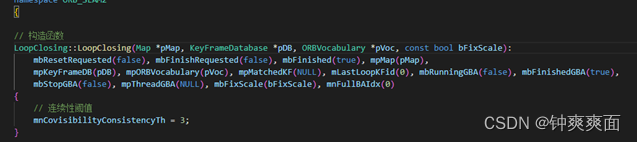

五、 回环检测初始化

设置了回环检测中,需要连续检测到多少帧回环帧才能算回环。