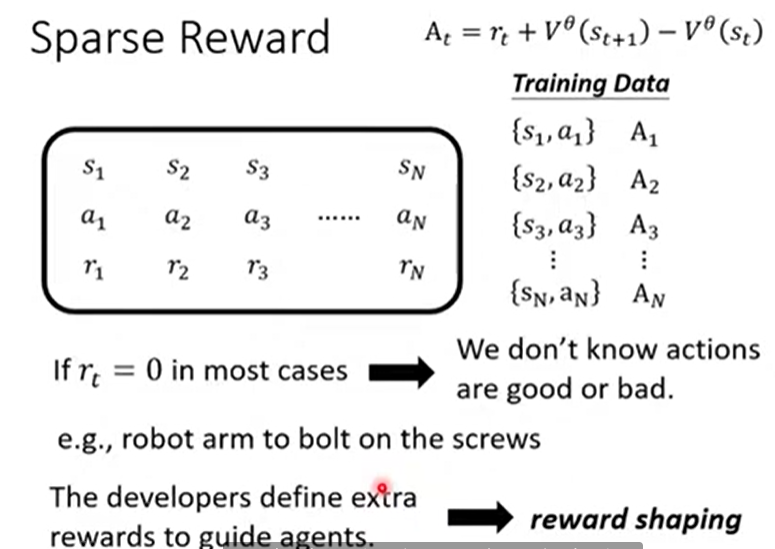

sparse reward

我们不知道行动是好是坏,大多数情况下,如果r = 0,那怎么解决呢?

例如,机器人手臂将螺栓固定在螺丝上,开发人员应该定义额外奖励来指导代理(reward shaping)。

reward shaping需要有一定的领域知识。

当代理看到新的(但有意义的)东西时,获得额外的奖励。

no reward:learning from demonstration

动机

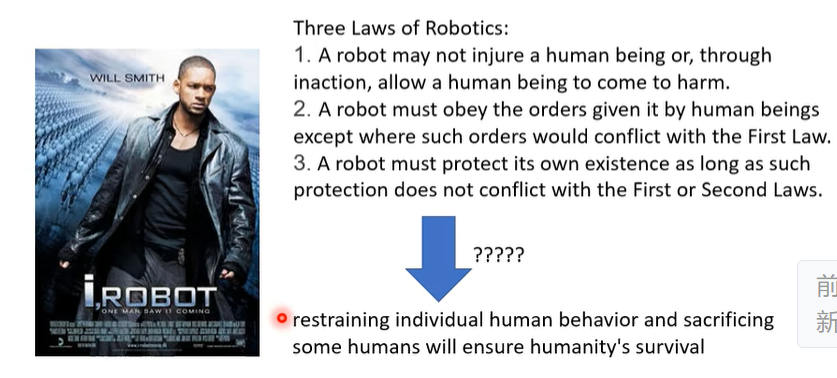

在某些任务中,即使是定义奖励也具有挑战性。手工制作的奖励会导致不受控制的行为。

没有reward的情况可以使用imitation learning

actor可以与环境互动,但奖励功能不可用。

在一些极端的情况下(expert没有遇到过),机器应该怎么做?

代理会复制每一个行为,甚至无关的动作。

Inverse Reinforcement Learning

逆向强化学习会根据expert来反推出奖励方程

简单的reward function不一定会学到简单的actor

假设老师的reward是最好的,但是也不说完全模仿老师。

原则:老师永远是最好的。

基本理念:初始化一个参与者actor,在每次迭代中,演员与环境交互以获得一些轨迹trajectories。

定义一个奖励函数,使教师的轨迹比参与者的轨迹更好。参与者学习根据新的奖励函数最大化奖励。输出奖励函数和从奖励函数中学习到的actor。

actor和GAN里面的generator很像,reward function和discriminator很像。

给机器画面学习: