目录

5. 分布式通信和协调(Communication and Coordination):

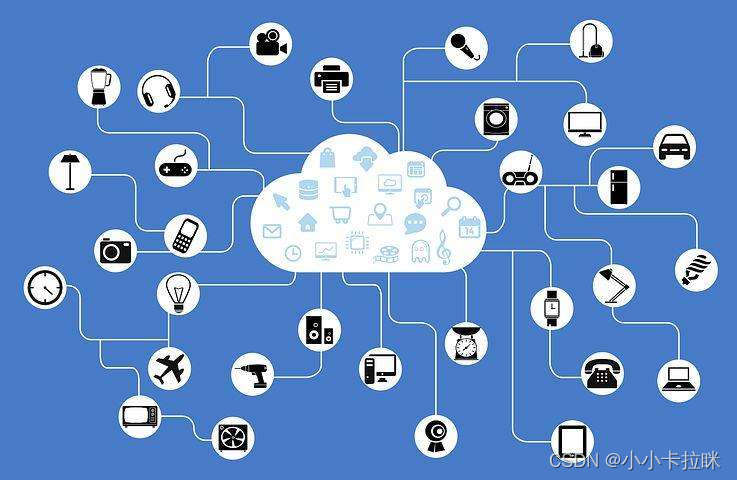

Python爬虫分布式架构是一种强大的工具,可以帮助我们高效地处理大规模的爬取任务和应对高并发的爬取需求。通过将爬虫任务分配到多个节点上执行,并合理地协调节点之间的通信和工作,我们可以实现更快速、并行和可扩展的爬虫系统。

什么是Python爬虫分布式架构

Python爬虫分布式架构是一种将爬虫任务分布到多个节点(机器)上执行的架构设计。传统的单机爬虫通常会受限于机器性能和网络带宽,无法高效地处理大规模爬取任务和满足高并发需求。而分布式爬虫架构通过将任务分担到多个节点上,使得爬取过程更加高效、并行和可扩展。

在Python爬虫分布式架构中,通常包含以下组件:

1. 调度中心(Scheduler):

负责管理爬虫任务队列,将任务分配给可用的爬虫节点,并监控任务状态和进度。

2. 爬虫节点(Crawler Node):

承担实际的爬取任务,从目标网站获取数据。每个爬虫节点可以独立地进行网络请求、解析和数据存储。

3. 数据存储(Data Storage):

用于存储从目标网站爬取的数据,可以是数据库、文件系统、消息队列或其他形式的数据存储和管理系统。

4. 反爬虫处理(Anti-Scraping):

在分布式架构中,反爬虫处理也是很重要的一环。可以在每个爬虫节点上设置合适的请求频率、随机延时、使用代理IP等措施来规避被网站屏蔽或限制的风险。

5. 分布式通信和协调(Communication and Coordination):

爬虫节点之间需要进行通信和协调,以便共享任务信息、状态同步、错误处理等。常用的通信机制可以包括消息队列、分布式队列、任务调度接口等。

使用Python爬虫分布式架构的好处包括提高爬虫的效率、并行爬取多个目标网站、更好地应对高并发场景,以及充分利用计算资源等。然而,分布式爬虫也涉及到任务调度、数据一致性、错误处理、去重等问题,需要一定的架构设计和技术实现。

Python爬虫分布式架构代码示例

下面是一个简单的Python爬虫分布式架构代码示例,使用了Scrapy框架和Redis作为任务队列:

1. 调度中心(scheduler.py):

import redis

# 连接Redis

redis_conn = redis.Redis()

# 从待爬取URL集合中获取任务

def get_task():

task = redis_conn.spop('urls_to_crawl')

if task:

return task.decode('utf-8')

else:

return None

# 将完成的任务标志为已完成

def mark_task_complete(task):

redis_conn.sadd('completed_urls', task)2. 爬虫节点(crawler.py):

import requests

import scheduler

# 爬取函数

def crawl(url):

# 发送HTTP请求获取网页内容

response = requests.get(url)

if response.status_code == 200:

# 解析网页内容并提取数据

data = response.text

# 数据处理和存储

save_data(data)

# 标记任务完成

scheduler.mark_task_complete(url)

# 主循环

while True:

# 获取待爬取的任务

task = scheduler.get_task()

if task:

# 执行爬取任务

crawl(task)

else:

# 当没有任务时休眠一段时间

time.sleep(5)3. 数据存储(data_storage.py):

def save_data(data):

# 进行数据存储操作,可以是数据库存储、文件存储等

pass上述示例代码仅提供了一个简单的框架,实际应用中可能涉及更多的功能和细节,例如错误处理、去重、日志记录、反爬虫处理等。您可以根据具体需求和系统架构进行相应的扩展和改进。此外,还可以结合其他工具和库(例如Celery、RabbitMQ等)来实现更复杂的分布式爬虫架构。

可能会遇到的问题

在Python爬虫分布式架构中,可能会遇到以下一些常见问题:

1. 数据一致性:

由于爬虫任务被分布到多个节点执行,可能导致数据的不一致性,例如多个节点同时爬取同一页面,需要考虑如何处理重复数据或冲突数据的情况。

2. 任务调度和负载均衡:

如何有效地将任务分配给可用的爬虫节点,并进行负载均衡,以确保每个节点的工作量均衡和最大化利用。

3. 系统可靠性和容错性:

在分布式环境下,节点之间的通信和协调可能面临网络故障、节点宕机等问题,需要考虑如何处理节点失效和故障恢复。

4. 反爬虫策略:

目标网站可能会有反爬虫机制,需要注意合适的请求频率、随机延时、使用代理IP等措施,以规避被网站屏蔽或限制的风险。

5. 数据存储和管理:

在多节点的爬取过程中,如何设计合适的数据存储和管理策略,确保数据的完整性、可靠性和高效性。

6. 监控和日志:

分布式爬虫需要进行监控和日志记录,以便及时发现和处理异常情况,并进行性能优化和问题排查。

7. 安全性考虑:

在分布式环境中,需要考虑如何保护敏感数据、防止恶意攻击或未经授权的访问。

这些问题都需要综合考虑,根据具体的爬虫需求和架构设计选择合适的技术和方案来解决。同时,良好的系统设计、错误处理机制和合理的监控手段也是确保分布式爬虫平稳运行的关键。

总结

Python爬虫分布式架构为我们提供了处理大规模爬取任务的解决方案,在高并发场景下具有很大的优势。通过任务调度中心、爬虫节点、数据存储等组件的协作,我们可以更好地管理和执行爬虫任务,并保证数据一致性和系统的可靠性。

然而,在应用分布式爬虫架构时,我们还需注意处理数据一致性、任务调度和负载均衡、系统的容错性和安全性等问题。通过合理的架构设计和技术实现,我们可以构建出高效、稳定和可扩展的爬虫系统,从而更好地满足各种爬虫需求。