前两天,马斯克联合数千名AI科技人员,要求暂停巨型AI实验的新闻,想必大家都知道了。

这个消息挺爆炸,一度加剧了人们的恐慌情绪。

鸣哥当时灵光一闪,这件事ChatGPT是如何看待的?

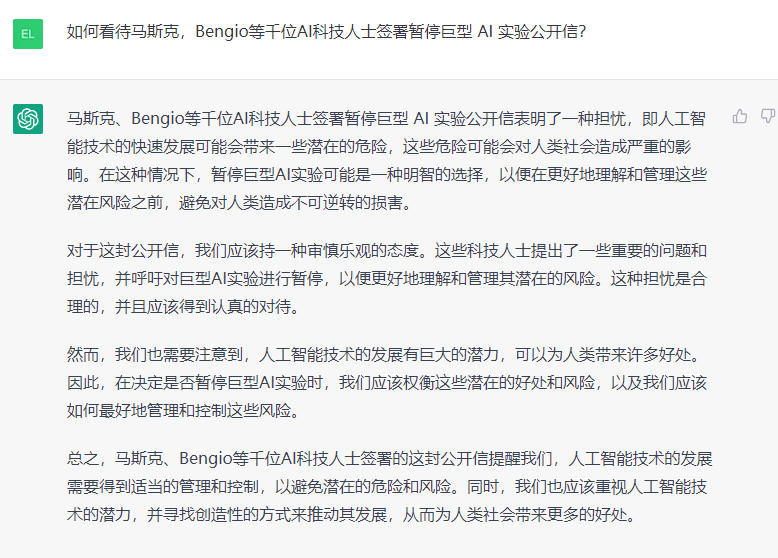

于是我输入这一新闻事件,得到的答复是这样的:

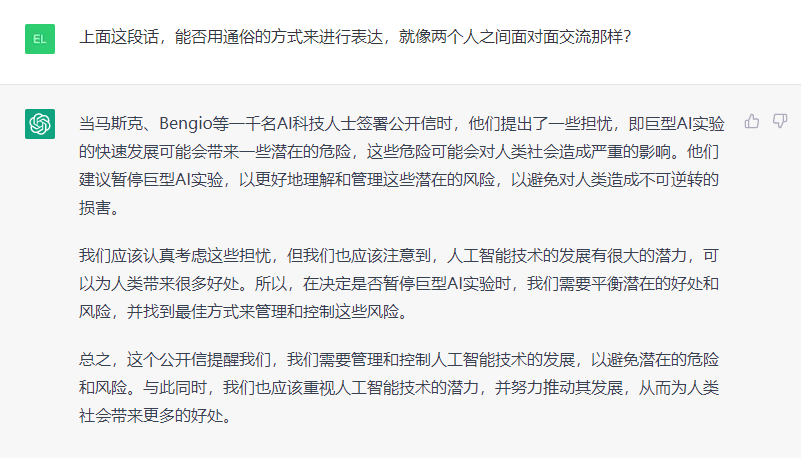

接着我又问,AI的快速发展会带一些怎样的潜在风险,对人类又有什么影响?

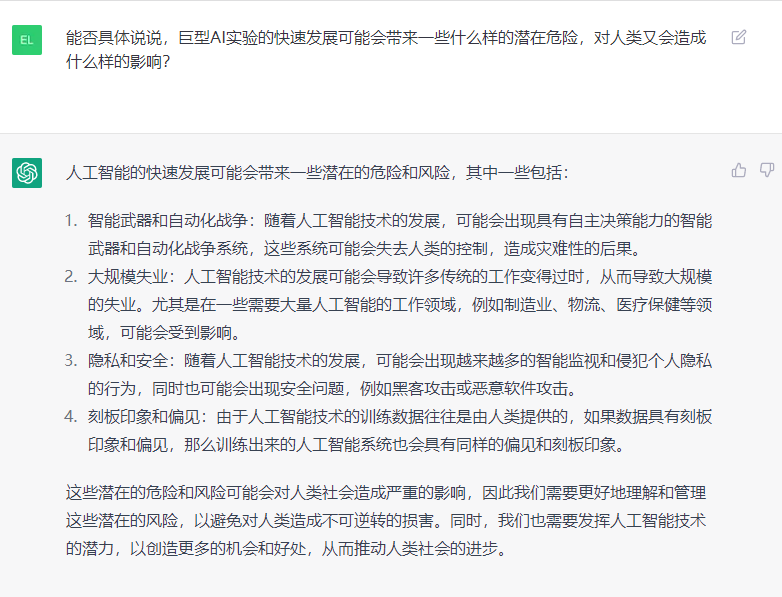

根据ChatGPT的回答,可以总结为以下几点:

第一,可能会出现一些人工智能武器,假如AI形成自我意识,就有可能脱离人类的控制,造成灾难性后果。

第二,AI的快速发展,可能会替代很多岗位,造成大规模失业。

第三,AI的出现可能会威胁个人隐私和安全。

可能你觉得这只会出现在科幻电影里,我只能说,这些场景离我们并不遥远。

鸣哥接触ChatGPT也有一段时间了,一直在摸索尝试,接下来简单分享我对ChatGPT的一些看法。

01

鸣哥接触ChatGPT,最主要的原因是,希望用ChatGPT来进行内容创作。

如果你写过文章,就知道写作真的是一件很痛苦的事。

鸣哥每一篇文章都要保证质量,所以每写一篇文章,都会死不少脑细胞。

所以,我尝试着用ChatGPT来创作内容。

不过,目前来看,ChatGPT创作的内容,还达不到我的公众号文章发布标准。

但是用ChatGPT来写小红书笔记,或者抖音视频脚本,还是很简单的。

并不是说,ChatGPT生成的公众号文章质量不行。

鸣哥认为主要有两个原因。

第一,ChatGPT生成的文章,新闻味太重。

它可以很理性,跟你摆事实讲道理,可以分享硬核干货,但无法调动情绪,不能引起读者共鸣。

现在的自媒体爆款内容,大多有一个共性,那就是能够调动粉丝的情绪。

这一点,目前的ChatGPT还比较欠缺。

当然还有第二个原因,就是我对ChatGPT的调教还不够熟练。

ChatGPT有非常庞大的数据,它可以为你做任何你想做的事。

但前提是,你得让它明白你的目的,知道你具体的需求。

如果你的目的不够明确,ChatGPT就无法get你的具体需求,生成的内容就可能就不是你想要的。

举个栗子,假如你需要去自媒体公司面试,让ChatGPT充当面试官。

你的需求不够清晰,那么ChatGPT可能会问一些超出你能力或者职责之外的问题。

但是,当你把自己的背景信息,投喂给ChatGPT,并且提出了具体的需求。

那么ChatGPT就知道你想干嘛,从而生成你想要的答案。

所以,用好ChatGPT的关键,就是给它投喂准确的背景信息,让它能够理解你到底要做什么。

02

不过,在使用ChatGPT的过程中,我发现ChatGPT对于不熟悉的地方,也会胡编乱造。

比如说,我之前想让ChatGPT帮我总结一下,《人生第二次》具体的内容是什么。

结果,ChatGPT直接告诉我,纪录片《人生第二次》是美国导演的作品。

事实上,这部纪录片是央视拍摄的。

后来我纠正它,然后再次提问。

ChatGPT地回答依然驴唇不对马嘴。

你可能觉得ChatGPT出错了,但我更倾向于认为,ChatGPT学会了说谎。

对于一件它也不确定的事情,就可能会胡乱编造。

如果没有足够的辨别能力,很可能会被误导。

再往里想一层,如果有一天,AI具备自我意识,那么它就可能欺骗人类。

细思极恐。

03

回到知乎这个问题,马斯克联合数千名AI科技人员,签署暂停巨型AI的实验。

很有可能是担心AI发展过快,脱离了人类的控制。

假如,我是说假如,AI真的具备了自我意识的那一天,那么它会不会为了自身的利益而搞事情?

到那时,《黑客帝国》的场景,就不只存在于科幻电影里了。

另外,AI的快速发展,可能会破坏社会秩序,如大量替代人类的工作岗位,引发社会动荡。

在当下,我们并没有做好为ChatGPT到来的准备。

所以,这也能够理解。

既然ChatGPT的能力已经体现,就不能任其发展。

就像核武器一样,需要对ChatGPT进行限制。

比如会成立一堆机构,什么安全委员会、计划委员会等等。

防止出现一些不可控的因素。

04

鸣哥不知道你们怎么想,是接受,恐慌,还是排斥。

但有一点是肯定的。

AI的发展可能会延缓,但绝对阻止不了。

这是时代的趋势。

既然无法改变,唯一能做的,就是正视它,学习它,使用它。

未来已来,做好准备吧!