Linux开发—I/O复用

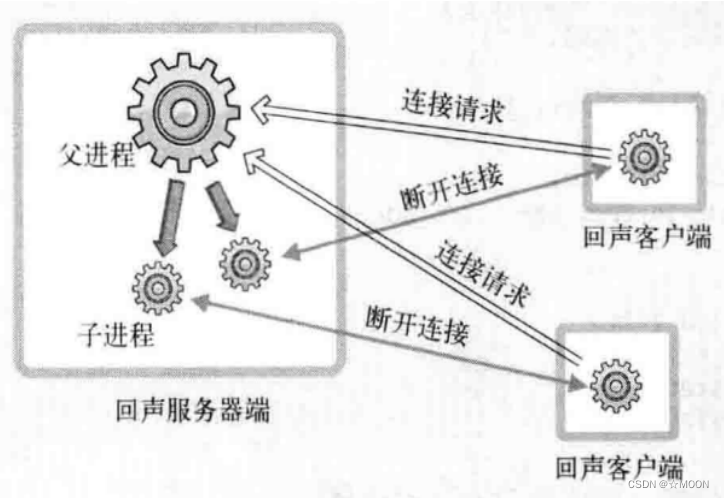

一,背景

多进程服务器的缺点:

- 1,需要大量的运算

- 2,需要大量的内存空间

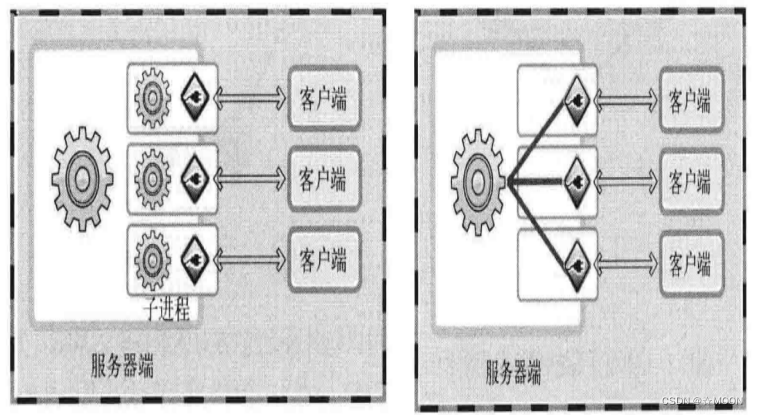

复用技术在服务端的应用:

二,I/O 复用

- 复用的意义:

- 1,提高物理设备的效率

- 2,用最少的物理要素传递最多数据

更多select和epoll比较,个人看了一些别人的贴子,可参考select和epoll比较

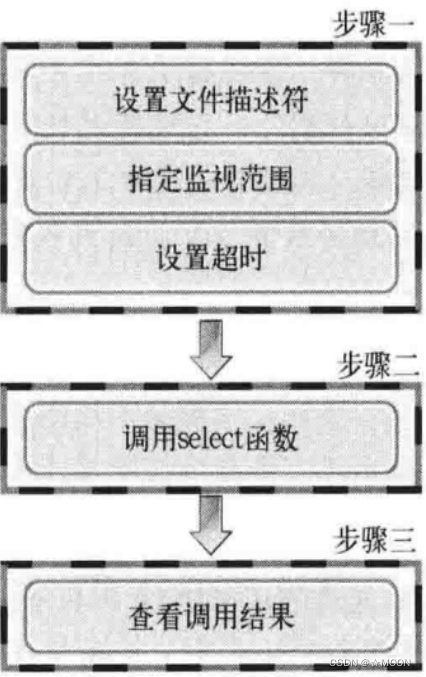

1,Select模型

0,优缺点:

- 优势:单线程可以服务多个客户端。

- 缺点:

- 1,服务客户端的数量有限制,不能超过1024个

- 2,对accept需要轮询监控,连接数量比较大的话对性能的消耗过巨

1,select模型认识:

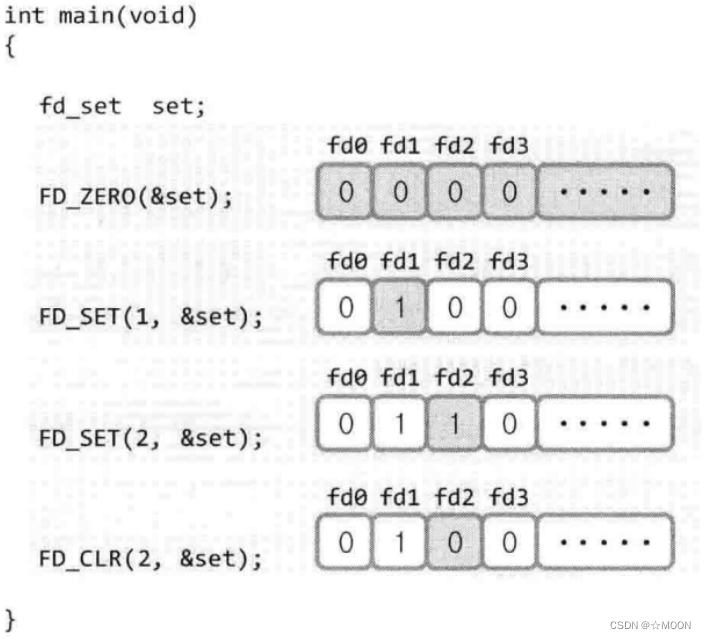

1,fd_set 设置文件描述符:

- select函数监视多个(不超过1024个)文件描述符

- fd_set 结构体

- FD_ZERO(fd set *fdset)∶将fd set变量的所有位初始化为0。

- FD_SET(int fd,fd set*fdset)∶在参数dset指向的变量中注册文件描述符fd的信息。

- FD_CLR(int fd,fd set*fdset)∶从参数fdset指向的变量中清除文件描述符fd的信息。

- FD_ISSET(int fd,fd_set*fdset)∶若参数fdset指向的变量中包含文件描述符fd的信息,则返回"真"。

2,调用select函数:

#include<sys/select.h>

#include <sys/time.h>

int select(int nfds, fd_set*readset, fd_set* writeset, fd_set*exceptset, const struct timeval * timeout);

// →成功时返回大于0的值,失败时返回-1。

- nfds :监视对象文件描述符数量。

- readset:用于检查可读性,

- writeset:用于检查可写性,

- exceptset:用于检查带外数据,

- timeout:一个指向timeval结构的指针,用于决定select等待I/O的最长时间。如果为空将一直等待。

2,select模型实例:

select重点在服务端

void select_cs_connect(char* arg)

{

if (strcmp(arg, "s") == 0)//如果输入s,走服务端路线

{

select_server();

}

else

{

fputs("Please input your name:", stdout);

scanf("%s", name);

select_client();

}

}

1,服务端

//select函数

#include<sys/select.h>

#include <sys/time.h>

void select_server()

{

int serv_sock;

struct sockaddr_in serv_adr;

serv_sock = socket(PF_INET, SOCK_STREAM, 0);

if (serv_sock == -1)

{

printf("create socket error:%d %s\n", errno, strerror(errno));

return;

}

memset(&serv_adr, 0, sizeof(serv_adr));

serv_adr.sin_family = AF_INET;

serv_adr.sin_addr.s_addr = htonl(INADDR_ANY);

serv_adr.sin_port = htons(9527);

if (bind(serv_sock, (struct sockaddr*)&serv_adr, sizeof(serv_adr)) == -1)

{

error_handling("thread server bind error");

printf("bind error msg:%d %s\n", errno, strerror(errno));

return;

}

if (listen(serv_sock, 5) == -1)

{

error_handling("thread server listen error");

printf("listen error msg:%d %s\n", errno, strerror(errno));

return;

}

printf("create server socket success!\n");

int clnt_sock;

struct sockaddr_in clnt_adr;

socklen_t clnt_adr_sz = sizeof(clnt_adr);

fd_set reads, copy_reads;

FD_ZERO(&reads);

FD_SET(serv_sock, &reads);

timeval timeout = {

5, 5000};//设置5.5秒超时,结构体中,第二个参数为微秒结构0.5秒 = 5000000

int fd_max = serv_sock;

while (1)

{

copy_reads = reads;

int fd_num = select(fd_max + 1, ©_reads, NULL, NULL, &timeout);//套接字最大再加1,范围全部覆盖

if (fd_num == -1)

{

printf("select error msg:%d %s\n", errno, strerror(errno));

close(serv_sock);

return;

}

if (fd_num == 0) continue;

printf("fd_num is:%d\n",fd_num);

//轮询

for (int i = 0; i < fd_max + 1; i++)

{

if (FD_ISSET(i, ©_reads))

{

if (i == serv_sock) // connection request!

{

clnt_sock =

accept(serv_sock, (struct sockaddr*)&clnt_adr, &clnt_adr_sz);

FD_SET(clnt_sock, &reads);

if (fd_max < clnt_sock)

fd_max = clnt_sock;

printf("connected client: %d \n", clnt_sock);

}

else // read message!

{

char buf[256] = "";

ssize_t str_len = read(i, buf, BUF_SIZE);

if (str_len == 0) // close request!

{

FD_CLR(i, &reads);

close(i);

printf("closed client: %d \n", i);

}

else

{

write(i, buf, str_len); // echo!

}

}

}

}

}

close(serv_sock);

}

2,客户端

// 客户端 发送消息

char name[64] = "[MOON]";

void* client_send_msg(void* arg)

{

pthread_detach(pthread_self());

int clnt_sock = *(int*)arg;//取出当前线程的socket

char msg[256] = "";

char buffer[1024];

while (1)

{

memset(buffer, 0, sizeof(buffer));

fgets(msg, sizeof(msg), stdin);//对文件的标准输入流操作 读取buffer的256字节

if (strcmp(msg, "q\n") == 0 || (strcmp(msg, "Q\n") == 0)) {

break;

}

if (strcmp(msg, "") == 0)

{

continue;

}

snprintf(buffer, sizeof(buffer), "%s: %s", name, msg);

size_t len = strlen(buffer);

size_t send_len = 0;

//当数据量很大时,并不能一次把所有数据全部发送完,因此需要分包发送

while (send_len < len)

{

ssize_t ret = write(clnt_sock, buffer + send_len, len - send_len);//send_len 记录分包的标记

if (ret <= 0) {

//连接出了问题

fputs("may be connect newwork failed,make client write failed!\n", stdout);

break;

}

send_len += (size_t)ret;

}

};

sem_post(&semid);

pthread_exit(NULL);

}

//客户端-接收消息

void* client_recv_msg(void* arg)

{

pthread_detach(pthread_self());

int clnt_sock = *(int*)arg;//取出当前线程的socket

char buffer[1024] = "";

while (1)

{

size_t ret = read(clnt_sock, buffer, sizeof(buffer));

if (ret <= 0) {

//连接出了问题

fputs("client read failed!\n", stdout);

break;

}

fputs(buffer, stdout);

memset(buffer, 0, ret);//处理完消息及时重置内存

};

sem_post(&semid);

pthread_exit(NULL);

}

void select_client()

{

struct sockaddr_in clnt_adr;

socklen_t clnt_adr_sz = sizeof(clnt_adr);

int clnt_sock = socket(PF_INET, SOCK_STREAM, 0);

memset(&clnt_adr, 0, clnt_adr_sz);

clnt_adr.sin_family = AF_INET;

clnt_adr.sin_addr.s_addr = inet_addr("127.0.0.1");

clnt_adr.sin_port = htons(9527);

if (connect(clnt_sock, (struct sockaddr*)&clnt_adr, clnt_adr_sz) == -1)

{

printf("connect error msg:%d %s\n", errno, strerror(errno));

return;

}

pthread_t thread_send, thread_recv;

sem_init(&semid, 0, -1);

pthread_create(&thread_send, NULL, client_send_msg, &clnt_sock);//消息clnt_sock为局部变量

pthread_create(&thread_recv, NULL, client_recv_msg, &clnt_sock);//消息clnt_sock为局部变量

sem_wait(&semid);

close(clnt_sock);

}

2,Epoll模型

- 解决select模型的缺点(select轮询设备耗费性能和连接设备数量有限的问题)

- Select模型的缺点:

- 调用select函数后常见的针对所有文件描述符的循环语句如果很多非活跃的用户的话select效率比较低,如果活跃用户多的话select效率比epoll高一些。

每次调用select函数时都需要向该函数传递监视对象信息。 - 调用select 函数后,并不是把发生变化的文件描述符单独集中到一起,而是通过观察作为监视对象的fd_set变量的变化,找出发生变化的文件描述符,因此无法避免针对所有监视对象的循环语句。而且,作为监视对象的fd_set变量会发生变化,所以调用select函数前应复制并保存原有信息,并在每次调用select函数时传递新的监视对象信息。

- 调用select函数后常见的针对所有文件描述符的循环语句如果很多非活跃的用户的话select效率比较低,如果活跃用户多的话select效率比epoll高一些。

- 解决方案:

- “向操作系统传递1次监视对象,监视范围或内容发生变化只通知发生变化的事项。”

这样就无需每次调用select函数时都向操作系统传递监视对象信息,但前提是操作系统支持这种处理方式(每种操作系统支持的程度和方式存在差异)。Linux的支持方式是epoll,Windows 的支持方式是IOCP。epoll这个是Linux独有的函数。

- “向操作系统传递1次监视对象,监视范围或内容发生变化只通知发生变化的事项。”

1,Epoll模型认识

Epoll的三大函数:epoll_create,epoll_wait, epoll_ctl

1,epoll_create

#include<sys/epoll.h>

int epoll_create(int size);

//→成功时返回epoll文件描述符,失败时返回-1。

- size:epoll实例的大小。

该函数从2.3.2版本的开始加入的,2.6版开始引入内核

Linux最新的内核稳定版本已经到了5.8.14,长期支持版本到了5.4.70

从2.6.8内核开始的Linux,会忽略这个参数,但是必须要大于0

这个是Linux独有的函数

2,epoll_ctl

#include<sys/epoll.h>

int epoll_ctl(int epfd, int op, int fd, struct epoll_event* event);

//→成功时返回0,失败时返回-1。

- epfd 用于注册监视对象的epoll例程的文件描述符。

- op 用于指定监视对象的添加、删除或更改等操作。

- EPOLL_CTL_ADD 增加

- EPOLL_CTL_MOD 修改

- EPOLL_CTL_DEL 删除

- fd 需要注册的监视对象文件描述符。

- event 监视对象的事件类型。

- EPOLLIN∶需要读取数据的情况。

- EPOLLOUT∶输出缓冲为空,可以立即发送数据的情况。

- EPOLLPRI∶收到OOB数据的情况。

- EPOLLRDHUP∶断开连接或半关闭的情况,这在边缘触发方式下非常有用。

- EPOLLERR∶发生错误的情况。

- EPOLLET∶以边缘触发的方式得到事件通知。

- EPOLLONESHOT∶发生一次事件后,相应文件描述符不再收到事件通知。因此需要向 epoll_ctl 函数的第二个参数传递 EPOLLCTL_MOD,再次设置事件。

3,epoll_wait:

#include <sys/epoll.h>

int epoll_wait(int epfd, struct epoll_event*events,int maxevents,int timeout);

//→成功时返回发生事件的文件描述符数,失败时返回-1。

- epfd 表示事件发生监视范围的epol例程的文件描述符

- events 保存发生事件的文件描述符集合的结构体地址值。

- maxevents 第二个参数中可以保存的最大事件数目。

- Timeout:以1/1000秒为单位的等待时间,传递-1时,一直等待直到发生事件。

2,Epoll模型实例

1,服务端

// epoll模型

#include <sys/epoll.h>

void epoll_server()

{

int serv_sock;

struct sockaddr_in serv_adr;

serv_sock = socket(PF_INET, SOCK_STREAM, 0);

if (serv_sock == -1)

{

printf("create socket error:%d %s\n", errno, strerror(errno));

close(serv_sock);

return;

}

memset(&serv_adr, 0, sizeof(serv_adr));

serv_adr.sin_family = AF_INET;

serv_adr.sin_addr.s_addr = htonl(INADDR_ANY);

serv_adr.sin_port = htons(9527);

if (bind(serv_sock, (struct sockaddr*)&serv_adr, sizeof(serv_adr)) == -1)

{

error_handling("thread server bind error");

printf("bind error msg:%d %s\n", errno, strerror(errno));

close(serv_sock);

return;

}

if (listen(serv_sock, 5) == -1)

{

error_handling("thread server listen error");

printf("listen error msg:%d %s\n", errno, strerror(errno));

close(serv_sock);

return;

}

printf("create server socket success!\n");

int clnt_sock;

struct sockaddr_in clnt_adr;

socklen_t clnt_adr_sz = sizeof(clnt_adr);

epoll_event event;

int event_cnt;

int epfd = epoll_create(1);

if (epfd == -1)

{

printf("epoll_create error msg:%d %s\n", errno, strerror(errno));

close(serv_sock);

return;

}

epoll_event* all_events = new epoll_event[100];

event.events = EPOLLIN;

event.data.fd = serv_sock;

epoll_ctl(epfd, EPOLL_CTL_ADD, serv_sock, &event);

while (true)

{

event_cnt = epoll_wait(epfd, all_events, 100, 1000);//1000:等待1秒

if (event_cnt == -1)

printf("epoll_wait error msg:%d %s\n", errno, strerror(errno));

break;

if (event_cnt == 0)continue;

for (int i = 0; i < event_cnt; i++)

{

int event_data_fd = all_events[i].data.fd;

if (event_data_fd == serv_sock) {

clnt_sock = accept(serv_sock, (sockaddr*)&clnt_adr, &clnt_adr_sz);

event.events = EPOLLIN;

event.data.fd = clnt_sock;

epoll_ctl(epfd, EPOLL_CTL_ADD, clnt_sock, &event);

printf("client is connect success! %d\n", clnt_sock);

}

else

{

char buf[256] = "";

ssize_t str_len = read(event_data_fd, buf, sizeof(buf));

if (str_len <= 0) // close request!

{

epoll_ctl(epfd, EPOLL_CTL_DEL, event_data_fd, NULL);

close(event_data_fd);

printf("closed client: %d \n", i);

}

else

{

write(event_data_fd, buf, str_len); // echo!

}

}

}

}

delete[] all_events;

close(serv_sock);

close(epfd);

}

void epoll_cs_connect(char* arg)

{

if (strcmp(arg, "s") == 0)//如果输入s,走服务端路线

{

epoll_server();

}

else

{

fputs("Please input your name:", stdout);

scanf("%s", name);

select_client();

}

}

2,客户端

- 客户端代码逻辑同select模型实例中的客户端代码。

3,边缘触发与条件触发

1,定义

-

条件触发(level-triggered,也被称为水平触发)LT:

只要满足条件,就触发一个事件(只要有数据没有被获取,内核就不断通知你) -

边缘触发(edge-triggered)ET:

每当状态变化时,触发一个事件

“举个读socket的例子,假定经过长时间的沉默后,现在来了100个字节,这时无论边缘触发和条件触发都会产生一个通知应用程序可读。应用程序读了50个字节,然后重新调用api等待io事件。

这时水平触发的api会因为还有50个字节可读从而立即返回用户一个read ready notification。

而边缘触发的api会因为可读这个状态没有发生变化而陷入长期等待。 因此在使用边缘触发的api时,要注意每次都要读到socket返回EWOULDBLOCK为止,否则这个socket就算废了。而使用条件触发的api 时,如果应用程序不需要写就不要关注socket可写的事件,否则就会无限次的立即返回一个write ready notification。 -

select属于典型的条件触发。

-

epoll中如果设置events为EPOLLET则为边缘触发

2,epoll边缘触发案例:

边缘触发:

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <unistd.h>

#include <fcntl.h>

#include <errno.h>

#include <arpa/inet.h>

#include <sys/socket.h>

#include <sys/epoll.h>

#define BUF_SIZE 4

#define EPOLL_SIZE 50

void setnonblockingmode(int fd);

void error_handling(char *buf);

int main(int argc, char *argv[])

{

int serv_sock, clnt_sock;

struct sockaddr_in serv_adr, clnt_adr;

socklen_t adr_sz;

int str_len, i;

char buf[BUF_SIZE];

struct epoll_event *ep_events;

struct epoll_event event;

int epfd, event_cnt;

if(argc!=2) {

printf("Usage : %s <port>\n", argv[0]);

exit(1);

}

serv_sock=socket(PF_INET, SOCK_STREAM, 0);

memset(&serv_adr, 0, sizeof(serv_adr));

serv_adr.sin_family=AF_INET;

serv_adr.sin_addr.s_addr=htonl(INADDR_ANY);

serv_adr.sin_port=htons(atoi(argv[1]));

if(bind(serv_sock, (struct sockaddr*) &serv_adr, sizeof(serv_adr))==-1)

error_handling("bind() error");

if(listen(serv_sock, 5)==-1)

error_handling("listen() error");

epfd=epoll_create(EPOLL_SIZE);

ep_events=malloc(sizeof(struct epoll_event)*EPOLL_SIZE);

setnonblockingmode(serv_sock);

event.events=EPOLLIN;

event.data.fd=serv_sock;

epoll_ctl(epfd, EPOLL_CTL_ADD, serv_sock, &event);

while(1)

{

event_cnt=epoll_wait(epfd, ep_events, EPOLL_SIZE, -1);

if(event_cnt==-1)

{

puts("epoll_wait() error");

break;

}

puts("return epoll_wait");

for(i=0; i<event_cnt; i++)

{

if(ep_events[i].data.fd==serv_sock)

{

adr_sz=sizeof(clnt_adr);

clnt_sock=accept(serv_sock, (struct sockaddr*)&clnt_adr, &adr_sz);

setnonblockingmode(clnt_sock);

event.events=EPOLLIN|EPOLLET;

event.data.fd=clnt_sock;

epoll_ctl(epfd, EPOLL_CTL_ADD, clnt_sock, &event);

printf("connected client: %d \n", clnt_sock);

}

else

{

while(1)

{

str_len=read(ep_events[i].data.fd, buf, BUF_SIZE);

if(str_len==0) // close request!

{

epoll_ctl(epfd, EPOLL_CTL_DEL, ep_events[i].data.fd, NULL);

close(ep_events[i].data.fd);

printf("closed client: %d \n", ep_events[i].data.fd);

break;

}

else if(str_len<0)

{

if(errno==EAGAIN)

break;

}

else

{

write(ep_events[i].data.fd, buf, str_len); // echo!

}

}

}

}

}

close(serv_sock);

close(epfd);

return 0;

}

void setnonblockingmode(int fd)

{

int flag=fcntl(fd, F_GETFL, 0);

fcntl(fd, F_SETFL, flag|O_NONBLOCK);

}

void error_handling(char *buf)

{

fputs(buf, stderr);

fputc('\n', stderr);

exit(1);

}