1.为什么要使用代理IP?

默认爬虫时使用的是真实IP,为了伪装真实IP,使用代理IP。

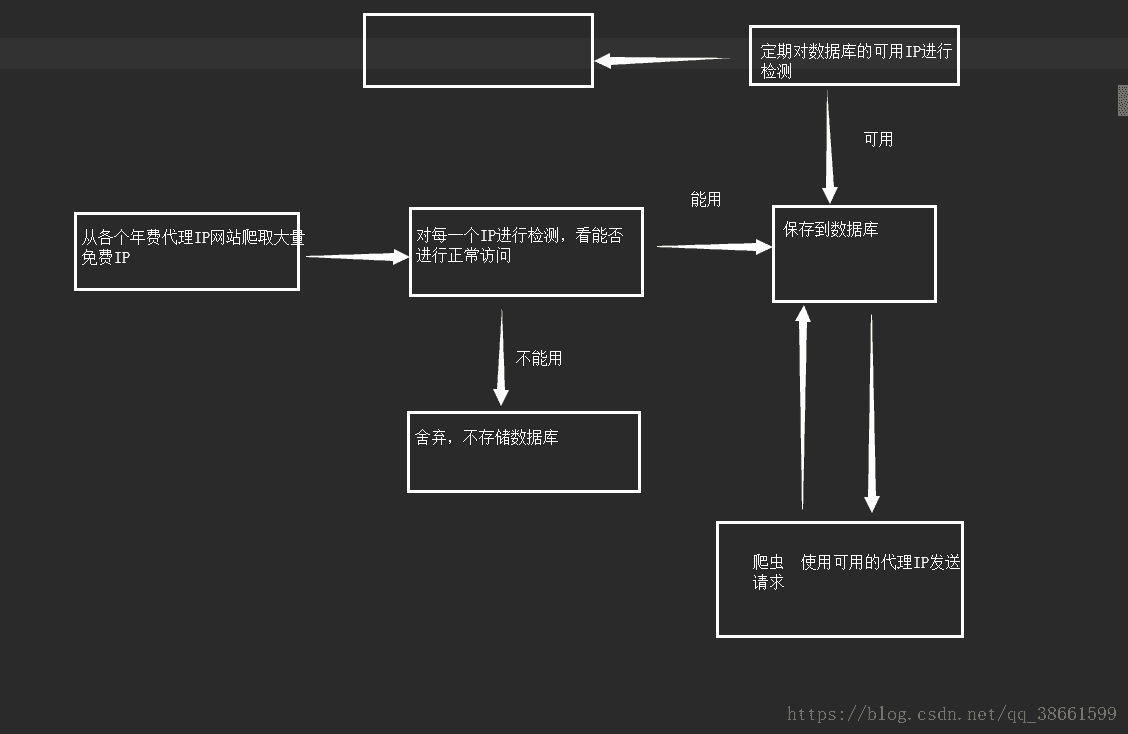

2.看图理解代理IP

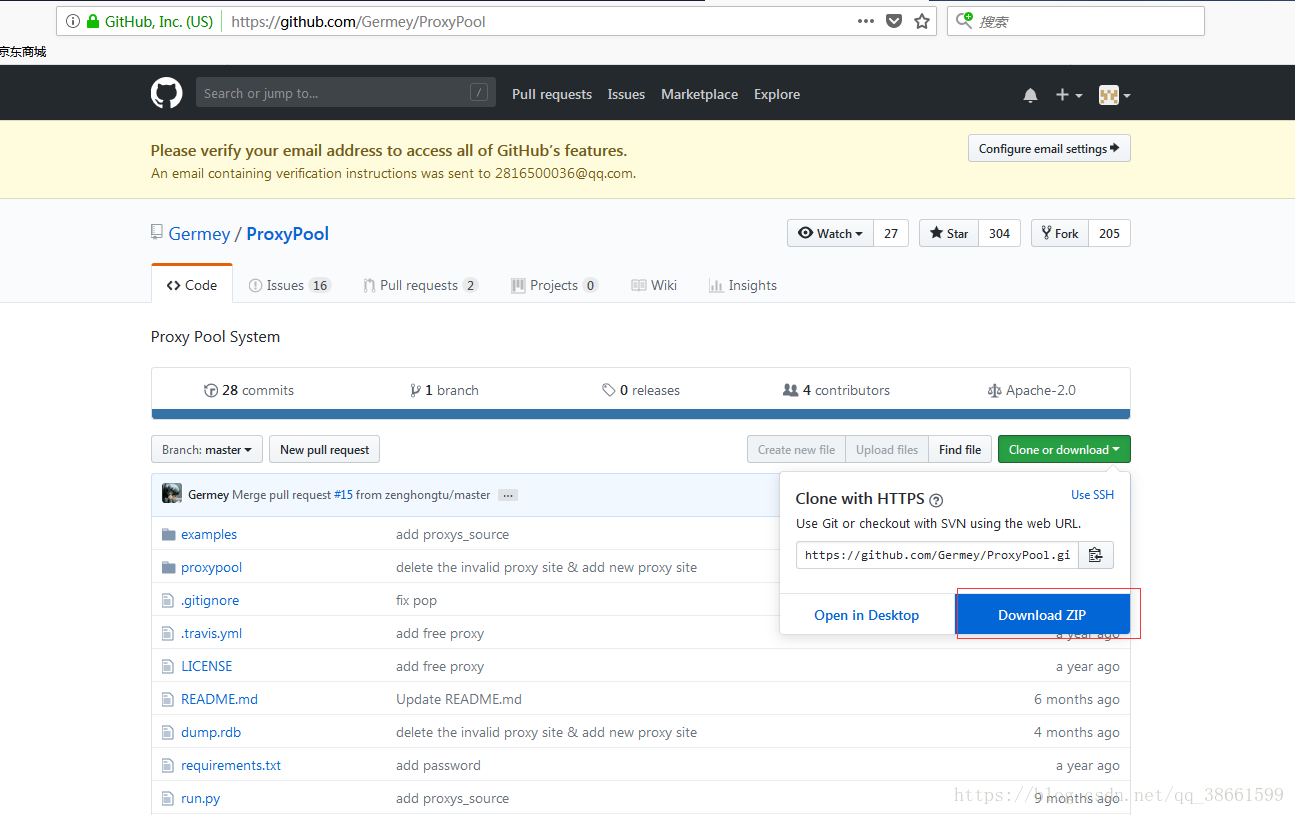

3.下载安装ProxyPool

下载地址:

https://github.com/Germey/ProxyPool

点击"Clone or download",选择"Download ZIP"

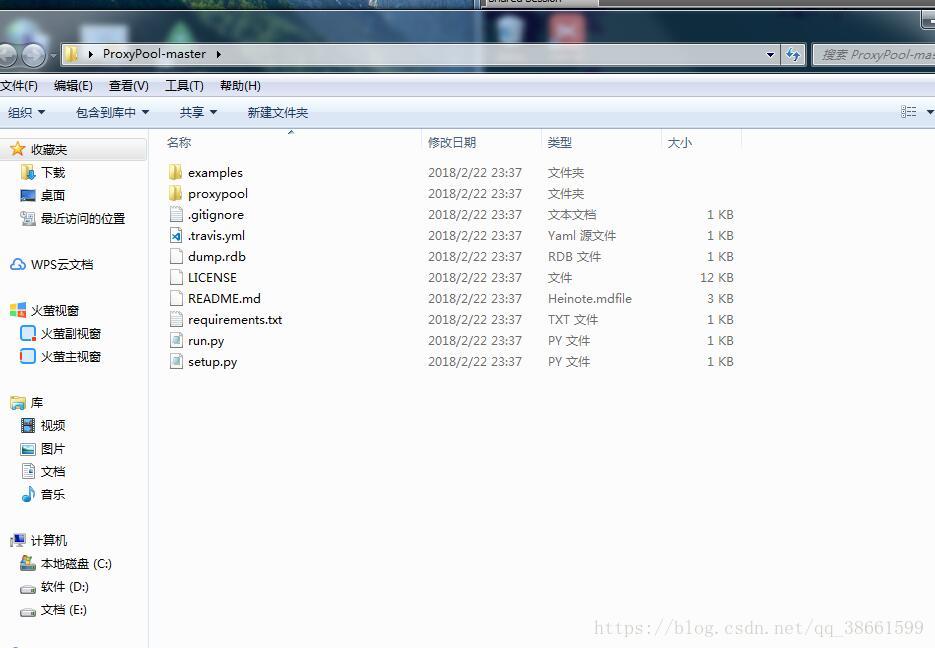

解压后看到有这一堆即为下载成功

4.安装Redis

下载地址:https://redis.io/download

安装好之后将Redis服务开启

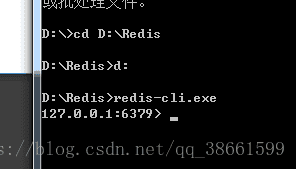

在黑窗口中输入命令进入到Redis的安装位置中,就拿D盘来说

输入命令: redis-cli.exe 将Redis服务连接

5.安装依赖

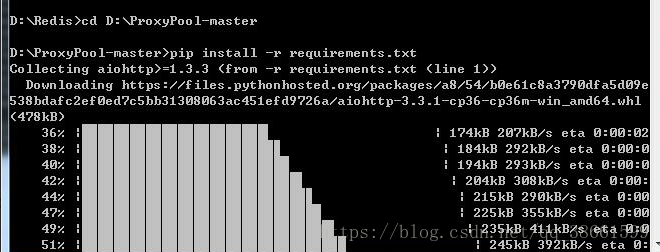

进入到ProxyPool-master文件夹中,然后敲命令"pip3 install -r requirements.txt"即可

6.打开代理池和API

输入命令:python run.py后发现有错误:没有一个叫fake_useragent的模块

只需安装一下即可,输入命令:pip install fake_useragent安装后,再输入命令python run.py

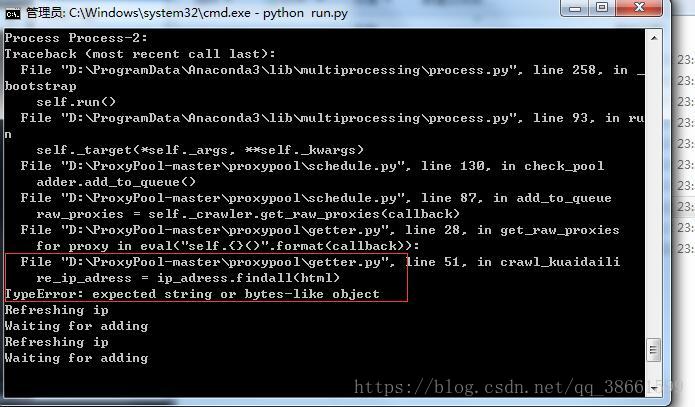

不幸的是又报错了!

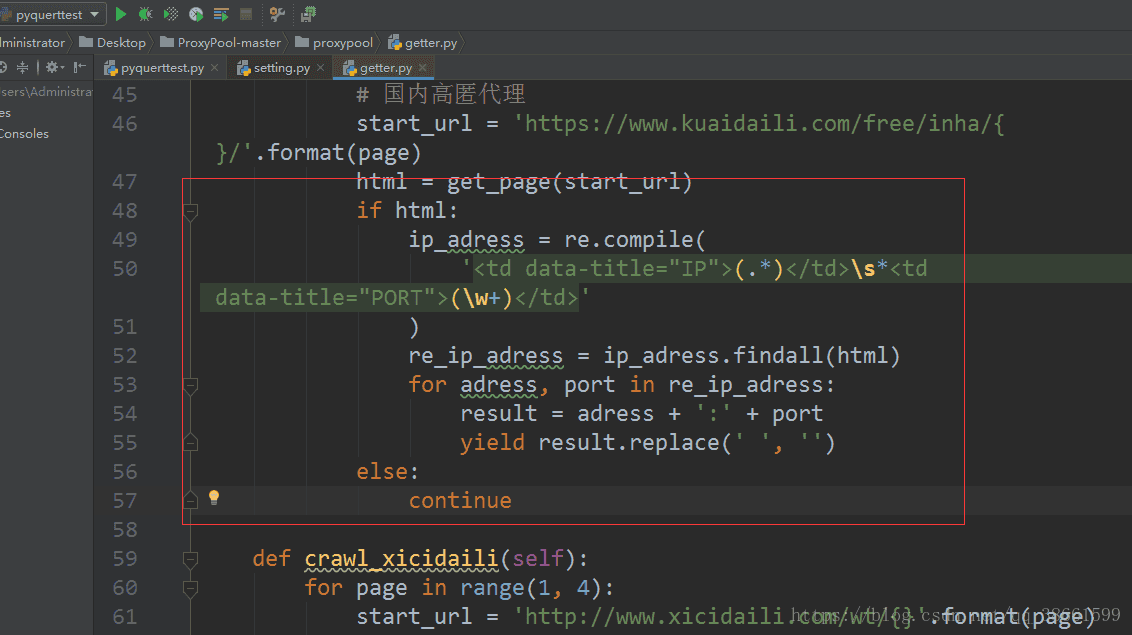

不用慌,根据错误提示找到getter.py的51行,添加if...else..修改一下即可

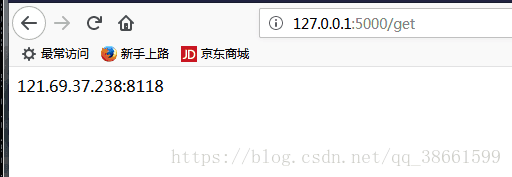

再输入python run.py,然后去浏览器上输入127.0.0.1:5000/get刷新,出现IP即可

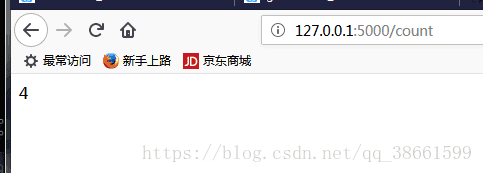

也可输入:127.0.0.1:5000/count 查看可用的IP的数量(每次刷新,可能不同)

7.获取代理(必须保证黑窗口在开着)

利用requests获取方法如下

import requests

PROXY_POOL_URL = 'http://localhost:5000/get'

def get_proxy():

try:

response = requests.get(PROXY_POOL_URL)

if response.status_code == 200:

return response.text

except ConnectionError:

return None

黑窗口不动的时候

按回车-->Refreshing ip

按回车-->Refreshing ip