上篇:Nacos 配置中心

目录

Sentinel 介绍(官方介绍)

Sentinel是⼀个面向云原生微服务的流量控制、熔断降级组件。替代Hystrix,针对问题:服务雪崩、服务降级、服务熔断、服务限流

Hystrix:

服务消费者—>调用服务提供者

在调用方引⼊Hystrix—> 单独搞了⼀个Dashboard项目—>Turbine

1)自己搭建监控平台 dashboard

2)没有提供UI界面进行服务熔断、服务降级等配置(而是写代码,入侵了我们源程序环境)

Sentinel:

1)独立可部署Dashboard/控制台组件

2)减少代码开发,通过UI界面配置即可完成细粒度控制(投递微服务)

Sentinel 具有以下特征:

丰富的应用场景: Sentinel 承接了阿里巴巴近 10 年的双十一大促流量的核心场景,例如秒杀(即突发流量控制在系统容量可以承受的范围)、消息削峰填谷、实时熔断下游不可用应用等。

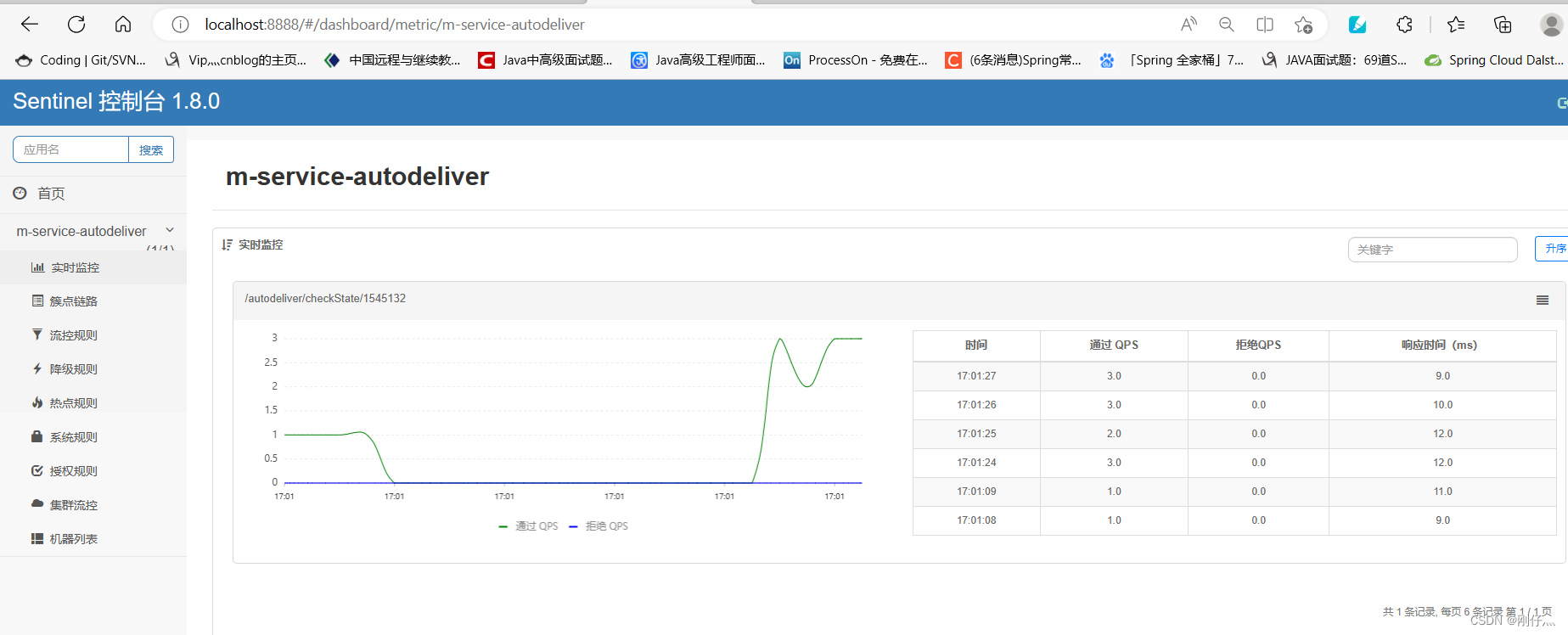

完备的实时监控: Sentinel 同时提供实时的监控功能。您可以在控制台中看到接入应用的单台机器秒级数据,甚至 500 台以下规模的集群的汇总运行情况。

广泛的开源生态: Sentinel 提供开箱即用的与其它开源框架/库的整合模块,例如与 Spring Cloud、Dubbo、gRPC 的整合。您只需要引入相应的依赖并进行简单的配置即可快速地接入 Sentinel。

完善的 SPI 扩展点: Sentinel 提供简单易用、完善的 SPI 扩展点。您可以通过实现扩展点,快速的定制逻辑。例如定制规则管理、适配数据源等。

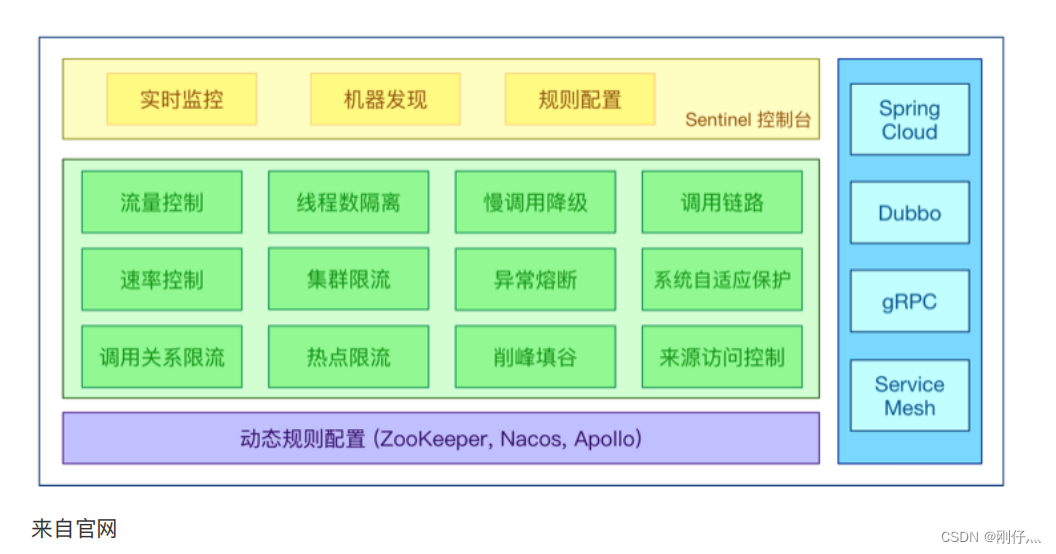

Sentinel 的主要特性:

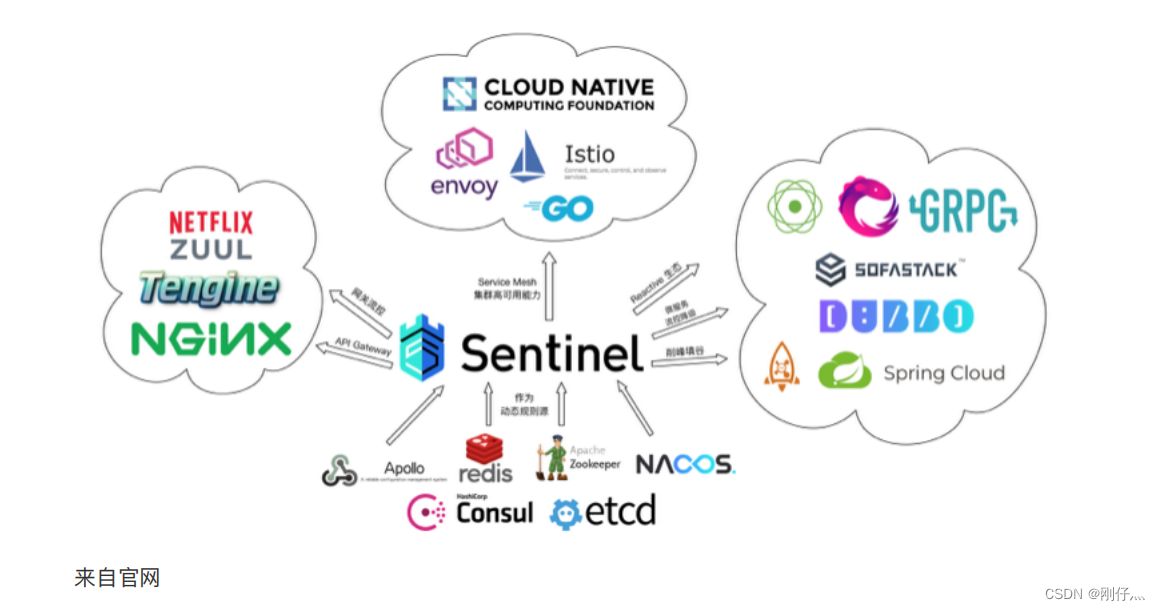

Sentinel 的开源生态:

Sentinel 部署

下载地址:https://github.com/alibaba/Sentinel/releases 我们使用v1.8.0

启动:java -jar sentinel-dashboard-1.8.0.jar &

⽤户名/密码:sentinel/sentinel

服务改造

- 消费者服务

lagou-service-autodeliver-8094-sentinel

- 依赖

<dependencies>

<!--sentinel 核⼼环境 依赖-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-sentinel</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

<!-- <dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-config</artifactId>

</dependency>-->

</dependencies>

- 配置

server:

port: 8094

spring:

application:

name: m-service-autodeliver

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848,127.0.0.1:8849,127.0.0.1:8850

sentinel:

transport:

dashboard: 127.0.0.1:8888

port: 8719

#针对的被调⽤⽅微服务名称,不加就是全局⽣效

m-service-autodeliver:

ribbon:

#请求连接超时时间

ConnectTimeout: 2000

#请求处理超时时间

ReadTimeout: 5000

#对所有操作都进⾏重试

OkToRetryOnAllOperations: true

####根据如上配置,当访问到故障请求的时候,它会再尝试访问⼀次当前实例(次数由MaxAutoRetries配置),

####如果不⾏,就换⼀个实例进⾏访问,如果还不⾏,再换⼀次实例访问(更换次数由MaxAutoRetriesNextServer配置),

####如果依然不⾏,返回失败信息。

MaxAutoRetries: 0 #对当前选中实例重试次数,不包括第⼀次调⽤

MaxAutoRetriesNextServer: 0 #切换实例的重试次数

NFLoadBalancerRuleClassName: com.netflix.loadbalancer.RoundRobinRule #负载策略调整

# 暴露健康接⼝的细节

management:

endpoints:

web:

exposure:

include: "*"

endpoint:

health:

show-details: always

#负载策略调整

logging:

level:

# Feign⽇志只会对⽇志级别为debug的做出响应

com.w.edu.service.ResumeServiceFeignClientFallback: debug

-

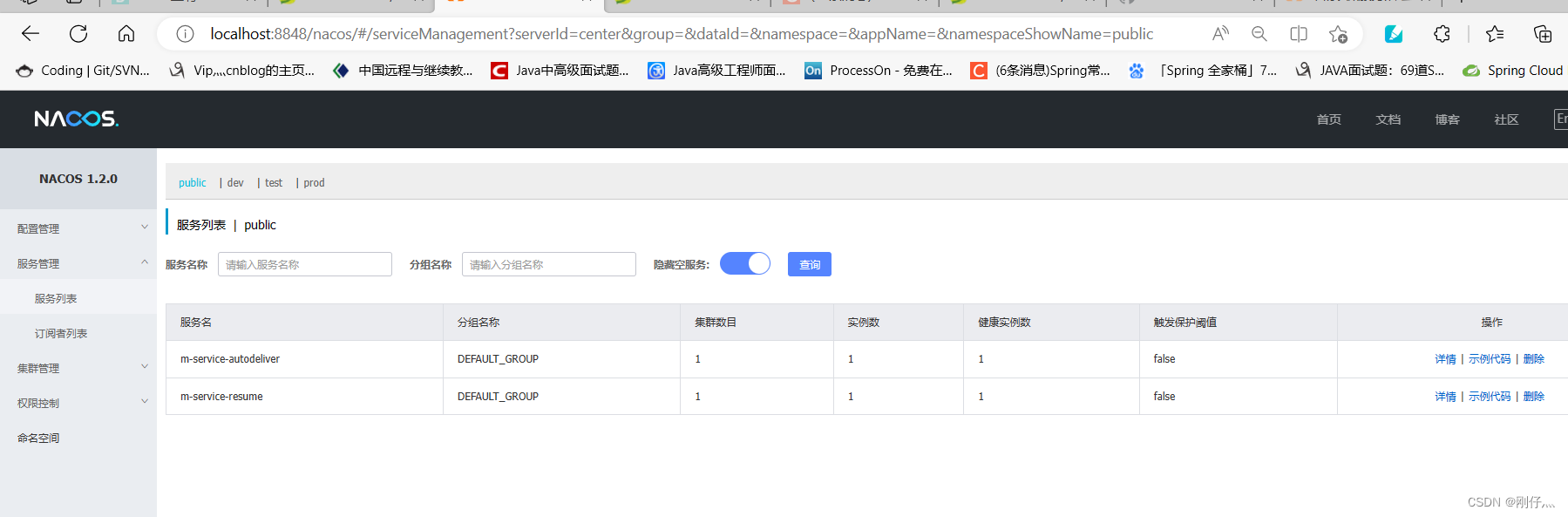

nacos集群

-

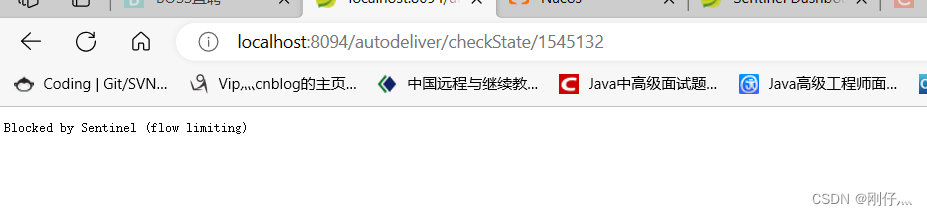

多次访问接口http:http://localhost:8094/autodeliver/checkState/1545132 观察Sentinel 控制台

Sentinel 关键概念

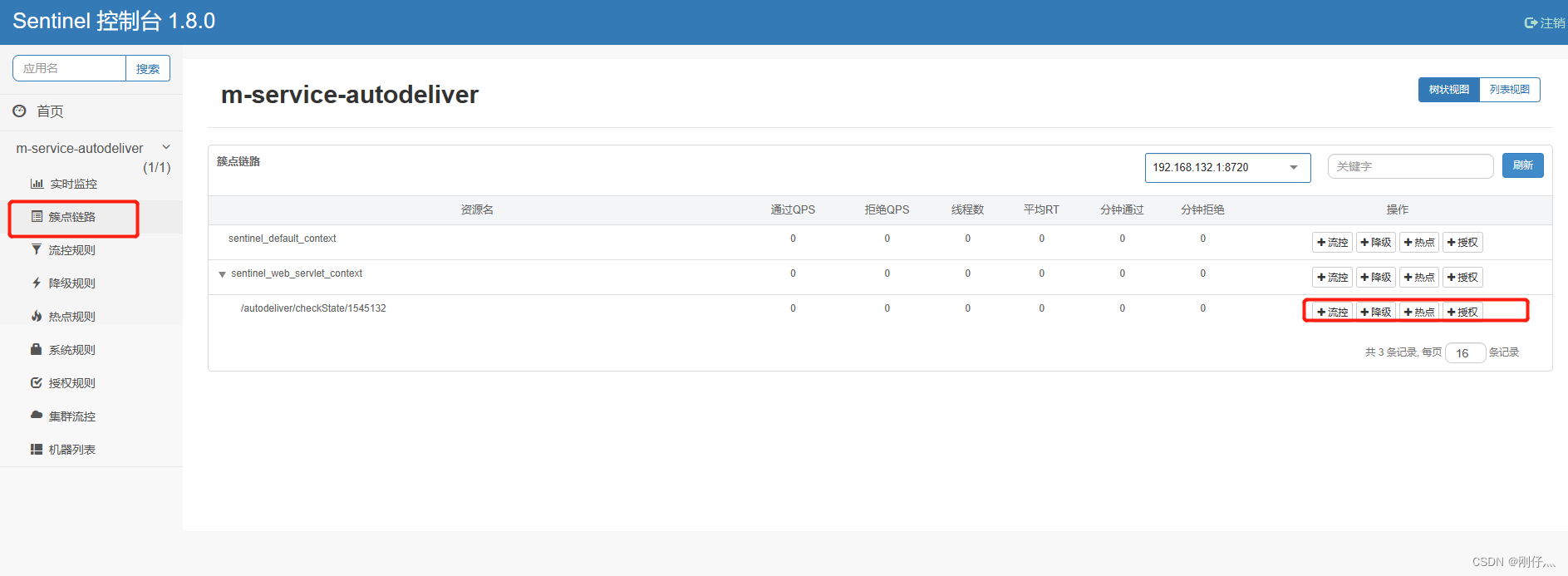

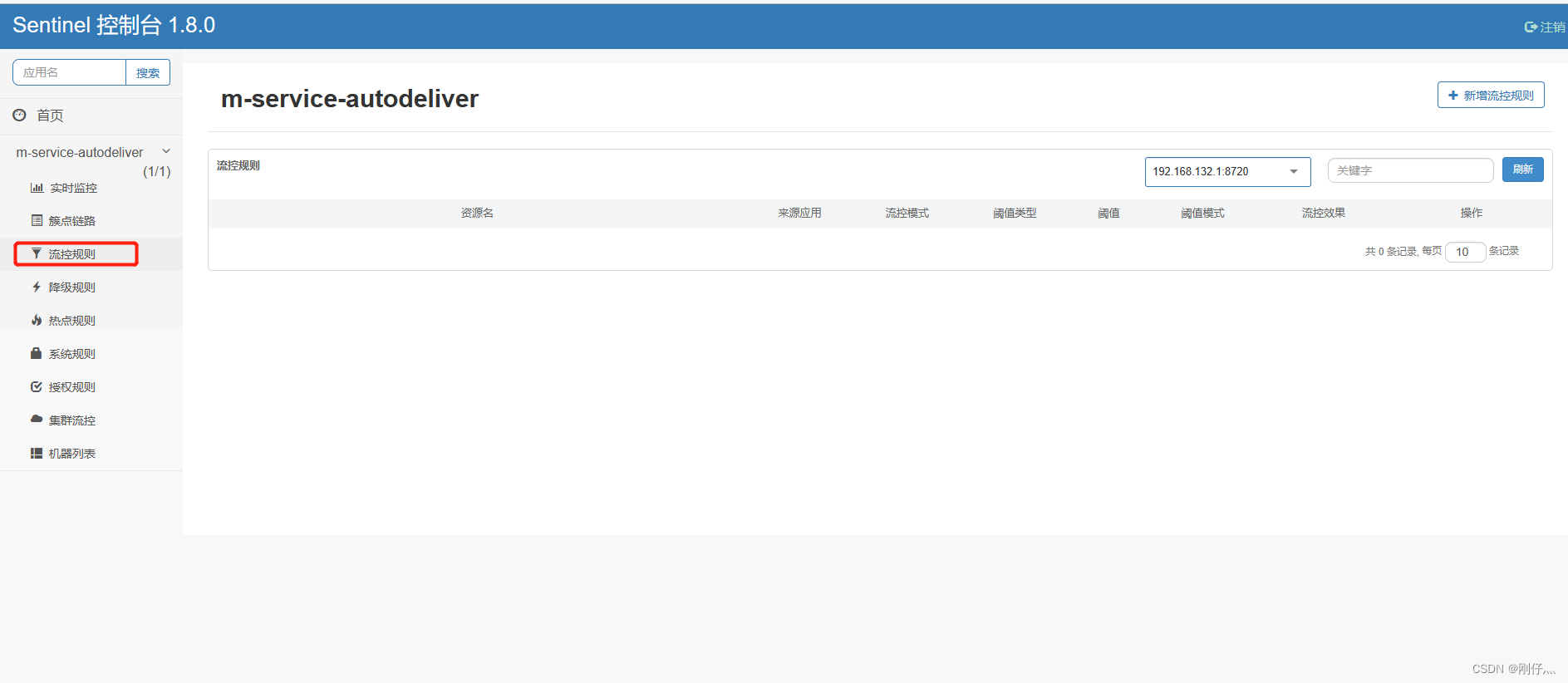

流控规则-簇点链路、流控规则

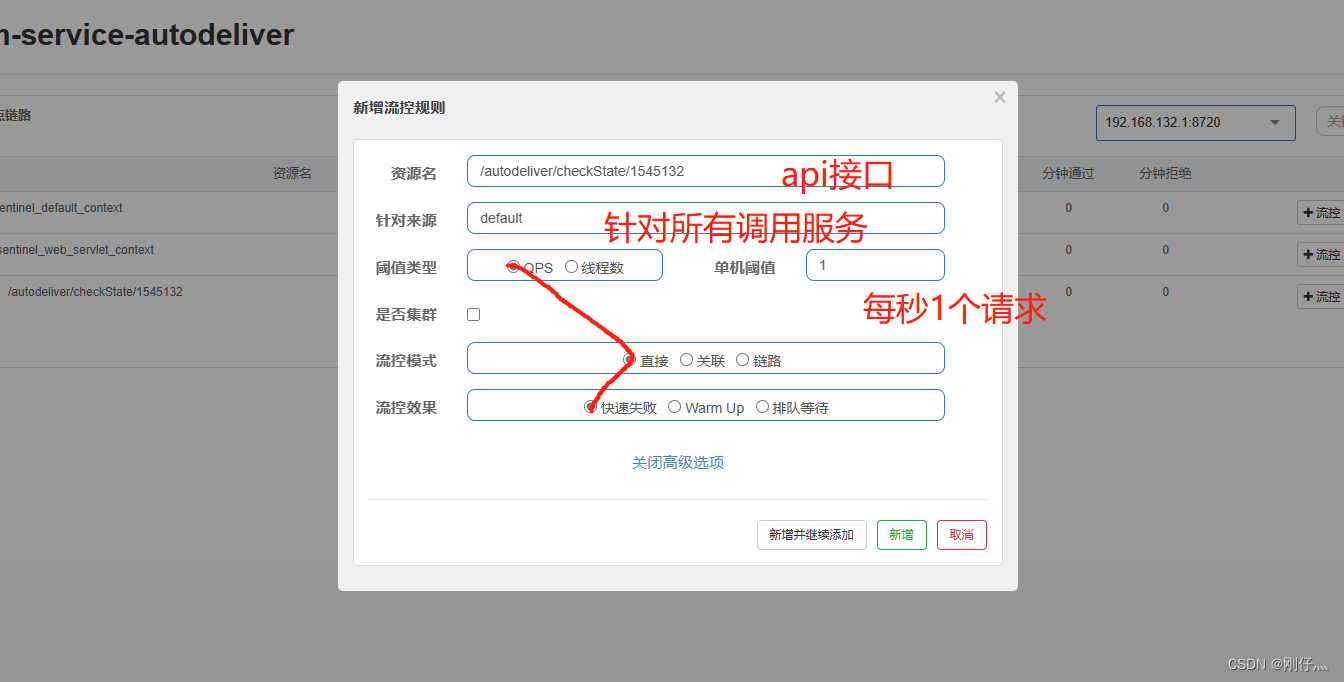

直接模式

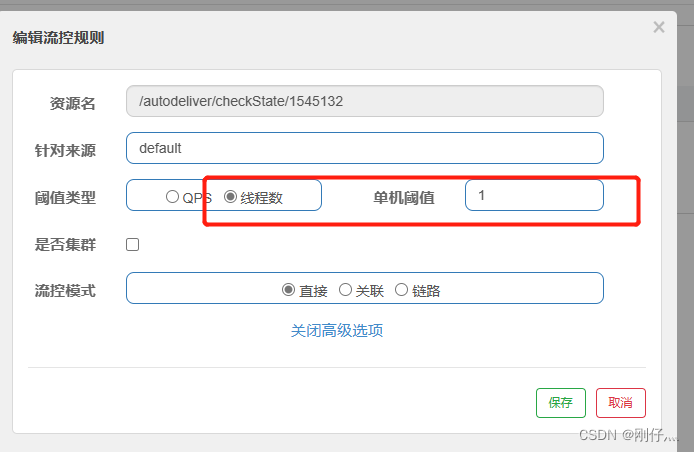

- QPS类型:(每秒钟请求数量)当调⽤该资源的QPS达到阈值时进行限流

-

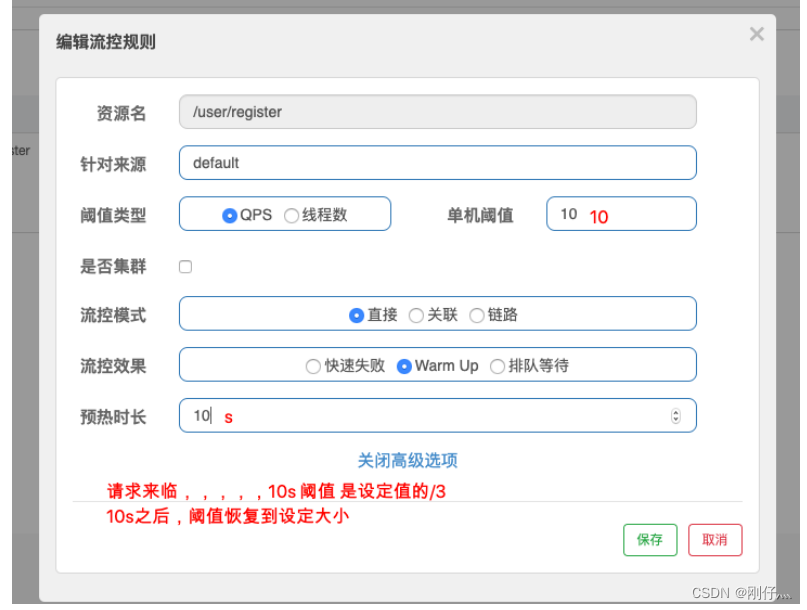

新建流控规则

是否集群:是否集群限流

流控模式:

直接:资源调⽤达到限流条件时,直接限流

关联:关联的资源调⽤达到阈值时候限流⾃⼰

链路:只记录指定链路上的流量

流控效果:

快速失败:直接失败,抛出异常

Warm Up:根据冷加载因子(默认3)的值,从阈值/冷加载因子,经过预热时长,才达到设置的QPS阈

值

排队等待:匀速排队,让请求匀速通过,阈值类型必须设置为QPS,否则无效 -

1秒内多次访问,快速失败

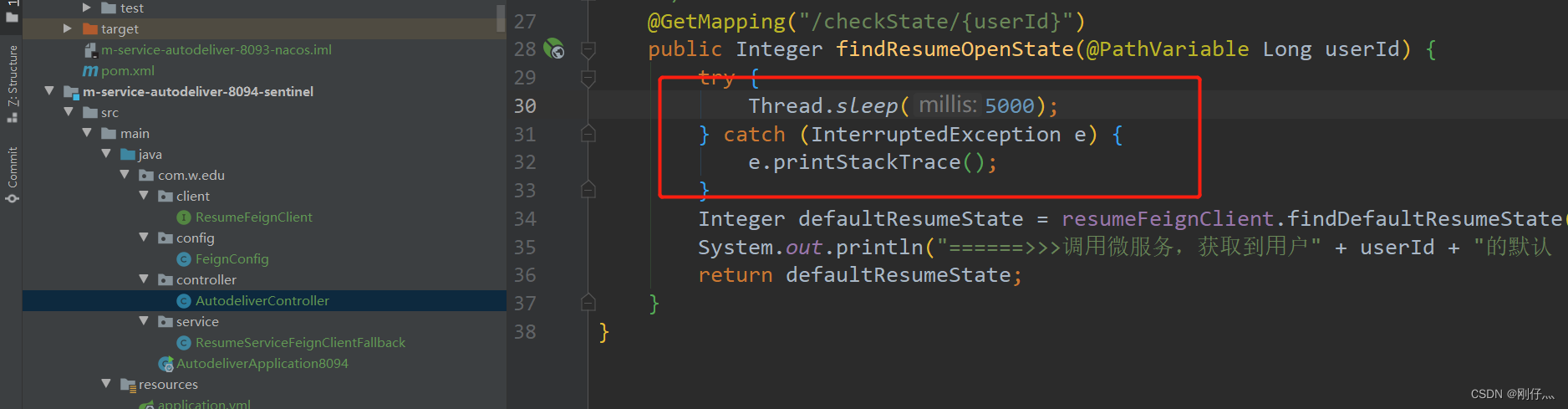

- 线程数:当调用资源的线程数达到阈值的时候进行限流

- 1秒内多次访问,快速失败

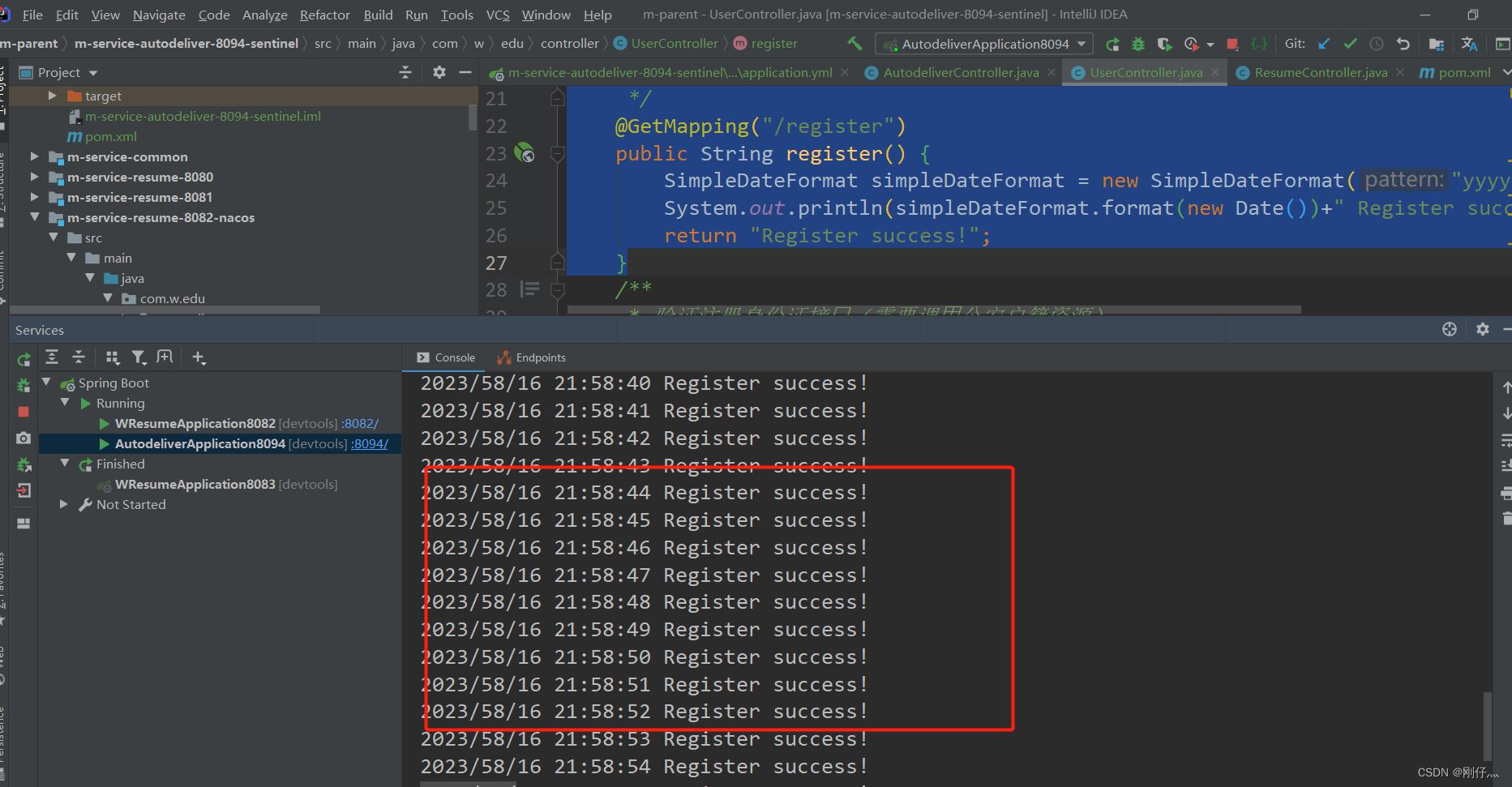

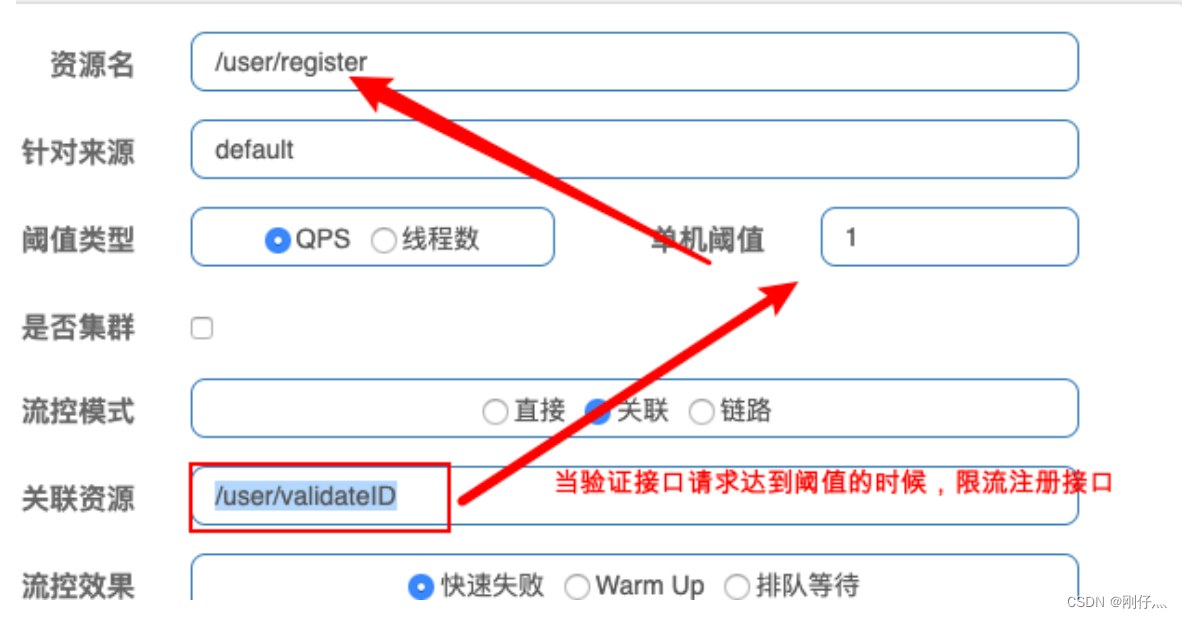

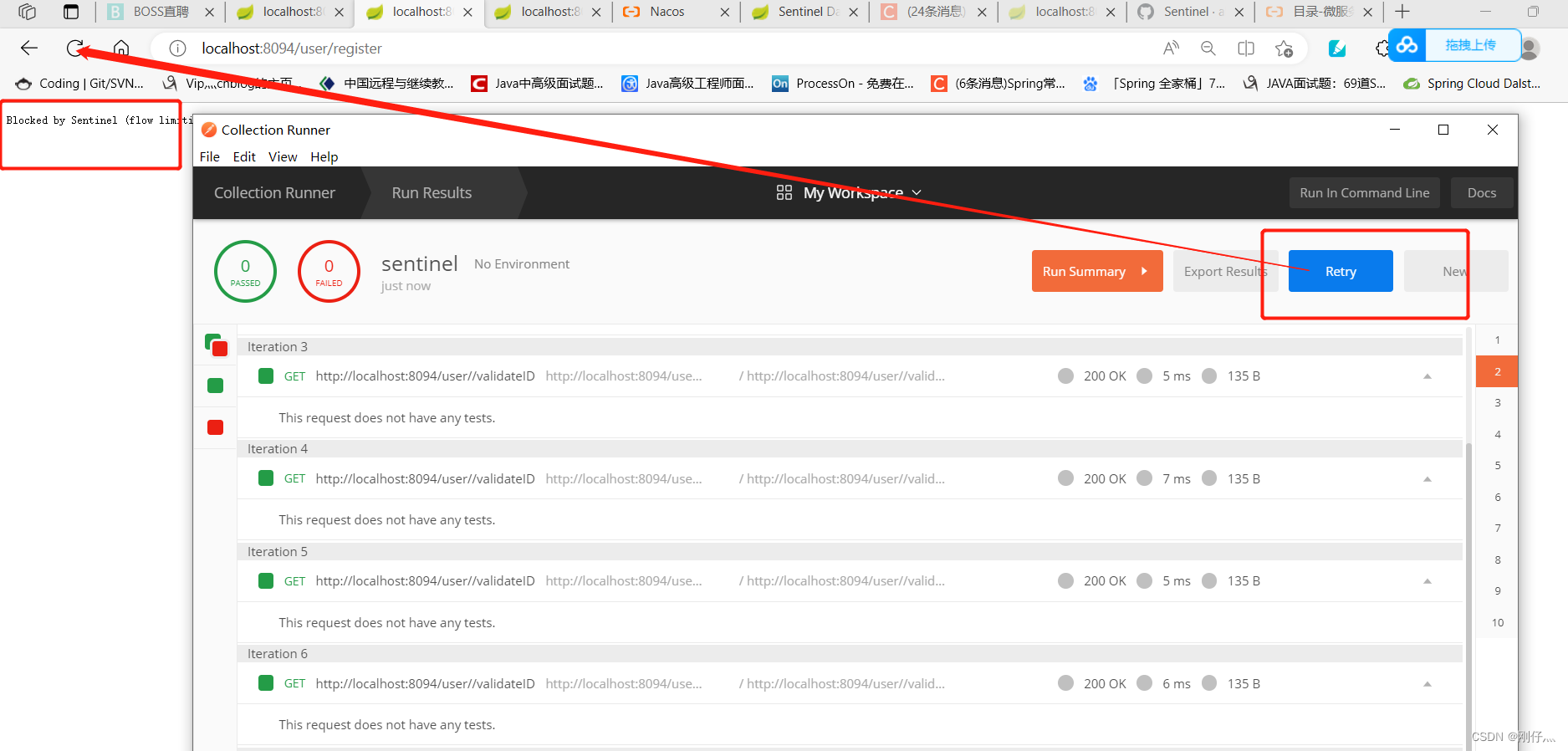

关联模式

关联的资源调用达到阈值时候限流自己,比如用户注册接口,需要调用身份证校验接口(往往身份证校验接口),如果身份证校验接口请求达到阈值,使用关联,可以对用户注册接口进行限流

@RestController

@RequestMapping("/user")

public class UserController {

/**

* ⽤户注册接⼝

* @return

*/

@GetMapping("/register")

public String register() {

System.out.println("Register success!");

return "Register success!";

}

/**

* 验证注册身份证接⼝(需要调⽤公安户籍资源)

* @return

*/

@GetMapping("/validateID")

public String findResumeOpenState() {

System.out.println("validateID");

return "ValidateID success!";

}

}

-

创建限流规则

-

1秒内多次访问,密集式请求/user/validateID验证接口,我们会发现/user/register接口也被限流了

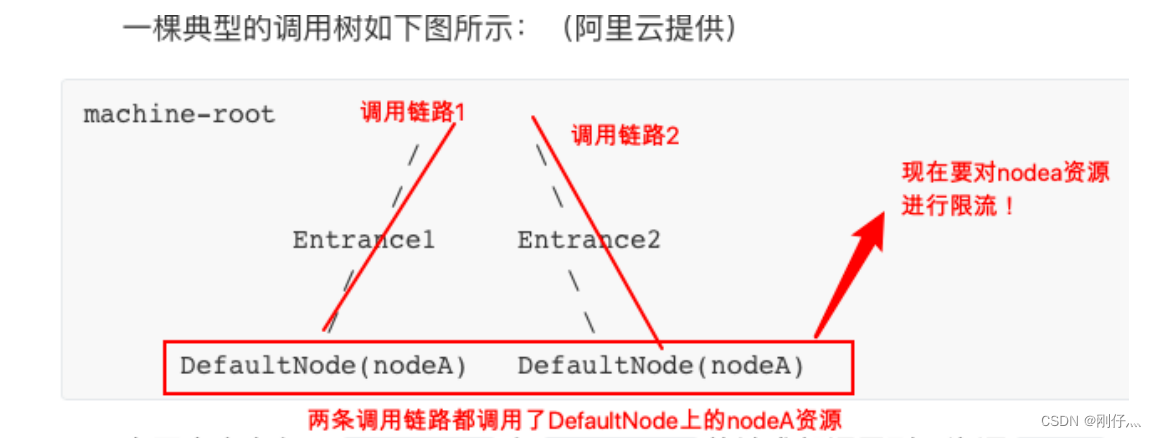

链路模式

链路指的是请求链路(调用链)

链路模式下会控制该资源所在的调用链路入口的流量。需要在规则中配置⼊口资源,即该调用链路⼊口的上下文名称

⼀棵典型的调用树如下图所示:(阿里云提供)

上图中来自入口Entrance1和 Entrance2 的请求都调用到了资源 NodeA ,Sentinel 允许只根据某

个调用入口的统计信息对资源限流。比如链路模式下设置入口资源为 Entrance1 来表示只有从入口

Entrance1 的调用才会记录到 NodeA 的限流统计当中,而不关心经 Entrance2 到来的调用。

流控效果

快速失败:直接失败,抛出异常

Warm Up:根据冷加载因子(默认3)的值,从阈值/冷加载因子,经过预热时长,才达到设置的QPS阈值

排队等待:匀速排队,让请求匀速通过,阈值类型必须设置为QPS,否则无效

快速失败

直接失败,抛出异常

Warm Up预热

通过 Warm Up 模式(预热模式),让通过的流量缓慢增加,经过设置的预热时间以后,到达系统处理请求速率的设定值。

Warm Up 模式默认会从设置的 QPS 阈值的 1/3 开始慢慢往上增加至 QPS 设置值。

排队等待

排队等待模式下会严格控制请求通过的间隔时间,即请求会匀速通过,允许部分请求排队等待,通常用于消息队列削峰填谷等场景。需设置具体的超时时间,当计算的等待时间超过超时时间时请求就会被拒绝。

很多流量过来了,并不是直接拒绝请求,而是请求进行排队,⼀个⼀个匀速通过(处理),请求能等就等着被处理,不能等(等待时间>超时时间)就会被拒绝。

排队效果