一、实验环境

- JDK版本:jdk1.8.0_171

- Spark版本:2.1.0,下载地址

- Linux操作系统:CentOS6.5

二、准备工作

- JDK安装,请参考《Hadoop2.7.3环境搭建之伪分布式》

- Spark安装包已上传至目录/tools(需事先创建)

三、安装部署

-

解压安装:进入tools下,执行如下命令:

tar -zxvf spark-2.1.0-bin-hadoop2.7.tgz -C /training/注意:由于Spark的脚本命令和Hadoop有冲突,只需在.bash_profile中设置一个即可(不能同时设置) -

修改配置文件:spark-env.sh (事先不存在需要创建或者复制得到)

export JAVA_HOME=/home/hadoop/software/jdk export SPARK_MASTER_HOST=Master export SPARK_MASTER_PORT=7077 #history 配置历史服务 export SPARK_HISTORY_OPTS="-Dspark.history.ui.port=18080 -Dspark.history.retainedApplications=30 -Dspark.history.fs.logDirectory=/home/hadoop/software/spark/history"注意:history目录需要事先创建 -

修改slaves文件,将localhost改成主机名:Master

-

复制spark-defaults.conf.template为spark-defaults.conf,并添加如下内容

spark.eventLog.enabled true spark.eventLog.dir /home/hadoop/software/spark/logs注意:logs目录需要事先创建 -

启动Spark:进入到安装目录下的sbin目录下,执行:

./start-all.sh -

启动Spark历史服务:进入到安装目录下的sbin目录下,执行:

start-history-server.sh -

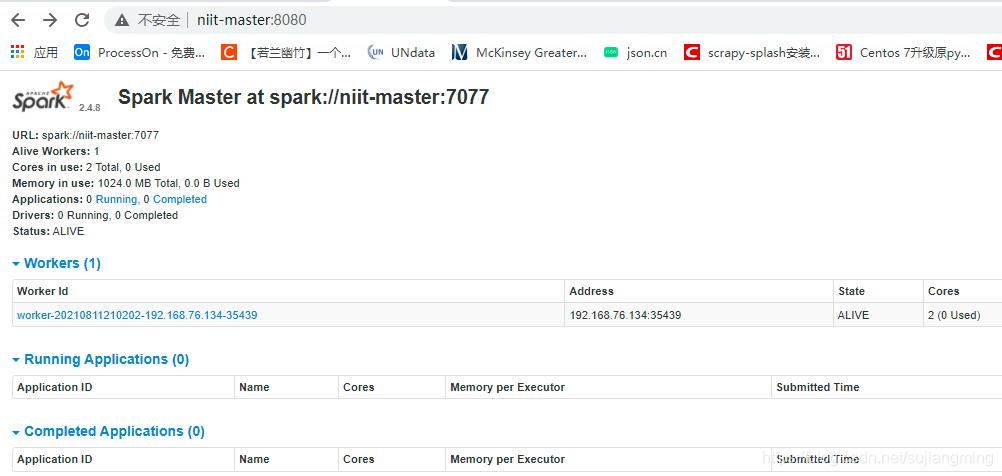

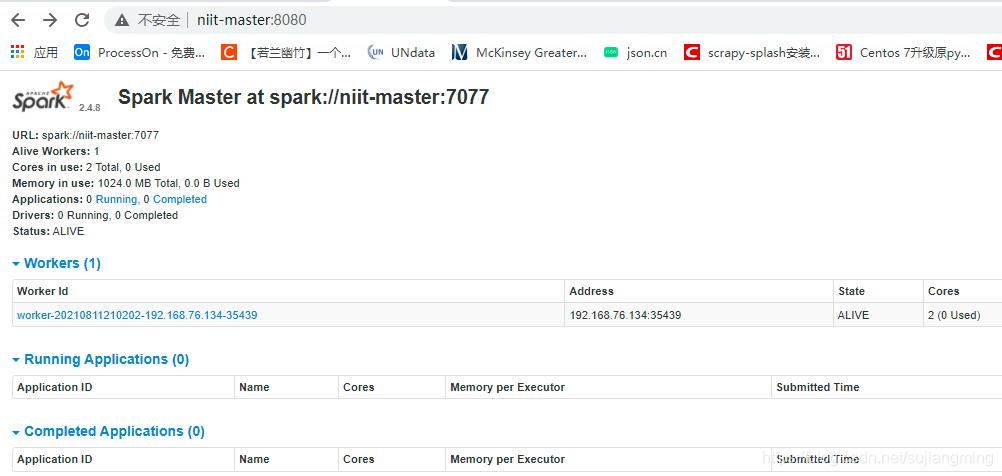

访问SparkUI:http://niit-master:8080

-

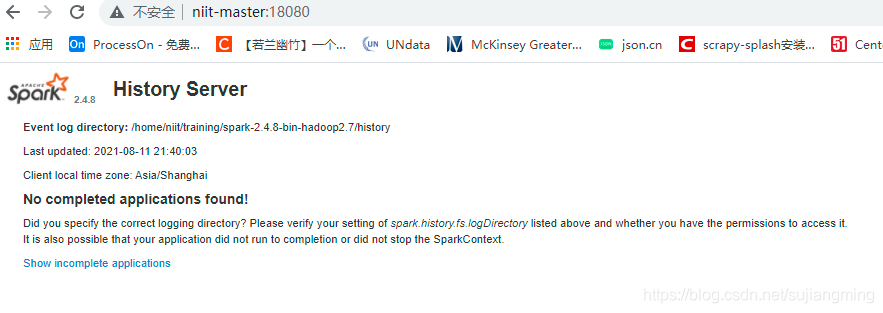

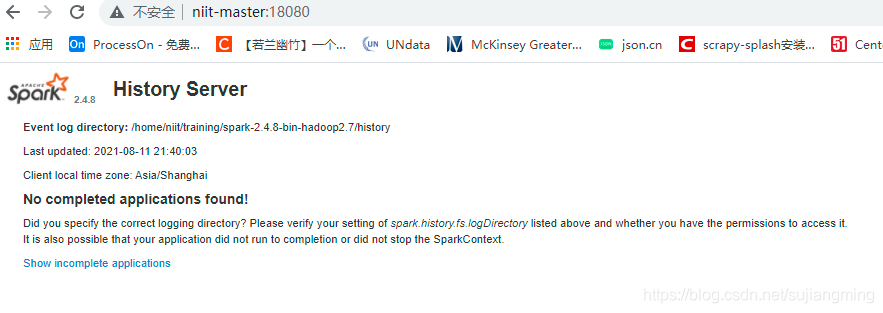

访问Spark历史服务:http://niit-master:18080

一、实验环境

- JDK版本:jdk1.8.0_171

- Spark版本:2.1.0,下载地址

- Linux操作系统:CentOS6.5

二、准备工作

- JDK安装,请参考《Hadoop2.7.3环境搭建之伪分布式》

- Spark安装包已上传至目录/tools(需事先创建)

三、安装部署

-

解压安装:进入tools下,执行如下命令:

tar -zxvf spark-2.1.0-bin-hadoop2.7.tgz -C /training/注意:由于Spark的脚本命令和Hadoop有冲突,只需在.bash_profile中设置一个即可(不能同时设置) -

修改配置文件:spark-env.sh (事先不存在需要创建或者复制得到)

export JAVA_HOME=/home/hadoop/software/jdk export SPARK_MASTER_HOST=Master export SPARK_MASTER_PORT=7077 #history 配置历史服务 export SPARK_HISTORY_OPTS="-Dspark.history.ui.port=18080 -Dspark.history.retainedApplications=30 -Dspark.history.fs.logDirectory=/home/hadoop/software/spark/history"注意:history目录需要事先创建 -

修改slaves文件,将localhost改成主机名:Master

-

复制spark-defaults.conf.template为spark-defaults.conf,并添加如下内容

spark.eventLog.enabled true spark.eventLog.dir /home/hadoop/software/spark/logs注意:logs目录需要事先创建 -

启动Spark:进入到安装目录下的sbin目录下,执行:

./start-all.sh -

启动Spark历史服务:进入到安装目录下的sbin目录下,执行:

start-history-server.sh -

访问SparkUI:http://niit-master:8080

-

访问Spark历史服务:http://niit-master:18080