目录

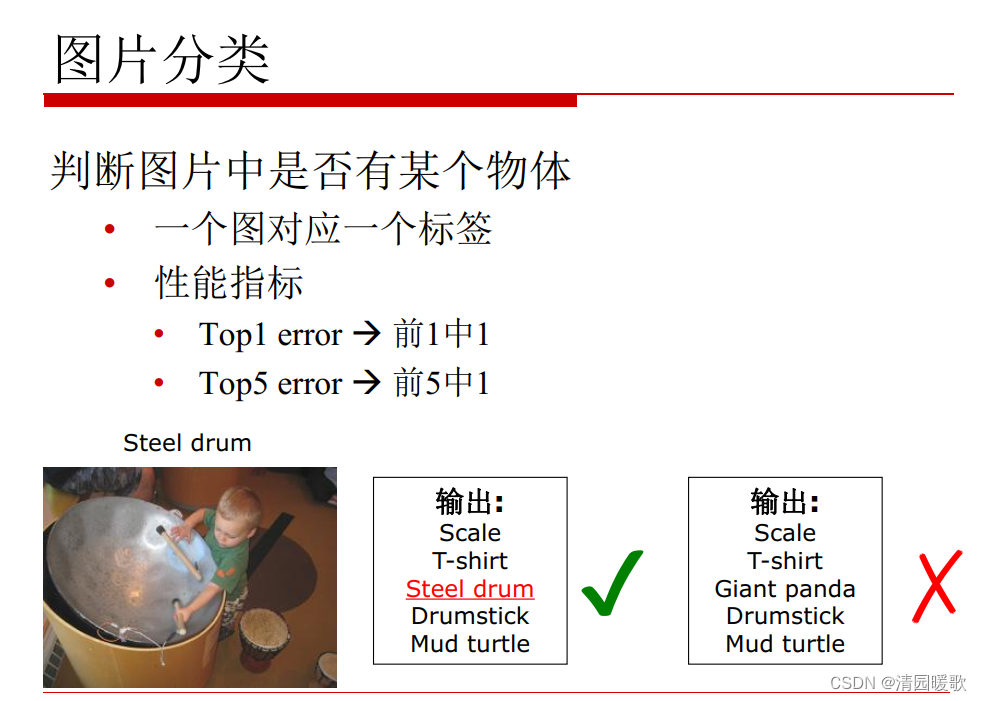

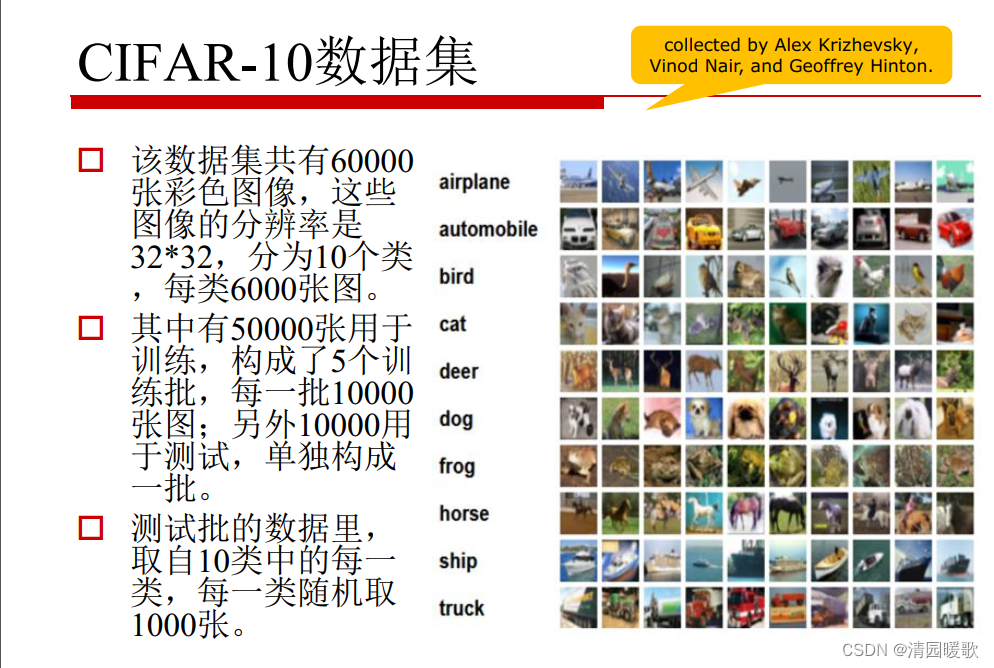

五、图像分类

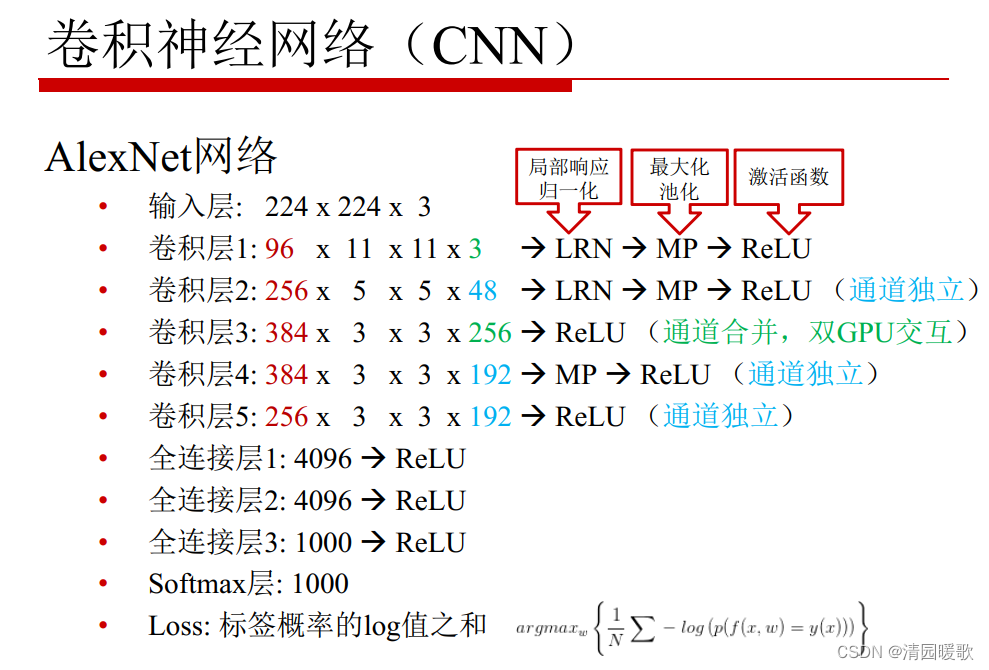

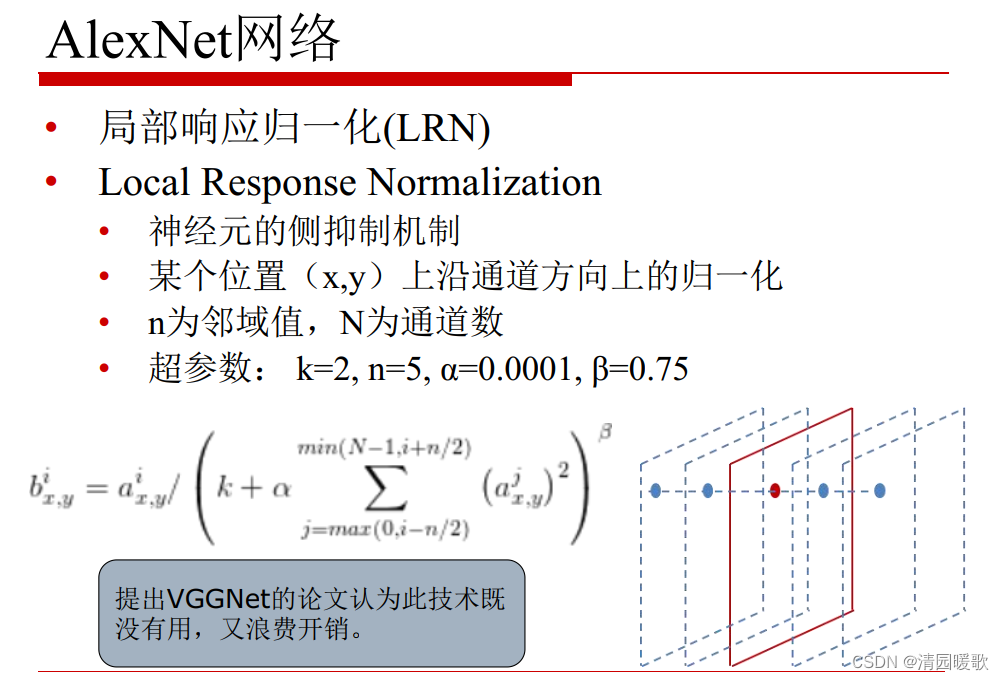

5.1 AlexNet

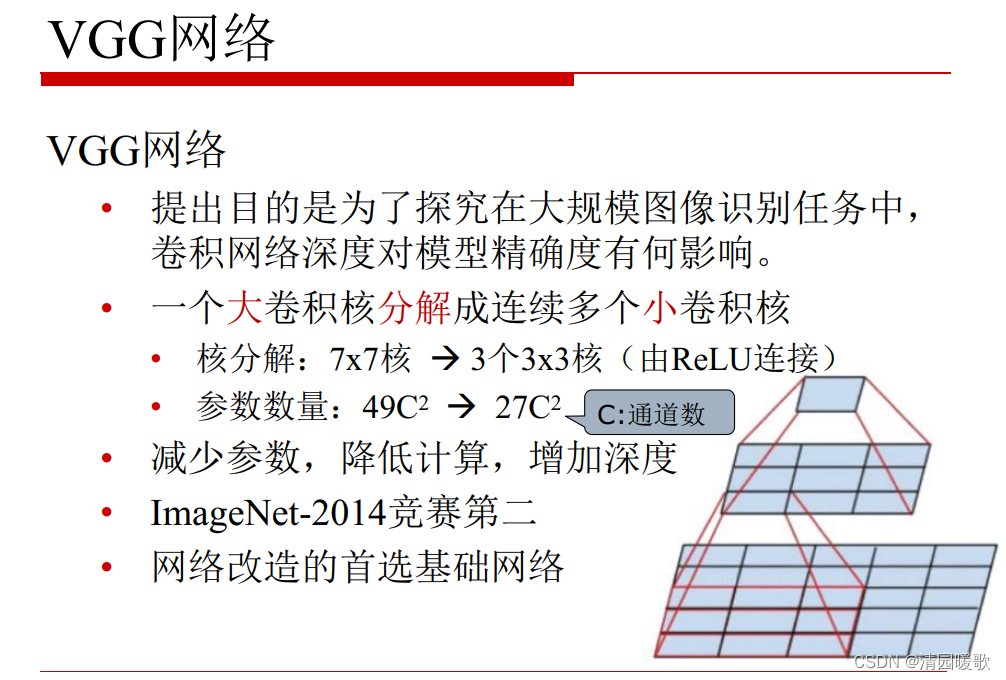

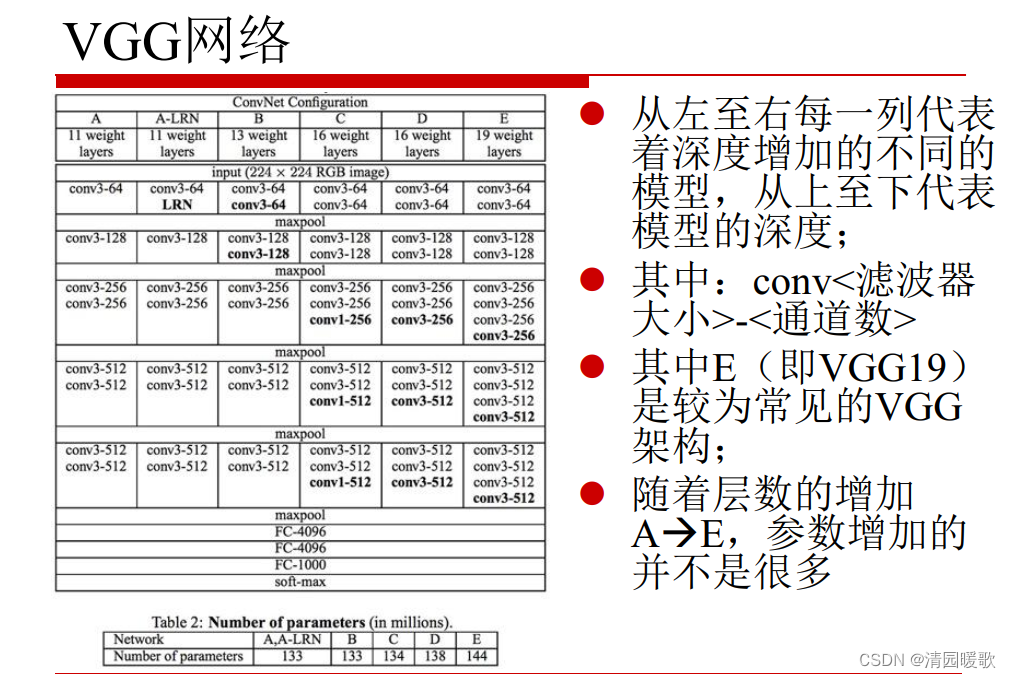

5.2 VGG

5.3 GoogLeNet、Inception

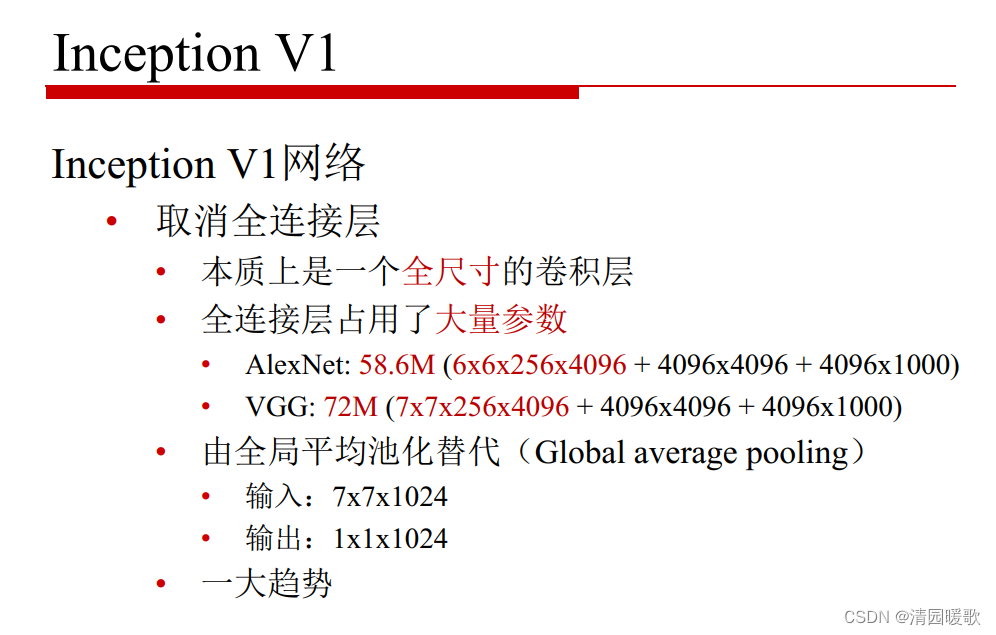

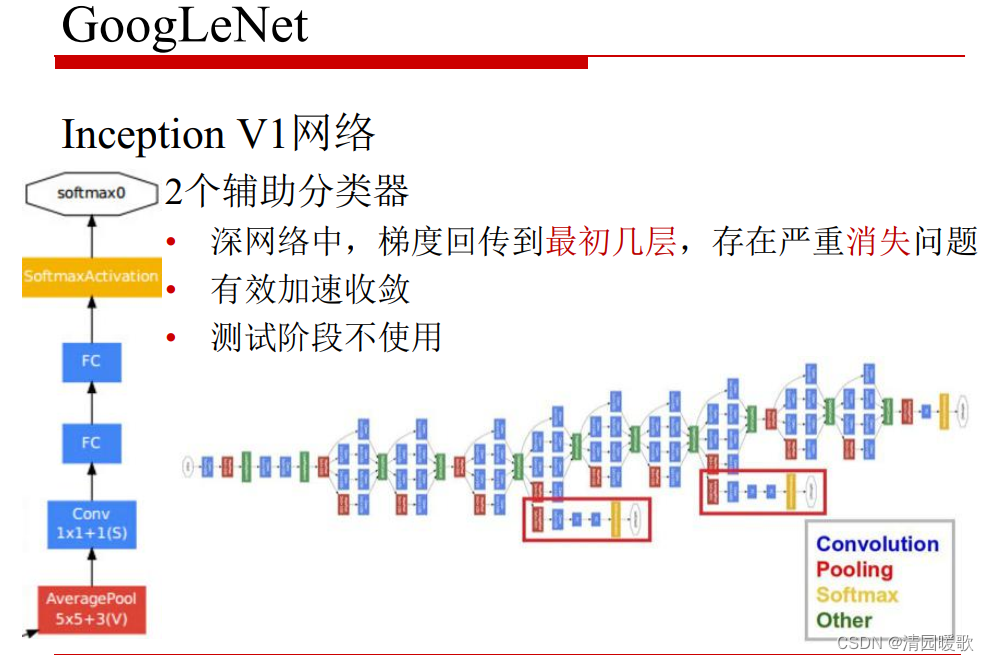

5.3.1 Inception V1

全连接层参数过多,所以要改进

GAP:全局平均池化

在梯度要消失的地方,再次传入

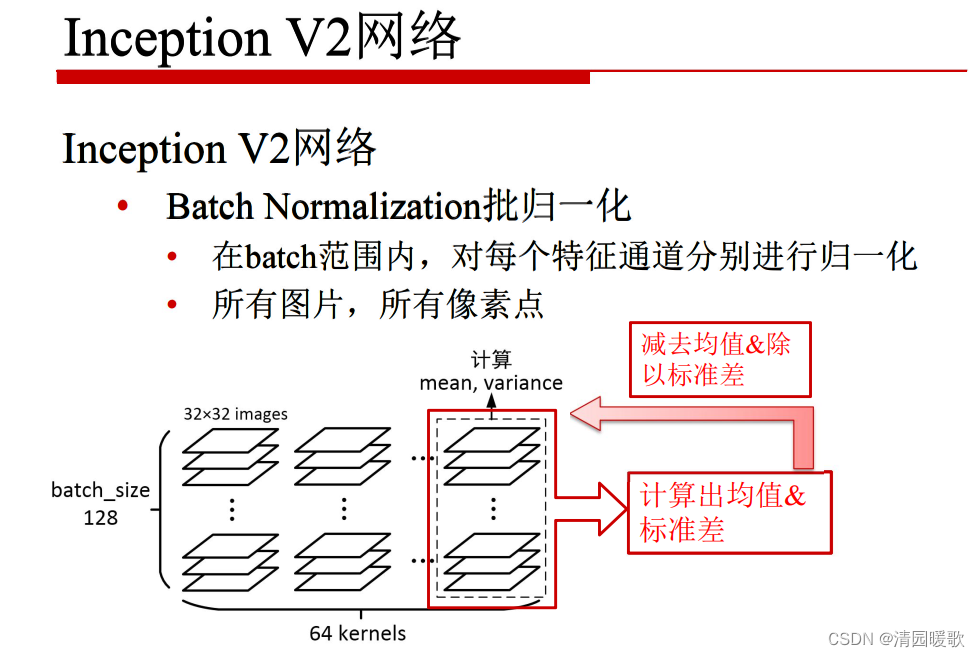

5.3.2 Inception V2

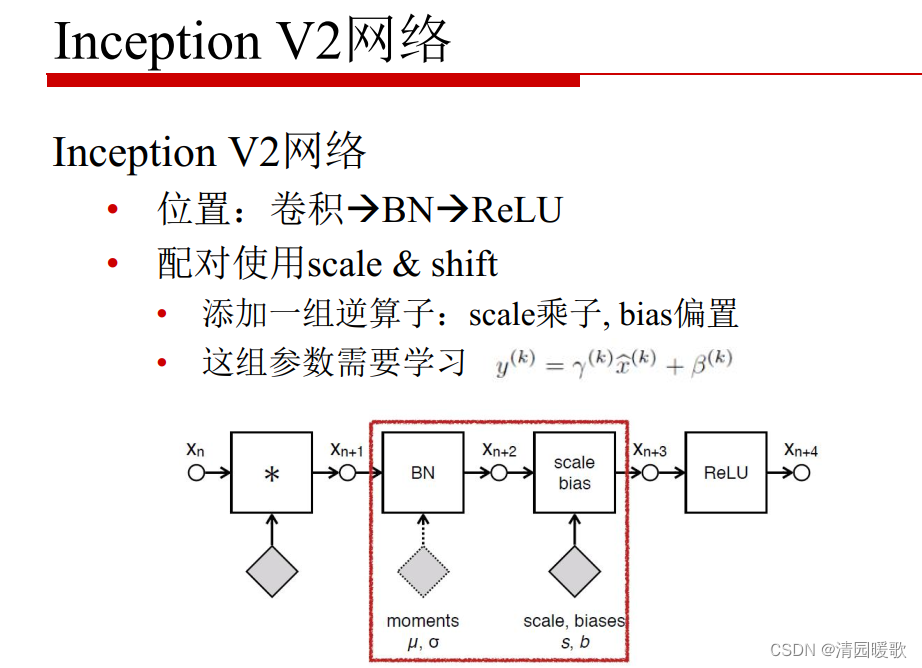

(1)训练时要将traning参数设置为True,在验证时将trainning参数设置为False。在pytorch中可通过创建 模型的model.train()和model.eval()方法控制。

(1)训练时要将traning参数设置为True,在验证时将trainning参数设置为False。在pytorch中可通过创建 模型的model.train()和model.eval()方法控制。

(2)batch size尽可能设置大点,设置小后表现可能很糟糕,设置的越大求的均值和方差越接近整个训练集的均值和方差。

(3)一般将bn层放在卷积层(Conv)和激活层(例如Relu)之间,且卷积层不要使用偏置bias。

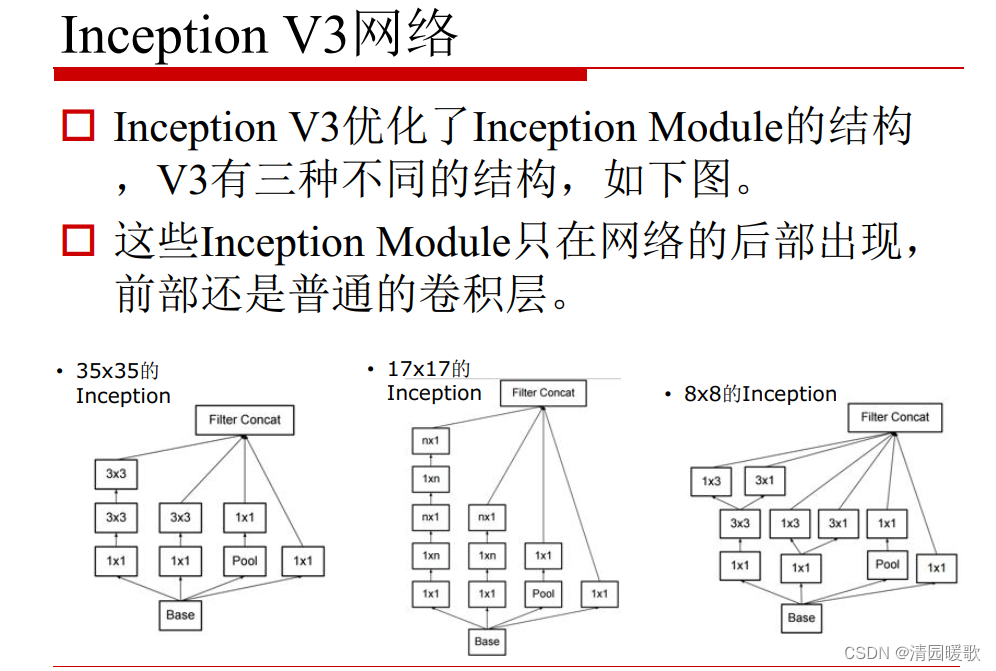

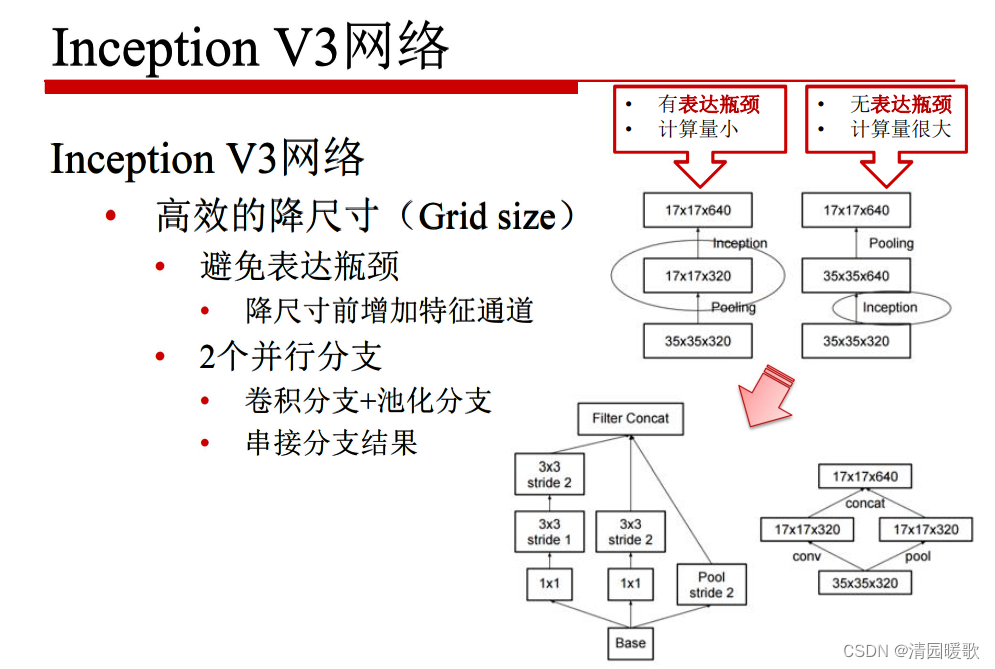

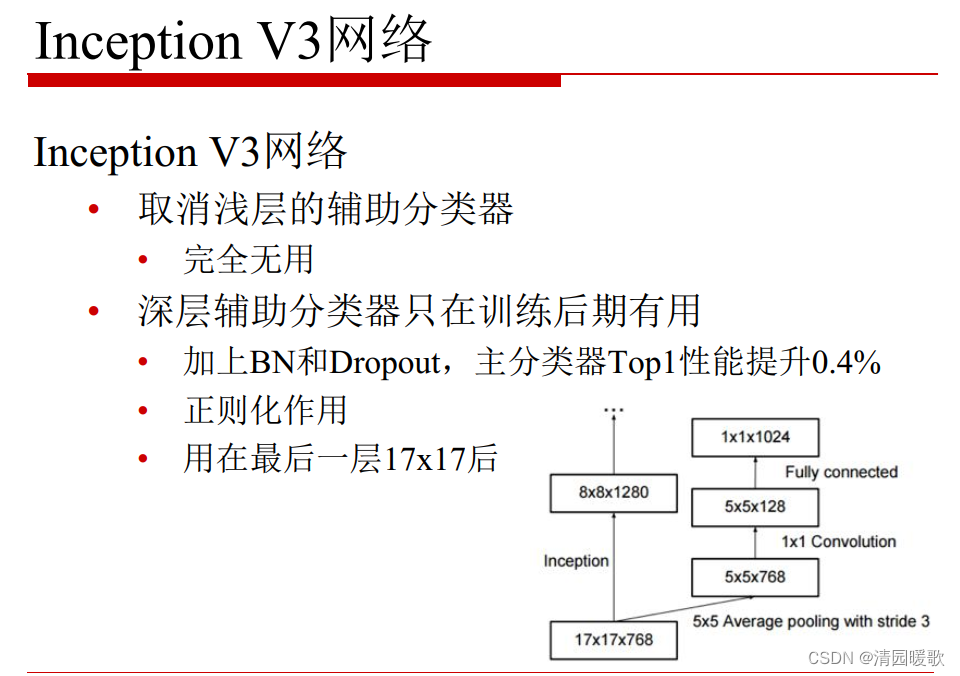

5.3.3 Inception V3

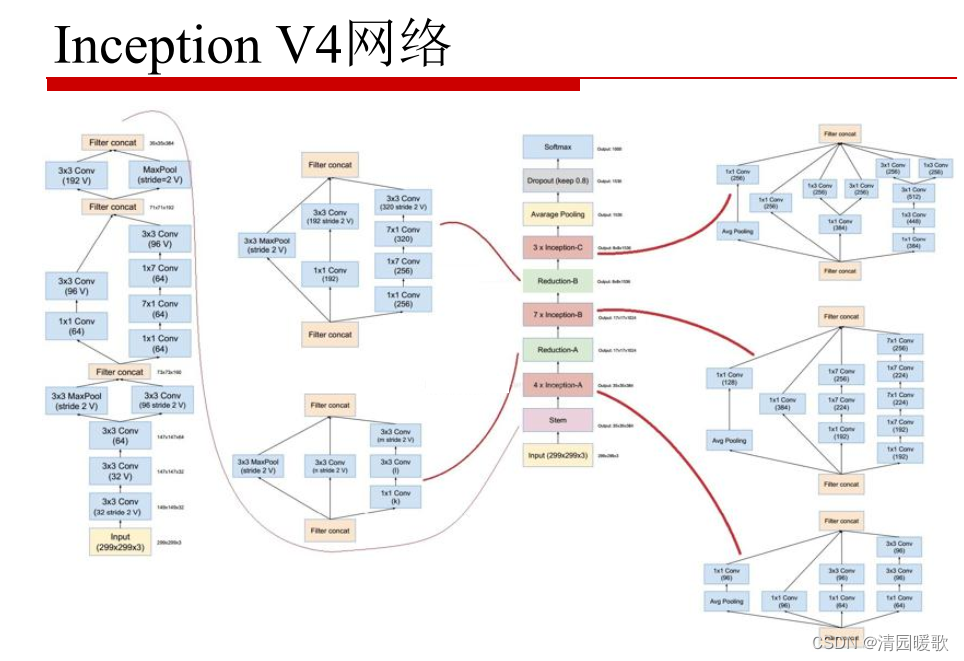

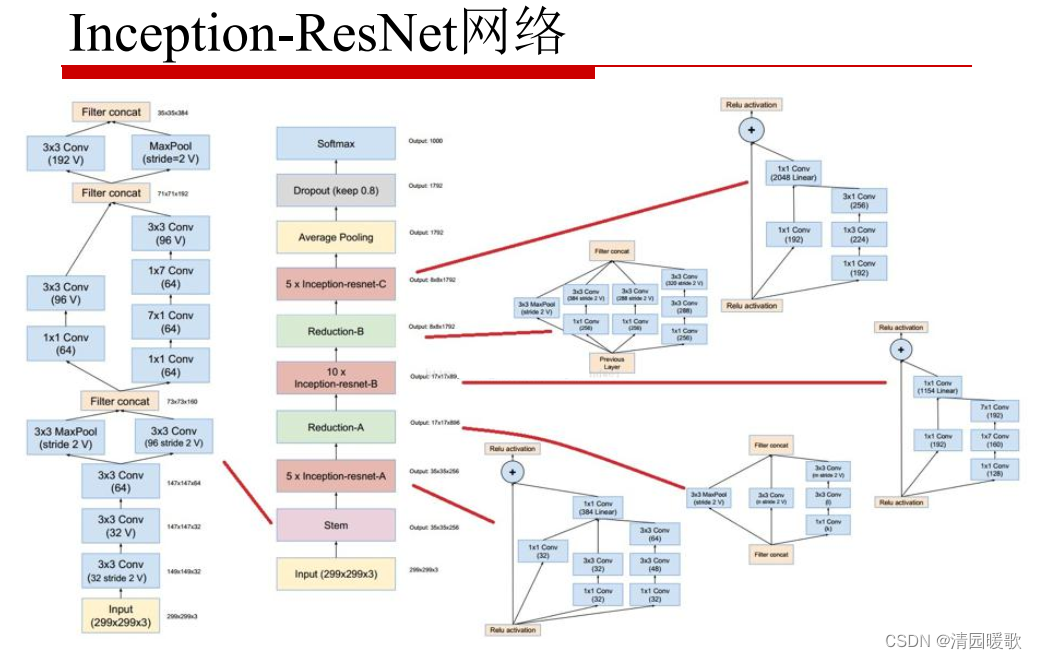

5.3.4 Inception V4

VGG是大多数的主干模型,Google的可扩展性相对差一点

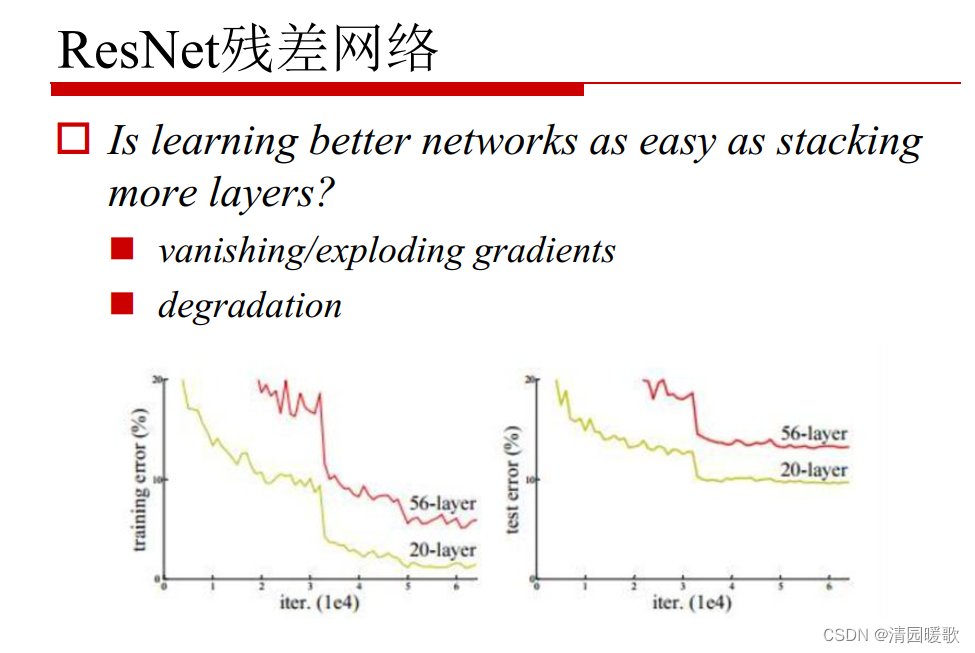

5.4 ResNet 残差网络

5.4.1 ResNet

优化:用1×1卷积先降维减少计算量,再升维和前面的残差块组合

FLOPs这里是指需要的计算量

FLOPs这里是指需要的计算量

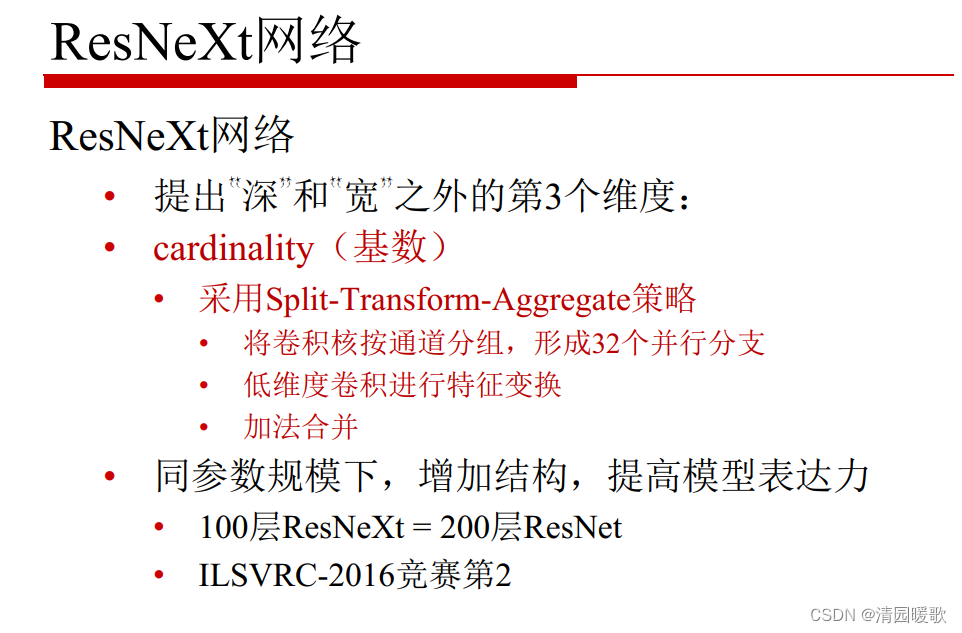

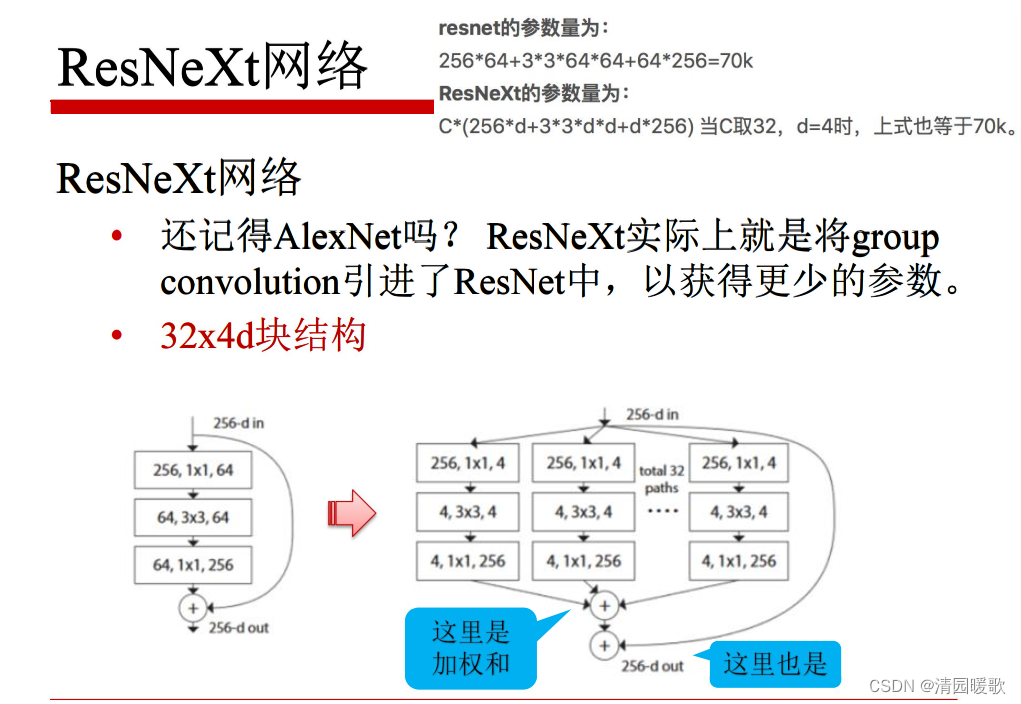

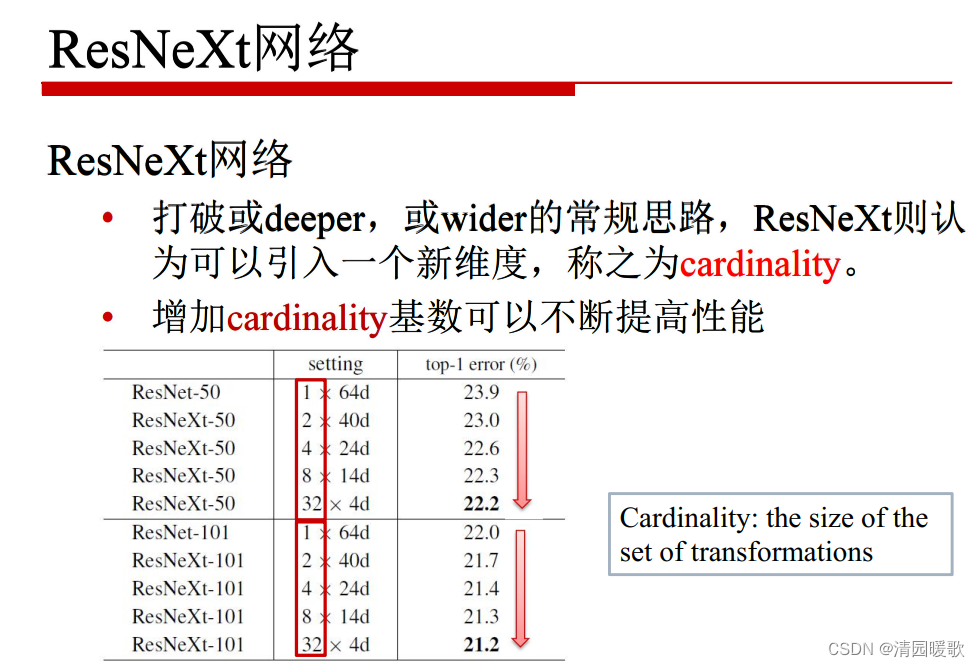

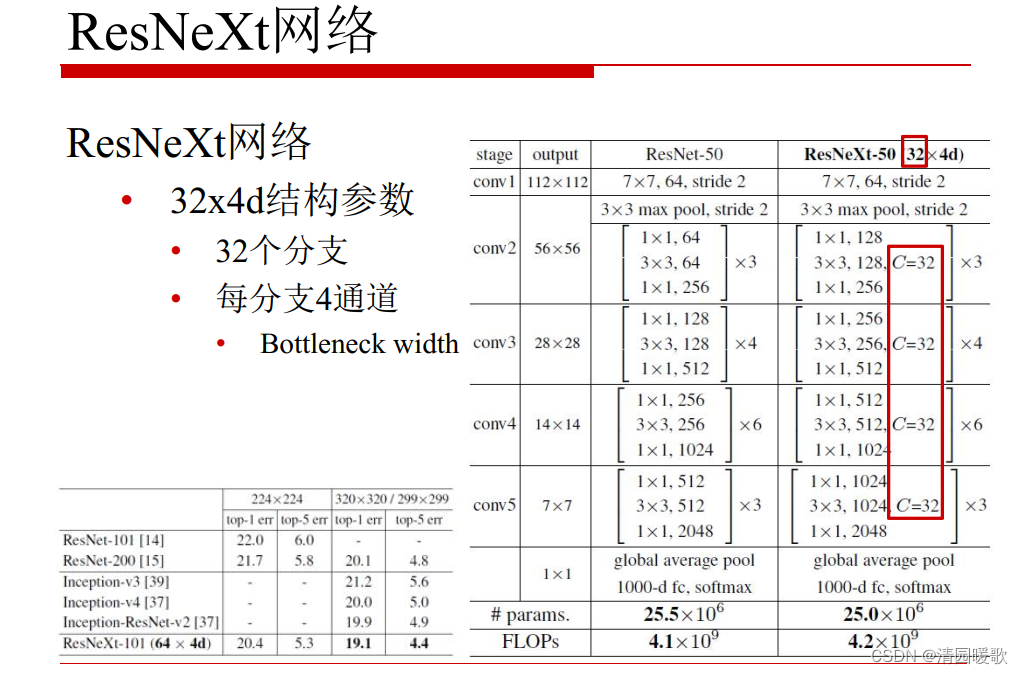

5.4.2 ResNeXt

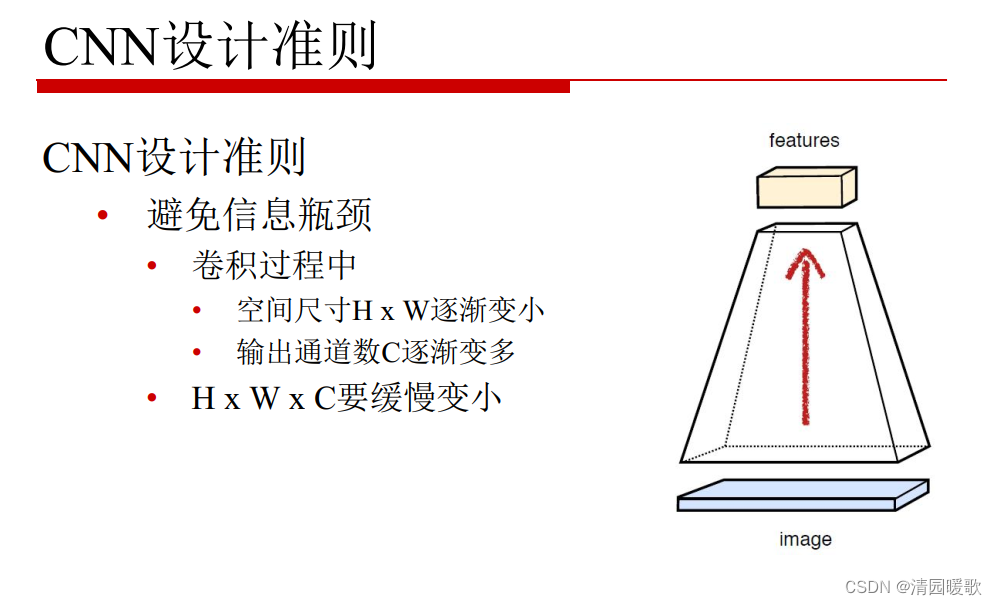

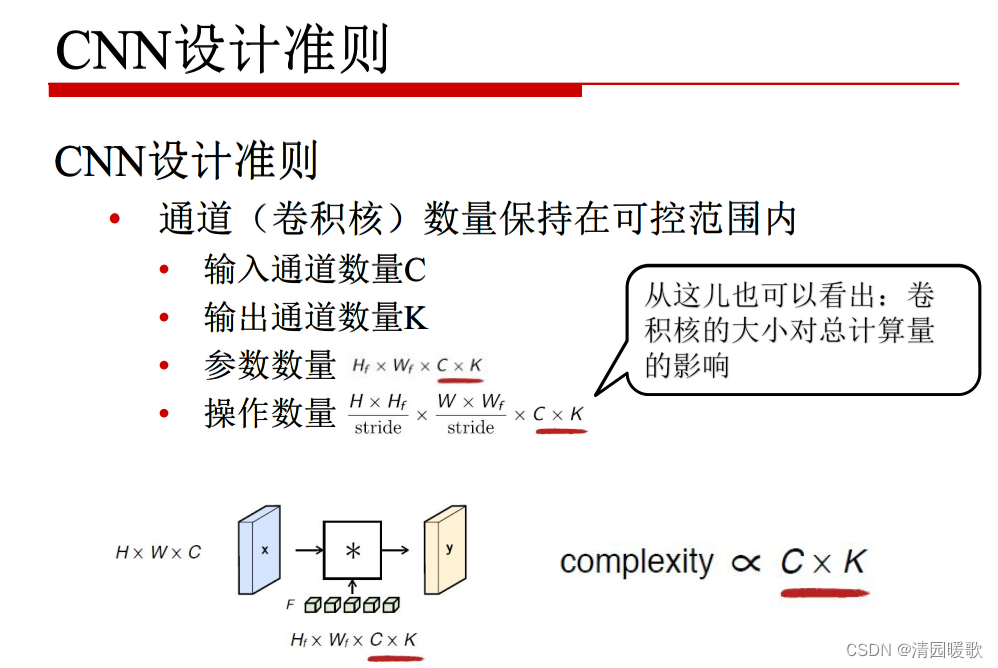

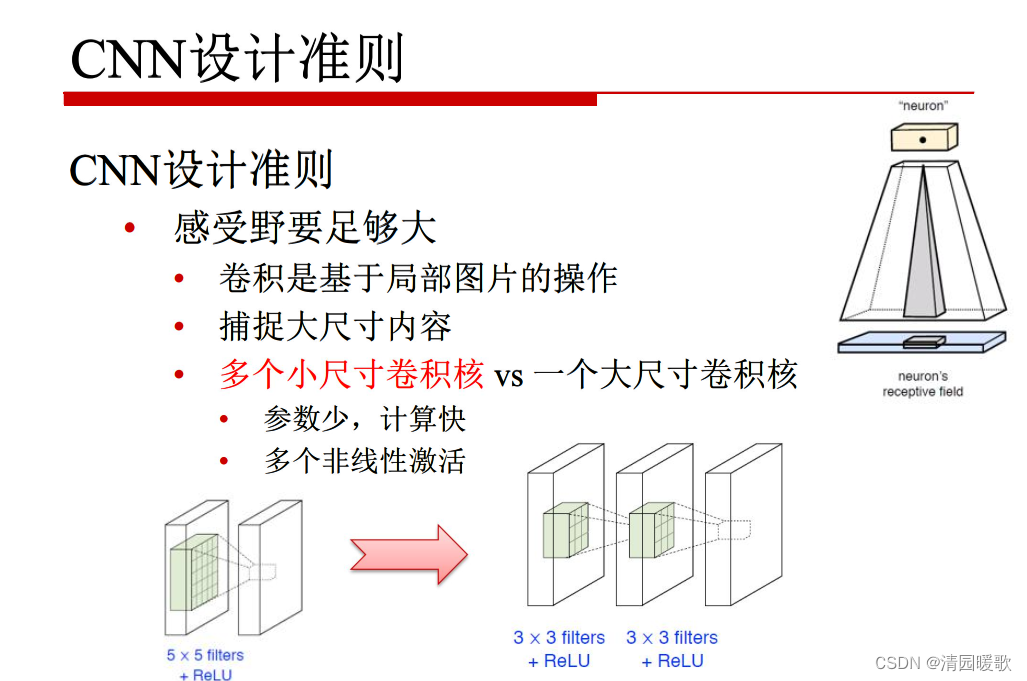

5.5 CNN设计准则

这里不一定分组卷积就比整个卷积强

这里不一定分组卷积就比整个卷积强