点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

论文作者 | 自动驾驶Daily

编辑 | 自动驾驶之心

不得不说,技术更新太快了,Nerf在学术界慢慢被替换下去了。Gaussians登场了,浙江大学的工作

论文:Street Gaussians for Modeling Dynamic Urban Scenes

链接:https://arxiv.org/pdf/2401.01339.pdf

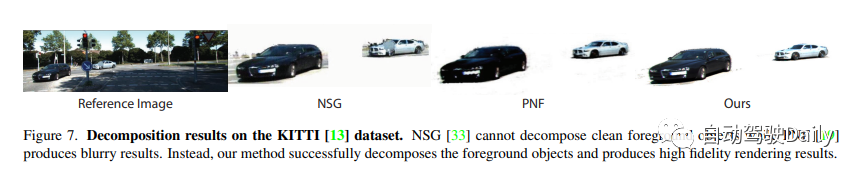

本文旨在解决从单目视频中建模动态城市街道场景的问题。最近的方法扩展了NeRF,将跟踪车辆姿态纳入animate vehicles,实现了动态城市街道场景的照片逼真视图合成。然而,它们的显著局限性在于训练和渲染速度慢,再加上跟踪车辆姿态对高精度的迫切需求。这篇论文介绍了Street Gaussians,一种新的明确的场景表示,它解决了所有这些限制。具体地说,动态城市街道被表示为一组点云,这些点云配备有语义logits和3D Gaussians,每一个都与前景车辆或背景相关联。

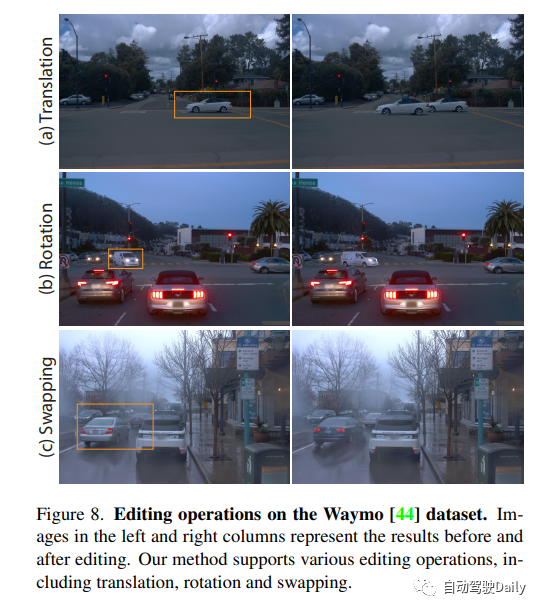

为了对前景对象车辆的动力学进行建模,使用可优化的跟踪姿态以及动态外观的动态球面谐波模型对每个对象点云进行优化。显式表示允许简单地合成目标车辆和背景,这反过来又允许在半小时的训练内以133 FPS(1066×1600分辨率)进行场景编辑操作和渲染。所提出的方法在多个具有挑战性的基准上进行了评估,包括KITTI和Waymo Open数据集。

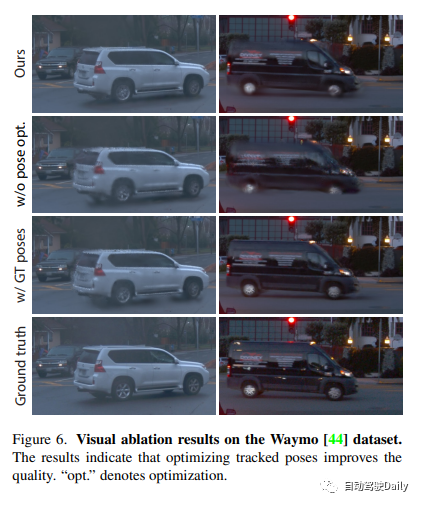

实验表明,所提出的方法在所有数据集上始终优于现有技术的方法。此外,尽管仅依赖于现成跟踪器的pose,但所提出的表示提供的性能与使用GT pose所实现的性能不相上下。

代码:https://zju3dv.github.io/streetgaussians/

Street Gaussians方法介绍

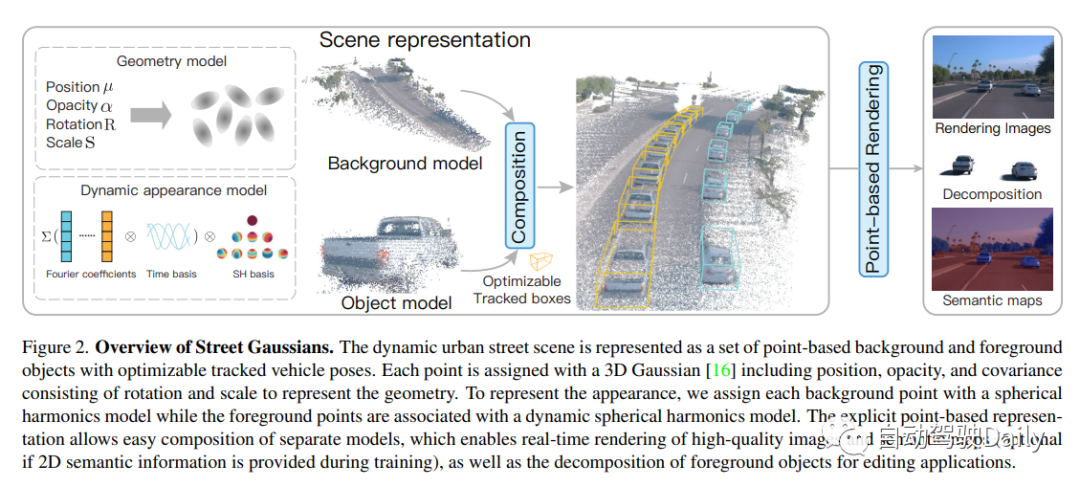

给定从城市街道场景中的移动车辆捕获的一系列图像,本文的目标是开发一个能够为任何给定的输入时间步长和任何视点生成真实感图像的模型。为了实现这一目标,提出了一种新的场景表示,命名为Street Gaussians,专门用于表示动态街道场景。如图2所示,将动态城市街道场景表示为一组点云,每个点云对应于静态背景或移动车辆。显式基于点的表示允许简单地合成单独的模型,从而实现实时渲染以及编辑应用程序的前景对象分解。仅使用RGB图像以及现成跟踪器的跟踪车辆姿态,就可以有效地训练所提出的场景表示,通过我们的tracked车辆姿态优化策略进行了增强。

Street Gaussians概览如下所示,动态城市街道场景表示为一组具有可优化tracked车辆姿态的基于点的背景和前景目标。每个点都分配有3D高斯,包括位置、不透明度和由旋转和比例组成的协方差,以表示几何体。为了表示apperence,为每个背景点分配一个球面谐波模型,而前景点与一个动态球面谐波模型相关联。显式的基于点的表示允许简单地组合单独的模型,这使得能够实时渲染高质量的图像和语义图(如果在训练期间提供2D语义信息,则是可选的),以及分解前景目标以编辑应用程序

实验结果对比

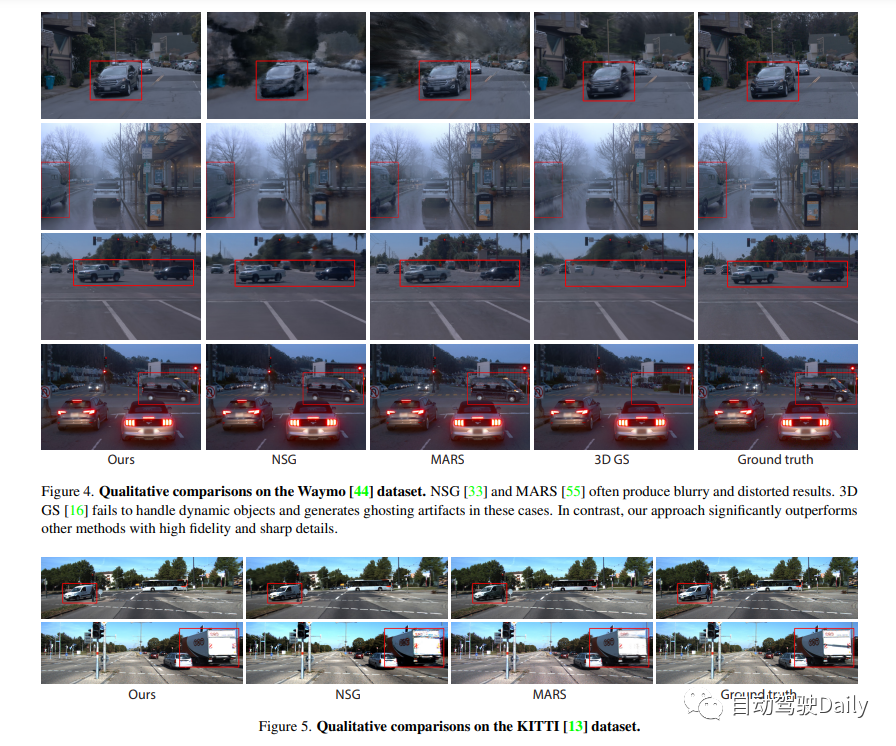

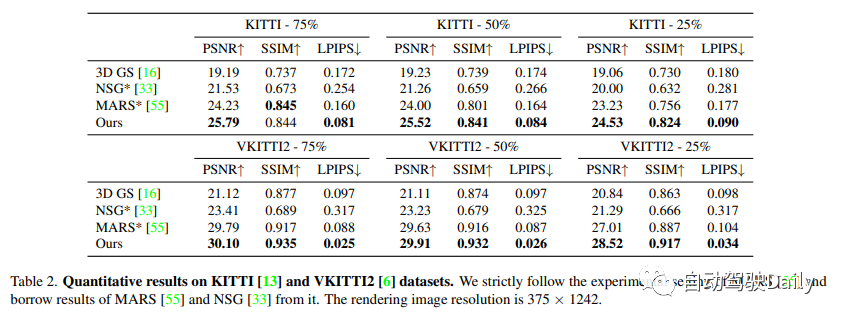

我们在Waymo开放数据集和KITTI基准上进行了实验。在Waymo开放数据集上,选择了6个记录序列,其中包含大量移动物体、显著的ego运动和复杂的照明条件。所有序列的长度约为100帧,选择序列中的每10张图像作为测试帧,并使用剩余的图像进行训练。当发现我们的基线方法在使用高分辨率图像进行训练时存在较高的内存成本时,将输入图像缩小到1066×1600。在KITTI和Vitural KITTI 2上,遵循MARS的设置,并使用不同的训练/测试分割设置来评估。在Waymo数据集上使用检测器和跟踪器生成的边界框,并使用KITTI官方提供的目标轨迹。

将本文的方法与最近的三种方法进行比较。

(1) NSG将背景表示为多平面图像,并使用每个目标学习的潜在代码和共享解码器来对运动目标进行建模。

(2) MARS基于Nerfstudio构建场景图。

(3) 3D高斯使用一组各向异性高斯对场景进行建模。

NSG和MARS都是使用GT框进行训练和评估的,这里尝试了它们实现的不同版本,并报告了每个序列的最佳结果。我们还将3D高斯图中的SfM点云替换为与我们的方法相同的输入,以进行公平比较。详见补充资料。

投稿作者为『自动驾驶之心知识星球』特邀嘉宾,欢迎加入交流!

① 全网独家视频课程

BEV感知、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、大模型与自动驾驶、Nerf、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

视频官网:www.zdjszx.com

视频官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

近2400人的交流社区,涉及30+自动驾驶技术栈学习路线,想要了解更多自动驾驶感知(2D检测、分割、2D/3D车道线、BEV感知、3D目标检测、Occupancy、多传感器融合、多传感器标定、目标跟踪、光流估计)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、AI模型部署落地实战、行业动态、岗位发布,欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频,期待交流!

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦目标检测、语义分割、全景分割、实例分割、关键点检测、车道线、目标跟踪、3D目标检测、BEV感知、多模态感知、Occupancy、多传感器融合、transformer、大模型、点云处理、端到端自动驾驶、SLAM、光流估计、深度估计、轨迹预测、高精地图、NeRF、规划控制、模型部署落地、自动驾驶仿真测试、产品经理、硬件配置、AI求职交流等方向。扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】平台矩阵,欢迎联系我们!