这几天OpenAI即将直播的消息,调足了大家的胃口,吃瓜群众都在猜测是不是GPT-5要发布了,Sam Altman不得不在X平台辟谣,GPT-5暂时还不发,AI搜索引擎这次也没有。小编一直非常好奇,为什么大家这么关注GPT-5呢?GPT-4的重大更新还不能满足吃瓜群众的需求吗?直到读了这篇文章,我才知道GPT的版本差异比苹果手机的版本差异大多了,GPT-5光是在视频处理上的进步就足以令人期待了,更不要提在通用人工智能(AGI)方面可能会有的进展了,看完我也好期待GPT-5……

太长不看版:

- ChatGPT模型,如GPT-3.5和GPT-4,均基于Transformer架构,并通过微调,在特定任务上表现出色,如对话和文本补全;

- GPT-4标志着自然语言处理能力的显著飞跃,具备多模态能力、增强的推理能力,相比前代能处理更长上下文的能力;

- GPT-4 Turbo是GPT-4的优化版本,专为基于聊天的应用设计,提供了更高的成本效益和效率;

- 预计GPT-5将在视频处理和通用人工智能(AGI)方面有令人期待的进步;

- 随着这些模型的不断进化,可用性和成本等因素将决定其是否能在各行业的广泛采用。

了解ChatGPT模型基础:架构与训练

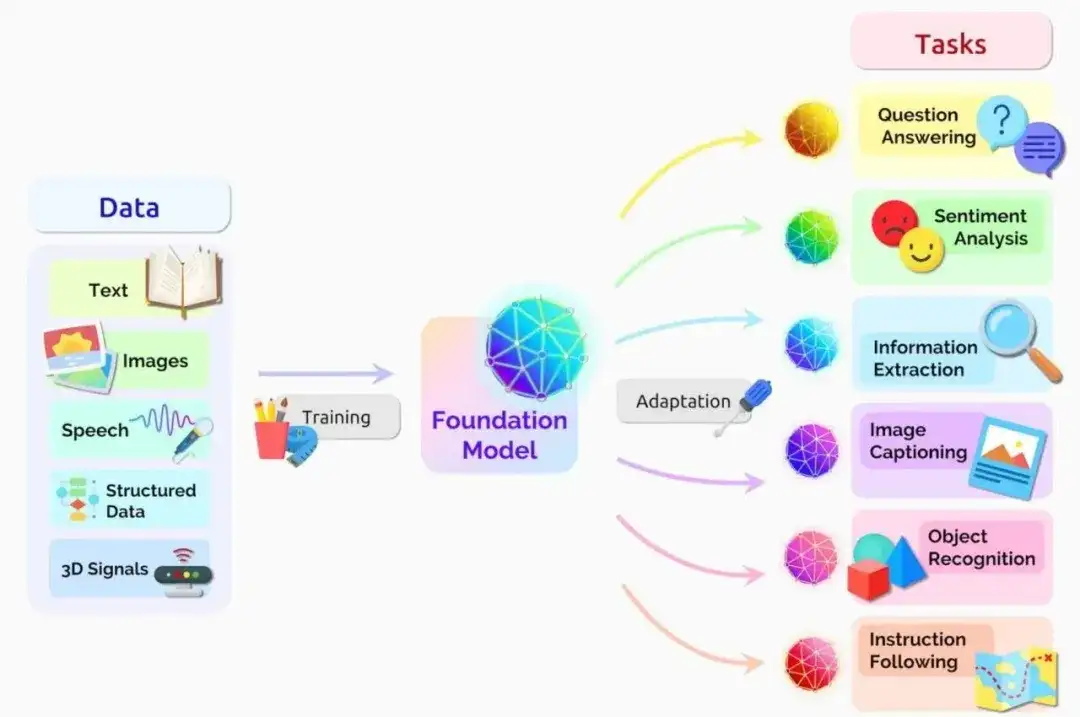

**为了掌握各种ChatGPT模型的能力及其差异,首先理解驱动它们的底层架构至关重要。这些模型的核心基于GPT (Generative Pre-trained Transformer)架构,该架构彻底改变了自然语言处理领域。**GPT架构源自于2017年Vaswani等人发表的里程碑论文《Attention Is All You Need》中介绍的Transformer模型。Transformer模型摒弃了传统的循环神经网络(RNNs),转而采用自我注意力机制,使得模型在生成输出时能够权衡输入序列不同部分的重要性。《Attention Is All You Need》论文地址:https://arxiv.org/abs/1706.03762循环神经网络(RNNs)具体介绍:

https://www.techopedia.com/definition/32834/recurrent-neural-network-rnn

Transformer模型,来源:英伟达

自我注意力机制使模型比RNN更有效地捕捉长距离依赖性和上下文信息,RNN在处理梯度消失和记忆限制方面苦苦挣扎。通过关注输入序列的相关部分,Transformer模型能够生成更加连贯、上下文恰当的输出。

**GPT架构的另一个关键方面为预训练过程。**GPT模型最初是在大量无标签文本数据上进行训练,如书籍、文章和网站。在这个无监督的预训练阶段,模型学习根据前面的词语预测序列中的下一个词。这使模型能够发展出对语言结构、语法和语义的丰富理解。

然而,预训练后的GPT模型尚未针对对话或文本补全等特定任务进行优化。为了使模型适应这些目的,会采用微调过程。微调涉及使用针对目标任务的小型数据集对预训练模型进行再训练,比如针对ChatGPT的对话数据。

在微调期间,将调整模型的参数,以最大程度地减少特定任务的数据集上的误差。这一过程使模型能够学习目标任务特有的细微差别和模式,从而提高性能并实现更接近人类的互动。

“Transformer架构、自注意力机制、预训练以及微调过程的结合,使得GPT模型能够生成高质量、上下文相关的文本输出。“

这些架构选择构成了ChatGPT模型的基础,使它们能够进行自然对话、回答问题并协助完成多种语言相关任务。

在接下来的章节中,当我们探讨具体的ChatGPT模型时,请记住它们都共享这一共同架构,其差异主要体现在模型大小、训练数据和微调策略等因素上。

GPT-3.5:ChatGPT的基础

OpenAI于2020年发布的GPT-3.5是原始ChatGPT构建的基础语言模型。作为GPT模型家族的一员,GPT-3.5展示了在自然语言处理和生成方面的显著进步。

GPT-3.5的关键特性

- 提高语言理解能力:与前辈相比,GPT-3.5展现了对上下文、细微差别和语义的更深层次理解;

- 模型规模增大:拥有1750亿个参数,GPT-3.5是目前最大的语言模型之一,能够捕获更复杂的模式并生成更连贯的文本;

- 文本生成增强:GPT-3.5能跨多个领域生成类似人类的文本,从创意写作到技术文档。

ChatGPT对GPT-3.5的依赖

ChatGPT的基本模型建立在GPT-3.5架构之上。通过对GPT-3.5进行多领域对话数据的微调,ChatGPT发展出了与用户进行自然、情境感知对话的能力。

ChatGPT的成功可归因于其基础GPT-3.5模型的强项,包括上下文理解、广泛的知识库及适应性。GPT-3.5使ChatGPT能够通过理解对话的上下文,在整个对话过程中保持连贯性和相关性。GPT-3.5的大量预训练,让ChatGPT能够引用涵盖多种主题和领域的庞大知识库。

此外,GPT-3.5的架构有助于ChatGPT适应不同对话风格和用户偏好的能力。

GPT-3.5的局限与缺点

尽管功能强大,GPT-3.5并非没有局限。主要缺点包括:

- 缺乏推理能力:虽然GPT-3.5能够生成连贯且上下文相关的文本,但在需要逻辑推理或问题解决的任务上表现不佳;

- 偏差与不一致性:GPT-3.5可能展现出其训练数据中的偏差,并有时产生不一致或矛盾的回复;

- 有限的上下文窗口:GPT-3.5的最大输入大小为2,048个标记(约1,500个单词),这可能限制了它处理更长形式内容或在扩展对话中维持上下文的能力。

理解GPT-3.5的优势和局限对于在与ChatGPT及其他基于该模型的生成式AI应用交互时设定现实期望至关重要。尽管GPT-3.5显著推进了会话AI领域,但在推理、偏差缓解和上下文处理等方面仍有改进空间。

GPT-4:自然语言处理领域的一大飞跃

GPT-4标志着在自然语言处理能力上取得了重要进展。OpenAI于2023年发布的GPT-4,在继承前代优点的基础上,引入了新特性与改进。

GPT-4的关键特性

- 多模态能力:GPT-4最显著的增强之一是其跨多种模态处理和生成内容的能力。除了处理文本外,GPT-4还能分析和描述图像,为广泛的新应用和使用场景打开了大门;

- 增加上下文窗口:与GPT-3.5相比,GPT-4拥有显著更大的上下文窗口。能够处理多达25,000个标记(约17,000个词),使得GPT-4能应对更长篇幅的内容,并在长时间对话或文档中保持上下文连贯;

- 增强推理能力:GPT-4展现出提升的推理能力,使其在需要逻辑思维、问题解决和分析的任务上表现更佳。这一进步为GPT-4在科研、数据分析和决策支持等领域的应用开辟了新可能。

GPT-4对ChatGPT的影响

GPT-4的推出对ChatGPT及整个会话式AI领域产生了重大影响。

通过利用GPT-4的能力,ChatGPT能进行更加复杂且上下文敏感的对话,为用户提供更准确、相关的回复。

此外,GPT-4的多模态能力促进了结合语言理解和视觉感知的新应用开发。这在图像字幕生成、视觉问答和多模态内容创作方面带来更多激动人心的可能性。

应对局限性与伦理考量

尽管GPT-4带来了巨大进步,但必须认识到它并非解决语言模型所有局限性和挑战的万能药。研究人员和开发者需继续应对诸如偏见、不一致性及潜在滥用等问题。OpenAI强调了其对负责任AI开发的承诺,采取了如下措施:

- 改进防止生成有害或误导性内容的保护措施

- 与研究者和伦理学家合作,识别并减轻潜在风险

- 透明公开GPT-4的能力和局限

GPT-3.5与GPT-4详细对比

| 特征 | GPT-3.5 | GPT-4 | | 语言理解 | 展现出对上下文、细微差别及语义的深刻理解 | 具备逻辑思维、问题解决及分析能力 | | 模型规模 | 1750亿参数 | 1.76万亿参数(未确认) | | 文本生成 | 可以跨多个领域生成类似人类的文本 | 可以跨多种模式(文本、图像)处理和生成内容 | | 上下文窗口 | 最大输入2,048个令牌 | 上下文窗口显著增大,最多可达25,000个令牌,能处理更长篇幅的内容 | | 推理能力 | 缺乏推理能力 | 提高推理能力 |

GPT-4 Turbo:针对聊天应用优化

GPT-4 Turbo是GPT-4模型的变体,专为满足聊天应用的独特需求而设计。该模型结合了GPT-4的高级功能,并进行了优化,以提高其在对话环境中的性能和效率。

GPT-4 Turbo的关键特性

- 为聊天量身定做:GPT-4 Turbo经过大量对话数据的微调,使其在基于聊天的交互中能生成更加自然连贯的回复;

- 提升效率:通过架构和训练过程的优化,GPT-4 Turbo相比标准GPT-4模型提供了更快的响应时间和更低的计算成本;

- 增强上下文管理:GPT-4 Turbo设计用于更有效地处理对话的动态性,跨多轮对话保持上下文和连贯性。

GPT-4 Turbo在ChatGPT中的优势

GPT-4 Turbo的专业性为聊天应用带来多方面的好处:

- 成本效益:通过降低计算需求,GPT-4 Turbo使得开发者能够构建、运营和扩展成本更低的聊天应用程序;

- 改善用户体验:凭借更快的响应速度和更具上下文相关性的输出,GPT-4 Turbo提升了基于聊天交互的总体用户体验;

- 可扩展性:GPT-4 Turbo的优化使其非常适合处理高并发量的对话,使聊天应用能够无缝扩展。

GPT-5会有多强大?

OpenAI已确认正在积极研发GPT-5,尽管关于GPT-5的具体细节仍然有限,但早期迹象表明,它将带来显著的改进和新功能。

GPT-5可能的功能改进:

- 进一步扩大上下文窗口,以支持更长形式的内容理解和生成

- 高级多轮对话处理能力,实现更加自然流畅的对话

- 增强推理和问题解决能力,拓展语言模型的能力边界

此外,有传言称GPT-5可能会引入视频处理能力,使其多媒体处理能力从文本和图像扩展到视频。这可能在视频分析、生成及交互等领域开辟新的前沿。像ChatGPT这样的语言模型迅速发展,重新点燃了关于实现通用人工智能(AGI)可能性的讨论——这是一种假设的AI系统能力,能够理解并学习任何人类可以完成的知识性任务。

FAQ

Q:我应该使用哪个ChatGPT模型?

A:您选择ChatGPT模型应依据您的特定需求、预算和技术能力。GPT-3.5适用于通用场景,而GPT-4则提供了更高级的功能和多模态支持。GPT-4 Turbo针对聊天应用优化,平衡了性能与效率。

Q:ChatGPT-4使用的是什么模型?

A:ChatGPT-4基于GPT-4语言模型,这是OpenAI开发的GPT系列中最先进的模型。相比于其前辈GPT-3.5,GPT-4在多模态能力、增强推理及更大的上下文窗口等方面有显著提升。

Q:GPT-5即将到来吗?

A:是的,OpenAI已确认正在积极开发GPT-5,作为GPT-4模型的继任者。尽管具体细节有限,GPT-5预计将在上下文理解、对话能力方面带来进一步的进展,甚至可能包含视频处理能力。

Q:哪个GPT模型最好?

A:这取决于你的应用场景和需求。就目前而言,GPT-4提供了最先进的功能,而GPT-3.5则是通用及聊天应用场景下更经济实惠的选择。

如有侵权,请联系删除。参考链接: https://www.techopedia.com/chatgpt-models-guide

关注我们

“可信 AI 进展 “ 公众号致力于最新可信人工智能技术的传播和开源技术的培育,覆盖大规模图学习,因果推理,知识图谱,大模型等技术领域,欢迎扫码关注,解锁更多 AI 资讯~