作者:离散木木夕

欢迎大家给出宝贵的建议!

哪些机器学习算法不需要做归一化

哪些机器学习算法不需要做归一化?

概率模型(树形模型)不需要归一化,因为它们不关心变量的值,而是关心变量的分布和变量之间的条件概率,如决策树、RF。而像Adaboost、SVM、LR、Knn、KMeans之类的最优化问题就需要归一化。

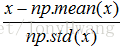

标准化:特征均值为0,方差为1

公式:

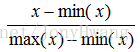

归一化:把每个特征向量(特别是奇异样本数据)的值都缩放到相同数值范围。如[0,1]或[-1,1]。最常用的归一化形式就是将特征向量调整为L1范数(就是绝对值相加),使特征向量的数值之和为1。L2范数就是欧几里得之和。

data_normalized = preprocessing.normalize( data , norm="L1" )

公式:

这个方法经常用于确保数据点没有因为特征的基本性质而产生较大差异,即确保数据处于同一数量级(同一量纲),提高不同特征数据的可比性。