一、逻辑回归二分类

1.1、Hypothesis Representation

与线性回归的区别是将预测函数换成了

,即将预测值的范围限制在了0-1之间,以便于二值分类,sigmoid函数如下图:

标题:sigmoid函数

标题:sigmoid函数

其中预测函数的实质是给出了输出为1的可能性,例如

代表输出为1的可能性为70%。

1.2、Decision Boundary

为了处理0-1分类问题,我们可以将hypothesis function 转换为:

即:

可以看出此时的 Decision Boundary便是超平面 ,Decision Boundary的作用便是认为分割为 y = 0 和 y = 1的区域。

例:

此时我们的decision boundary是一条垂直线,在直线右侧 y = 1,直线左侧 y = 0。

注意:的参数

不一定必须为线性的,也可以为非线性的,以拟合非线性的情况,如圆:(e.g.

)

1.3、Cost Function

模型:

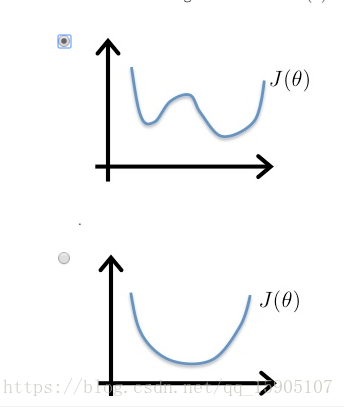

说明:逻辑回归的cost function不能写成线性回归那样,由于

,是非线性的,会使得

存在波动波动,使得cost最小化时,有多个局部最优解,即不是(convex function)凸函数,不能得到最优的参数

如图:

设计logistic Cost Function

当 y=1时,得

当 y = 0 时,

使用这个方法可以保证cost function是凸函数

1.3.1、Simplified Cost Function and Gradient Descent

将y=0和y=1合并在一起,结果如下:

完整的 m 个样本的cost为:

向量化:

1.4、Gradient Descent

由:

得:

向量化:

二、多分类问题(one-vs-all)

2.1、模型

此时标签有多个,有prediction function

对于多分类问题,我们通常先选定一类,然后将其它的类均归为第二类,将多分类问题转化为二分类问题。然后循环所有类,然后将最高的作为多分类的预测值。

例:有三个classes

2.2、过拟合

解决办法:

1) Reduce the number of features:

- Manually select which features to keep.

- Use a model selection algorithm (studied later in the course).

2) Regularization

- Keep all the features, but reduce the magnitude of parameters \theta_jθj.

- Regularization works well when we have a lot of slightly useful features.

2.2.1、正则化(Regularization)

线性回归:

正则化后的cost function:

其中λ是个超参数,需要手动调节

正则化后的Gradient Descent:

其中 正则化项。

逻辑回归:

正则化后的cost function:

其中 即为正则化项

参考:吴恩达老师:机器学习