版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/tyhj_sf/article/details/54134210

转载请注明出处:http://blog.csdn.net/tyhj_sf/article/details/54134210

声明:

(1)该博文为个人学习总结,部分内容(包括数学公式)是来自书籍及网上的资料。具体引用的资料请看参考文献。具体的版本声明也参考原文献。

(2)本文仅供学术交流,非商用。所以每一部分具体的参考资料并没有详细对应,更有些部分本来就是直接从其他博客复制过来的。如果某部分不小心侵犯了大家的版权,还望海涵,并联系本人删除或修改。

引言

最近谷歌升级版AlphaGo打败众多国内外围棋高手,那狗又火了一把,再次引起大家的关注。作为一个对技术有追求的人,嗯,是时候好好学习当前最火的人工智能与机器学习的相关技术了。学习一项技术,仅仅了解其技术原理是远远不够的,从技术实践中建立感性认识,才能对技术原理有深入的理解。因此,本文先介绍神经网络基本原理,后面系列文章将详细介绍神经网络的成熟算法及网络结构(比如:BP神经网络、RBF、CNN等)并编程实现之。

神经元模型

以监督学习为例,假设我们有训练样本集

(x(i),y(i)

) ,那么神经网络算法能够提供一种复杂且非线性的假设模型

hW,b(x)

,它具有参数

W,b

,可以以此参数来拟合我们的数据。

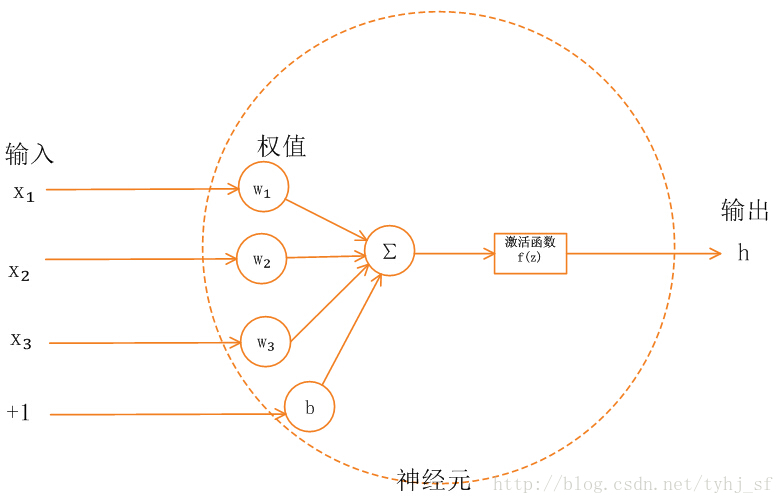

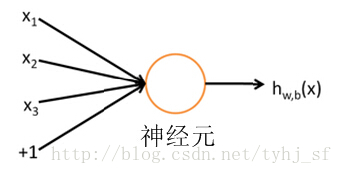

为了描述神经网络,我们先从最简单的神经网络讲起,这个神经网络仅由一个“神经元”构成,以下即是这个“神经元”的图示

后文我们会介绍有多个神经元的神经网络,因此单个神经元模型我们后面会简化成如下图:

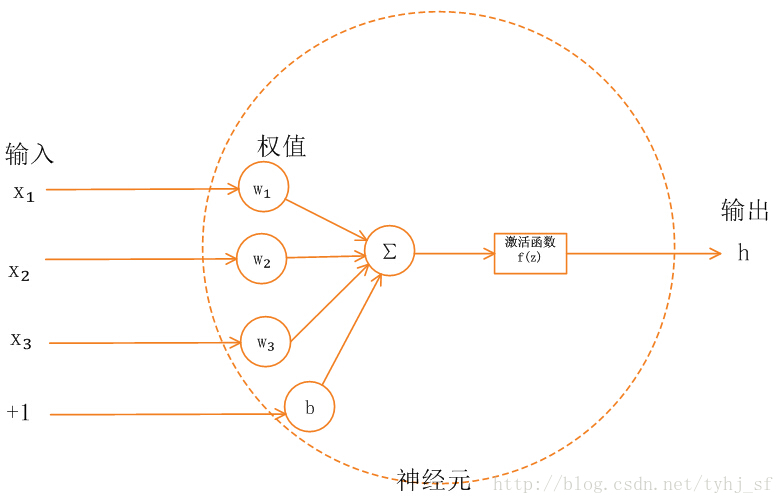

这个“神经元”是一个以

x1,x2,x3

及截距

+1

为输入值的运算单元,其输出为

hW,b(x)=f(WTx)=f(∑3i=1Wixi+b)

,其中函数

f:R↦R

被称为“激活函数”。在本教程中,我们选用sigmoid函数作为”激活函数”

f(⋅)

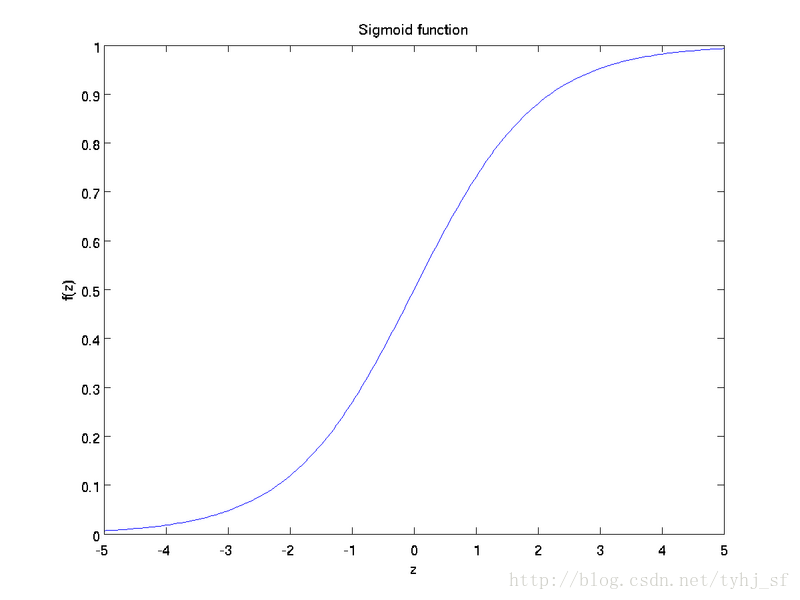

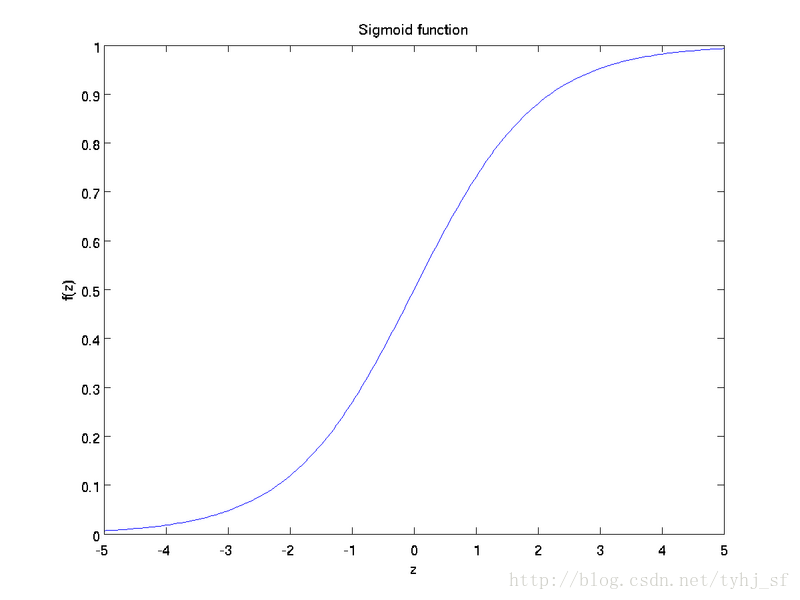

sigmoid函数:

f(z)=11+exp(−z).

sigmoid函数图像如下:

可以看出,这个单一“神经元”的输入-输出映射关系其实就是一个逻辑回归(logistic regression)。

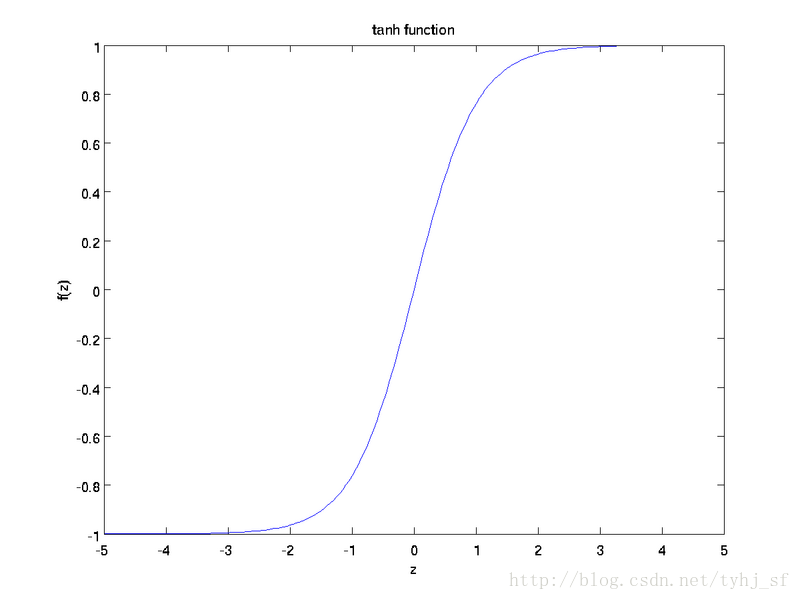

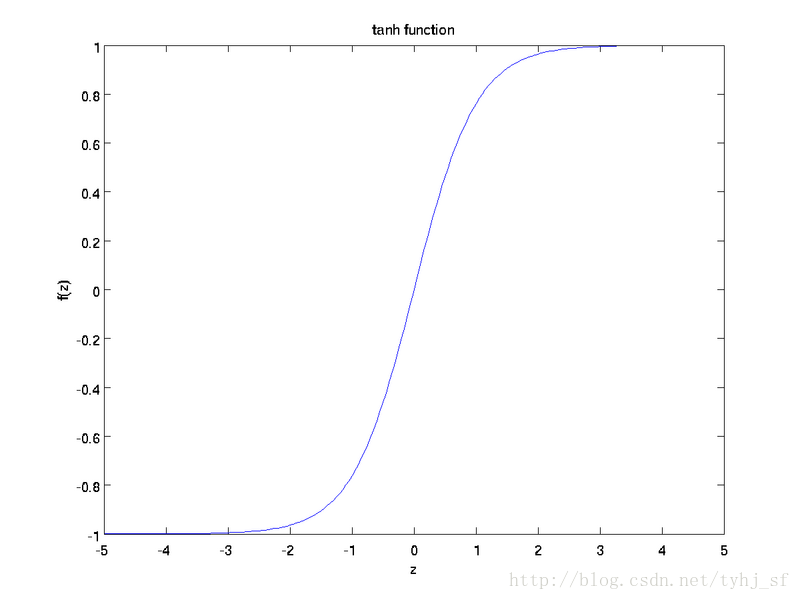

虽然本系列教程采用sigmoid函数,但你也可以选择双曲正切函数(tanh).

tanh函数:

f(z)=tanh(z)=ez−e−zez+e−z,

tanh函数的图像如下:

tanh(z)

tanh(z)

函数是sigmoid函数的一种变体,它的取值范围为

[−1,1]

,而不是sigmoid函数的

[0,1]

。

注意,这里我们不再令

x0=1

。取而代之,我们用单独的参数

b

来表示截距。

最后要说明的是,有一个等式我们以后会经常用到:如果选择

f(z)=1/(1+exp(−z))

,也就是sigmoid函数,那么它的导数就是

f′(z)=f(z)(1−f(z))

(如果选择tanh函数,那它的导数就是

f′(z)=1−(f(z))2

,你可以根据sigmoid(或tanh)函数的定义自行推导这个等式。

神经网络模型

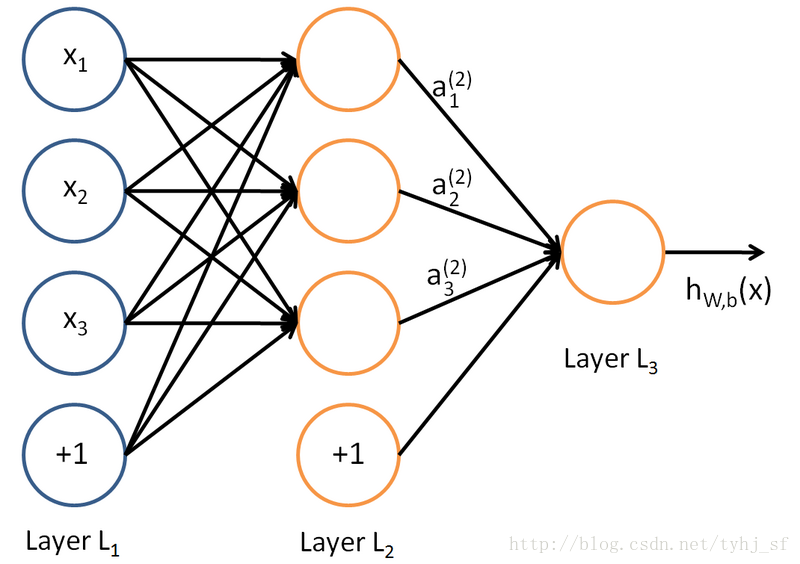

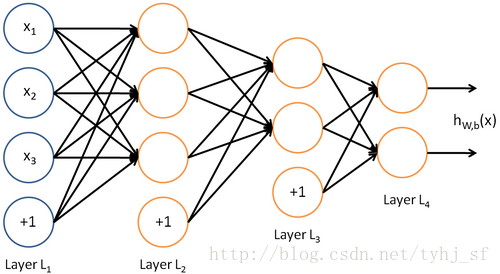

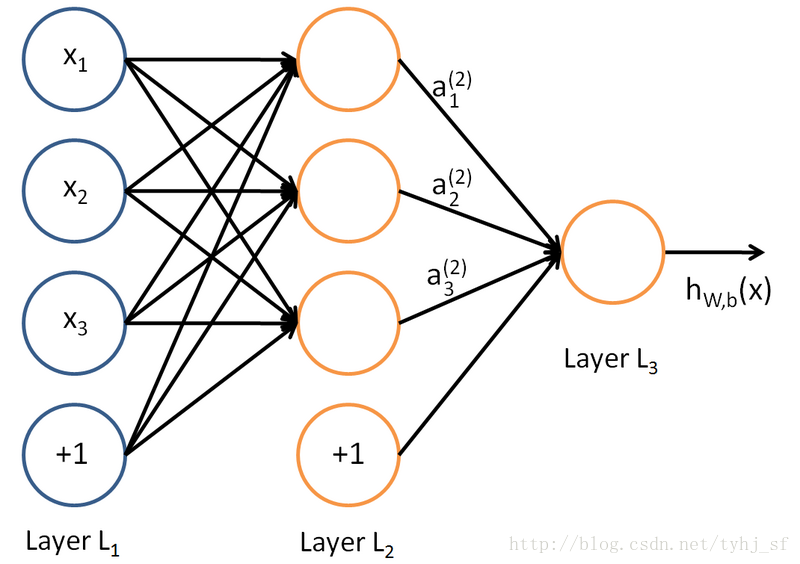

所谓神经网络就是将许多个单一“神经元”联结在一起,这样,一个“神经元”的输出就可以是另一个“神经元”的输入。例如,下图就是一个简单的神经网络:

我们使用蓝色圆圈来表示神经网络的输入,标上“

+1

”的圆圈被称为”’偏置节点”’,也就是截距项。神经网络最左边的一层叫做”’输入层”’,最右的一层叫做”’输出层”’(本例中,输出层只有一个节点)。中间所有节点组成的一层叫做”’隐藏层”’,因为我们不能在训练样本集中观测到它们的值。同时可以看到,以上神经网络的例子中有3个”’输入单元”’(偏置单元不计在内),3个”’隐藏单元”’及一个”’输出单元”’。

本例约定:

(1)我们用

nl

来表示网络的层数,本例中

nl=3

。

(2)我们将第

l

层记为

Ll

,于是

L1

是输入层,输出层是

Lnl

。

(3)本例神经网络有参数

(W,b)=(W(1),b(1),W(2),b(2))

,其中

W(l)ij

(下面的式子中用到)是第

l

层第

j

单元与第

l+1

层第

i

单元之间的联接参数(其实就是连接线上的权重,注意标号顺序),

b(l)i

是第

l+1

层第

i

单元的偏置项。因此在本例中,

W(1)∈R3×3

,

W(2)∈R1×3

。注意,没有其他单元连向偏置单元(即偏置单元没有输入),因为它们总是输出

+1

。同时,我们用

sl

表示第

l

层的节点数(偏置单元不计在内)。

(4)我们用

a(l)i

表示第

l

层第

i

单元的”’激活值”’(输出值)。当

l=1

时,

a(1)i=xi

,也就是第

i

个输入值(输入值的第

i

个特征)。对于给定参数集合

W,b

,我们的神经网络就可以按照函数

hW,b(x)

来计算输出结果。本例神经网络的计算步骤如下:

a(2)1a(2)2a(2)3hW,b(x)=f(W(1)11x1+W(1)12x2+W(1)13x3+b(1)1)=f(W(1)21x1+W(1)22x2+W(1)23x3+b(1)2)=f(W(1)31x1+W(1)32x2+W(1)33x3+b(1)3)=a(3)1=f(W(2)11a(2)1+W(2)12a(2)2+W(2)13a(2)3+b(2)1)

(5)我们用

z(l)i

表示第

l

层第

i

单元输入加权和(包括偏置单元),比如,

z(2)i=∑nj=1W(1)ijxj+b(1)i

,则

a(l)i=f(z(l)i)

。

这样我们就可以得到一种更简洁的表示法。这里我们将激活函数

f(⋅)

扩展为用向量(分量的形式)来表示,即

f([z1,z2,z3])=[f(z1),f(z2),f(z3)]

,那么,上面的等式可以更简洁地表示为:

z(2)a(2)z(3)hW,b(x)=W(1)x+b(1)=f(z(2))=W(2)a(2)+b(2)=a(3)=f(z(3))

我们将上面的计算步骤叫作”前向传播(forward propagation)”。回想一下,之前我们用

a(1)=x

表示输入层的激活值,那么给定第

l

层的激活值

a(l)

后,第

l+1

层的激活值

a(l+1)

就可以按照下面步骤计算得到:

:

z(l+1)a(l+1)=W(l)a(l)+b(l)=f(z(l+1))

将参数矩阵化,使用矩阵-向量运算方式,我们就可以利用线性代数的优势对神经网络进行快速求解。

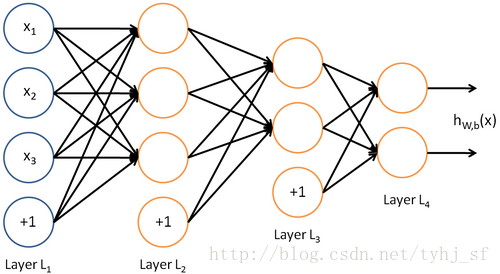

目前为止,我们讨论了一种神经网络,我们也可以构建另一种”结构”的神经网络(这里结构指的是神经元之间的联接模式),也就是包含多个隐藏层的神经网络。最常见的一个例子是

nl

层的神经网络,第

1

层是输入层,第

nl

层是输出层,中间的每个层

l

与层

l+1

紧密相联。这种模式下,要计算神经网络的输出结果,我们可以按照之前描述的等式,按部就班,进行前向传播,逐一计算第

L2

层的所有激活值,然后是第

L3

层的激活值,以此类推,直到第

Lnl

层。这是一个”’前馈”’神经网络的例子,因为这种联接图没有闭环或回路。

复杂一点儿的神经网络也可以有多层隐藏层和多个输出单元。比如,下面的神经网络有两层隐藏层:

L2

及

L3

,输出层

L4

有两个输出单元。

要求解这样的神经网络,需要样本集

(x(i),y(i))

,其中

y(i)∈R2

。如果你想预测的输出是多个的,那这种神经网络很适用。(比如,在医疗诊断应用中,患者的体征指标就可以作为向量的输入值,而不同的输出值

yi

可以表示不同的疾病存在与否。)

题外话,数学公式的编辑真是个非常坑爹的事情……….

参考资料:

(1)《人工智能:一种现代的方法》第二版.

(2)UFLDL.