下载

hadoop官网是:Hadoop.apache.org

直接打开这个链接即可下载最新稳定版,我下载到的是hadoop-2.9的

安装

1.我就准备用上两台机子吧;

| namenode | 192.168.27.131 |

| datanode | 192.168.27.131 |

| datanode | 192.168.27.128 |

2.关掉防火墙:service iptables stop

3.hosts修改

vi /etc/hosts

4.安装hadoop

4.1上传我们下载的hadoop-2.9.0.tar.gz到/usr/local/hadoop

4.2解压缩文件

tar -zxvf hadoop-2.9.0.tar.gz4.3重命名文件夹

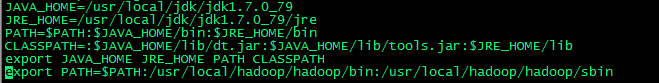

mv hadoop-2.9.0 hadoop4.4配置Hadoop环境变量

修改文件 vi /etc/profile 追加内容

export PATH=$PATH:/usr/local/hadoop/bin:/usr/local/hadoop/sbin

source /etc/profile 重新加载配置

4.5修改Hadoop的jre位置

vi hadoop-env.sh

说明:这里是jdk的安装路径

5.配置namenode

5.1修改core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://CentOS04:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/var/hadoop</value>

</property>

</configuration>

5.2在namenode上格式化hdfs

hadoop namenode -format

5.3启动hdfs的namenode

hadoop-daemon.sh start namenode

通过jps命令可以查看

说明:这个jps是jdk的工具,需要环境变量中配置jdk即可,上面我们已经配置了

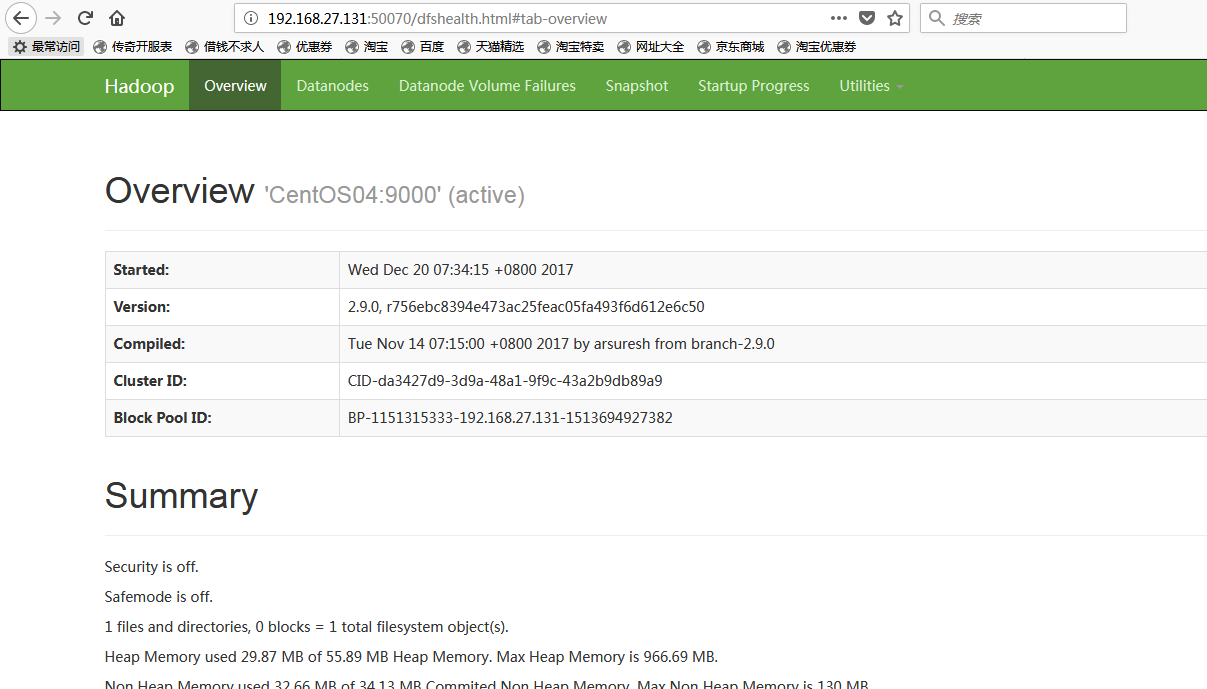

5.4测试namenode

用浏览器打开namenode的50070端口

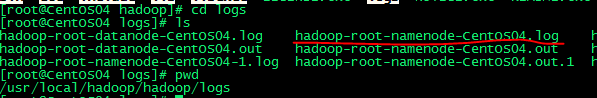

如果访问不到可以到日志文件查看报错信息:

6.Datanode配置

以上操作之后其实也已经算是有了datanode,也就是本机也是有datanode

我们可以通过如下命令进行启动:

hadoop-daemon.sh start datanode

ok!这样表示成功,当然我们还需要再配置一台datanode来集群

很简单,把Hadoop安装目录文件夹拷贝到集群中其他机器上,也就是128这台机子上

scp -r hadoop CentOS01:/`pwd`这样再启动datanode即可;也可以是使用start-dfs.sh一键启动,这样启动是整个集群,不需要一台一台去启动

当然128这台也需要修改下hosts和环境变量profile,和上面一样即可

补充:hadoop集群其实也就是hdfs的集群