一 spark简介

Spark是基于内存计算的大数据分布式计算框架。Spark基于内存计算,提高了在大数据环境下数据处理的实时性,同时保证了高容错性和高可伸缩性,允许用户将Spark部署在大量廉价硬件之上,形成集群。

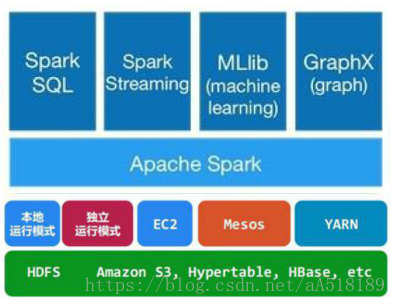

二架构及生态介绍:

通常当需要处理的数据量超过了单机尺度(比如我们的计算机有4GB的内存,而我们需要处理100GB以上的数据)这时我们可以选择spark集群进行计算,有时我们可能需要处理的数据量并不大,但是计算很复杂,需要大量的时间,这时我们也可以选择利用spark集群强大的计算资源,并行化地计算,其架构示意图如下:

Spark Core:包含Spark的基本功能;尤其是定义RDD的API、操作以及这两者上的动作。其他Spark的库都是构建在RDD和Spark Core之上的

Spark SQL:提供通过Apache Hive的SQL变体Hive查询语言(HiveQL)与Spark进行交互的API。每个数据库表被当做一个RDD,Spark SQL查询被转换为Spark操作。

Spark Streaming:对实时数据流进行处理和控制。Spark Streaming允许程序能够像普通RDD一样处理实时数据

MLlib:一个常用机器学习算法库,算法被实现为对RDD的Spark操作。这个库包含可扩展的学习算法,比如分类、回归等需要对大量数据集进行迭代的操作。

GraphX:控制图、并行图操作和计算的一组算法和工具的集合。GraphX扩展了RDD API,包含控制图、创建子图、访问路径上所有顶点的操作

三 学习spark的原因

Spark扩展了广泛使用的MapReduce计算模型,其中Spark有个Directed Acyclic Graph(DAG有向无环图)执行引擎,支持循环数据流和内存计算。Hadoop是磁盘级计算,进行计算时,都需要从磁盘读或者写数据,同时整个计算模型需要网络传输,导致MapReduce具有高延迟的致命弱点。据统计,基于Spark内存的计算速度比Hadoop MapReduce快100倍以上,基于磁盘的计算速度也要快10倍以上

四 Spark优点

1.运算效率高

Spark把中间数据放到内存中,迭代运算效率高。MapReduce中计算结果需要落地,保存到磁盘上,这样势必会影响整体速度,而Spark支持DAG图的分布式并行计算的编程框架,减少了迭代过程中数据的落地,提高了处理效率。(延迟加载)

2.容错性高

Spark引进了弹性分布式数据集RDD (Resilient Distributed Dataset) 的抽象,它是分布在一组节点中的只读对象集合,这些集合是弹性的,如果数据集一部分丢失,则可以根据“血统”(即允许基于数据衍生过程)对它们进行重建。另外在RDD计算时可以通过CheckPoint来实现容错。

z

3.Spark更加通用。不像Hadoop只提供了Map和Reduce两种操作,Spark提供的数据集操作类型有很多种,大致分为:Transformations和Actions两大类。Transformations包括Map、Filter、FlatMap、Sample、GroupByKey、ReduceByKey、Union、Join、Cogroup、MapValues、Sort等多种操作类型,同时还提供Count, Actions包括Collect、Reduce、Lookup和Save等操作。

4.支持的运算平台,支持的开发语言更多。

spark 4 种开发语言:

scala,java,python,R

Spark是MapReduce的替代方案,而且兼容HDFS、Hive,可融入Hadoop的生态系统,以弥补MapReduce的不足。

hdfs,yarn

五 Spark特点

快

与Hadoop的MapReduce相比,Spark基于内存的运算要快100倍以上,基于硬盘的运算也要快10倍以上。Spark实现了高效的DAG执行引擎,可以通过基于内存来高效处理数据流。

易用

Spark支持Java、Python和Scala和R的API,还支持超过80种高级算法,使用户可以快速构建不同的应用。而且Spark支持交互式的Python和Scala的shell,可以非常方便地在这些shell中使用Spark集群来验证解决问题的方法。

通用

一站式解决方案

storm

Spark提供了统一的解决方案。Spark可以用于批处理、交互式查询(Spark SQL)、实时流处理(Spark Streaming)、机器学习(Spark MLlib)和图计算(GraphX)。这些不同类型的处理都可以在同一个应用中无缝使用。Spark统一的解决方案非常具有吸引力,毕竟任何公司都想用统一的平台去处理遇到的问题,减少开发和维护的人力成本和部署平台的物力成本。

兼容性

Spark可以非常方便地与其他的开源产品进行融合。比如,Spark可以使用Hadoop的YARN和Apache Mesos作为它的资源管理和调度器,并且可以处理所有Hadoop支持的数据,包括HDFS、HBase和Cassandra等。这对于已经部署Hadoop集群的用户特别重要,因为不需要做任何数据迁移就可以使用Spark的强大处理能力。Spark也可以不依赖于第三方的资源管理和调度器,它实现了Standalone作为其内置的资源管理和调度框架,这样进一步降低了Spark的使用门槛,使得所有人都可以非常容易地部署和使用Spark。此外,Spark还提供了在EC2上部署Standalone的Spark集群的工具。

六 spark集群安装

下载Spark安装包

注意:安装spark时,无需安装scala jdk 必须要 jdk1.8以上

上传spark-安装包到Linux上

解压安装包到指定位置

# tar -zxvf spark-2.2.0-bin-hadoop2.7.tgz -C apps/

Spark安装包目录结构:

bin 可执行脚本 conf 配置文件 data 示例程序使用数据 examples示例程序 jars依赖jar包 LICENSE licenses NOTICE pythonpythonAPI RR语言API README.md RELEASE sbin集群管理命令 |

机器部署

准备4台Linux服务器,安装好JDK,最低要求2台

hdp-01 192.168.8.11

hdp-02 192.168.8.12

hdp-03 192.168.8.13

hdp-04 192.168.8.14

master:hpd-01

workers: hdp-02 hdp-03 hdp-04

部署standalone集群

确保集群中各节点的防火墙是关闭的。

查看防火墙状态 # service iptables status 关闭防火墙 # service iptables stop 永久关闭防火墙 # chkconfig iptables off |

确保主节点到各从节点的免密登录配置好了

从Master节点到worker节点的免密登录

在master机器上执行: # ssh-keygen # for i in 2 3 4; do ssh-copy-id hdp-0$i; done |

进入到Spark安装目录

注意是 spark-2.2.0-bin-hadoop2.7

不是spark-2.2.0

# cd apps/ spark-2.2.0-bin-hadoop2.7

进入conf目录并重命名并修改spark-env.sh.template文件

# cd conf/

# mv spark-env.sh.template spark-env.sh

# vim spark-env.sh

在该配置文件中添加如下配置

export JAVA_HOME=/usr/local/jdk export SPARK_MASTER_HOST=wangzhihua1 export SPARK_MASTER_PORT=7077 |

保存退出

重命名并修改slaves.template文件

# mv slaves.template slaves

# vim slaves

思考?为什么要修改slaves配置文件

在该文件中添加子节点所在的位置(Worker节点)

wangzhihua2 Wangzhihua3 Wangzhihua4 |

最好把localhost删了,不然主节点也是自己的从节点

保存退出

将配置好的Spark文件夹拷贝到其他节点上

单独拷贝:

# scp -r /root/apps/spark-2.2.0-bin-hadoop2.7/ hdp-02:/root/apps/

批量拷贝:

# cd /root/apps # for i in {2..4};do scp -r spark-2.2.0-bin-hadoop2.7 hdp-0$i:$PWD ;done |

Spark集群配置完毕,目前是1个Master,3个Worker,在Master(hdp-01)上启动Spark集群

1.1.1. 启停操作

单独启动master(在master安装节点上):

# start-master.sh

单独启动worker:

在每一台worker节点上执行:

start-slave.sh spark://wangzhihua1:7077

启动众worker(在Master所在节点上执行)

# start-slaves.sh

这里获取的是是slaves文件中的主机名

分别停止:

# stop-slaves.sh

# stop-master.sh

批量脚本启动:

# start-all.sh

停止:

# stop-all.sh

为了能方便使用,配置一下环境变量:

export SPARK_HOME=/root/apps/spark-2.2.0-bin-hadoop2.7

$SPARK_HOME/sbin

配置环境变量的注意事项:

hadoop/sbin的目录和spark/sbin可能会有命令冲突:

start-all.sh stop-all.sh

我们可以给其中一个启动命令进制重命名

启动后执行jps命令,主节点上有Master进程,其他子节点上有Worker进程,

登录Spark管理界面查看集群状态(主节点):http://wangzhihua1:8080/

查看机器内存的命令: free -m

默认情况下:spark会占用机器上的所有cores,

memory呢,会默认的使用ram – 1G

默认配置:

http://spark.apache.org/docs/latest/spark-standalone.html

到此为止,Spark集群安装完毕。