背景信息

本文实现英文文本词频统计,功能与Mapreduce中的wordcount是类似的。本文主要是为之后词向量训练做准备工作。

本地实现词频统计函数,输入一个文本文件,最终以dict的形式返回词频统计信息。

说明:如果输入为英文文本,则可以直接处理;如果是中文文本,则需要先进行分词等预处理工作。

详细代码

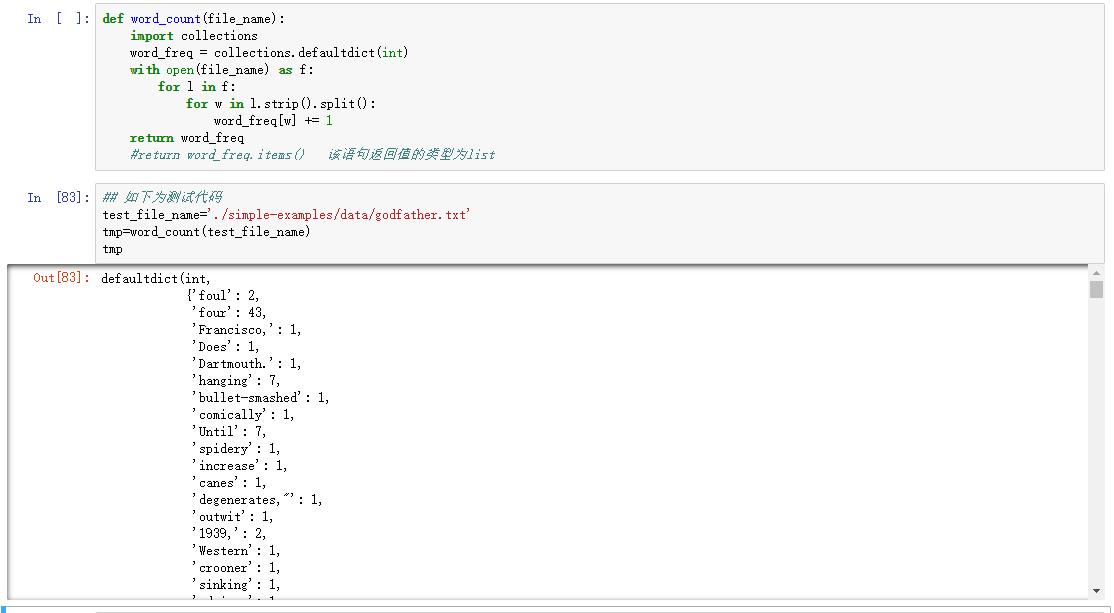

def word_count(file_name):

import collections

word_freq = collections.defaultdict(int)

with open(file_name) as f:

for l in f:

for w in l.strip().split():

word_freq[w] += 1

return word_freq

#return word_freq.items() 该语句返回值的类型为list

strip()删除空白符(包括'/n', '/r','/t');split()以空格分割字符串

- 输入参数——file_name: 表示输入文件名,类型String

- 返回值:返回值为dict,注释行则可以返回list类型的值。

测试示例

如下示例在Jupyter Notebook中实现,输入文件为《教父》英文小说,通过上述函数统计出每个单词出现的概率。