Python OpenCV这个初级图像处理系列是参考他人的文章写的,有些地方做了一些改动,没有太多理论,侧重代码实现,主要目的是将这些基本操作代码系统地梳理一遍,也是为了以后能快速查找。

此系列源码在我的GitHub里:https://github.com/yeyujujishou19/Python-OpenCV

一,Sobel算子

Sobel算子依然是一种过滤器,只是其是带有方向的。在Python-OpenCV中,使用Sobel的算子的函数原型如下:

dst = cv2.Sobel(src, ddepth, dx, dy[, dst[, ksize[, scale[, delta[, borderType]]]]])前四个是必须的参数:

第一个参数是需要处理的图像;

第二个参数是图像的深度,-1表示采用的是与原图像相同的深度。目标图像的深度必须大于等于原图像的深度;

dx和dy表示的是求导的阶数,0表示这个方向上没有求导,一般为0、1、2。

其后是可选的参数:

dst不用解释了;

ksize是Sobel算子的大小,必须为1、3、5、7。

scale是缩放导数的比例常数,默认情况下没有伸缩系数;

delta是一个可选的增量,将会加到最终的dst中,同样,默认情况下没有额外的值加到dst中;

borderType是判断图像边界的模式。这个参数默认值为cv2.BORDER_DEFAULT。

代码:

# coding=utf-8

import cv2

import numpy as np

img = cv2.imread("D:/test/26.png", 0)

'''

在Sobel函数的第二个参数这里使用了cv2.CV_16S。

因为OpenCV文档中对Sobel算子的介绍中有这么一句:

“in the case of 8-bit input images it will result in truncated derivatives”。

即Sobel函数求完导数后会有负值,还有会大于255的值。

而原图像是uint8,即8位无符号数,所以Sobel建立的图像位数不够,会有截断。

因此要使用16位有符号的数据类型,即cv2.CV_16S。

在经过处理后,别忘了用convertScaleAbs()函数将其转回原来的uint8形式。

否则将无法显示图像,而只是一副灰色的窗口。convertScaleAbs()的原型为:

dst = cv2.convertScaleAbs(src[, dst[, alpha[, beta]]])

其中可选参数alpha是伸缩系数,beta是加到结果上的一个值。结果返回uint8类型的图片。

由于Sobel算子是在两个方向计算的,最后还需要用cv2.addWeighted(...)函数将其组合起来。

其函数原型为:

dst = cv2.addWeighted(src1, alpha, src2, beta, gamma[, dst[, dtype]])

其中alpha是第一幅图片中元素的权重,beta是第二个的权重,gamma是加到最后结果上的一个值。

'''

x = cv2.Sobel(img, cv2.CV_16S, 1, 0)

y = cv2.Sobel(img, cv2.CV_16S, 0, 1)

absX = cv2.convertScaleAbs(x)# 转回uint8

absY = cv2.convertScaleAbs(y)

dst = cv2.addWeighted(absX, 0.5, absY, 0.5, 0)

cv2.imshow("orign", img)

cv2.imshow("absX", absX)

cv2.imshow("absY", absY)

cv2.imshow("Result", dst)

cv2.waitKey(0)

cv2.destroyAllWindows()

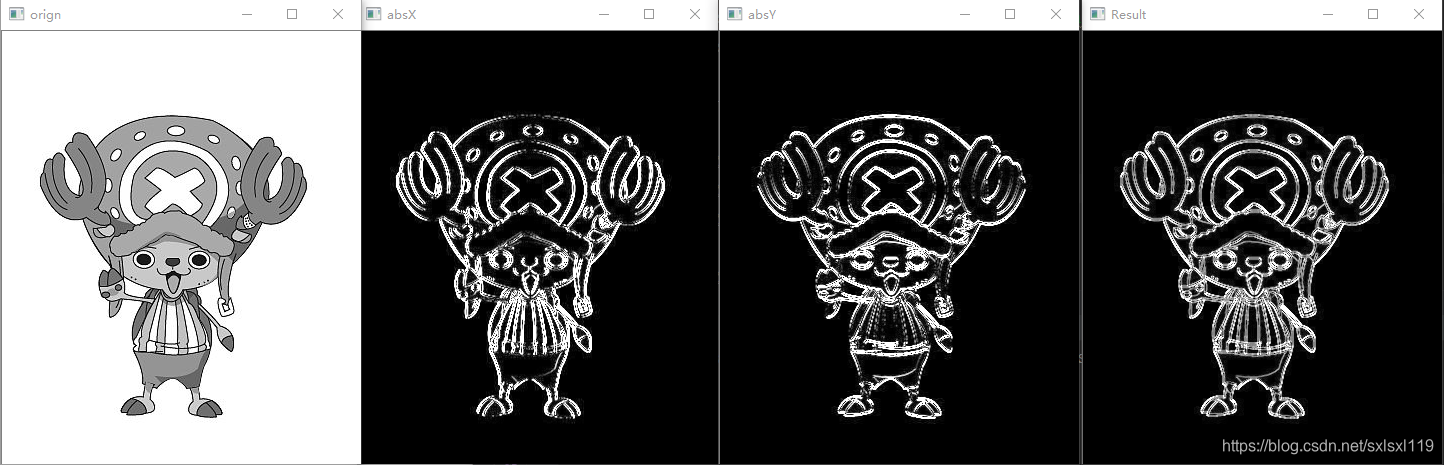

代码结果:

二,Laplacian算子

原理:

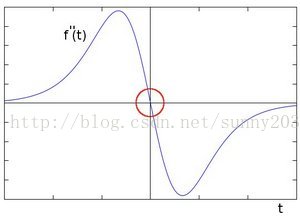

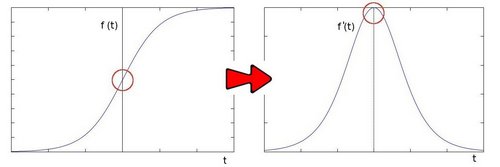

图像中的边缘区域,像素值会发生“跳跃”,对这些像素求导,在其一阶导数在边缘位置为极值,这就是Sobel算子使用的原理——极值处就是边缘。如下图(下图来自OpenCV官方文档):

如果对像素值求二阶导数,会发现边缘处的导数值为0。如下(下图来自OpenCV官方文档):

Laplace函数实现的方法是先用Sobel 算子计算二阶x和y导数,再求和:

在OpenCV-Python中,Laplace算子的函数原型如下:

dst = cv2.Laplacian(src, ddepth[, dst[, ksize[, scale[, delta[, borderType]]]]])前两个是必须的参数:

第一个参数是需要处理的图像;

第二个参数是图像的深度,-1表示采用的是与原图像相同的深度。目标图像的深度必须大于等于原图像的深度;

其后是可选的参数:

dst不用解释了;

ksize是算子的大小,必须为1、3、5、7。默认为1。

scale是缩放导数的比例常数,默认情况下没有伸缩系数;

delta是一个可选的增量,将会加到最终的dst中,同样,默认情况下没有额外的值加到dst中;

borderType是判断图像边界的模式。这个参数默认值为cv2.BORDER_DEFAULT。

代码:

# coding=utf-8

import cv2

import numpy as np

img = cv2.imread("D:/test/26.png", 0)

gray_lap = cv2.Laplacian(img, cv2.CV_16S, ksize=3)

dst = cv2.convertScaleAbs(gray_lap) # 转回uint8

cv2.imshow("orign", img)

cv2.imshow('laplacian', dst)

cv2.waitKey(0)

cv2.destroyAllWindows()

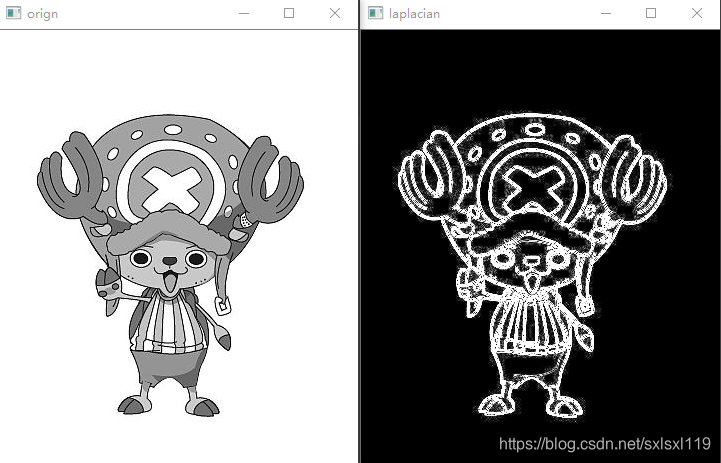

代码结果:

三,Canny算子

函数:

OpenCV-Python中Canny函数的原型为:

edge = cv2.Canny(image, threshold1, threshold2[, edges[, apertureSize[, L2gradient ]]]) 必要参数:

第一个参数是需要处理的原图像,该图像必须为单通道的灰度图;

第二个参数是阈值1;

第三个参数是阈值2。

其中较大的阈值2用于检测图像中明显的边缘,但一般情况下检测的效果不会那么完美,边缘检测出来是断断续续的。所以这时候用较小的第一个阈值用于将这些间断的边缘连接起来。

可选参数中apertureSize就是Sobel算子的大小。而L2gradient参数是一个布尔值,如果为真,则使用更精确的L2范数进行计算(即两个方向的倒数的平方和再开放),否则使用L1范数(直接将两个方向导数的绝对值相加)。

函数返回一副二值图,其中包含检测出的边缘。

代码一:

# coding=utf-8

import cv2

import numpy as np

img = cv2.imread("D:/test/26.png", 0)

'''

由于Canny只能处理灰度图,所以将读取的图像转成灰度图。

用高斯平滑处理原图像降噪。

调用Canny函数,指定最大和最小阈值,其中apertureSize默认为3。

'''

img = cv2.GaussianBlur(img, (3, 3), 0)

canny = cv2.Canny(img, 50, 150)

cv2.imshow("orign", img)

cv2.imshow('Canny', canny)

cv2.waitKey(0)

cv2.destroyAllWindows()

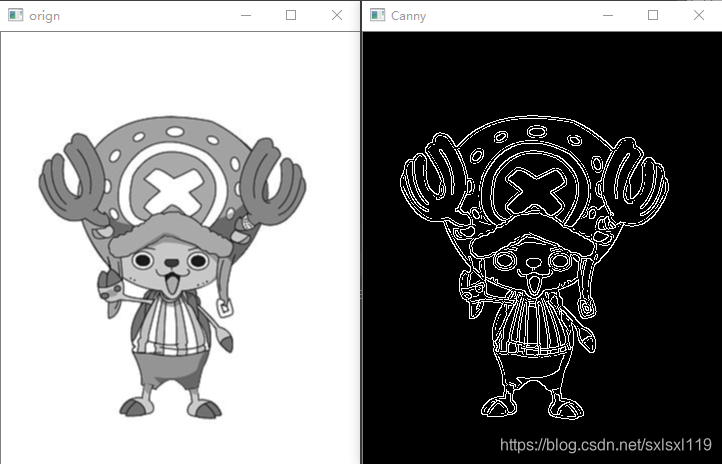

代码一结果:

代码二:

在运行时调整阈值大小的程序。其代码如下:

import cv2

import numpy as np

def CannyThreshold(lowThreshold):

detected_edges = cv2.GaussianBlur(gray, (3, 3), 0)

detected_edges = cv2.Canny(detected_edges, lowThreshold, lowThreshold * ratio, apertureSize=kernel_size)

dst = cv2.bitwise_and(img, img, mask=detected_edges) # just add some colours to edges from original image.

cv2.imshow('canny demo', dst)

lowThreshold = 0

max_lowThreshold = 100

ratio = 3

kernel_size = 3

img = cv2.imread("D:/test/26.png")

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

cv2.namedWindow('canny demo')

cv2.createTrackbar('Min threshold', 'canny demo', lowThreshold, max_lowThreshold, CannyThreshold)

CannyThreshold(0) # initialization

if cv2.waitKey(0) == 27:

cv2.destroyAllWindows()

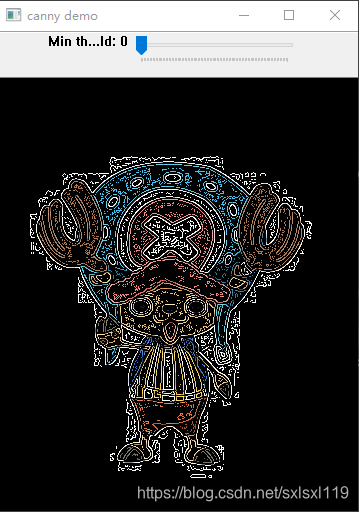

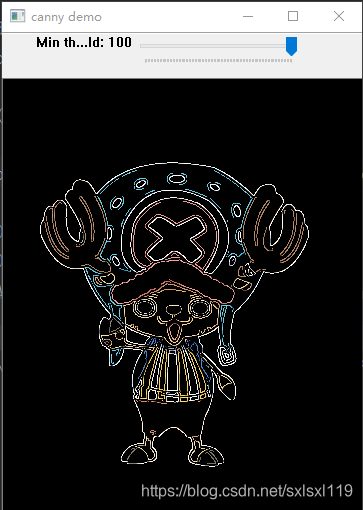

代码二结果:

欢迎扫码关注微信公众号