import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

from tensorflow.contrib.tensorboard.plugins import projector

# In[2]:

# 载入数据集

mnist = input_data.read_data_sets("G:/ATAGLIRL_tensorflow/MNIST_data/", one_hot=True)

# 运行次数

max_steps = 5001

# 图片数量

image_num = 10000 #可以改的,这是是3000张

#文件路径

DIR= "G:/ATAGLIRL_tensorflow/"

# 定义会话

sess = tf.Session()

# 载入图片

embedding = tf.Variable(tf.stack(mnist.test.images[:image_num]), trainable=False, name='embedding')

# 参数概要

def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.scalar('mean', mean) # 平均值

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var - mean)))

tf.summary.scalar('stddev', stddev) # 标准差

tf.summary.scalar('max', tf.reduce_max(var)) # 最大值

tf.summary.scalar('min', tf.reduce_min(var)) # 最小值

tf.summary.histogram('histogram', var) # 直方图

# 命名空间

with tf.name_scope('input'):

# 这里的none表示第一个维度可以是任意的长度

x = tf.placeholder(tf.float32, [None, 784], name='x-input')

# 正确的标签

y = tf.placeholder(tf.float32, [None, 10], name='y-input')

# 显示图片

with tf.name_scope('input_reshape'):

#输入不确定所以是-1

image_shaped_input = tf.reshape(x, [-1, 28, 28, 1])

tf.summary.image('input', image_shaped_input, 10)

with tf.name_scope('layer1'):

# 创建一个简单神经网络

with tf.name_scope('weights1'):

W1 = tf.Variable(tf.truncated_normal([784, 500],stddev=0.1),name='W1')

variable_summaries(W1)

with tf.name_scope('biases1'):

b1 = tf.Variable(tf.zeros([500])+0.1,name='b1')

variable_summaries(b1)

with tf.name_scope('wx_plus_b1'):

wx_plus_b1 = tf.matmul(x, W1) + b1

# with tf.name_scope('softmax'):

# prediction = tf.nn.softmax(wx_plus_b)

with tf.name_scope('activate1'):

L1 = tf.nn.tanh(wx_plus_b1)

with tf.name_scope('layer2'):

with tf.name_scope('weights2'):

W2 = tf.Variable(tf.truncated_normal([500,300],stddev=0.1),name='W2')

variable_summaries(W2)

with tf.name_scope('biases2'):

b2 = tf.Variable(tf.zeros([300]) + 0.1, name='b2')

variable_summaries(b2)

with tf.name_scope('wx_plus_b2'):

wx_plus_b2 = tf.matmul(L1, W2) + b2

with tf.name_scope('activate2'):

L2 = tf.nn.tanh(wx_plus_b2)

with tf.name_scope('layer3'):

with tf.name_scope('weights3'):

W3 = tf.Variable(tf.truncated_normal([300,10], stddev=0.1), name='W3')

variable_summaries(W3)

with tf.name_scope('biases3'):

b3 = tf.Variable(tf.zeros([10]) + 0.1, name='b2')

variable_summaries(b3)

with tf.name_scope('wx_plus_b3'):

wx_plus_b3 = tf.matmul(L2, W3) + b3

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b3)

with tf.name_scope('loss'):

# 交叉熵代价函数

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y, logits=prediction))

tf.summary.scalar('loss', loss)

with tf.name_scope('train'):

# 使用梯度下降法

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(loss)

# 初始化变量

sess.run(tf.global_variables_initializer())

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

# 结果存放在一个布尔型列表中

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(prediction, 1)) # argmax返回一维张量中最大的值所在的位置

with tf.name_scope('accuracy'):

# 求准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32)) # 把correct_prediction变为float32类型

tf.summary.scalar('accuracy', accuracy)

# 产生metadata文件

if tf.gfile.Exists(DIR + 'projector/projector/metadata.tsv'):

tf.gfile.DeleteRecursively(DIR + 'projector/projector/metadata.tsv')

#没有的话就生成一个tsv文件

with open(DIR + 'projector/projector/metadata.tsv', 'w') as f:

labels = sess.run(tf.argmax(mnist.test.labels[:], 1))

for i in range(image_num):

f.write(str(labels[i]) + '\n')

# 合并所有的summary

merged = tf.summary.merge_all()

#将图存入指定路径

projector_writer = tf.summary.FileWriter(DIR + 'projector/projector', sess.graph)

saver = tf.train.Saver()

#这个下面代码感觉是用于读取mnist_10k_sprite.png然后分割这个图显示用的

config = projector.ProjectorConfig()

embed = config.embeddings.add()

embed.tensor_name = embedding.name

embed.metadata_path = DIR + 'projector/projector/metadata.tsv'

embed.sprite.image_path = DIR + 'projector/data/mnist_10k_sprite.png'

embed.sprite.single_image_dim.extend([28, 28]) #图片分割

projector.visualize_embeddings(projector_writer, config) #图片可视化

for i in range(max_steps):

# 每个批次100个样本

batch_xs, batch_ys = mnist.train.next_batch(100)

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

run_metadata = tf.RunMetadata()

summary, _ = sess.run([merged, train_step], feed_dict={x: batch_xs, y: batch_ys}, options=run_options,

run_metadata=run_metadata)

projector_writer.add_run_metadata(run_metadata, 'step%03d' % i)

projector_writer.add_summary(summary, i)

#每隔100显示一次精度

if i % 100 == 0:

acc = sess.run(accuracy, feed_dict={x: mnist.test.images, y: mnist.test.labels})

print("Iter " + str(i) + ", Testing Accuracy= " + str(acc))

#保存模型

saver.save(sess, DIR + 'projector/projector/a_model.ckpt', global_step=max_steps)

projector_writer.close()

sess.close()

# In[ ]:可以改一下:

with tf.Session() as sess:

就是不用sess.close()的情况呗,也会显得简洁很多。

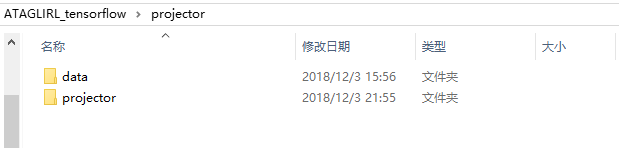

1、遇到的问题:

一定要建文件夹

2、跑完后还想接着修改参数继续跑,要删除以下文件,否则会报错,但这个错也很好发现、

在训练一个神经网络模型后,你会保存这个模型未来使用或部署到产品中。所以,什么是TF模型?TF模型基本包含网络设计或图,与训练得到的网络参数和变量。因此,TF模型具有两个主要文件:

a)meta图

这是一个拟定的缓存,包含了这个TF图完整信息;如所有变量等等。文件以.meta结束。

b)检查点文件:

这个文件是一个二进制文件,包含所有权重、偏移、梯度和所有其它存储的变量的值。这个文件以.ckpy结束。然而,TF已经在0.11版本后不再以这个形式了。转而文件包含如下文件 :

mymodel.data-00000-of-00001

mymodel.index

.data文件包含训练变量。

TF还包含一个名为“checkpoint”的文件 ,保存最后检查点的文件。

所以,综上,TF模型包含如下文件 :

- my_test_model.data-00000-of-00001

- my_test_model.index

- my_test_model.meta

- checkpoint**

2保存一个TF模型

saver = tf.train.Saver() ,注意,你需要在一个session中保存这个模型

saver.save(sess, ‘my-model-name’)

完整的例子为:

import tensorflow as tf w1 = tf.Variable(tf.random_normal(shape=[2]), name='w1') w2 = tf.Variable(tf.random_normal(shape=[5]), name='w2') saver = tf.train.Saver() sess = tf.Session() sess.run(tf.global_variables_initializer()) saver.save(sess, 'my_test_model')

3、Couldn't open CUDA library cupti64_90.dll 如何解决?

https://www.ziiai.com/question/170 这个链接就是我出现的问题

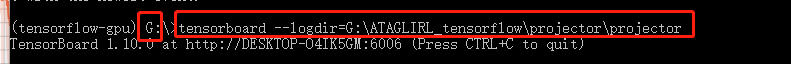

win10下一定要是在G盘下去输入:tensorboard --logdir=G:\ATAGLIRL_tensorflow\projector\projector 才行

ctrl+c是退出,然后可以从新输出命令行

一个一个打开看看

定义的命名空间 layer1 ,其下的biases1,weights1他们的max,mean,min,stddev

可视化image呀

# 显示图片

with tf.name_scope('input_reshape'):

#输入不确定所以是-1

image_shaped_input = tf.reshape(x, [-1, 28, 28, 1])

tf.summary.image('input', image_shaped_input, 10)