深层神经网络求梯度的大致过程:

偏差和方差:

过拟合措施(正则化):

w是参数矩阵

L2正则化又称为权重衰减,w的矩阵乘了一个比1小的数,在进行同之前的梯度递减,所以整个过程又称为“权重衰减”。

原因:lamda足够大,则w接近0,直观理解就是把多个隐藏单元的权重设置为零,于是消除了这些影响,网络得以简化.

过拟合措施(dropout):

每层的keep.prob可以设置不同值,对于w比较大的容易过拟合的层,这个值设置相对较小。

防止过拟合的其他方法还有:数据增强、early stopping。

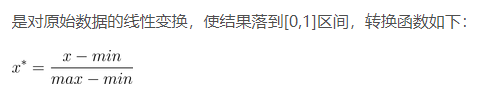

常见的数据归一化方法 min-max标准化 和 z-score 标准化。

前者:

这种方法有一种缺陷就是加入数据后可能导致max、min发生变化,需要重新计算。

后者:

经过处理的数据服从正态分布,即均值为0,标准差为1,注意,一般来说z-score不是归一化,而是标准化。

梯度检验:

注意:梯度检验不要用在训练中,可以在调试中观察,检验还不能和dropout同时进行。

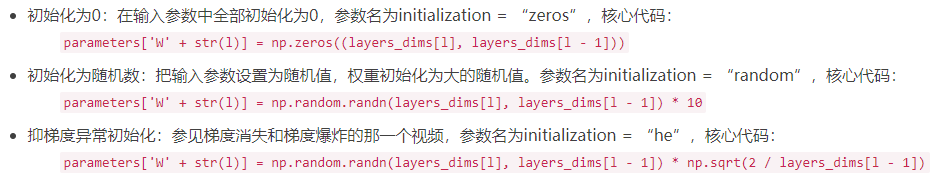

初始化权重: