局部最优化问题

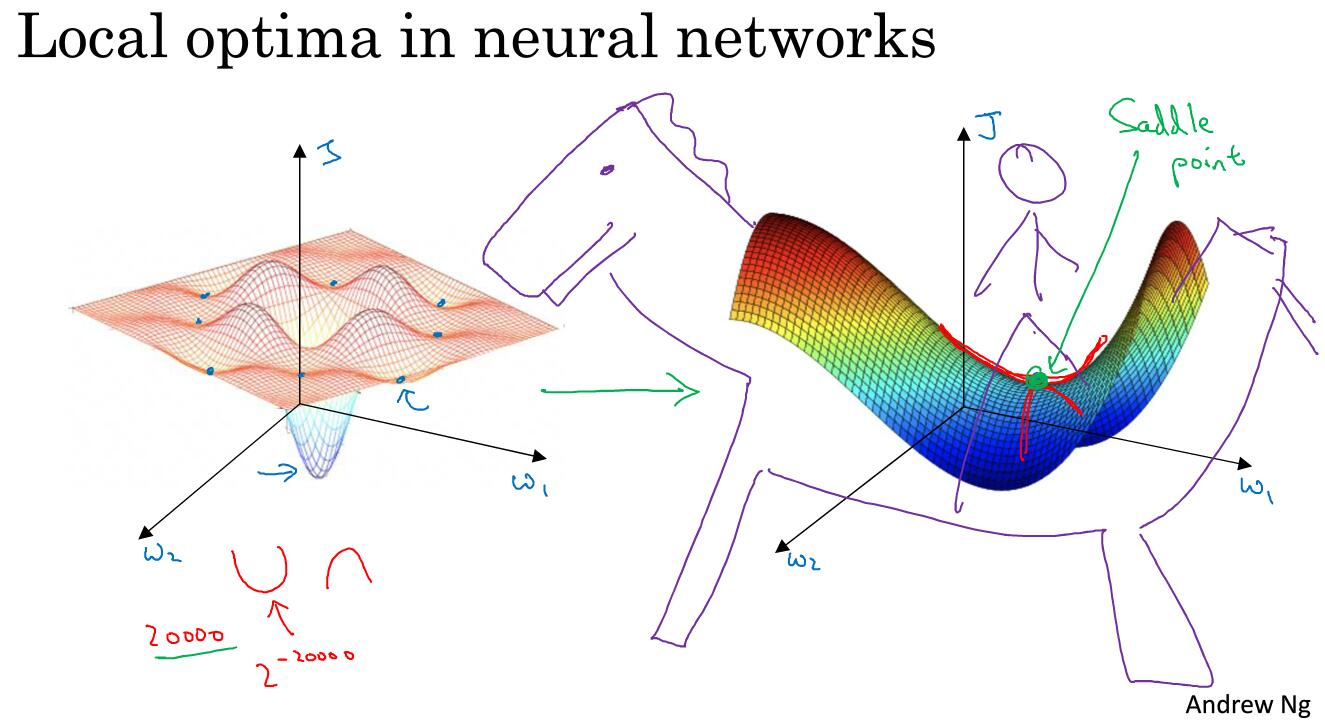

如图左侧所示,似乎存在很多局部最优解。某个算法可能会困在局部最优解里,而不能达到全局最优解。如果通过画图的情况,比如说这种两纬度的情况,就很容易出现许多局部最优解。然而,通过这样的低纬来理解高维是不正确的。

事实上如果你要创建一个神经网络,通常梯度为0的点并不是图中局部最优点,而是右图中的鞍点(saddle points),在高维情况,我们通常碰到的是鞍点而不是局部最优点。

对于深度学习而言,大部分低维空间的直觉不能应用到高维空间。

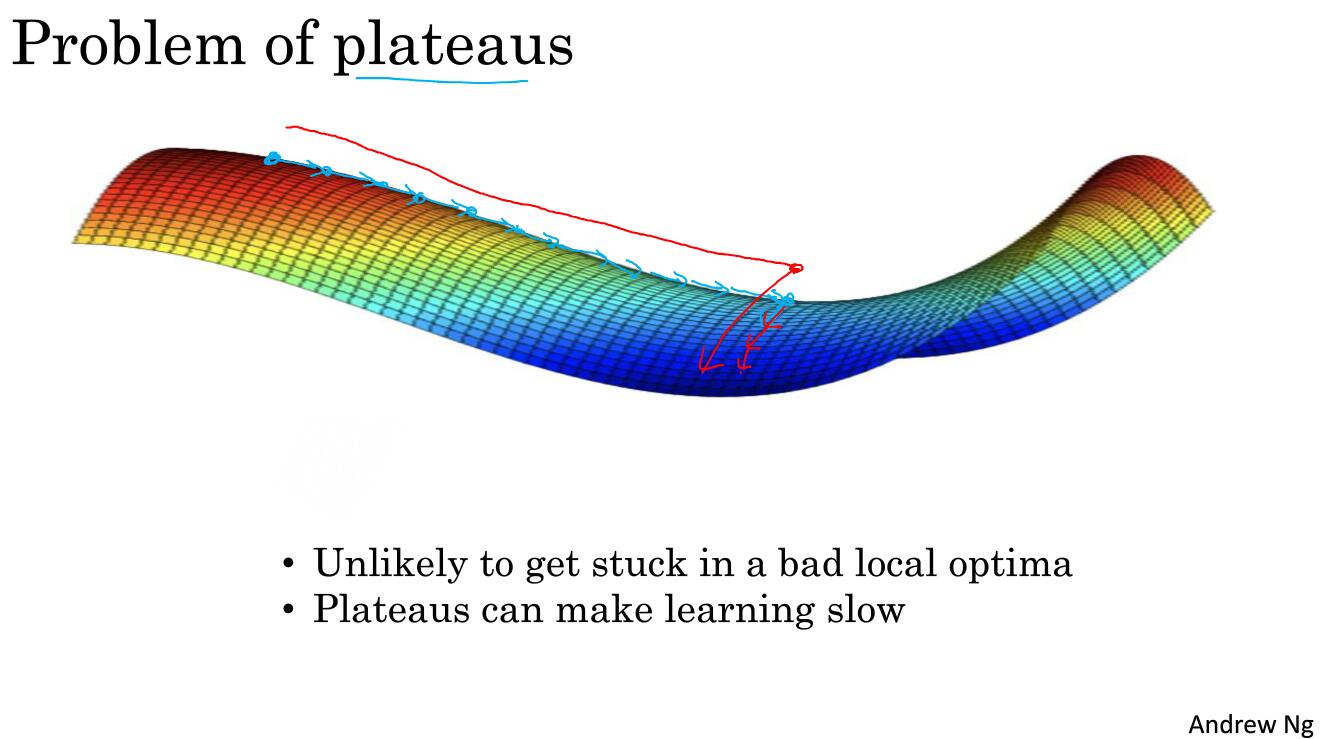

那么如果局部最优不是问题,那么问题是什么呢?

结果是平稳段会减缓学习。

平稳段是一块区域,那里的导数长时间接近于0。

那么本部分的经验是首先,你不太可能在训练大型神经网络中困在局部最优解。条件是大型神经网络有放多参数,而且成本函数J被定义在较高纬度空间。第二点,平稳段是个问题,会使你学的非常缓慢。