在上一篇的基础之上,再准备一个server4

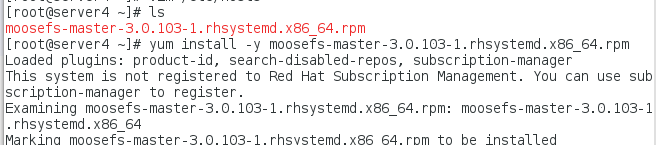

[root@server4 ~]# yum install -y moosefs-master-3.0.103-1.rhsystemd.x86_64.rpm

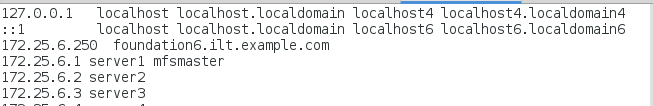

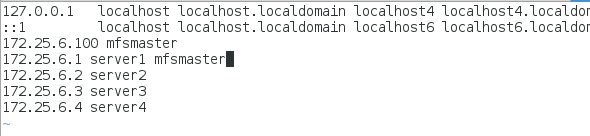

域名解析

[root@server4 ~]# vim /etc/hosts

[root@server4 ~]# vim /usr/lib/systemd/system/moosefs-master.service #修改第8行

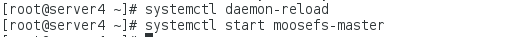

重新加载配置,开启服务

server1和server4上配置高可用yum源

高可用目录

[rhel7.3]

name=rhel7.3

baseurl=http://172.25.254.6/iso

gpgcheck=0

[HighAvailability]

name=HighAvailability

baseurl=http://172.25.254.250/iso/addons/HighAvailability

gpgcheck=0

[ResilientStorage]

name=ResilientStorage

baseurl=http://172.25.254.250/iso/addons/ResilientStorage

gpgcheck=0

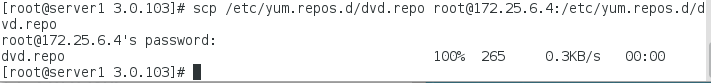

给server4复制一份高可用yum源

在serevr1和server4安装组件

[root@server1 ~]# yum install -y pacemaker corosync

[root@server4 ~]# yum install -y pacemaker corosync

在server1和server4上做免密

[root@server1 ~]# ssh-keygen

[root@server1 ~]# ssh-copy-id server4

[root@server1 ~]# ssh-copy-id server1

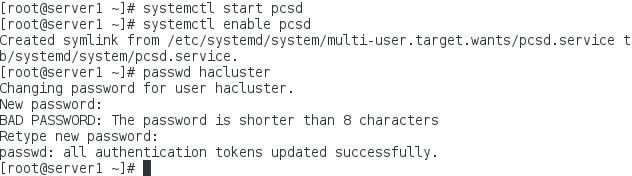

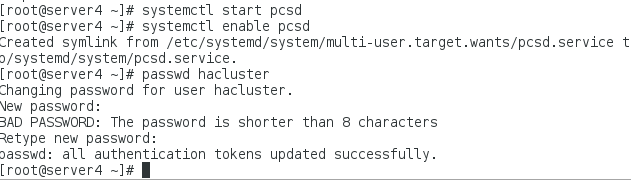

在server1和server4安装资源管理工具pcs并修改hacluster密码

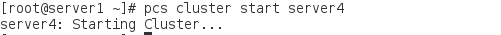

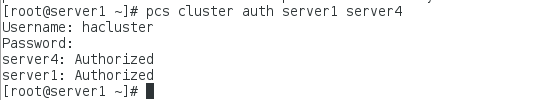

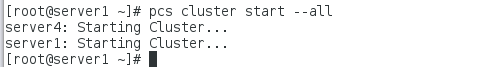

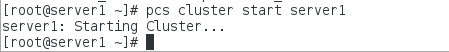

在server1创建集群,并启动

[root@server1 ~]# pcs cluster auth server1 server4

[root@server1 ~]# pcs cluster setup --name mycluster server1 server4

[root@server1 ~]# pcs cluster start --all

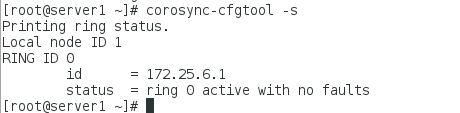

查看状态

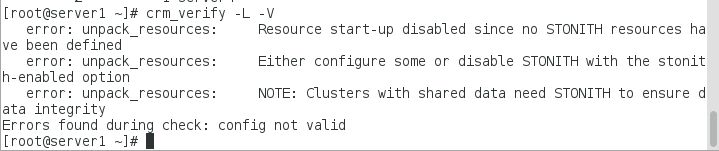

解决报错

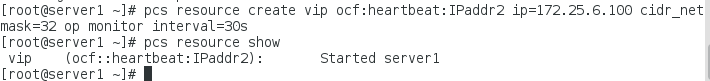

创建资源

[root@server1 ~]# pcs resource create vip ocf:heartbeat:IPaddr2 ip=172.25.6.100 cidr_netmask=32 op monitor interval=30s

[root@server1 ~]# pcs resource show

[root@server1 ~]# pcs status

在server4中监控

[root@server4 ~]# crm_mon

实现高可用

在server1中查看虚拟ip172.25.6.100

[root@server1 ~]# pcs cluster stop server1 #停止server1集群

在server1中查看已经没有虚拟ip了,在server4中查看

此时server4中的监控上vip已经飘移到server4

再开启serrver1server4上的也不会再飘回到server1

实现数据共享

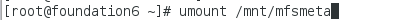

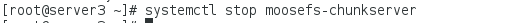

清理之前的环境

解析(server1-server4.真机)

[root@foundation6 ~]# vim /etc/hosts #添加172.25.14.100 mfsmaster

其他server一样

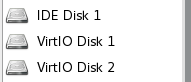

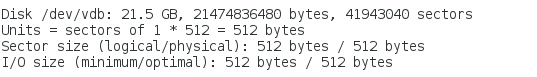

给sevrer2加虚拟磁盘

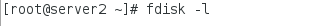

查看可用设备,多了vdb

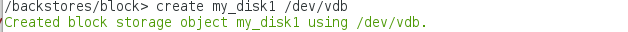

在server2安装targetcli,并做相应配置

[root@server2 ~]# yum install -y targetcli

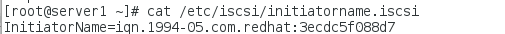

图中iqn.1994-05.com.redhat:3ecdc5f088d7是复制的server1中的(先在server1下载iscsi,再查看文件)

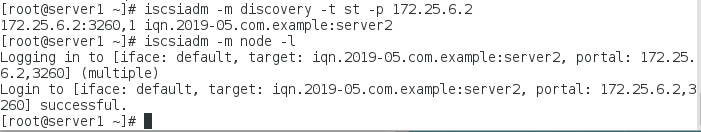

在server1中登陆成功

磁盘共享成功

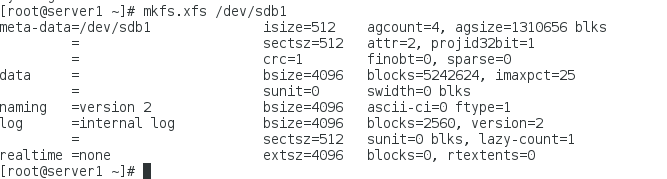

创建分区并格式化

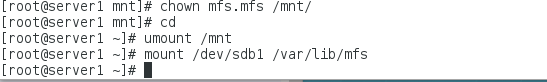

挂载

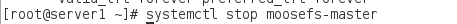

[root@server1 ~]# systemctl start moosefs-master #服务可以启动说明共享没有问题

[root@server1 ~]# systemctl stop moosefs-master

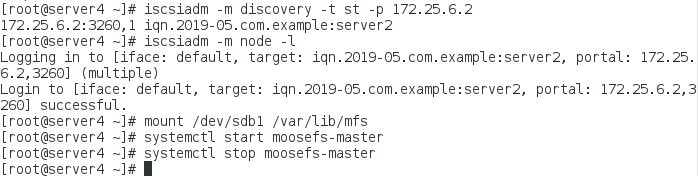

server4中

[root@server4 ~]# yum install -y iscsi-*

从server1中复制一份/etc/iscsi/initiatorname.iscsi到server4,再卸载iscsi重新下载iscsi

[root@server1 ~]# scp /etc/iscsi/initiatorname.iscsi [email protected]: /etc/iscsi/initiatorname.iscsi

[root@server4 ~]# yum remove -y iscsi-*

[root@server4 ~]# yum install -y iscsi-*

再次在server1创建资源

[root@server1 ~]# pcs resource create mfsdata ocf:heartbeat:Filesystem device=/dev/sdb1 directory=/var/lib/mfs fstype=xfs op monitor interval=30s

[root@server1 ~]# pcs resource create mfsd systemd:moosefs-master op monitor interval=1min

[root@server1 ~]# pcs resource group add mfsgroup vip mfsdata mfsd

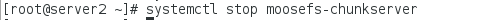

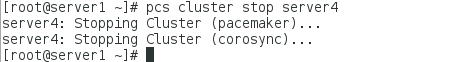

关掉server4,则server1上线

server4中监控中断

[root@server1 ~]# crm_mon #可以看到全部转移到server1上

就算server4好了也不会漂回去

[root@server1 ~]# pcs cluster start server4

fence配置

server1,server4安装fence-virt

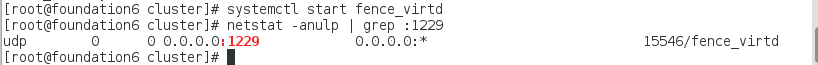

在客户端(真机)安装fence-virtd

[root@foundation6 ~]# yum install -y fence-virtd

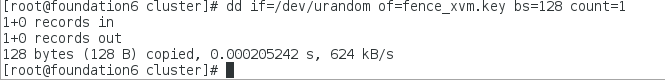

[root@foundation6 ~]# mkdir /etc/cluster

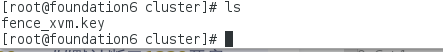

[root@foundation6 ~]# cd /etc/cluster

[root@foundation6 cluster]# fence_virtd -c #注意br0需要修改,其余回车即可

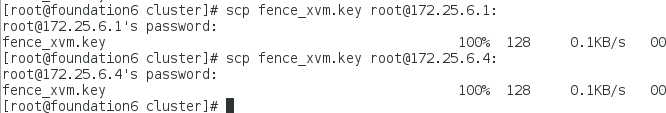

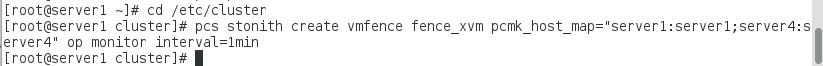

server1和server4分别建立cluster目录并移动fence_xvm.key文件到新建目录下

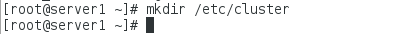

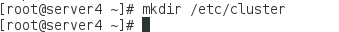

[root@server1 ~]# mkdir /etc/cluster

[root@server1 ~]# scp fence_xvm.key /etc/cluster

[root@server4 ~]# mkdir /etc/cluster

[root@server4 ~]# scp fence_xvm.key /etc/cluster

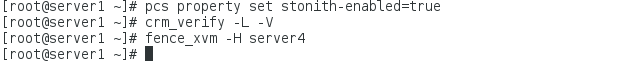

在server1继续配置策略

使server1崩溃

[root@server1 ~]# echo c > /proc/sysrq-trigger