逐步会更新阅读过的AutoML文献(其实是NAS),以及自己的一些思考

- Progressive Neural Architecture Search,2018ECCV的文章;

目的是:Speed up NAS by proposing an alternative algorithm (Progressive Search),

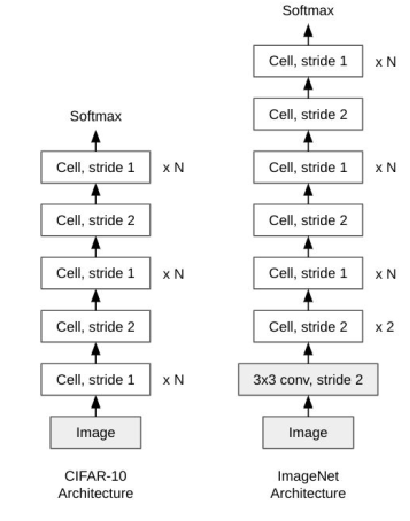

具体方法:采取Learning transferable architectures for scalable image recognition中相似的搜索空间,也就是block->cell->network;采用simple to complex的搜索策略,

网络结构

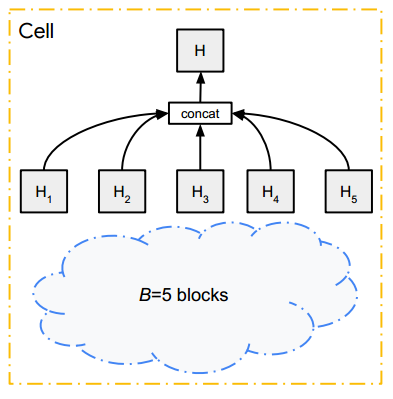

Cell结构

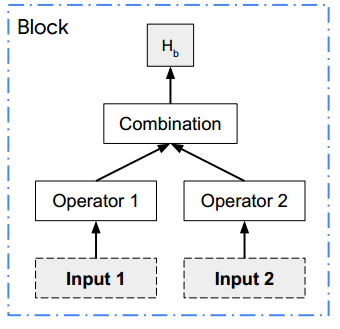

Block结构

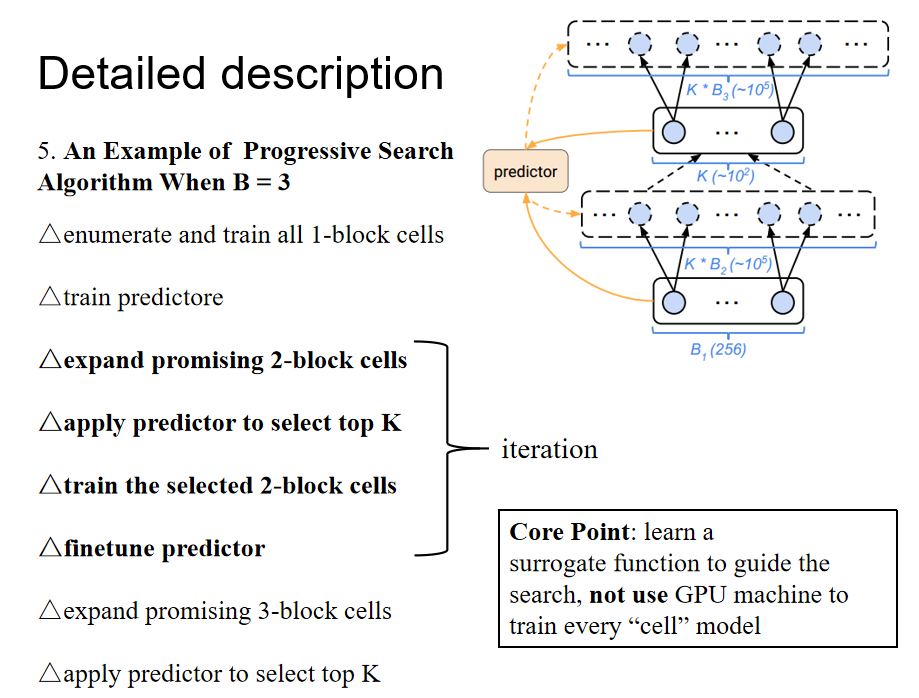

为了减少搜索空间,采用的搜索算法如下:

搜索算法

个人评论:采用了进化算法的思想,以及训练一个预测器,来预测网络性能,但是具体怎么预测并没有说明。

2.Efficient Neural Architecture Search via Parameter Sharing,大名鼎鼎的ENAS,采用权重共享的方法,2018CVPR的文章

目的是:Improve the efficiencyo of NAS to eschew training each child model from scratch to convergence,也就是减少每个子模型训练到收敛的时间。

IDEAS是:让每个子模型都共享一套权重;在一个超网络下,构建很多的子网络