本章内容:

1.FutureTask

2.ForkJoin

3.BlockingQueue

一、FutureTask

通过直接继承Thread和实现Runnable接口创建线程,都有一个缺点:在执行完任务之后无法获取执行结果。而自从JDK1.5开始,提供了Callable和Future,通过他们可以在任务执行完之后得到执行结果。

1.Callable与Runnable

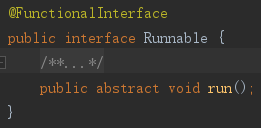

Runnable的run方法返回void,执行完任务后无法返回任何结果。

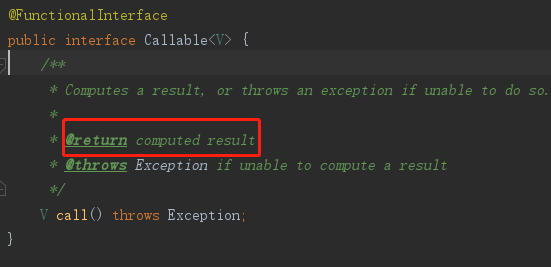

Callable的call方法返回泛型V,就是接口Callable传递进来的类型。

Callable一般是与ExecutorService配合来使用的。

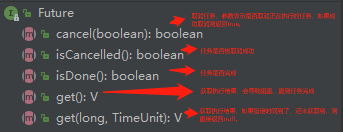

2.Future接口

Future接口就是对具体的Runnable和Callable任务的执行结果进行取消(中断任务)、查询是否完成、获取结果。必要时可以通过get方法获取执行结果,该方法会阻塞知道任务返回结果。

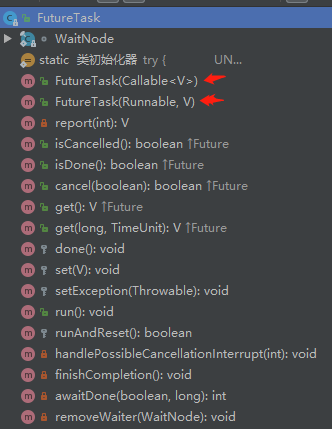

3.FutureTask使用

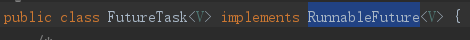

因为Future是一个接口,无法直接创建对象,因此产生了FutureTask。FutureTask实现RunnableFuture接口,RunnableFuture继承Future接口和Runnable接口,因此FutureTask既可以作为Runnable被线程执行,又可以作为Future得到Callable的返回值。(FutureTask是Future接口的唯一实现类)

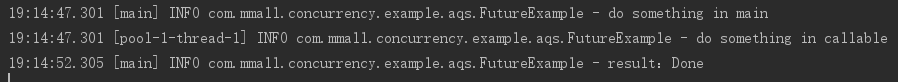

【示例1】Callable+Future

1 @Slf4j 2 public class FutureExample { 3 4 static class MyCallable implements Callable<String> { 5 @Override 6 public String call() throws Exception { 7 log.info("do something in callable"); 8 Thread.sleep(5000); 9 return "Done"; 10 } 11 } 12 13 public static void main(String[] args) throws Exception { 14 ExecutorService executorService = Executors.newCachedThreadPool(); 15 Future<String> future = executorService.submit(new MyCallable()); 16 log.info("do something in main"); 17 Thread.sleep(1000); 18 String result = future.get(); 19 log.info("result:{}", result); 20 } 21 }

【示例2】Callable+FutureTask

1 @Slf4j 2 public class FutureTaskExample { 3 4 public static void main(String[] args) throws Exception { 5 FutureTask<String> futureTask = new FutureTask<String>(new Callable<String>() { 6 @Override 7 public String call() throws Exception { 8 log.info("do something in callable"); 9 Thread.sleep(5000); 10 return "Done"; 11 } 12 }); 13 new Thread(futureTask).start(); 14 log.info("do something in main"); 15 Thread.sleep(1000); 16 String result = futureTask.get(); 17 log.info("result:{}", result); 18 } 19 }

二、Fork/Join框架

Fork/Join是Java7 提供的一个用于并行执行任务的框架,基本思想是把一个大任务分割成若干个小任务,最后汇总每个小任务结果后得到大任务结果的框架。

【实现】首先创建一个ForkJoin任务,把大任务分割成小任务,如果任务不够小,继续划分。在Java中我们可以使用JoinForkTask类,他提供任务中执行fork()和join()操作的机制。通常情况下,我们继承它的子类:①RecursiveTask:用于有返回结果的任务;②RecursiveAction:用于没有返回结果的任务;在Java中,任务的执行要通过ForkJoinPool来执行。

【示例】计算1+2+3+…+100(阿里面试题:百万级数据相加)

1 import lombok.extern.slf4j.Slf4j; 2 import java.util.concurrent.ForkJoinPool; 3 import java.util.concurrent.Future; 4 import java.util.concurrent.RecursiveTask; 5 6 @Slf4j 7 public class ForkJoinTaskExample extends RecursiveTask<Integer> { 8 9 public static final int threshold = 2; 10 private int start; 11 private int end; 12 13 public ForkJoinTaskExample(int start, int end) { 14 this.start = start; 15 this.end = end; 16 } 17 18 @Override 19 protected Integer compute() { 20 int sum = 0; 21 //如果任务足够小就计算任务 22 boolean canCompute = (end - start) <= threshold; 23 if (canCompute) { 24 for (int i = start; i <= end; i++) { 25 sum += i; 26 } 27 } else { 28 // 如果任务大于阈值,就分裂成两个子任务计算 29 int middle = (start + end) / 2; 30 ForkJoinTaskExample leftTask = new ForkJoinTaskExample(start, middle); 31 ForkJoinTaskExample rightTask = new ForkJoinTaskExample(middle + 1, end); 32 // 执行子任务 33 // leftTask.fork(); 34 // rightTask.fork(); 35 //直接使用invoke方法,建议使用 36 invokeAll(leftTask,rightTask); 37 // 等待任务执行结束合并其结果 38 int leftResult = leftTask.join(); 39 int rightResult = rightTask.join(); 40 // 合并子任务 41 sum = leftResult + rightResult; 42 } 43 return sum; 44 } 45 public static void main(String[] args) { 46 ForkJoinPool forkjoinPool = new ForkJoinPool(); 47 //生成一个计算任务,计算1+2+3+4 48 ForkJoinTaskExample task = new ForkJoinTaskExample(1, 100); 49 //执行一个任务 50 Future<Integer> result = forkjoinPool.submit(task); 51 try { 52 log.info("result:{}", result.get()); 53 } catch (Exception e) { 54 log.error("exception", e); 55 } 56 } 57 }

ForkJoinTask和一般任务的主要区别在于它需要实现compute方法, 在这个方法里,需要判断任务是否足够小,如果足够小就直接执行任务。如果不够小,就必须分割成两个子任务,每个子任务执行fork方法时,又会进入compute方法,如果当前任务不需要分割,则执行当前子任务并返回结果。使用join方法会等待子任务执行完并得到其结果,建议使用invokeAll()方法。

ForkJoinPool是由ForkJoinTask数组和ForkJoinWorkerThread数组组成。ForkJoinTask数组负责将存放程序提交给ForkJoinPool的任务。而ForkJoinWorkerThread数组负责执行这些任务。

ForkJoinPool使用invoke()时,线程同步执行,调用之后需要等待任务完成,才能执行后面的代码。使用submit()时,线程异步执行,只有在Future调用get的时候才会阻塞。

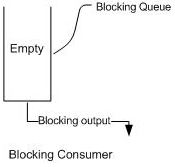

三、BlockingQueue

1.简介

BlockingQueue很好地解决了多线程中高效安全传输数据的问题。BlockingQueue(阻塞队列)首先是一个队列,数据从一端输入,从另一端输出。

多线程环境中,通过队列可以很容易实现数据共享,比如经典的“生产者”和“消费者”模型中,通过队列可以很便利地实现两者之间的数据共享。假设我们有若干生产者线程,另外又有若干个消费者线程。如果生产者线程需要把准备好的数据共享给消费者线程,利用队列的方式来传递数据,就可以很方便地解决他们之间的数据共享问题。但如果生产者和消费者在某个时间段内,万一发生数据处理速度不匹配的情况呢?理想情况下,如果生产者产出数据的速度大于消费者消费的速度,并且当生产出来的数据累积到一定程度的时候,那么生产者必须暂停等待一下(阻塞生产者线程),以便等待消费者线程把累积的数据处理完毕,反之亦然。然而,在concurrent包发布以前,在多线程环境下,我们每个程序员都必须去自己控制这些细节,尤其还要兼顾效率和线程安全,而这会给我们的程序带来不小的复杂度。好在此时,强大的concurrent包横空出世了,而他也给我们带来了强大的BlockingQueue。(在多线程领域:所谓阻塞,在某些情况下会挂起线程(即阻塞),一旦条件满足,被挂起的线程又会自动被唤醒)

当队列中没有数据的情况下,消费者端的所有线程都会被自动阻塞(挂起),直到有数据放入队列。当队列中填满数据的情况下,生产者端的所有线程都会被自动阻塞(挂起),直到队列中有空的位置,线程被自动唤醒。作为BlockingQueue的使用者,我们再也不需要关心什么时候需要阻塞线程,什么时候需要唤醒线程,因为这一切BlockingQueue都给你一手包办了。

【API】

放入数据:

offer(anObject):表示如果可能的话,将anObject加到BlockingQueue里,即如果BlockingQueue可以容纳,则返回true,否则返回false.(本方法不阻塞当前执行方法的线程)

offer(E o, long timeout, TimeUnit unit),可以设定等待的时间,如果在指定的时间内,还不能往队列中加入BlockingQueue,则返回失败。

put(anObject):把anObject加到BlockingQueue里,如果BlockQueue没有空间,则调用此方法的线程被阻断直到BlockingQueue里面有空间再继续.

获取数据:

poll(time):取走BlockingQueue里排在首位的对象,若不能立即取出,则可以等time参数规定的时间,取不到时返回null;

poll(long timeout, TimeUnit unit):从BlockingQueue取出一个队首的对象,如果在指定时间内,队列一旦有数据可取,则立即返回队列中的数据。否则知道时间超时还没有数据可取,返回失败。

take():取走BlockingQueue里排在首位的对象,若BlockingQueue为空,阻断进入等待状态直到BlockingQueue有新的数据被加入;

drainTo():一次性从BlockingQueue获取所有可用的数据对象(还可以指定获取数据的个数),通过该方法,可以提升获取数据效率;不需要多次分批加锁或释放锁。

BlockingQueue成员如下所示:

2.ArrayBlockingQueue

基于数组的阻塞队列实现,在ArrayBlockingQueue内部,维护了一个定长数组,以便缓存队列中的数据对象,这是一个常用的阻塞队列,除了一个定长数组外,ArrayBlockingQueue内部还保存着两个整形变量,分别标识着队列的头部和尾部在数组中的位置。

ArrayBlockingQueue在生产者放入数据和消费者获取数据,都是共用同一个锁对象,由此也意味着两者无法真正并行运行,这点尤其不同于LinkedBlockingQueue;按照实现原理来分析,ArrayBlockingQueue完全可以采用分离锁,从而实现生产者和消费者操作的完全并行运行。Doug Lea之所以没这样去做,也许是因为ArrayBlockingQueue的数据写入和获取操作已经足够轻巧,以至于引入独立的锁机制,除了给代码带来额外的复杂性外,其在性能上完全占不到任何便宜。 ArrayBlockingQueue和LinkedBlockingQueue间还有一个明显的不同之处在于,前者在插入或删除元素时不会产生或销毁任何额外的对象实例,而后者则会生成一个额外的Node对象。这在长时间内需要高效并发地处理大批量数据的系统中,其对于GC的影响还是存在一定的区别。而在创建ArrayBlockingQueue时,我们还可以控制对象的内部锁是否采用公平锁,默认采用非公平锁。

3.LinkedBlockingQueue

基于链表的阻塞队列,同ArrayListBlockingQueue类似,其内部也维持着一个数据缓冲队列(该队列由一个链表构成),当生产者往队列中放入一个数据时,队列会从生产者手中获取数据,并缓存在队列内部,而生产者立即返回;只有当队列缓冲区达到最大值缓存容量时(LinkedBlockingQueue可以通过构造函数指定该值),才会阻塞生产者队列,直到消费者从队列中消费掉一份数据,生产者线程会被唤醒,反之对于消费者这端的处理也基于同样的原理。而LinkedBlockingQueue之所以能够高效的处理并发数据,还因为其对于生产者端和消费者端分别采用了独立的锁来控制数据同步,这也意味着在高并发的情况下生产者和消费者可以并行地操作队列中的数据,以此来提高整个队列的并发性能。

作为开发者,我们需要注意的是,如果构造一个LinkedBlockingQueue对象,而没有指定其容量大小,LinkedBlockingQueue会默认一个类似无限大小的容量(Integer.MAX_VALUE),这样的话,如果生产者的速度一旦大于消费者的速度,也许还没有等到队列满阻塞产生,系统内存就有可能已被消耗殆尽了。

ArrayBlockingQueue和LinkedBlockingQueue是两个最普通也是最常用的阻塞队列,一般情况下,在处理多线程间的生产者消费者问题,使用这两个类足以。

【示例】

1 /** 2 * 生产者线程 3 * 4 * 5 */ 6 public class Producer implements Runnable { 7 8 private volatile boolean isRunning = true; 9 private BlockingQueue queue; 10 private static AtomicInteger count = new AtomicInteger(); 11 private static final int DEFAULT_RANGE_FOR_SLEEP = 1000; 12 13 public Producer(BlockingQueue queue) { 14 this.queue = queue; 15 } 16 17 public void run() { 18 String data = null; 19 Random r = new Random(); 20 21 System.out.println("启动生产者线程!"); 22 try { 23 while (isRunning) { 24 System.out.println("正在生产数据..."); 25 Thread.sleep(r.nextInt(DEFAULT_RANGE_FOR_SLEEP)); 26 27 data = "data:" + count.incrementAndGet(); 28 System.out.println("将数据:" + data + "放入队列..."); 29 if (!queue.offer(data, 2, TimeUnit.SECONDS)) { 30 System.out.println("放入数据失败:" + data); 31 } 32 } 33 } catch (InterruptedException e) { 34 e.printStackTrace(); 35 Thread.currentThread().interrupt(); 36 } finally { 37 System.out.println("退出生产者线程!"); 38 } 39 } 40 41 public void stop() { 42 isRunning = false; 43 } 44 }

1 /** 2 * 消费者线程 3 * 4 * 5 */ 6 public class Consumer implements Runnable { 7 8 private BlockingQueue<String> queue; 9 private static final int DEFAULT_RANGE_FOR_SLEEP = 1000; 10 11 public Consumer(BlockingQueue<String> queue) { 12 this.queue = queue; 13 } 14 15 public void run() { 16 System.out.println("启动消费者线程!"); 17 Random r = new Random(); 18 boolean isRunning = true; 19 try { 20 while (isRunning) { 21 System.out.println("正从队列获取数据..."); 22 String data = queue.poll(2, TimeUnit.SECONDS); 23 if (null != data) { 24 System.out.println("拿到数据:" + data); 25 System.out.println("正在消费数据:" + data); 26 Thread.sleep(r.nextInt(DEFAULT_RANGE_FOR_SLEEP)); 27 } else { 28 // 超过2s还没数据,认为所有生产线程都已经退出,自动退出消费线程。 29 isRunning = false; 30 } 31 } 32 } catch (InterruptedException e) { 33 e.printStackTrace(); 34 Thread.currentThread().interrupt(); 35 } finally { 36 System.out.println("退出消费者线程!"); 37 } 38 } 39 40 41 }

1 /** 2 * 测试类 3 */ 4 public class BlockingQueueTest { 5 6 public static void main(String[] args) throws InterruptedException { 7 // 声明一个容量为10的缓存队列 8 BlockingQueue<String> queue = new LinkedBlockingQueue<String>(10); 9 10 Producer producer1 = new Producer(queue); 11 Producer producer2 = new Producer(queue); 12 Producer producer3 = new Producer(queue); 13 Consumer consumer = new Consumer(queue); 14 15 // 借助Executors 16 ExecutorService service = Executors.newCachedThreadPool(); 17 // 启动线程 18 service.execute(producer1); 19 service.execute(producer2); 20 service.execute(producer3); 21 service.execute(consumer); 22 23 // 执行10s 24 Thread.sleep(10 * 1000); 25 producer1.stop(); 26 producer2.stop(); 27 producer3.stop(); 28 29 Thread.sleep(2000); 30 // 退出Executor 31 service.shutdown(); 32 } 33 } 34 35 复制代码

4.DelayQueue

DelayQueue中的元素只有当其指定的延迟时间到了,才能够从队列中获取到该元素。DelayQueue是一个没有大小限制的队列,因此往队列中插入数据的操作(生产者)永远不会被阻塞,而只有获取数据的操作(消费者)才会被阻塞。

使用场景:

DelayQueue使用场景较少,但都相当巧妙,常见的例子比如使用一个DelayQueue来管理一个超时未响应的连接队列。

5.PriorityBlockingQueue

基于优先级的阻塞队列(优先级的判断通过构造函数传入的Compator对象来决定),但需要注意的是PriorityBlockingQueue并不会阻塞数据生产者,而只会在没有可消费的数据时,阻塞数据的消费者。因此使用的时候要特别注意,生产者生产数据的速度绝对不能快于消费者消费数据的速度,否则时间一长,会最终耗尽所有的可用堆内存空间。在实现PriorityBlockingQueue时,内部控制线程同步的锁采用的是公平锁。

6.SynchronousQueue

一种无缓冲的等待队列,类似于无中介的直接交易,有点像原始社会中的生产者和消费者,生产者拿着产品去集市销售给产品的最终消费者,而消费者必须亲自去集市找到所要商品的直接生产者,如果一方没有找到合适的目标,那么对不起,大家都在集市等待。相对于有缓冲的BlockingQueue来说,少了一个中间经销商的环节(缓冲区),如果有经销商,生产者直接把产品批发给经销商,而无需在意经销商最终会将这些产品卖给那些消费者,由于经销商可以库存一部分商品,因此相对于直接交易模式,总体来说采用中间经销商的模式会吞吐量高一些(可以批量买卖);但另一方面,又因为经销商的引入,使得产品从生产者到消费者中间增加了额外的交易环节,单个产品的及时响应性能可能会降低。

声明一个SynchronousQueue有两种不同的方式,它们之间有着不太一样的行为。公平模式和非公平模式的区别:

如果采用公平模式:SynchronousQueue会采用公平锁,并配合一个FIFO队列来阻塞多余的生产者和消费者,从而体系整体的公平策略;

但如果是非公平模式(SynchronousQueue默认):SynchronousQueue采用非公平锁,同时配合一个LIFO队列来管理多余的生产者和消费者,而后一种模式,如果生产者和消费者的处理速度有差距,则很容易出现饥渴的情况,即可能有某些生产者或者是消费者的数据永远都得不到处理。