2014翻译论文

Sequence to Sequence Learning with Neural Networks

基本信息:2014 nips 6500+

目标公式:$ p(y_t|v, y_1, . . . , y_{ t−1}) $

参数:$y_t$是生成的翻译文本,$v$是表达输入文本的定长向量

模型架构:用多层LSTM将输入序列$A,B,C,<EOS>$生成$v$ , 而后再利用另一个LSTM生成翻译文本。

2015翻译论文

1.Neural Machine Translation by Jointly Learning to Align and Translate

基本信息:2015 ICLR 6900+

提出问题:encoder-decoder模型,对于越长的文本翻译效果越差

解决方案:decoder时期的每个$h_j$都和encoder部分所有$h_i$得到加权值$α_i$,而后再$α_i$乘以对应的$h_i$求和,得到新表示的$c_i$。以上方法能够有重点的关注和解码部分最相关的部分。

扫描二维码关注公众号,回复:

8971891 查看本文章

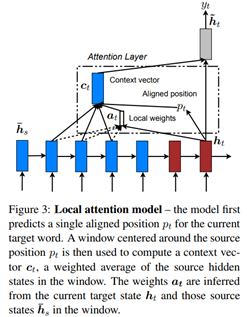

2.Effective Approaches to Attention-based Neural Machine Translation

基本信息:2015 EMNLP 1800+

2017翻译论文

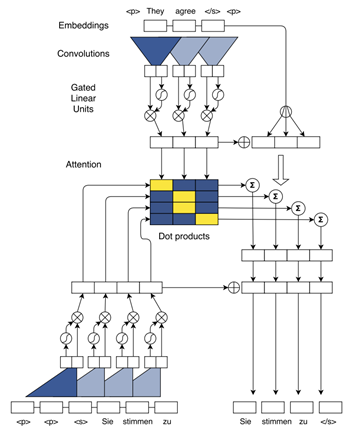

1.convolutional sequence to sequence learning

基本信息:2017 arXiv 600+