指定义在凸集中的凸函数最优化的问题

优化目标

尽管优化方法可以最小化深度学习中的损失函数值,但本质上优化方法达到的目标与深度学习的目标并不相同。

- 优化方法目标:训练集损失函数值 - 深度学习目标:测试集损失函数值(泛化性)

优化在深度学习中的挑战

1. 局部最小值

2. 鞍点:鞍点是对所有自变量一阶偏导数都为0,且Hessian矩阵特征值有正有负的点。 沿着某一方向是稳定的,另一条方向是不稳定的奇点,叫做鞍点。

3. 梯度消失:梯度为0

凸优化问题的优势

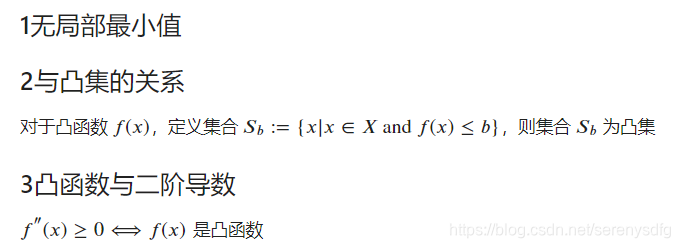

- 凸优化问题的局部最优解就是全局最优解

- 很多非凸问题都可以被等价转化为凸优化问题或者被近似为凸优化问题(例如拉格朗日对偶问题)

- 凸优化问题的研究较为成熟,当一个具体被归为一个凸优化问题,基本可以确定该问题是可被求解的

凸函数

凸集合:任意两点的连线仍在集合内

凸函数:两者中间的点连线的y大于实际函数的y(比如:最低点向下的抛物线

凸函数性质的不等式:jasen不等式:函数值的期望>期望的函数值

凸函数 性质

有限制条件的优化问题可以用以下方法解决

拉格朗日乘子法

添加惩罚项

投影法