在本文中,我们介绍了一个用于手势识别(HGR)系统的庞大数据集 Ha-GRID(HAnd Gesture Recognition Image Dataset)。该数据集包含 552,992 个样本,分为 18 类手势。注释由带有手势标签的手的边界框和领先手的标记组成。提议的数据集允许构建 HGR 系统,该系统可用于视频会议服务、家庭自动化系统、汽车行业、为有语言和听力障碍的人提供的服务等。我们特别关注与设备的交互以管理它们。这就是为什么选择的所有 18 个手势都是功能性的、大多数人熟悉的,并且可能是采取某些行动的动力。此外,我们使用众包平台收集数据集并考虑各种参数以确保数据的多样性。我们描述了为我们的任务使用现有 HGR 数据集的挑战,并提供了它们的详细概述。此外,还提出了手部检测和手势分类任务的基线。HaGRID 和预训练模型是公开可用的。

手势在人类交流中的使用起着重要作用:手势可以在情感上强化陈述或完全取代它们。 更重要的是,手势识别(HGR)可以成为人机交互的一部分。 此类系统在汽车领域、家庭自动化系统、各种视频/流媒体平台(Zoom、Skype、Discord、Jazz 等)等领域具有广泛的实际应用。 此外,该系统还可以成为活跃手语用户(听力和语言障碍者)的虚拟助手或服务的一部分。 这些区域要求系统在线工作,并且对背景、场景、主题和照明条件具有鲁棒性。

在本文中,我们展示了 HaGRID 数据集来设计 HGR 系统。 它包含超过 50 万张图像,分为 18 类手势符号(图 1),它们不是面向语言的。 这种手势被选择用于设备控制系统的设计,并服务于一个符号功能角色[18]。 符号手势有助于人与人之间的信息交流,在我们的案例中,它们用于人机交互。 第 3 节将描述如何使用选定的静态手势来设计动态手势,即 用符号手势创建能动的手势(另一个功能角色,对应于操纵物体的能力)。数据集中功能性手势的小词典旨在降低 HGR 系统的复杂性并避免设备用户不必要的认知负担。 在使用手势控制系统时,必须有舒适的设计动作。 所有呈现的手势都被选为对此最有用的手势。 我们还添加了一个包含自然手部动作样本的额外类,并将其称为“无手势”。 所有图像的背景、照明、场景和主题都不同。 这种异质性是通过使用两个众包平台来实现的,即 Yandex.Toloka3 和 ABC Elementary4。 数据集中的所有样本都是高分辨率的,并以 RGB 格式收集。

对(1)高分辨率图像、(2)图像场景的异质性、受试者、他们的年龄和性别、照明、相机到受试者的距离以及(3)样本数量等特征的组合成为了创建 HaGRID 的动机。该数据集由大约 50 万个 FullHD (1920 × 1080) RGB 图像组成,具有 18 个手势和一个“无手势”类。它有在

至少 34,730 个独特的场景。请记住,建议的数据集包含两个位置的一些手势:手的正面和背面。这允许使用两个静态手势来解释动态手势。例如,使用手势“停止”和“停止倒转”,您可以设计动态手势“向上滑动”(“停止拇指向下”,即“停止”旋转 180 度,作为行的开始,“停止倒转”作为结束)和“向下滑动”(“停止”作为行的开始,“停止倒竖拇指向下”,即“停止倒转”旋转 180 度,作为结束)。此外,您还可以获得 2 个动态手势,“向右滑动”和“向左滑动”,具有 90 度旋转增强。所有设计的动态手势示例如图 2 所示。

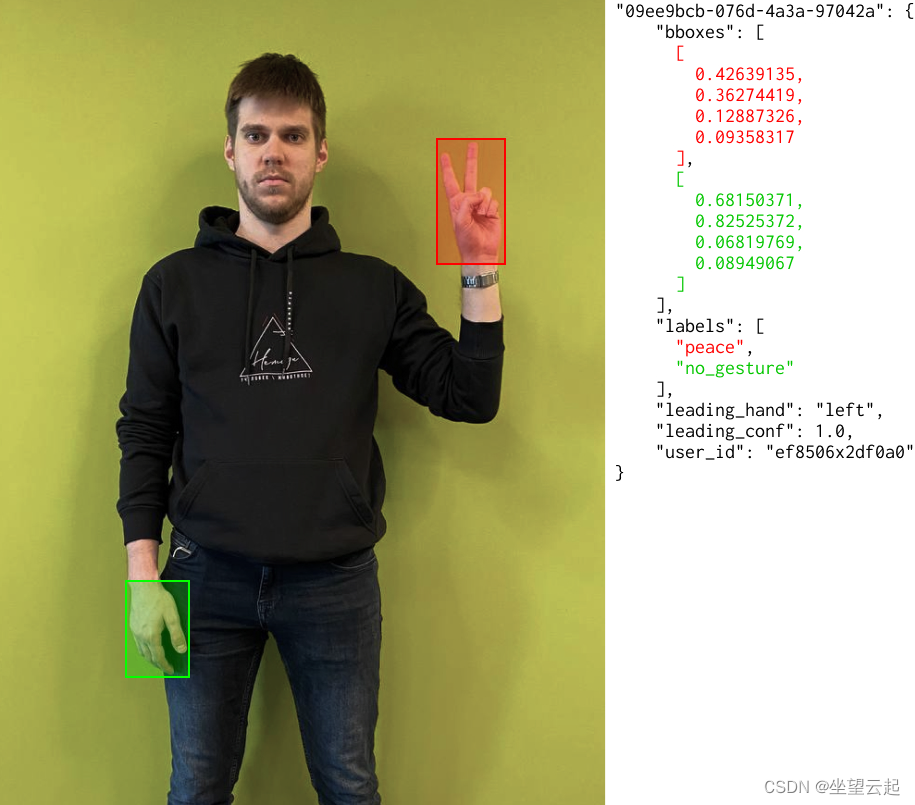

除了手势分类,HaGRID 还可用于手部检测问题(每幅图像有一帧中 n 只手对应的 n 个边界框)和两个二元分类问题:(1)手势/非手势和(2)右/ 左手 7. 图 3 提供了数据集中一个样本的标记示例。

https://github.com/hukenovs/hagrid![]() https://github.com/hukenovs/hagrid HaGRID 上的模型训练结果

https://github.com/hukenovs/hagrid HaGRID 上的模型训练结果

HaGRID 旨在用于手势识别系统。 此外,该数据集可用于领先搜索。 使用前手还可以使手势数量增加 2 倍,以与大量计算机响应相匹配。 我们在这个主题上的后续工作包括通过添加新的静态手势和具有与目标手势相似的用户手部自然行为的样本来增加数据集的大小。

另外还有计划使用额外的注释来扩展标记,例如性别、分割掩码、关键点等。 此外,我们即将推出用于图像和视频识别以及一些流行的计算机视觉任务的新数据集。

在本文中,我们介绍了名为 HaGRID 的 HAnd Gesture Recognition Dataset,它在主题和收集条件方面是最大和最多样化的数据集之一。 手势数据集主要用于系统控制设备,但其应用潜力相当巨大。 与其他数据集相比,HaGRID 是最复杂的数据集,因为它是从大约 35.000

具有不同照明和距相机距离的场景。此外,还提供了 HGR 任务评估的基线。