♥️作者:小刘在C站

♥️个人主页: 小刘主页

♥️努力不一定有回报,但一定会有收获加油!一起努力,共赴美好人生!

♥️学习两年总结出的运维经验,以及思科模拟器全套网络实验教程。专栏:云计算技术

♥️小刘私信可以随便问,只要会绝不吝啬,感谢CSDN让你我相遇!

目录

5.2

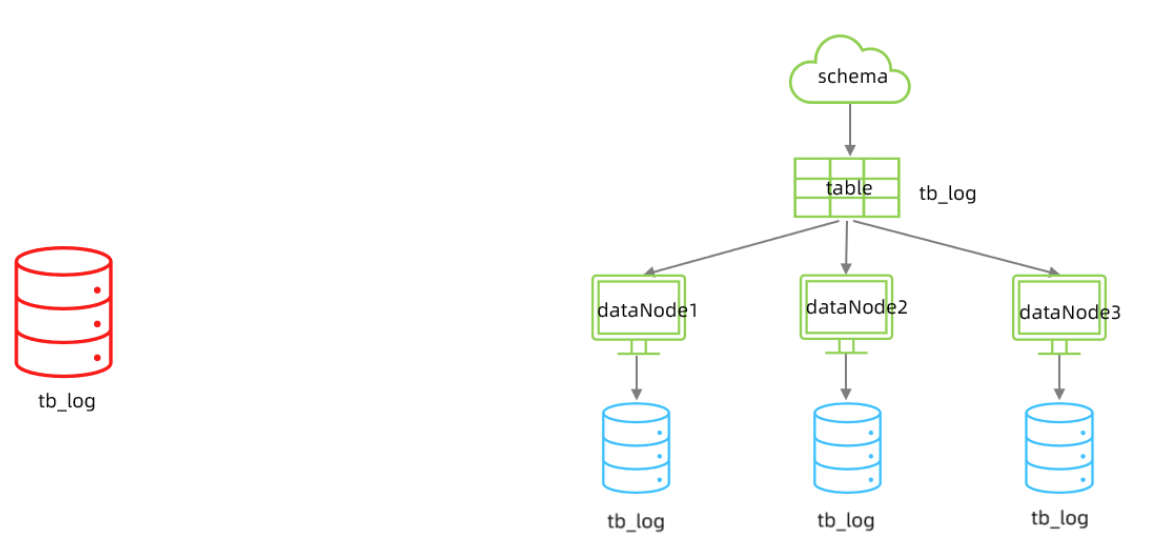

水平拆分

5.2.1 场景

在业务系统中

,

有一张表

(

日志表

),

业务系统每天都会产生大量的日志数据

,

单台服务器的数据存

储及处理能力是有限的

,

可以对数据库表进行拆分。

5.2.2 准备

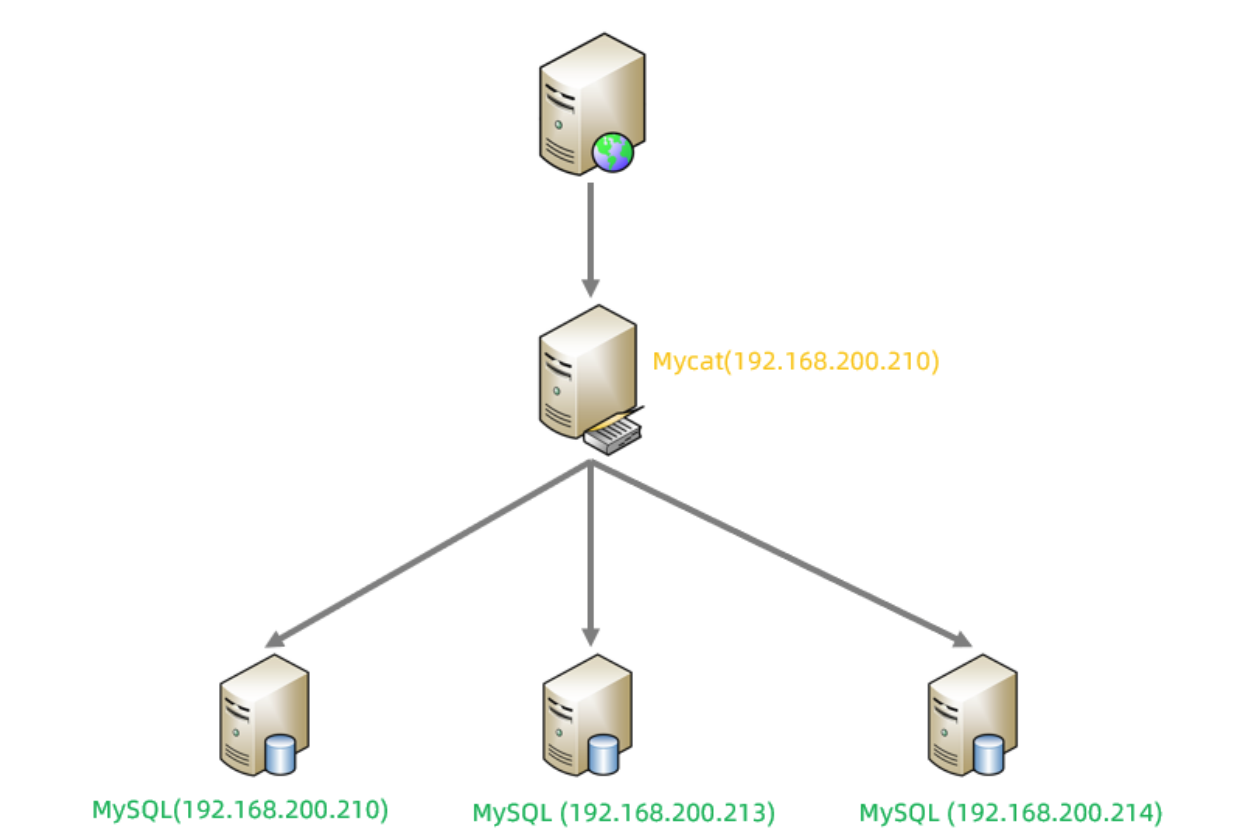

准备三台服务器,具体的结构如下:

并且,在三台数据库服务器中分表创建一个数据库itcast。

5.2.3 配置

1). schema.xml

<schema name="ITCAST" checkSQLschema="true" sqlMaxLimit="100">

<table name="tb_log" dataNode="dn4,dn5,dn6" primaryKey="id" rule="mod-long" />

</schema>

<dataNode name="dn4" dataHost="dhost1" database="itcast" />

<dataNode name="dn5" dataHost="dhost2" database="itcast" />

<dataNode name="dn6" dataHost="dhost3" database="itcast" />

tb_log

表最终落在

3

个节点中,分别是

dn4

、

dn5

、

dn6

,而具体的数据分别存储在

dhost1

、

dhost2

、

dhost3

的

itcast

数据库中。

2). server.xml

配置

root

用户既可以访问

SHOPPING

逻辑库,又可以访问

ITCAST

逻辑库。

<user name="root" defaultAccount="true">

<property name="password">123456</property>

<property name="schemas">SHOPPING,ITCAST</property>

<!-- 表级 DML 权限设置 -->

<!--

<privileges check="true">

<schema name="DB01" dml="0110" >

<table name="TB_ORDER" dml="1110"></table>

</schema>

</privileges>

-->

</user>

5.2.4 测试

配置完毕后,重新启动

MyCat

,然后在

mycat

的命令行中,执行如下

SQL

创建表、并插入数据,查看数

据分布情况。

CREATE TABLE tb_log (

id bigint(20) NOT NULL COMMENT 'ID',

model_name varchar(200) DEFAULT NULL COMMENT '模块名',

model_value varchar(200) DEFAULT NULL COMMENT '模块值',

return_value varchar(200) DEFAULT NULL COMMENT '返回值',

return_class varchar(200) DEFAULT NULL COMMENT '返回值类型',

operate_user varchar(20) DEFAULT NULL COMMENT '操作用户',

operate_time varchar(20) DEFAULT NULL COMMENT '操作时间',

param_and_value varchar(500) DEFAULT NULL COMMENT '请求参数名及参数值',

operate_class varchar(200) DEFAULT NULL COMMENT '操作类',

operate_method varchar(200) DEFAULT NULL COMMENT '操作方法',

cost_time bigint(20) DEFAULT NULL COMMENT '执行方法耗时, 单位 ms',

source int(1) DEFAULT NULL COMMENT '来源 : 1 PC , 2 Android , 3 IOS',

PRIMARY KEY (id)

) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4;

INSERT INTO tb_log (id, model_name, model_value, return_value, return_class,

operate_user, operate_time, param_and_value, operate_class, operate_method,

cost_time,source)

VALUES('1','user','insert','success','java.lang.String','10001','2022-01-06

18:12:28','{\"age\":\"20\",\"name\":\"Tom\",\"gender\":\"1\"}','cn.itcast.contro

ller.UserController','insert','10',1);

INSERT INTO tb_log (id, model_name, model_value, return_value, return_class,

operate_user, operate_time, param_and_value, operate_class, operate_method,

cost_time,source)

VALUES('2','user','insert','success','java.lang.String','10001','2022-01-06

18:12:27','{\"age\":\"20\",\"name\":\"Tom\",\"gender\":\"1\"}','cn.itcast.contro

ller.UserController','insert','23',1);

INSERT INTO tb_log (id, model_name, model_value, return_value, return_class,

operate_user, operate_time, param_and_value, operate_class, operate_method,

cost_time,source)

VALUES('3','user','update','success','java.lang.String','10001','2022-01-06

18:16:45','{\"age\":\"20\",\"name\":\"Tom\",\"gender\":\"1\"}','cn.itcast.contro

ller.UserController','update','34',1);

INSERT INTO tb_log (id, model_name, model_value, return_value, return_class,

operate_user, operate_time, param_and_value, operate_class, operate_method,

cost_time,source)

VALUES('4','user','update','success','java.lang.String','10001','2022-01-06

18:16:45','{\"age\":\"20\",\"name\":\"Tom\",\"gender\":\"1\"}','cn.itcast.contro

ller.UserController','update','13',2);

INSERT INTO tb_log (id, model_name, model_value, return_value, return_class,

operate_user, operate_time, param_and_value, operate_class, operate_method,

cost_time,source)

VALUES('5','user','insert','success','java.lang.String','10001','2022-01-06

18:30:31','{\"age\":\"200\",\"name\":\"TomCat\",\"gender\":\"0\"}','cn.itcast.co

ntroller.UserController','insert','29',3);

INSERT INTO tb_log (id, model_name, model_value, return_value, return_class,

operate_user, operate_time, param_and_value, operate_class, operate_method,

cost_time,source)

VALUES('6','user','find','success','java.lang.String','10001','2022-01-06

18:30:31','{\"age\":\"200\",\"name\":\"TomCat\",\"gender\":\"0\"}','cn.itcast.co

ntroller.UserController','find','29',2);5.3 分片规则

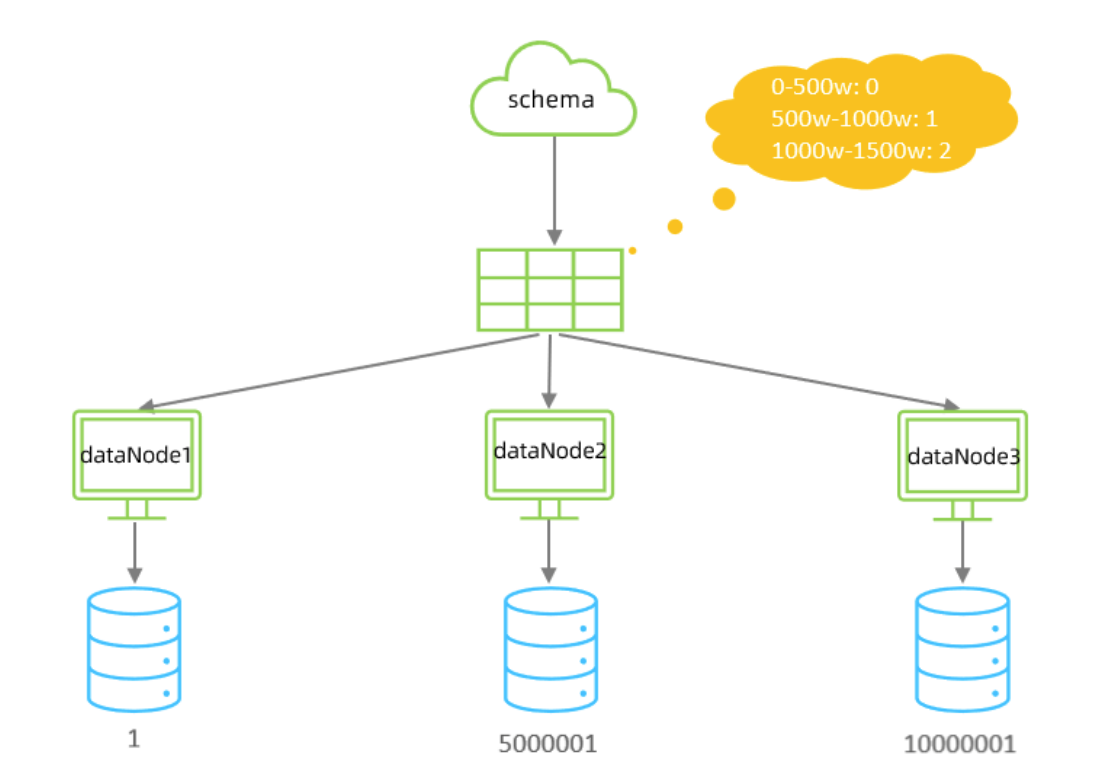

5.3.1 范围分片

1). 介绍

根据指定的字段及其配置的范围与数据节点的对应情况, 来决定该数据属于哪一个分片。

2). 配置

schema.xml逻辑表配置:

<table name="TB_ORDER" dataNode="dn1,dn2,dn3" rule="auto-sharding-long" />schema.xml数据节点配置:

<dataNode name="dn1" dataHost="dhost1" database="db01" />

<dataNode name="dn2" dataHost="dhost2" database="db01" />

<dataNode name="dn3" dataHost="dhost3" database="db01" />

rule.xml

分片规则配置:

<tableRule name="auto-sharding-long">

<rule>

<columns>id</columns>

<algorithm>rang-long</algorithm>

</rule>

</tableRule>

<function name="rang-long" class="io.mycat.route.function.AutoPartitionByLong">

<property name="mapFile">autopartition-long.txt</property>

<property name="defaultNode">0</property>

</function>

分片规则配置属性含义:

在

rule.xml

中配置分片规则时,关联了一个映射配置文件

autopartition-long.txt

,该配置文

件的配置如下:

# range start-end ,data node index

# K=1000,M=10000.

0-500M=0

500M-1000M=1

1000M-1500M=2

含义:

0-500

万之间的值,存储在

0

号数据节点

(

数据节点的索引从

0

开始

)

;

500

万

-1000

万之间的

数据存储在

1

号数据节点 ;

1000

万

-1500

万的数据节点存储在

2

号节点 ;

该分片规则,主要是针对于数字类型的字段适用。 在

MyCat

的入门程序中,我们使用的就是该分片规则。

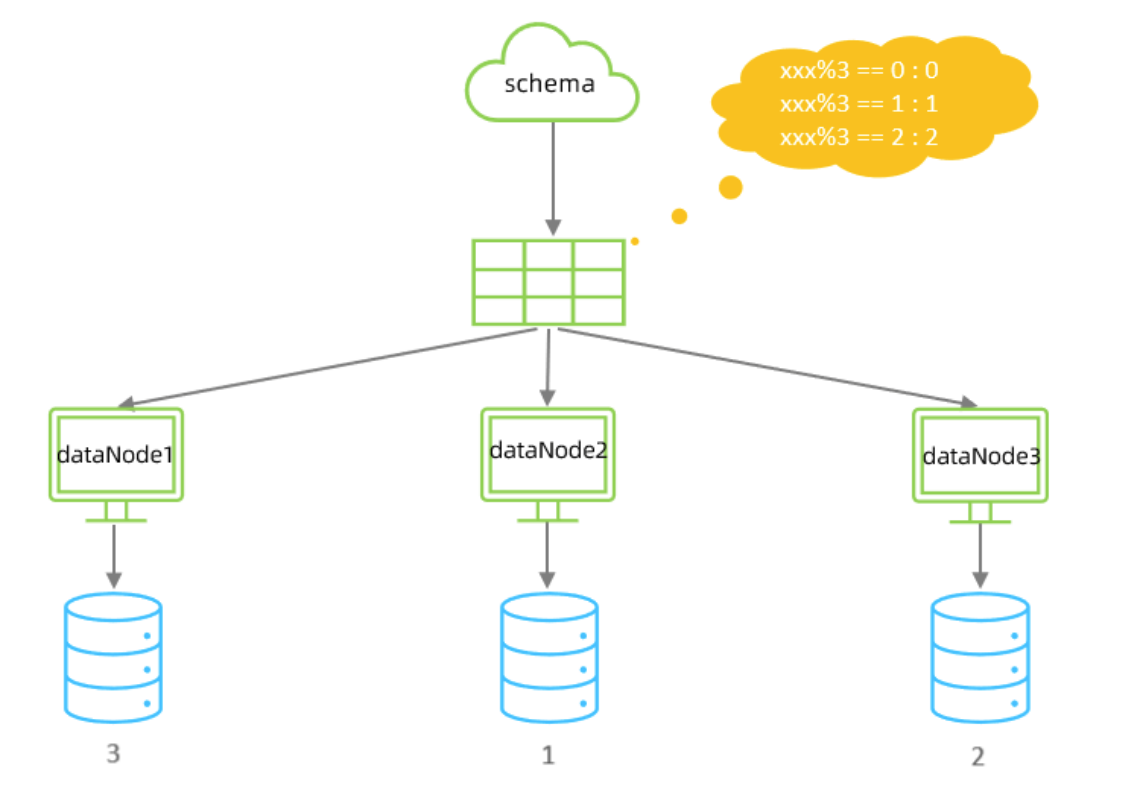

5.3.2 取模分片

1). 介绍

根据指定的字段值与节点数量进行求模运算,根据运算结果, 来决定该数据属于哪一个分片。

2). 配置

schema.xml

逻辑表配置:

<table name="tb_log" dataNode="dn4,dn5,dn6" primaryKey="id" rule="mod-long" />

schema.xml

数据节点配置:

<dataNode name="dn4" dataHost="dhost1" database="itcast" />

<dataNode name="dn5" dataHost="dhost2" database="itcast" />

<dataNode name="dn6" dataHost="dhost3" database="itcast" />

rule.xml

分片规则配置:

<tableRule name="mod-long">

<rule>

<columns>id</columns>

<algorithm>mod-long</algorithm>

</rule>

</tableRule>

<function name="mod-long" class="io.mycat.route.function.PartitionByMod">

<property name="count">3</property>

</function>

分片规则属性说明如下:

该分片规则,主要是针对于数字类型的字段适用。 在前面水平拆分的演示中,我们选择的就是取模分片。

3). 测试

配置完毕后,重新启动

MyCat

,然后在

mycat

的命令行中,执行如下

SQL

创建表、并插入数据,查看数据分布情况。

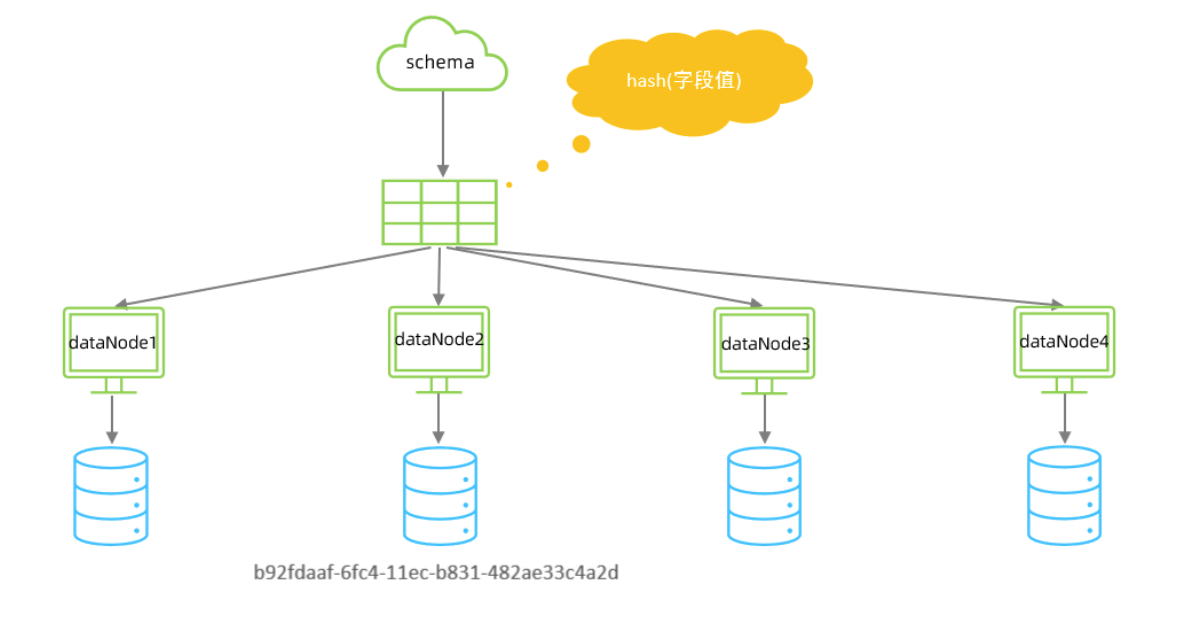

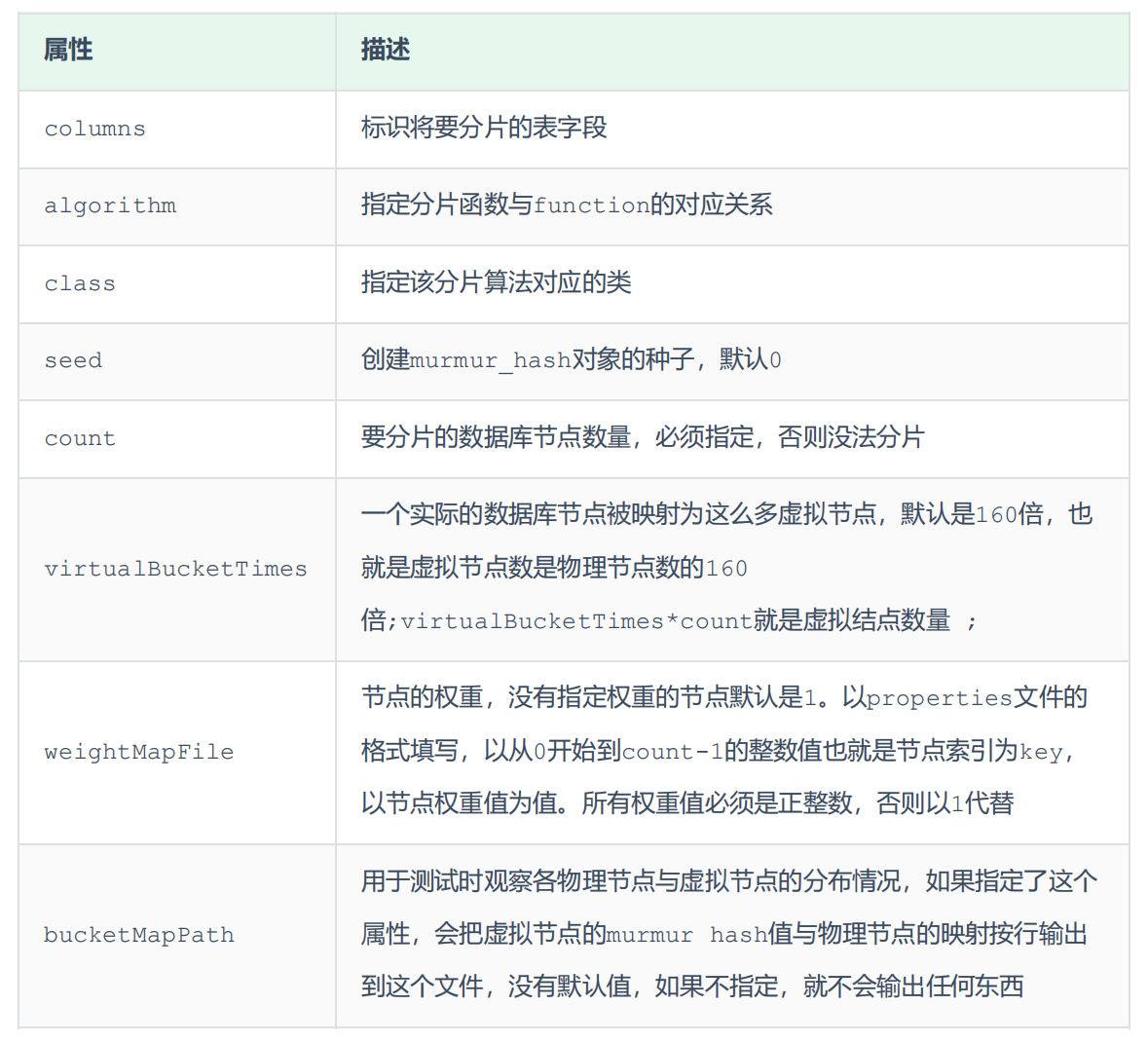

5.3.3 一致性hash分片

1). 介绍

所谓一致性哈希,相同的哈希因子计算值总是被划分到相同的分区表中,不会因为分区节点的增加而改变原来数据的分区位置,有效的解决了分布式数据的拓容问题。

2). 配置

schema.xml

中逻辑表配置:

<!-- 一致性hash -->

<table name="tb_order" dataNode="dn4,dn5,dn6" rule="sharding-by-murmur" />

schema.xml

中数据节点配置:

<dataNode name="dn4" dataHost="dhost1" database="itcast" />

<dataNode name="dn5" dataHost="dhost2" database="itcast" />

<dataNode name="dn6" dataHost="dhost3" database="itcast" />

rule.xml

中分片规则配置:

<tableRule name="sharding-by-murmur">

<rule>

<columns>id</columns>

<algorithm>murmur</algorithm>

</rule>

</tableRule>

<function name="murmur" class="io.mycat.route.function.PartitionByMurmurHash">

<property name="seed">0</property><!-- 默认是0 -->

<property name="count">3</property>

<property name="virtualBucketTimes">160</property>

</function>

分片规则属性含义:

3). 测试

配置完毕后,重新启动

MyCat

,然后在

mycat

的命令行中,执行如下

SQL

创建表、并插入数据,查看数

据分布情况。

create table tb_order(

id varchar(100) not null primary key,

money int null,

content varchar(200) null

);

INSERT INTO tb_order (id, money, content) VALUES ('b92fdaaf-6fc4-11ec-b831-

482ae33c4a2d', 10, 'b92fdaf8-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b93482b6-6fc4-11ec-b831-

482ae33c4a2d', 20, 'b93482d5-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b937e246-6fc4-11ec-b831-

482ae33c4a2d', 50, 'b937e25d-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b93be2dd-6fc4-11ec-b831-

482ae33c4a2d', 100, 'b93be2f9-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b93f2d68-6fc4-11ec-b831-

482ae33c4a2d', 130, 'b93f2d7d-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b9451b98-6fc4-11ec-b831-

482ae33c4a2d', 30, 'b9451bcc-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b9488ec1-6fc4-11ec-b831-

482ae33c4a2d', 560, 'b9488edb-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b94be6e6-6fc4-11ec-b831-

482ae33c4a2d', 10, 'b94be6ff-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b94ee10d-6fc4-11ec-b831-

482ae33c4a2d', 123, 'b94ee12c-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b952492a-6fc4-11ec-b831-

482ae33c4a2d', 145, 'b9524945-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b95553ac-6fc4-11ec-b831-

482ae33c4a2d', 543, 'b95553c8-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b9581cdd-6fc4-11ec-b831-

482ae33c4a2d', 17, 'b9581cfa-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b95afc0f-6fc4-11ec-b831-

482ae33c4a2d', 18, 'b95afc2a-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b95daa99-6fc4-11ec-b831-

482ae33c4a2d', 134, 'b95daab2-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b9667e3c-6fc4-11ec-b831-

482ae33c4a2d', 156, 'b9667e60-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b96ab489-6fc4-11ec-b831-

482ae33c4a2d', 175, 'b96ab4a5-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b96e2942-6fc4-11ec-b831-

482ae33c4a2d', 180, 'b96e295b-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b97092ec-6fc4-11ec-b831-

482ae33c4a2d', 123, 'b9709306-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b973727a-6fc4-11ec-b831-

482ae33c4a2d', 230, 'b9737293-6fc4-11ec-b831-482ae33c4a2d');

INSERT INTO tb_order (id, money, content) VALUES ('b978840f-6fc4-11ec-b831-

482ae33c4a2d', 560, 'b978843c-6fc4-11ec-b831-482ae33c4a2d');♥️关注,就是我创作的动力

♥️点赞,就是对我最大的认可

♥️这里是小刘,励志用心做好每一篇文章,谢谢大家