论文速读 – CenterPoint (Center-based 3D Object Detection and Tracking)

参考:

1. CenterPoint 论文

2. CenterPoint code

3. CenterPoint 论文笔记

4. CVPR 2021 | CenterPoint

5. 3D版CenterNet: CenterPoint,小修小改也能刷爆榜单

6. CenterPoint 运行记录

7. CenterPoint 腾讯云

一. 摘要

三维物体通常使用点云中的 3D 框表示。这种表示模仿了基于图像的 2D 边界框检测,但3D 世界中的物体不遵循任何特定方向,并且基于3D盒子的检测器难以枚举所有方向或拟合旋转对象的轴对齐边界框。我们的框架 CenterPoint 首先检测使用关键点检测器检测物体中心,同时回归其他属性:3D 大小、3D 方向和速度。在第二阶段,它使用目标上的附加点特征来细化以上的估计。3D对象跟踪简化为贪婪的最近点匹配。该检测和跟踪算法简单,高效和有效。 在 nuScenes 和 Waymo 开放数据集上,展现出了sota效果。

二. 介绍

CenterPoint使用基于lidar的主干网络,如VoxelNet或者PointPillars对输入点云进行表征。基于中心点的表示有很多好处,如不像包围盒,点没有旋转的概念;另外可以简化下游任务追踪;还方便更有效设计第二阶段的细化模块,第二阶段提取被估计物体三维边界框中每个面的三维中心的点特征。 它恢复了由于步幅和有限的接收域而丢失的局部几何信息,比之前方案更有效。

相关工作:

2D目标检测:预测沿坐标轴的包围盒。RCNN家族识别类别未知包围盒,YOLO, SSD, and RetinaNet识别特定类别box候选。CenterNet 、CenterTrack直接检测物体中心点,不需要候选box。

3D目标检测:预测三维包围盒。Vote3Deep、VoxelNet、SECOND、PIXOR、PointPillars、MVF、Pillar-od、VoteNet

两阶段3D目标检测:ROIPool、RoIAlign

3D目标追踪:3D卡尔曼滤波器、CenterTrack。

预备工作:

2D CenterNet产生一张热力图(heatmap)w×h×k,k代表类别,局部八邻域最大值代表被检测物体中心.CenterNet 先预测每个类别的物体中心,再设置两个通道w×h×2回归物体的尺寸(object size ),包含物体宽和高。同时回归了一个局部偏移(local_offset)。

**3D 检测。**通常做法:通过VoxelNet或者PointPillars,经过主干网络,将一帧点云处理成图视角的特征图(map-view feature map,W×L×F),再加上一个检测头

三. 网络和方法

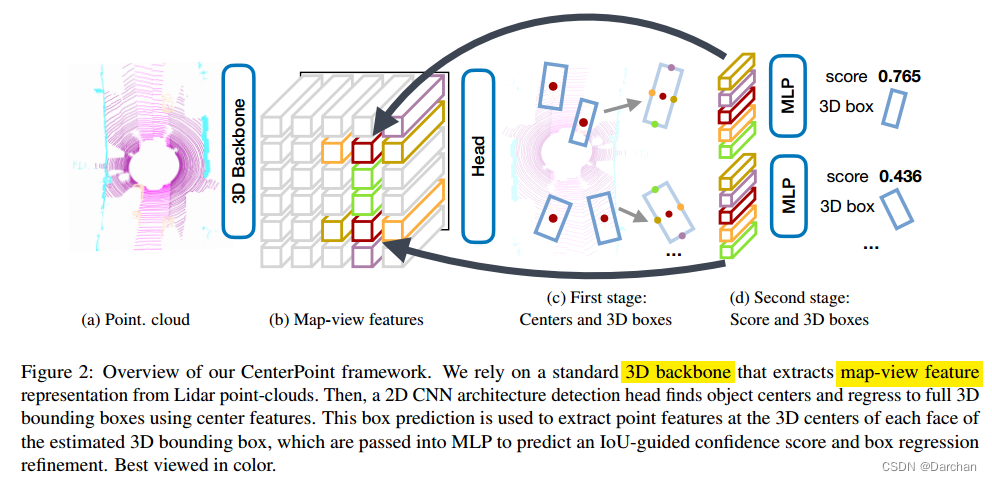

网络整体架构如下图。CenterPoint的第一阶段预测特定类别的热图、目标大小、亚体素位置细化、旋转和速度,所有的输出都是密集的预测。

3.1 第一阶段Centers and 3D boxes

1. 中心热力图头。

目标是产生任何检测物体的热力图顶峰(peak)的中心位置。在训练过程中,热力图顶峰将通过利用带标注的包围盒的三维中心投影到地图视图(map-view)中,再利用二维高斯曲线生成。然后使用Focal loss进行训练。如果直接使用标准的CenterNet进行训练,将导致非常稀疏的监督信号,大部分位置会被认为是背景。作者通过扩大每个真值(gt)目标中心的高斯peak, 增大了监督信号。

2. 回归头。

我们还需要保存其他属性:

- 子体素(sub-voxel)位置细化:减少主干网络中的体素化和步进操作的量化误差,二维。

- 地面以上高度:定位物体,添加高度信息,一维

- 3D尺寸:三维

- yaw角:二维

3. 速度头和追踪。

速度估计需要当前帧和过去帧,两帧数据。然后预测这两帧的位置差别,使用L1 loss进行监督。在推理的时候,使用这个偏移(offset)联系前后帧的检测。把当前帧的目标中心投影到前一帧,计算它们负的速度估计,然后进行最近距离的匹配。

3.2 第二阶段CenterPoint。

从主干网络输出提取额外的点特征(point-feature)。我们从预测的3D目标的每个面的中心提取一个点特征。因为顶部、底部的中心在map-view中都是一个中心,因此作者就考虑了四个点和一个中心点。对于每一个点,使用双线性插值来获取。

四. 实验和结果

评价指标:mAP ,mAPH,NDS,PKL,MOTA,MOTP

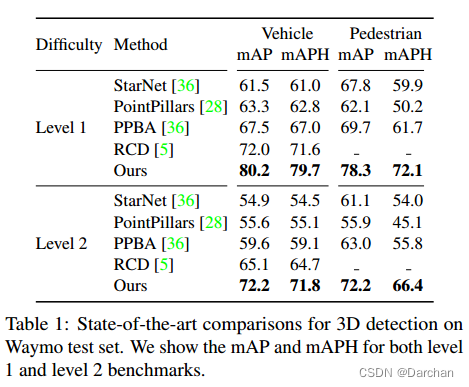

Waymo

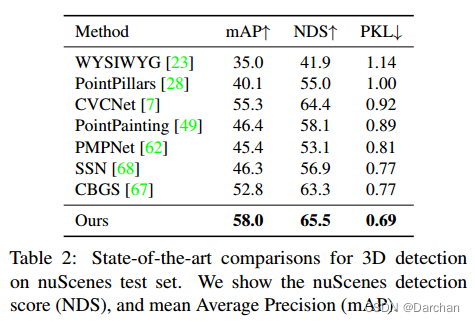

nuScenes