目录

1.Yolov8介绍

Ultralytics YOLOv8是Ultralytics公司开发的YOLO目标检测和图像分割模型的最新版本。YOLOv8是一种尖端的、最先进的(SOTA)模型,它建立在先前YOLO成功基础上,并引入了新功能和改进,以进一步提升性能和灵活性。它可以在大型数据集上进行训练,并且能够在各种硬件平台上运行,从CPU到GPU。

具体改进如下:

-

Backbone:使用的依旧是CSP的思想,不过YOLOv5中的C3模块被替换成了C2f模块,实现了进一步的轻量化,同时YOLOv8依旧使用了YOLOv5等架构中使用的SPPF模块;

-

PAN-FPN:毫无疑问YOLOv8依旧使用了PAN的思想,不过通过对比YOLOv5与YOLOv8的结构图可以看到,YOLOv8将YOLOv5中PAN-FPN上采样阶段中的卷积结构删除了,同时也将C3模块替换为了C2f模块;

-

Decoupled-Head:是不是嗅到了不一样的味道?是的,YOLOv8走向了Decoupled-Head;

-

Anchor-Free:YOLOv8抛弃了以往的Anchor-Base,使用了Anchor-Free的思想;

-

损失函数:YOLOv8使用VFL Loss作为分类损失,使用DFL Loss+CIOU Loss作为分类损失;

-

样本匹配:YOLOv8抛弃了以往的IOU匹配或者单边比例的分配方式,而是使用了Task-Aligned Assigner匹配方式

框架图提供见链接:Brief summary of YOLOv8 model structure · Issue #189 · ultralytics/ultralytics · GitHub

2.野外火灾烟雾数据集介绍

数据集大小737张,train:val:test 随机分配为7:2:1,类别:smoke

3.Gold-YOLO

链接:https://arxiv.org/pdf/2309.11331.pdf

代码:https://github.com/huawei-noah/Efficient-Computing/tree/master/Detection/Gold-YOLO

单位:华为诺亚方舟实验室

理论部分可参考:超越YOLO系列!华为提出Gold-YOLO:高效实时目标检测器 - 知乎

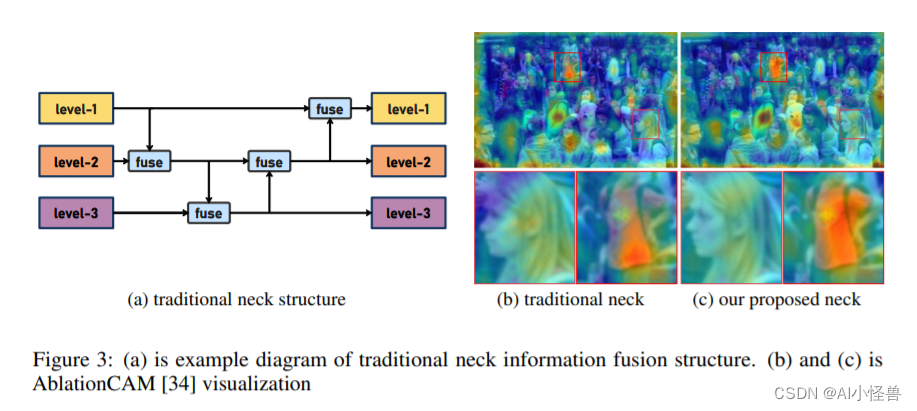

传统YOLO的问题

在检测模型中,通常先经过backbone提取得到一系列不同层级的特征,FPN利用了backbone的这一特点,构建了相应的融合结构:不层级的特征包含着不同大小物体的位置信息,虽然这些特征包含的信息不同,但这些特征在相互融合后能够互相弥补彼此缺失的信息,增强每一层级信息的丰富程度,提升网络性能。

原始的FPN结构由于其层层递进的信息融合模式,使得相邻层的信息能够充分融合,但也导致了跨层信息融合存在问题:当跨层的信息进行交互融合时,由于没有直连的交互通路,只能依靠中间层充当“中介”进行融合,导致了一定的信息损失。之前的许多工作中都关注到了这一问题,而解决方案通常是通过添加shortcut增加更多的路径,以增强信息流动。

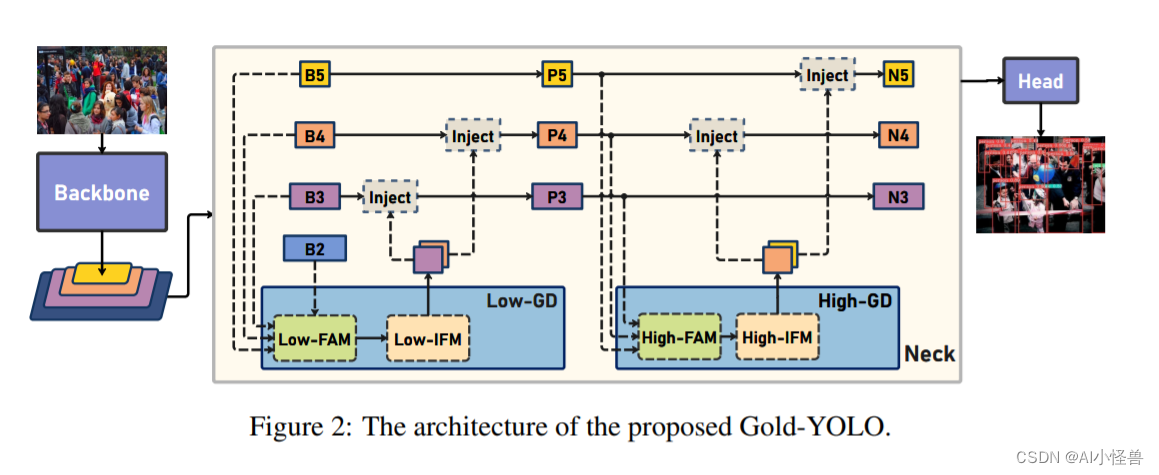

摘要:当前YOLO系列模型通常采用类FPN方法进行信息融合,而这一结构在融合跨层信息时存在信息损失的问题。针对这一问题,我们提出了全新的信息聚集-分发(Gather-and-Distribute Mechanism)GD机制,通过在全局视野上对不同层级的特征进行统一的聚集融合并分发注入到不同层级中,构建更加充分高效的信息交互融合机制,并基于GD机制构建了Gold-YOLO。在COCO数据集中,我们的Gold-YOLO超越了现有的YOLO系列,实现了精度-速度曲线上的SOTA。

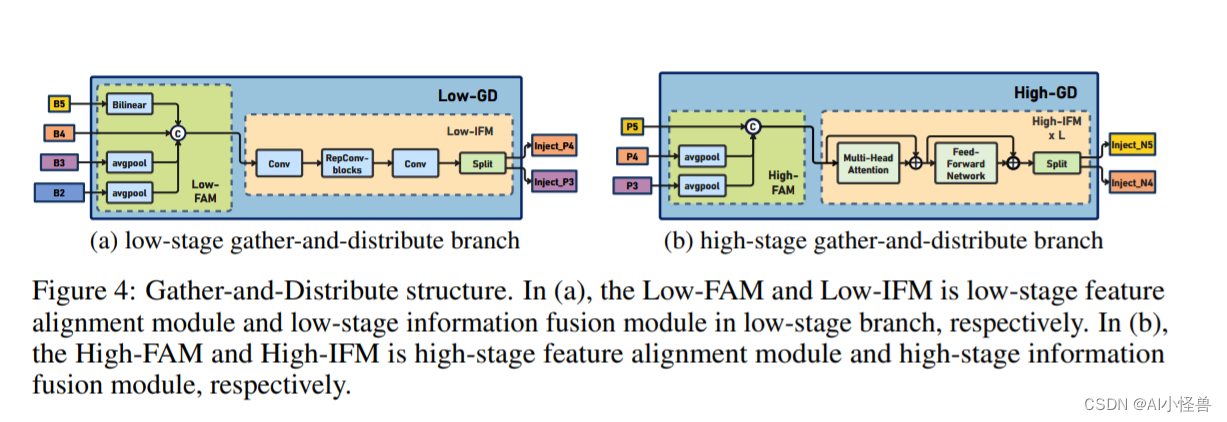

提出了一种全新的信息交互融合机制:信息聚集-分发机制(Gather-and-Distribute Mechanism)。该机制通过在全局上融合不同层次的特征得到全局信息,并将全局信息注入到不同层级的特征中,实现了高效的信息交互和融合。在不显著增加延迟的情况下GD机制显著增强了Neck部分的信息融合能力,提高了模型对不同大小物体的检测能力。

在Gold-YOLO中,针对模型需要检测不同大小的物体的需要,并权衡精度和速度,我们构建了两个GD分支对信息进行融合:低层级信息聚集-分发分支(Low-GD)和高层级信息聚集-分发分支(High-GD),分别基于卷积和transformer提取和融合特征信息。

实验结果:

针对Gold-YOLO中不同分支和结构对模型精度和速度的影响,进行了相应的消融实验。

针对Gold-YOLO中不同分支和结构对模型精度和速度的影响,进行了相应的消融实验。

3.1gold-yolo引入到yolov8

3.2 gold-yolo加入到yolov8

核心代码:

class Attention(torch.nn.Module):

def __init__(self, dim, key_dim, num_heads, attn_ratio=4):

super().__init__()

self.num_heads = num_heads

self.scale = key_dim ** -0.5

self.key_dim = key_dim

self.nh_kd = nh_kd = key_dim * num_heads # num_head key_dim

self.d = int(attn_ratio * key_dim)

self.dh = int(attn_ratio * key_dim) * num_heads

self.attn_ratio = attn_ratio

self.to_q = Conv(dim, nh_kd, 1, act=False)

self.to_k = Conv(dim, nh_kd, 1, act=False)

self.to_v = Conv(dim, self.dh, 1, act=False)

self.proj = torch.nn.Sequential(nn.ReLU6(), Conv(self.dh, dim, act=False))

def forward(self, x): # x (B,N,C)

B, C, H, W = get_shape(x)

qq = self.to_q(x).reshape(B, self.num_heads, self.key_dim, H * W).permute(0, 1, 3, 2)

kk = self.to_k(x).reshape(B, self.num_heads, self.key_dim, H * W)

vv = self.to_v(x).reshape(B, self.num_heads, self.d, H * W).permute(0, 1, 3, 2)

attn = torch.matmul(qq, kk)

attn = attn.softmax(dim=-1) # dim = k

xx = torch.matmul(attn, vv)

xx = xx.permute(0, 1, 3, 2).reshape(B, self.dh, H, W)

xx = self.proj(xx)

return xx

class top_Block(nn.Module):

def __init__(self, dim, key_dim, num_heads, mlp_ratio=4., attn_ratio=2., drop=0.,

drop_path=0.):

super().__init__()

self.dim = dim

self.num_heads = num_heads

self.mlp_ratio = mlp_ratio

self.attn = Attention(dim, key_dim=key_dim, num_heads=num_heads, attn_ratio=attn_ratio)

# NOTE: drop path for stochastic depth, we shall see if this is better than dropout here

self.drop_path = DropPath(drop_path) if drop_path > 0. else nn.Identity()

mlp_hidden_dim = int(dim * mlp_ratio)

self.mlp = Mlp(in_features=dim, hidden_features=mlp_hidden_dim, drop=drop)

def forward(self, x1):

x1 = x1 + self.drop_path(self.attn(x1))

x1 = x1 + self.drop_path(self.mlp(x1))

return x1

class TopBasicLayer(nn.Module):

def __init__(self, embedding_dim, ouc_list, block_num=2, key_dim=8, num_heads=4,

mlp_ratio=4., attn_ratio=2., drop=0., attn_drop=0., drop_path=0.):

super().__init__()

self.block_num = block_num

self.transformer_blocks = nn.ModuleList()

for i in range(self.block_num):

self.transformer_blocks.append(top_Block(

embedding_dim, key_dim=key_dim, num_heads=num_heads,

mlp_ratio=mlp_ratio, attn_ratio=attn_ratio,

drop=drop, drop_path=drop_path[i] if isinstance(drop_path, list) else drop_path))

self.conv = nn.Conv2d(embedding_dim, sum(ouc_list), 1)

def forward(self, x):

# token * N

for i in range(self.block_num):

x = self.transformer_blocks[i](x)

return self.conv(x)

class AdvPoolFusion(nn.Module):

def forward(self, x):

x1, x2 = x

if torch.onnx.is_in_onnx_export():

self.pool = onnx_AdaptiveAvgPool2d

else:

self.pool = nn.functional.adaptive_avg_pool2d

N, C, H, W = x2.shape

output_size = np.array([H, W])

x1 = self.pool(x1, output_size)

return torch.cat([x1, x2], 1)核心代码:

全网首发YOLOv8暴力涨点:Gold-YOLO,遥遥领先,超越所有YOLO | 华为诺亚NeurIPS23_AI小怪兽的博客-CSDN博客

4.训练结果分析

训练结果如下:

原始[email protected] 0.839提升至0.954

YOLOv8-goldYOLO summary: 359 layers, 6015123 parameters, 0 gradients, 11.9 GFLOPs

Class Images Instances Box(P R mAP50 mAP50-95): 100%|██████████| 25/25 [00:06<00:00, 3.84it/s]

all 199 199 0.88 0.93 0.954 0.5555.系列篇

2)基于Yolov8的野外烟雾检测(2):多维协作注意模块MCA| 2023.9最新发布

3)基于Yolov8的野外烟雾检测(3):动态蛇形卷积,实现暴力涨点 | ICCV2023