1.线性回归比较简单,描述了自变量和因变量之间的简单线性关系,我们的目标是通过特征的组合来学习到要预测函数式(线性式),如下面的式子:

用向量形式表示,我们可以将其表示为:

2.本质上是在特征空间上找到一条直线来拟合目标值y的数据分布情况。

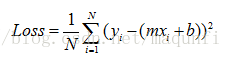

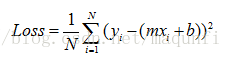

3.对于参数w的求取我们使用最常用的最小二乘法(最小平方法)定义损失函数:

4.举个调用LR的代码例子:

1.线性回归比较简单,描述了自变量和因变量之间的简单线性关系,我们的目标是通过特征的组合来学习到要预测函数式(线性式),如下面的式子:

用向量形式表示,我们可以将其表示为:

2.本质上是在特征空间上找到一条直线来拟合目标值y的数据分布情况。

3.对于参数w的求取我们使用最常用的最小二乘法(最小平方法)定义损失函数:

4.举个调用LR的代码例子: