版权声明:转载时,请务必注明文章出处网址,谢谢! https://blog.csdn.net/Gentleman_Qin/article/details/81047478

1、深度学习(Deep Learning):

是建立在计算机神经网络理论和机器学习理论上的系统科学,它使用建立在复杂的机器结构上的多处理层,结合非线性转换方法算法,对高层复杂数据模型进行抽象。

深度学习有两大要素:

(1)数据表示:数据是机器学习的基本要素,也是神经输入网进行反馈的源头。数据的表示和建模对深度学习的性能有着很大的影响。目前关于数据表示,有局部表示、分布表示和稀疏分布表示。

(2)特征提取方法:高斯伯努利模型是特征模型的范例,用来提取数据特征。未来的特征算法研究将主要集中在自适应的特征提取和自动编码机制等方面。在提取特征的逻辑层方面,经典的有树结构和图结构。

2、反向传播(

BackPropagation

)算法:

(1)定义:

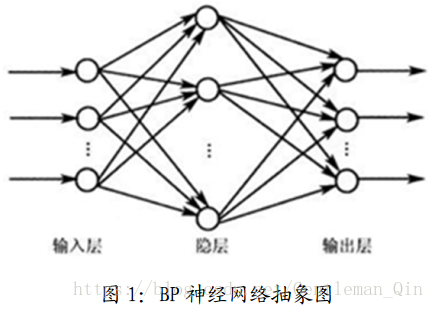

BP 神经网络(如图1)是按误差逆传播算法训练的多层前馈神经网络,它存储大量映射模式关系,无需揭示其映射方程。 BP 算法的核心思想是采用最速下降法(梯度下降法),通过反向传播调试网络的权值和阈值,使得其误差平方和最小。通过数学推导,得出误差逆传播算法的主要特点是:连接权重与学习模式误差成比例变化。

(2)优缺点:

BP 网络所提供的 BP 算法,有着一定的非线性映射能力、多层前馈网的泛化能力和样本容错能力。但是由于其学习速率是固定的,网络的收敛速度很慢,对于复杂问题难以高效解决。其次, BP 算法可以使权值收敛到某个值,但是不能保证其为误差平面的最小值,因为梯度下降方法所求的是局部最小值。同时,隐含层和单元选择没有固定的要求,因此会产生一定的冗余。

3、卷积神经网络(

Convolutional Neural Network

):

CNN 的基本结构包括两层:其一为特征提取层,神经元的输入层与前一层的局部连接域相连从而提取特征,提取完毕之后每个特征也会相互确立稳定的关系。其二是特征映射层,计算层由特征映射层组成,每个特征映射是一个平面,平面上所有神经元共享权值。共享权值的思想也是CNN 的独特之处。这种双层特征提取结构有效提高了特征的分辨率。

4、玻尔兹曼机(Boltzmann Machines):

一种随机递归神经网络,也可以看做是随机的 Hopfield 神经网络,因样本分布遵循玻尔兹曼分布。

(

Hopfield神经网络:是一种递归神经网络,是一种结合存储系统和二元系统的神经网络,保证了向局部极小的收敛,但收敛到错误的局部极小值,而非全局极小的情况也可能发生。)

5、受限玻尔兹曼机(Restricted Boltzmann Machines):

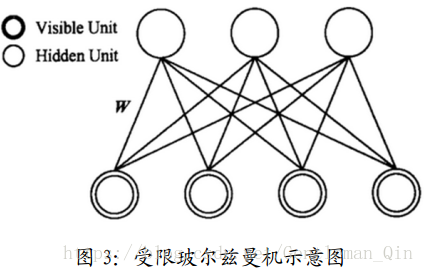

RBM 是一个双向概率图模型,只有可见层节点与隐层节点之间有连接权,可见层节点与可见层节点与隐层节点之间没有连接权。各层内部神经元之间没有连接,很大程度上提高了网络训练与学习的效率。在构造深度置信网络(DBN)时都是先构造出 RBM,再将某些 RBM 堆栈起来得到 DBN。

(

深度置信网络(Deep Belief Network):DBN,是神经网络的一种,既可以用于非监督学习,类似于一个自编码机;也可以用于监督学习,作为分类器来使用。)

(

无监督学习( Unsupervised Learning):在未加标签的数据中,试图找到隐藏的结构。提供给学习者的实例是未标记的,因此没有错误或报酬信号来评估潜在的解决方案。)

(

监督学习( Supervised Learning):利用一组已知类别的样本调整分类器的参数,使其达到所要求性能的过程。)

(

分类器(Classifier):

分类器是数据挖掘中对样本进行分类的方法的统称,包含决策树、逻辑回归、朴素贝叶斯、神经网络等算法。)

(

样本(specimen):统计学概念,总体中抽取的所要考查的元素总称,样本中个体的多少叫样本容量。)

(

数据挖掘(

Data Mining

):一般是指从大量的数据中通过算法搜索隐藏于其中信息的过程。数据挖掘通常与计算机科学有关,并通过统计、在线分析处理、情报检索、机器学习、专家系统(依靠过去的经验法则)和模式识别等诸多方法来实现上述目标。)

6、感知器(Perceptron):它可以被视为一种最简单形式的前馈式人工神经网络,是一种二元线性分类器。

多层感知器(MLP,Multilayer Perceptron)

将输入的多个数据集映射到单一的输出的数据集上。

7、深度神经网络(Deep Neural Network):DNN,

深度神经网络从结构上讲与传统的多层

感知机

没有什么不同,并且在做有

监督学习

时算法也是一样的。唯一的不同是这个网络在做有监督学习前要先做非监督学习,然后将非监督学习学到的

权值

当作有监督学习的初值进行训练。

8、神经网络(Neural Network):

人工神经网络的简称,通过模仿动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的。神经网络的学习是一个过程,在其所处环境的激励下,相继给网络输入一些样本模式,并按照一定的规则(学习算法)调整网络各层的权值矩阵,待网络各层权值都收敛到一定值,学习过程结束。然后我们就可以用生成的神经网络来对真实数据做分类。

9、支持向量机(

Support Vector Machine

):

SVM,是常见的一种判别方法。在机器学习领域,是一个有监督的学习模型,通常用来进行模式识别、分类以及回归分析。

SVM可以概括为两点:

(1)它是针对线性可分情况进行分析,对于线性不可分的情况,通过使用非线性

映射

算法将低维输入空间线性不可分的样本转化为

高维

特征空间使其线性可分,从而使得高维特征空间采用线性算法对样本的非线性特征进行线性分析成为可能。

(2)它基于结构风险最小化理论之上在特征空间中构建最优超平面,使得学习器得到全局最优化,并且在整个样本空间的期望以某个概率满足一定上界。