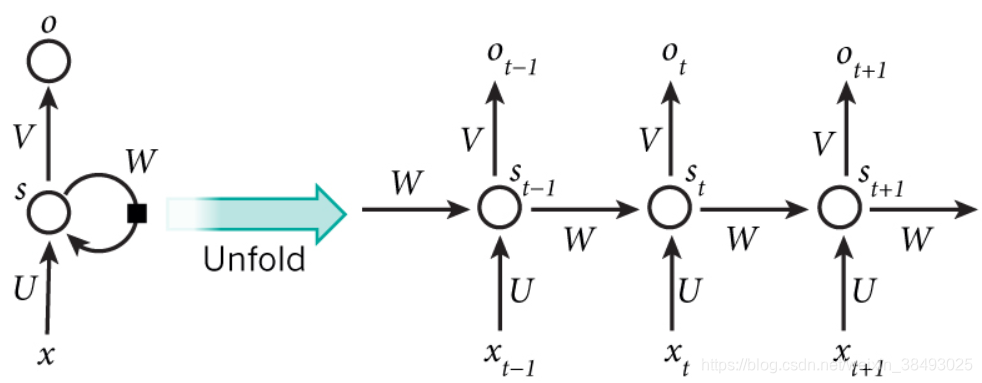

1.RNN

- 针对问题:训练样本是序列数据

- 模型思想:循环反馈

- 模型特点:

(1)随着序列的推进,前面的隐层将会影响后面的隐层

(2)U、V、W权值共享

(3)每个输入只与它本身的那条路线建立权连接,不会和别的神经元连接。 - 模型缺点:梯度消失,无法处理长序列数据(解决:LSTM、GRU)

RNN的前向传播

基于时间反向传播BPTT

(略)

2.LSTM

针对RNN梯度消失问题,对序列索引位置t的隐藏结构做改进:

- 新增另一个隐藏状态,称为细胞状态(LSTM的核心思想)

- 设置门控结构控制细胞状态:遗忘门、输入门、输出门

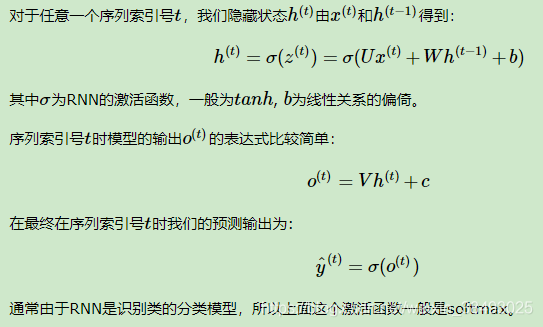

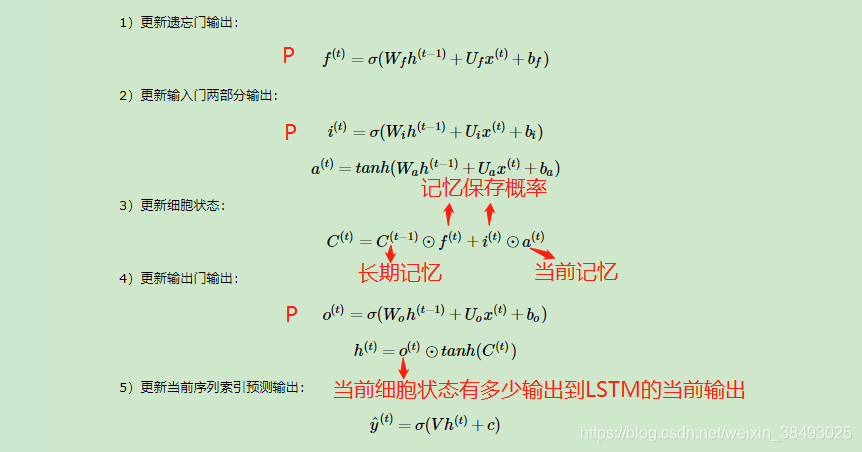

2.1 遗忘门

遗忘门决定了上一时刻的细胞状态

(代表长期的记忆) 有多少保留到当前时刻的细胞状态

。

遗忘门

的公式形式和RNN的隐藏状态

更新公式一致,区别在于激活函数,RNN是tanh激活函数,取值[-1,1],遗忘门是sigmoid函数,取值[0,1]代表遗忘概率。

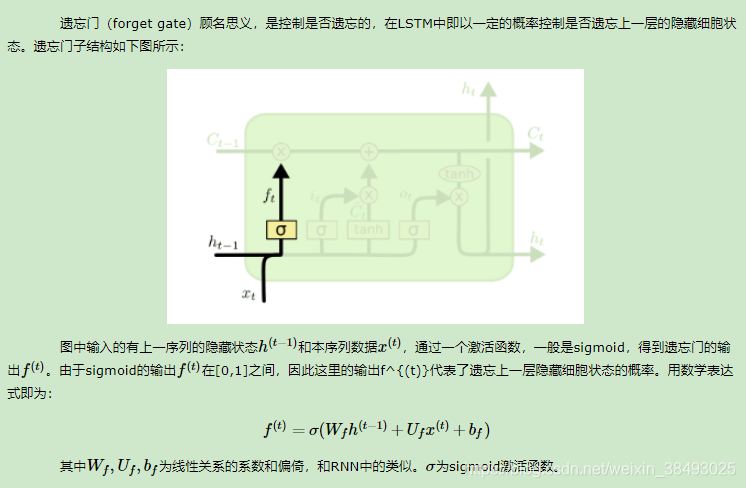

2.2 输入门

输入门决定了当前时刻的输入

有多少保存到当前时刻的细胞状态

输入门的第一部分

表示保存概率,取值[0,1],公式形式和遗忘门完全一样,第二部分

代表当前的记忆,公式形式则和RNN的隐藏状态

更新公式完全一致。

2.3 细胞状态更新

在研究LSTM输出门之前,我们要先看看LSTM之细胞状态。前面的遗忘门和输入门的结果都会作用于细胞状态

。

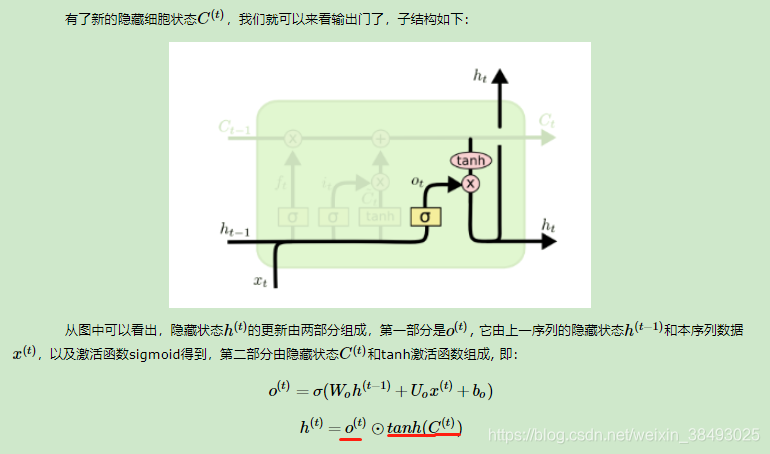

2.4 输出门

输出门决定了当前细胞状态

有多少输出到 LSTM 的当前输出值

。

输出门的第一部分

表示保存概率,公式形式和遗忘门完全一样

LSTM的前向传播

LSTM的反向传播

(略)