1 利用anaconda安装scrapy框架

conda install scrapy

会出现很多的依赖包要求更新和下载,输入y:

等待下载即可

输出scrapy命令,出现如下表示安装成功

2 Scrapy基本使用

创建Scrapy项目

首先进入你要进入你要创建爬虫项目的目录的文件夹,然后执行命令:

scrapy startproject myspiders(项目名)

创建好的项目目录如下:

-

文件说明:

scrapy.cfg :项目的配置信息,主要为Scrapy命令行工具提供一个基础的配置信息。(真正爬虫相关的配置信息在settings.py文件中)

items.py: 设置数据存储模板,用于结构化数据,如:Django的Model

pipelines: 数据处理行为,如:一般结构化的数据持久化

settings.py: 配置文件,如:递归的层数、并发数,延迟下载等

spiders: 爬虫目录,如:创建文件,编写爬虫规则 -

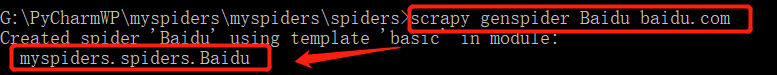

创建爬虫文件

进入爬虫目录文件夹

cd myspiders\spiders

再生成爬虫文件

scrapy genspider Baidu baidu.com

爬虫名为Baidu

在Pycharm中显示如下:

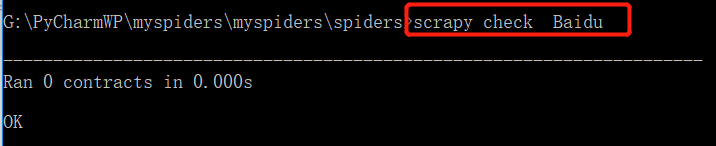

- 检查爬虫

当再次使用scrapy命令时,会出现新的命令,如下:

检查爬虫:

scrapy check Baidu

例如,爬出页面相应体,修改Baidu.py文件

- 运行爬虫

scrapy crawl Baidu

结果如下:

相关实例更新中。。。。。。。。

参考

[1] https://blog.csdn.net/qq_42543250/article/details/81347368

[2] http://www.cnblogs.com/kongzhagen/p/6549053.html

[3] https://www.cnblogs.com/jiangzijiang/p/8459669.html

[4] https://blog.csdn.net/qijingpei/article/details/70194251