hadoop解压之后:

修改 hadoop/etc/hadoop 下的配置文件:

修改 hadoop-env.sh 添加JAVA_HOME 路径

修改 core-site.xml;

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/lishuo/app/hadoop/tmp</value>

</property>

修改 hdfs-site.xml:

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

修改 mapred-site.xml

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

修改 yarn-site.xml

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

将hadoop添加到环境变量

export HADOOP_HOME=/itcast/hadoop-2.4.1

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

格式化namenode

在hadoop/bin目录下:

执行 ./hdfs namenode -format

先启动HDFS

sbin/start-dfs.sh

再启动YARN

sbin/start-yarn.sh

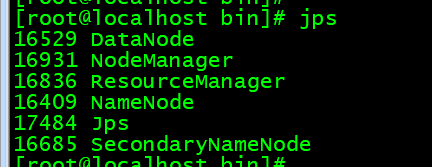

启动的进程

http://192.168.93.132:50070 (HDFS管理界面)

http://192.168.93.132:8088 (MR管理界面)

HDFS shell

查看帮助 hadoop fs -help <cmd>

上传 hadoop fs -put <linux上文件> <hdfs上的路径>

查看文件内容 hadoop fs -cat <hdfs上的路径>

查看文件列表 hadoop fs -ls /

下载文件 hadoop fs -get <hdfs上的路径> <linux上文件>