https://www.vmware.com/cn/products/workstation-pro/workstation-pro-evaluation.html

https://www.cnblogs.com/skyessay/p/6401653.html

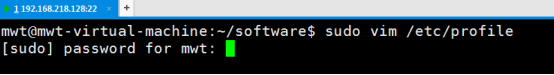

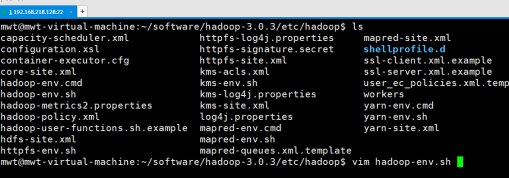

解压缩jdk8

![]()

配置环境变量

输入大写的G定位到最后一行

export JAVA_HOME=/home/mwt/software/jdk1.8.0_171

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export JRE_HOME=$JAVA_HOME/jre

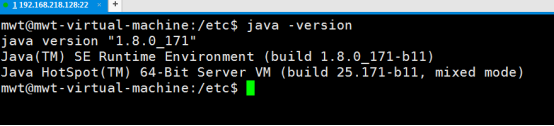

![]()

安装hadoop

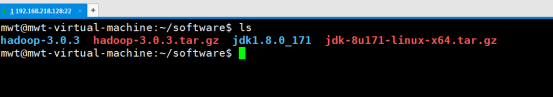

第一个配置文件hadoop-env.sh

export JAVA_HOME=/home/mwt/software/jdk1.8.0_171

第二个配置文件core-site.xml

![]()

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://192.168.218.128:9000</value>

</property>

<!-- 配置hdfs的中间数据存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/mwt/software/hadoop_tmp_dir</value>

</property>

</configuration>

第三个配置文件hdfs-site.xml

<configuration>

<!-- 每份数据存储副本数量,由于目前是单机环境,一台机器只能存一份数据 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

<property>

<name>dfs.http.address</name>

<value>hadoop.edu360.cn:50070</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop.edu360.cn:50090</value>

</property>

</configuration>

第四个配置文件mapred-site.xml

![]()

<configuration>

<!-- 指定mapreduce变成模型运行在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

第五个配置文件yarn-site.xml

![]()

<configuration>

<!-- 指定yarn的老大resourcemanager的地址 -->

<property>

<name>yaran.resourcemanager.hostname</name>

<value>hadoop.edu360.cn</value>

</property>

<!-- mapreduce执行shuffle时获取数据的方式 -->

<property>

<name>yaran.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

对hdfs进行初始化,就是格式化namenode

如果运行./hdfs namenode -format后出现下面情况

找不到hadoop.edu360.cn,永久修改主机名hostname

sudo vim /etc/hostname

sudo vim /etc/hosts

![]()

修改前: ,修改后

,修改后

重新运行./hdfs namenode -format

![]()

再次运行./hdfs namenode -format如果出现下面两幅图的情况就说明格式化namenode成功

运行./start-dfs.sh

提示Permission denied(publickey,password)

https://stackoverflow.com/questions/15211848/hadoop-start-dfs-sh-permission-denied

运行ssh-keygen

运行cp /home/mwt/.ssh/id_rsa.pub /home/mwt/.ssh/authorized_keys

![]()

再次运行./start-dfs.sh

HDFS管理界面:http://192.168.218.128:50070/

运行./start-yarn.sh

yarn的管理界面:http://192.168.218.128:8088/

使用 lsof 命令来查看某一端口是否开放,如果有显示说明已经开放了,如果没有显示说明没有开放

查看防火墙状态sudo ufw status

---> Status: inactive

键入以下命令卸载防火墙,并在启动时禁用防火墙sudo ufw disable

重启sudo reboot -h now

https://www.cnblogs.com/EasonJim/p/7595213.html

netstat -nltp

修改配置文件hdfs-site.xml

<!-- 配置hdfs的namenode的ip地址和端口 -->

<property>

<name>dfs.namenode.http-address</name>

<value>hadoop.edu360.cn:50070</value>

</property>

重启hdfs和yarn后再次运行netstat -nltp

sudo vim /etc/hosts

https://blog.csdn.net/kouryoushine/article/details/78401976

https://www.cnblogs.com/Springmoon-venn/p/8727275.html

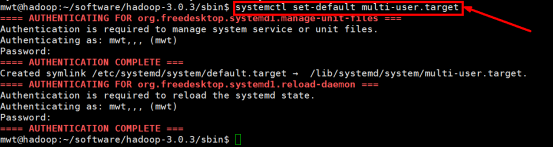

执行systemctl set-default multi-user.target

https://www.jb51.net/article/118426.htm

安装CentOS-7-x86_64-DVD-1804.iso

sudo vim /etc/profile

最后一行export PATH=$path:/sbin

sudo reboot -h now