改时间

clock --set --date="02/22/19 10:50" #改时间

clock --hctosys #同步硬件时间

clock --show 展示硬件时间

配置主节点名

vi /etc/sysconfig/network

添加:

NETWORKING=yes

HOSTNAME=master

重启即可永久生效(hostname xxx可以临时修改)

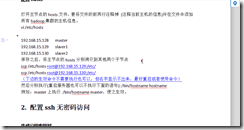

配置host

./bin/hostname master 使生效

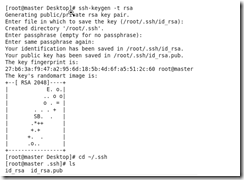

配置ssh免密码登录

在root用户下输入ssh-keygen -t rsa 一路回车

秘钥生成后在~/.ssh/目录下,有两个文件id_rsa(私钥)和id_rsa.pub(公钥),

三个系统都生成好之后,slave1和slave2将公钥传给master,master追加到authorized_keys后,在分发给slave1和slave2

[root@master .ssh]# cat id_rsa_slave1.pub >> authorized_keys

[root@master .ssh]# cat id_rsa_slave2.pub >> authorized_keys

将公钥复制到authorized_keys并赋予authorized_keys 600权限(cp id_rsa.pub authorized_keys)

或者

同理在slave1和slave2节点上生成秘钥,然后将秘钥复制到master节点上的authoized_keys

将master节点上的authoized_keys远程传输到slave1和slave2的~/.ssh/目录下

检查是否免密登录(第一次登录会有提示)

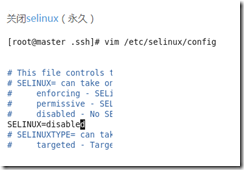

关闭防火墙

其中一种方法

安装JDK

首先卸载系统自带的jdk

查询安装了哪些jdk:rpm -qa | grep jdk

卸载jdk:

rpm -e:卸载rpm包

Nodeps:强制卸载

rpm -e --nodeps java-1.6.0-openjdk-javadoc-1.6.0.0-1.66.1.13.0.el6.x86_64

安装在同一位置/opt/java/jdk1.7.0_72

下载JDK

解压JDK : tar -zxvf /opt/java/jdk-7u72-linux-x64.gz

配置环境变量, 编辑profile文件:

vi /etc/profile

在profile文件末尾添加以下代码:

export JAVA_HOME=/opt/java/jdk1.7.0_72

export JRE_HOME=$JAVA_HOME/jre

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/lib

保存后,使刚才编辑的文件生效:

source /etc/profile

测试是否安装成功:java –version

安装Hadoop

在master主机上安装hadoop

安装位置自定,例如安装在/usr目录下面

下载hadoop包,放在/usr目录下,解压hadoop

tar -zxvf /opt/hadoop/hadoop-2.6.4.tar.gz

在usr下面生成hadoop-2.6.4目录

配置环境变量:

vi /etc/profile

在末尾添加:

export HADOOP_HOME=/usr/ hadoop-2.6.4

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

保存后使新编辑的profile生效:

source /etc/profile

配置Hadoop

需要配置的文件的位置为/hadoop-2.6.4/etc/hadoop,需要修改的有以下几个

hadoop-env.sh

yarn-env.sh

core-site.xml

hdfs-site.xml

mapred-site.xml

yarn-site.xml

slaves

其中

hadoop-env.sh和yarn-env.sh里面都要添加jdk的环境变量

hadoop-env.sh中

# The java implementation to use.

export JAVA_HOME=/opt/java/jdk1.7.0_72

(红色为新添加的内容,其他的代码是文件中原有的)

# The jsvc implementation to use. Jsvc is required to run secure datanodes

# that bind to privileged ports to provide authentication of data transfer

# protocol. Jsvc is not required if SASL is configured for authentication of

# data transfer protocol using non-privileged ports.

#export JSVC_HOME=${JSVC_HOME}

yarn-env.sh中

# User for YARN daemons

export HADOOP_YARN_USER=${HADOOP_YARN_USER:-yarn}

# resolve links - $0 may be a softlink

export YARN_CONF_DIR="${YARN_CONF_DIR:-$HADOOP_YARN_HOME/conf}"

# some Java parameters

export JAVA_HOME=/opt/java/jdk1.7.0_72

(红色为新添加的内容,也可以将注释解开,其他的代码是文件中原有的)

core-site.xml中

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>131072</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/temp</value>

</property>

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

</configuration>

hdfs-site.xml中

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master:9001</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/dfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.web.ugi</name>

<value> supergroup</value>

</property>

</configuration>

说明:

mapred-site.xml中

(如果没有可以复制mapred-site.xml.template命名mapred-site.xml)

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>master:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>master:19888</value>

</property>

</configuration>

yarn-site.xml中

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>master:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>master:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>master:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>master:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>master:8088</value>

</property>

</configuration>

slaves中(最好把原有的localhost删除)

master

slaver1

slaver2

拷贝hadoop安装文件到子节点

主节点上执行:

scp -r /usr/hadoop-2.6.4 root@slaver1:/usr

scp -r /usr/hadoop-2.6.4 root@slaver2:/usr

拷贝profile到子节点

主节点上执行:

scp /etc/profile root@slaver1:/etc/

scp /etc/profile root@slaver2:/etc/

在两个子节点上分别使新的profile生效:

source /etc/profile

格式化主节点的namenode

主节点上进入hadoop目录

然后执行:

./bin/hadoop namenode –format

新版本用下面的语句不用hadoop命令了

./bin/hdfs namenode –format

提示:successfully formatted表示格式化成功

启动hadoop

主节点上在hadoop目录下执行:

./sbin/start-all.sh

主节点上jps进程有:

NameNode

SecondaryNameNode

ResourceManager

每个子节点上的jps进程有:

DataNode

NodeManager

如果这样表示hadoop集群配置成功

在浏览器地址栏输入master的IP地址+50070端口进行访问